导语

集智俱乐部联合西湖大学工学院特聘研究员赵世钰、浙江大学教授任沁源、鹏城实验室高级工程师崔金强,共同发起「大语言模型与多智能体系统」读书会,探究大语言模型给机器人领域带来的新思想新价值。

背景

背景

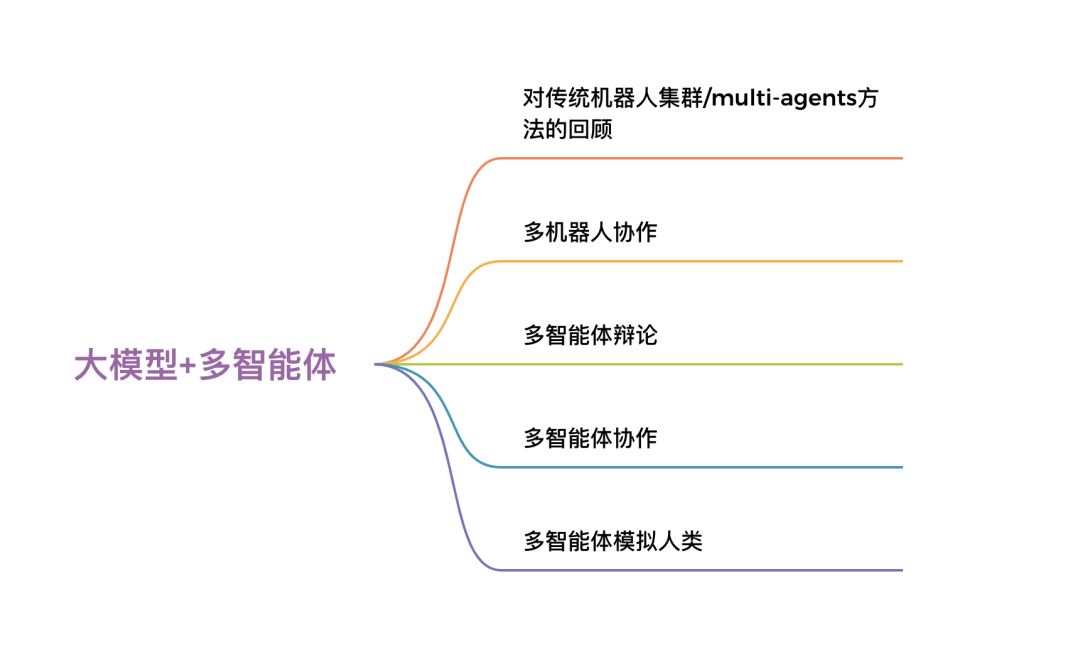

读书会框架

读书会框架

与复杂科学的关系

与复杂科学的关系

发起人介绍

发起人介绍

报名参与读书会

报名参与读书会

本读书会适合参与的对象

基于智能机器人的相关学科研究,特别是感兴趣智能机器人和大模型的一线科研工作者;

能基于读书会所列主题和文献进行深入探讨,可提供适合的文献和主题的朋友;

能熟练阅读英文文献,并对复杂科学充满激情,对世界的本质充满好奇的探索者;

想锻炼自己科研能力或者有出国留学计划的高年级本科生及研究生。

本读书会谢绝参与的对象

运行模式

本季读书会预计讨论分享8-10次,1次导论 + 6-8次专题内容 + 1次高层讨论,按暂定框架贯次展开;

举办时间

参与方式

报名方式

第一步:扫码填写报名信息。

第二步:填写信息后,付费299元。

第三步:添加负责人微信,拉入对应主题的读书会社区(微信群)。

共学共研模式与退费机制

加入社区后可以获得的资源:

在线会议室沉浸式讨论:与主讲人即时讨论交流

交互式播放器高效回看:快速定位主讲人提到的术语、论文、大纲、讨论等重要时间点(详情请见:解放科研时间,轻松掌握学术分享:集智斑图推出可交互式播放器)

高质量的主题微信社群:硕博比例超过80%的成员微信社区,闭门夜谈和交流

超多学习资源随手可得:从不同尺度记录主题下的路径、词条、前沿解读、算法、学者等

参与社区内容共创任务:读书会笔记、百科词条、公众号文章、论文解读分享等不同难度共创任务,在学习中贡献,在付出中收获。

共享追踪主题前沿进展:在群内和公众号分享最新进展,领域论文速递

参与共创任务,共建学术社区:

读书会笔记:在交互式播放器上记录术语和参考文献

集智百科词条:围绕读书会主题中重要且前沿的知识概念梳理成词条。例如:

论文解读分享:认领待读列表中的论文,以主题报告的形式在社区分享

论文摘要翻译:翻译社区推荐论文中的摘要和图注

公众号文章:以翻译整理或者原创生产形式生产公众号文章,以介绍前沿进展。例如:

论文翻译

- 诺奖之后的复杂科学:18位学者勾勒未来20年复杂系统研究图景

科普文章翻译

- 梅拉妮·米歇尔Science刊文:AI能否自主学习世界模型?

讲座整理

- AI何以涌现:复杂适应系统视角的ChatGPT和大语言模型

参考文献列表

参考文献列表

参考文献由徐璐峰、季文康提供。文献较多,为了更好的阅读体验,可前往集智斑图网站阅读,并收藏感兴趣的论文。

读书会阅读清单:https://pattern.swarma.org/article/279

多机器人协作

Mandi Z, Jain S, Song S. Roco: Dialectic multi-robot collaboration with large language models[J]. arXiv preprint arXiv:2307.04738, 2023.

这篇论文提出了一种新的多机器人协作方法,该方法利用预训练的大语言模型(LLMs)的强大功能进行高级通信和低级路径规划。机器人配备了LLMs讨论和集体推理任务策略的能力。

Zhang H, Du W, Shan J, et al. Building cooperative embodied agents modularly with large language models[J]. arXiv preprint arXiv:2307.02485, 2023.

实体智能体之间规划、沟通、协作,完成长期任务。这篇论文提出了一个新的框架,利用LLMs进行多智能体协作,并在不同的具体环境中进行测试。该框架允许智能体规划、沟通,并与其他智能体或人类有效合作,以高效完成长时程任务。

Michael Ahn, et al. AutoRT: "Embodied Foundation Models for Large Scale Orchestration of Robotic Agents"

大规模机器人代理协同自动化。AutoRT利用视觉-语言模型(VLMs)进行场景理解和基础定位,并进一步利用大语言模型(LLMs)提出多样化和新颖的指令,以供机器人队列执行。通过借助基础模型的知识引导数据收集,AutoRT能够有效地思考自主权权衡和安全性,并显著扩大机器人学习的数据收集。

多智能体辩论

Liang T, He Z, Jiao W, et al. Encouraging Divergent Thinking in Large Language Models through Multi-Agent Debate[J]. arXiv preprint arXiv:2305.19118, 2023.

多智能体之间持续辩论,从不同角度思考问题,解决复杂任务。论文提出了一个名为Multi-Agent Debate(MAD)的框架,其中多个智能体以“以牙还牙”的状态表达其论点,而一名裁判管理辩论过程以获得最终解决方案。MAD框架鼓励LLMs进行分歧思考,对需要深度思考的任务有帮助。

Du Y, Li S, Torralba A, et al. Improving Factuality and Reasoning in Language Models through Multiagent Debate[J]. arXiv preprint arXiv:2305.14325, 2023.

多智能体之间持续辩论,提高了生成内容的真实性,减少幻觉。文章提出了一种互补的方法,通过多个语言模型实例在多轮中提出和辩论各自的回答和推理过程,最终达成共同的最终答案。这种方法明显提升了在多个任务中的数学和战略推理能力。

Chan C M, Chen W, Su Y, et al. Chateval: Towards better llm-based evaluators through multi-agent debate[J]. arXiv preprint arXiv:2308.07201, 2023.

使用多智能体辩论的方式评估LLM在开放式问题以及NLG任务中的相应质量。提出了一种多代理辩论框架,超越了单一代理的提示策略。多代理的方法使一组LLMs能够与一系列智能对手协同工作,利用其独特的能力和专业知识,提高处理复杂任务的效率和效果。

Chen J C Y, Saha S, Bansal M. Reconcile: Round-table conference improves reasoning via consensus among diverse llms[J]. arXiv preprint arXiv:2309.13007, 2023.

多智能体圆桌辩论,解决复杂问题。RECONCILE通过多轮讨论,学习说服其他代理改进其答案,并采用置信度加权投票机制,增强了LLMs的推理能力。

Smit A, Duckworth P, Grinsztajn N, et al. Are we going MAD? Benchmarking Multi-Agent Debate between Language Models for Medical Q&A[J]. arXiv preprint arXiv:2311.17371, 2023.

对医学问答语言模型之间的多智能体辩论进行基准测试。

多智能体协作

Hao R, Hu L, Qi W, et al. ChatLLM Network: More brains, More intelligence[J]. arXiv preprint arXiv:2304.12998, 2023.

提出了ChatLLM网络,允许多个基于对话的语言模型进行交 互、提供反馈和共同思考。具体而言,网络中ChatLLM的各个实例可能对同一问题具有不 同的观点,通过通过一个独立的ChatLLM整合这些不同的观点,网络的优化使用基于语言的反向传播机制。

Li G, Hammoud H A A K, Itani H, et al. CAMEL: Communicative agents for" mind" exploration of large language model society[C]//Thirty-seventh Conference on Neural Information Processing Systems. 2023.

提出了一种基于角色扮演的多智能体协作框架。提供了一种可扩展的方法来研究多代理系统的合作行为和能力,并开源了一个支持沟通代理研究的库。

Wang Z, Mao S, Wu W, et al. Unleashing cognitive synergy in large language models: A task-solving agent through multi-persona self-collaboration[J]. arXiv preprint arXiv:2307.05300, 2023.

让单个Agent分裂成不同的角色,不同角色扮演了不同的Critic,共同完成复杂任务。

Dong Y, Jiang X, Jin Z, et al. Self-collaboration Code Generation via ChatGPT[J]. arXiv preprint arXiv:2304.07590, 2023.

多个Agent分工协作生成代码。具体来说,多个LLMs角色通过角色指令来组建团队,以协作和交互方式处理代码生成任务,而无需人工干预。组建了一个由三个 ChatGPT 角色(即分析师、编码员和测试员)组成的基本团队,分别对应软件开发的分析、编码和测试阶段。

Qian C, Cong X, Yang C, et al. Communicative agents for software development[J]. arXiv preprint arXiv:2307.07924, 2023.

多个Agent分工协作生成代码。论文核心是ChatDev框架,一个虚拟的基于聊天的软件开发公司,模仿了传统的瀑布模型,将开发过程细分为设计、编码、测试和文档四个明确定义的阶段。

Zhang J, Xu X, Deng S. Exploring collaboration mechanisms for llm agents: A social psychology view[J]. arXiv preprint arXiv:2310.02124, 2023.

探索代理人的协作机制LLM:社会心理学观点。论文虚构了四个由LLM智能体组成的独特“社会”,其中每个智能体都具有特定的“特质”(随和或过度自信),并以独特的“思维模式”(辩论或反思)进行合作。

Sun Q, Yin Z, Li X, et al. Corex: Pushing the Boundaries of Complex Reasoning through Multi-Model Collaboration[J]. arXiv preprint arXiv:2310.00280, 2023.

通过多模型协作突破复杂推理的界限。受人类行为的启发,Corex 由多种协作范式组成,包括辩论、审查和检索模式,这些模式共同致力于提高推理过程的事实性、忠实度和可靠性。这些范式促进了与任务无关的方法,使LLM能够“跳出框框思考”,从而克服幻觉并提供更好的解决方案。

Wang Z, Wang W, Li Z, et al. XUAT-Copilot: Multi-Agent Collaborative System for Automated User Acceptance Testing with Large Language Model[J]. arXiv preprint arXiv:2401.02705, 2024.

基于大语言模型的自动化用户验收测试的多智能体协作系统。

多智能体模拟人类

Xu Y, Wang S, Li P, et al. Exploring large language models for communication games: An empirical study on werewolf[J]. arXiv preprint arXiv:2309.04658, 2023

多个Agent玩狼人杀游戏。论文中展示了LLM具有的欺骗、伪装、领导等特质。

Park J S, O'Brien J, Cai C J, et al. Generative agents: Interactive simulacra of human behavior[C]//Proceedings of the 36th Annual ACM Symposium on User Interface Software and Technology. 2023: 1-22.

25个Agent构成模拟社会,这些Agent自发涌现出各种人类行为,如早起、做早餐、上班、绘画、写作、形成观点、注意他人、发起对话等。它们具有记忆、反思以及通过自然语言规划行为的能力。

Fu Y, Peng H, Khot T, et al. Improving language model negotiation with self-play and in-context learning from ai feedback[J]. arXiv preprint arXiv:2305.10142, 2023.

两个LLMs扮演买方和卖方的角色进行谈判。他们的 目标是与买方达成一个较低价格,与卖方达成一个较高价格。第三个语言 模型扮演评论家的角色,为玩家提供反馈以改进他们的谈判策略。

Wang Z, Chiu Y Y, Chiu Y C. Humanoid agents: Platform for simulating human-like generative agents[J]. arXiv preprint arXiv:2310.05418, 2023.

模拟人类的饥饿、健康、能力、情感需求,是Generative Agent的延续之作。

Akata E, Schulz L, Coda-Forno J, et al. Playing repeated games with Large Language Models[J]. arXiv preprint arXiv:2305.16867, 2023.

研究LLM进行博弈论游戏时的表现。采用行为博弈理论来研究LLMs的合作和协调行为。通过让不同的LLMs(GPT-3、GPT-3.5和GPT-4)在有限重复的游戏中相互对战,以及与其他类似人类的策略进行对战,来了解它们的行为。

关于集智俱乐部读书会和主办方

关于集智俱乐部读书会和主办方

集智俱乐部读书会是面向广大科研工作者的系列论文研读活动,其目的是共同深入学习探讨某个科学议题,了解前沿进展,激发科研灵感,促进科研合作,降低科研门槛。

读书会活动始于 2008 年,至今已经有 50 余个主题,内容涵盖复杂系统、人工智能、脑与意识、生命科学、因果科学、高阶网络等。凝聚了众多优秀科研工作者,促进了科研合作发表论文,孵化了许多科研产品。如:2013 年的“深度学习”读书会孕育了彩云天气 APP,2015 年的“集体注意力流”读书会产生了众包书籍《走近2050》,2020年的开始因果科学读书会孕育了全国最大的因果科学社区等。

主办方:集智俱乐部

联合主办方:Datawhale

协办方:集智学园

集智俱乐部成立于 2003 年,是一个从事学术研究、享受科学乐趣的探索者的团体,也是国内最早的研究人工智能、复杂系统的科学社区。它倡导以平等开放的态度、科学实证的精神,进行跨学科的研究与交流,力图搭建一个中国的 “没有围墙的研究所”。

Datawhale成立于2018年——是国内AI领域最大的开源学习组织,汇聚了众多有开源精神和探索精神的开源贡献者,致力于构建开源学习社区,和学习者一起成长。

点击“阅读原文”,报名读书会

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢