【全球AI战略洞察】栏目由清华大学人工智能国际治理研究院推出,旨在通过对当前人工智能领域发生的重要信息进行“标注、提炼、解读”,剖析全球AI治理各国家间不同的战略图景,以此描绘人工智能治理领域的国际格局。

栏目主理人:刘典

复旦大学中国研究院副研究员、清华大学人工智能国际治理研究院战略与宏观研究项目主任

作为全球治理合作的中枢,AI治理联盟旨在解决人工智能的多方面挑战和机遇,为决策者提供引导,确保人工智能在未来与人类价值观保持一致,同时促进社会进步。该联盟由“安全系统和技术”“负责任应用与转型”和“弹性治理和监管”三个核心工作组构成。本次发布的系列简报是来自200余个组织的250多名成员的共同成果。该系列简报包含多方观点,为引导人工智能的发展、应用和治理划清了重点领域。

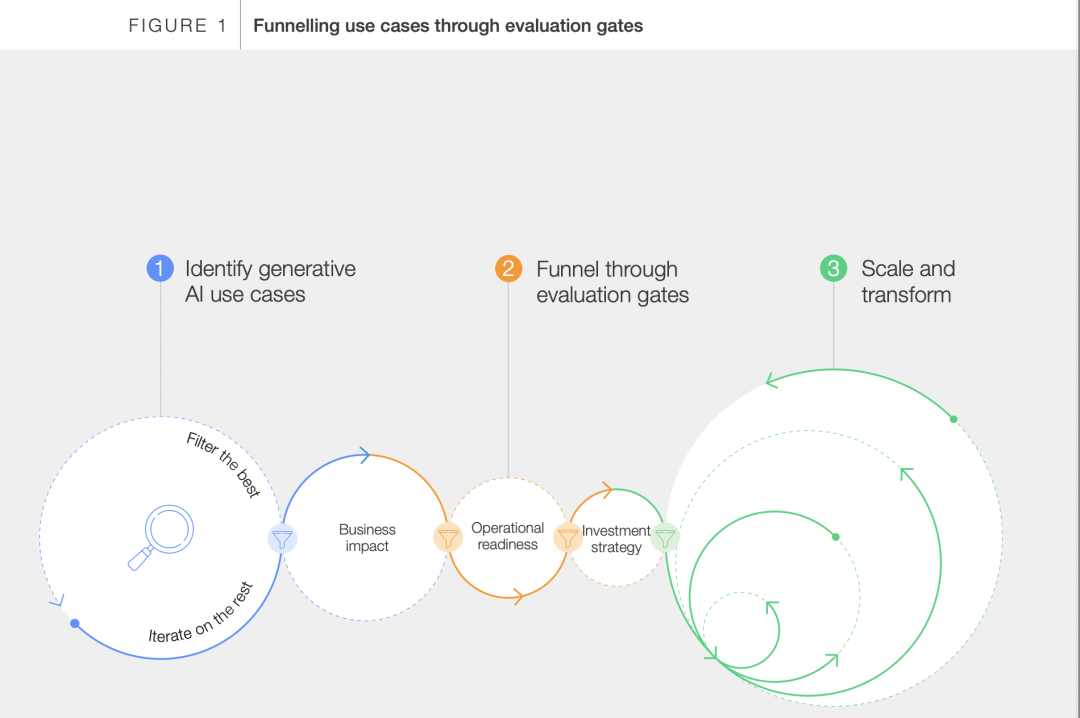

开发安全系统和技术——简报一 Presidio AI框架:开发安全的生成式人工智能模型 建立“Presidio AI 框架”(The Presidio AI Framework):一个以人工智能生命全周期、强大的风险防范措施和早期安全防护为核心的全面框架。倡导多方合作,强调共同责任和积极的风险管理。 该框架强调通过在生成式人工智能生命周期的早期阶段实施适当的防护措施,实现共同责任、缓解风险。 保证负责任应用与转型——简报二 从生成式人工智能中释放价值:指导负责任的转型 解决责任问题:进行明确治理 解决信任问题:通过沟通提升透明度 解决规模挑战:多样化、灵活的运营结构 解决人类影响:基于价值的变革管理 业务影响(Business Impact)

运营准备(Organizational Readiness/ Operational Readiness)

投资战略 (Investment Strategy)

该简报分析了生成式人工智能的颠覆性影响,且指出领导者采用基于用例的方法部署人工智能模型的必要性 评估包含三方面 负责任的转型: 推动弹性治理和监管——简报三 生成式人工智能治理:打造全球共同未来

主要阐释了人工智能治理的复杂性,通过比较各国政策响应,重点关注治理方法和监管措施; 同时,该文突出了生成式人工智能的关键争议,包括风险优先级和开放度(access spectrum)。 倡导国际合作,强调开放公平访问渠道以及共同监管的要求,提出要将发展中国家纳入治理体系。

简报一 Presidio AI框架:开发安全的生成式人工智能模型

共同责任, 早期风险识别 以及实施适当的防护措施,

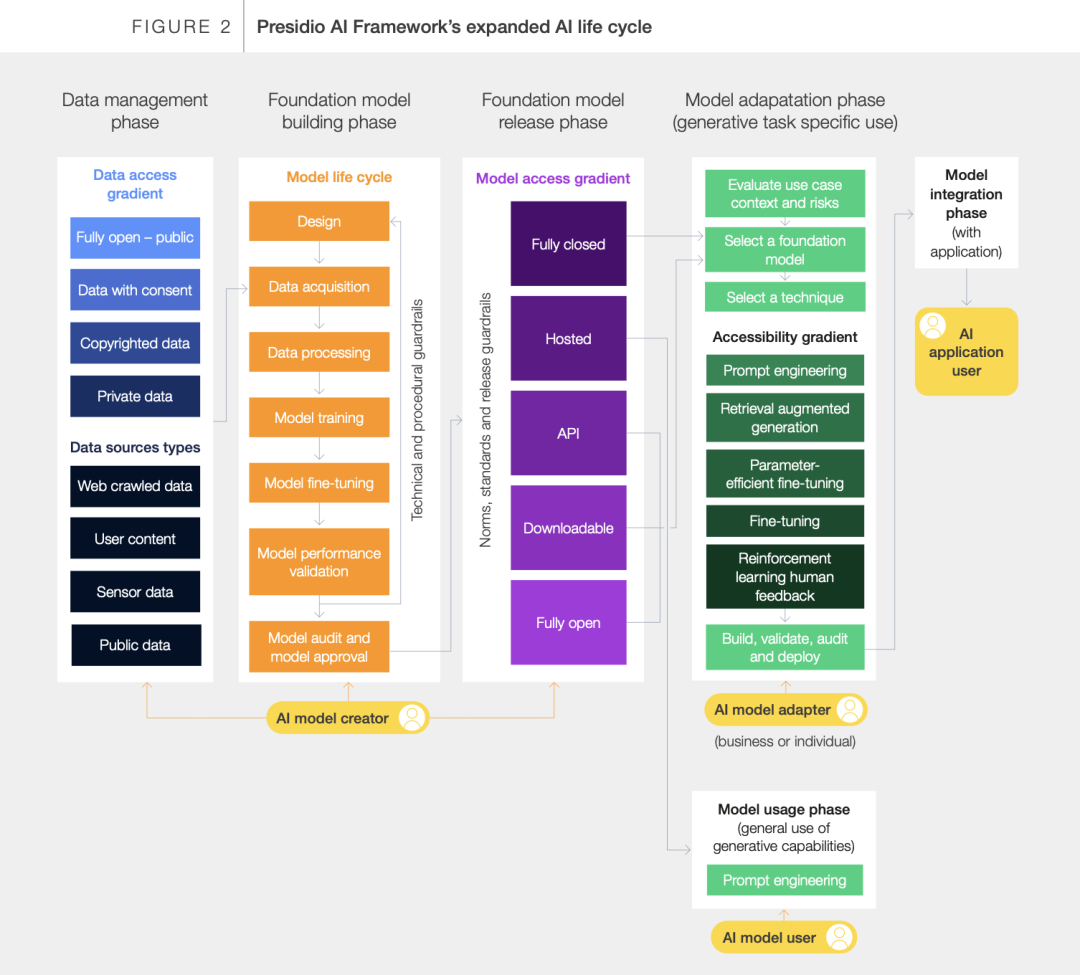

人工智能生命全周期(Expanded AI life cycle) 建立生成式人工智能生命周期的全面视图,表示在每个阶段都有不同的参与者,责任水平不一。

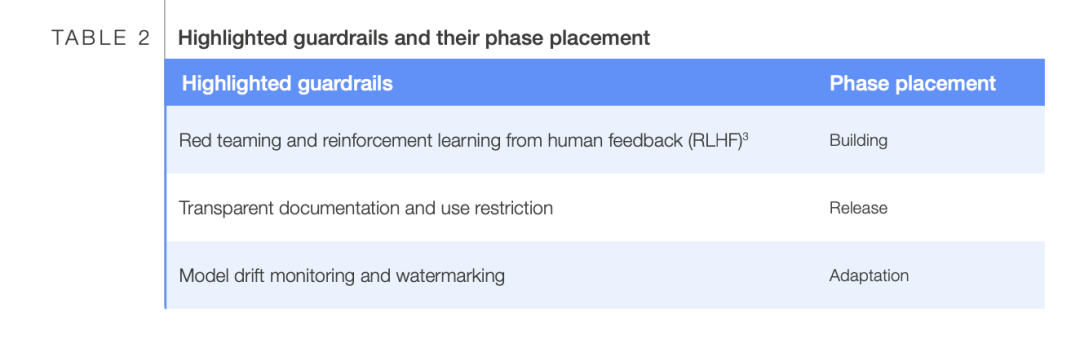

扩展风险防护措施(Expanded risk guardrails) 该框架详细说明了在生成式人工智能生命周期的不同阶段中考虑的防护措施,强调风险预防。

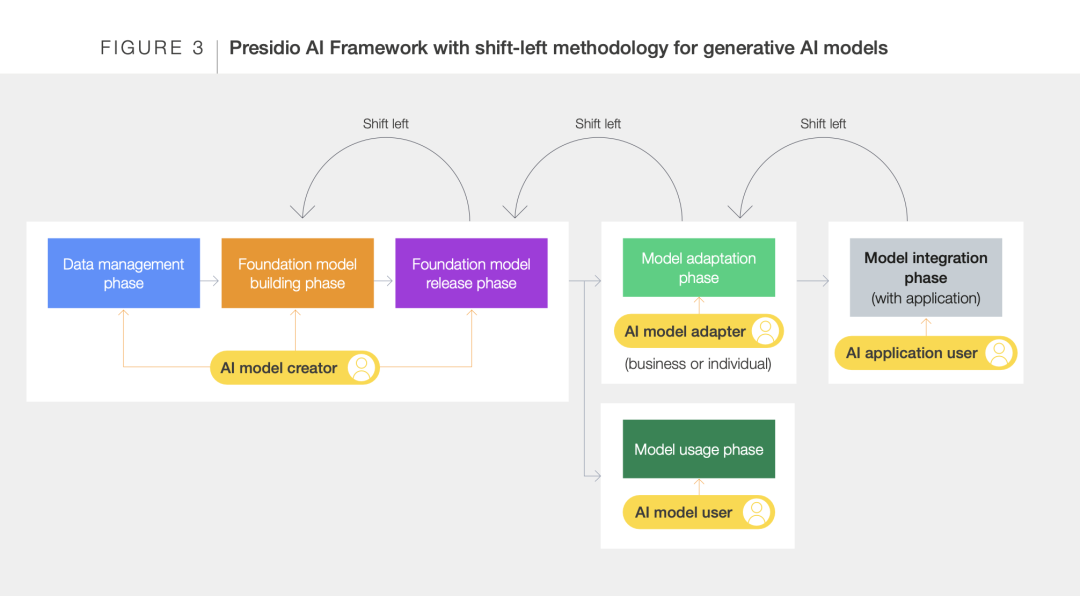

左移方法论(Shift-left methodology)

该方法论提议在生成式人工智能生命周期的早期阶段实施安全防护措施,以减轻风险并提高效率。

从发布到构建:在模型构建阶段,人工智能模型开发者主动加入防护措施,并收集必要数据和模型信息,及其透明度信息。 从适配/使用到发布:在模型发布阶段,人工智能模型开发者加入额外的防护措施,建立使用的规范和标准,并完成全面记录,以帮助下游参与者理解模型,做出关于模型使用的知情决策。 从应用到适配:在模型适配阶段,适配者在将AI模型适配应用时,参考模型开发者所提供的基础模型记录,加入防护措施。

简报二 从生成式人工智能中释放价值:指导负责任的转型

该简报提出,在采纳生成式人工智能用例之前,可以通过以下方面对其进行评估后,再扩大应用规模和转型。

业务影响(Business Impact): 是否通过提高生产率或提升人的技能、是否通过赋予普通人以专业技术和知识能力从而提升底线、是否能够解决人类目前无法解决的问题从而提升上限等。 运营准备(Organizational Readiness/ Operational Readiness): 模型应用阶段:技术人才 技术基础设施 模型发布阶段:人工反馈循环 可解释性和可审计性 模型安全 模型适配阶段:责任 合法性 利益相关方信任 其他:数据管理 投资战略 (Investment Strategy)

负责任的转型:

解决责任问题:针对即时和下游结果,进行明确治理

解决信任问题:通过沟通提升透明度 解决规模挑战:多样化、灵活的运营结构 解决人类影响:基于价值的变革管理

简报三 生成式人工智能治理:打造全球共同未来

治理方法:AI治理可能侧重于风险、规则、原则或结果,以及是否已制定国家AI战略。 监管措施:AI治理原则可能基于现有的法律法规和官方机构,或新的监管机制。

风险优先级:如何优先处理人工智能的当前危害和潜在风险。 人工智能既存在短期危害,也存在一系列潜在的长期风险。关于如何确定应优先考虑人工智能的风险,以及应该考虑的时间范围,存在各种观点。 开放度:治理将如何规定人工智能技术的开放度问题

国际合作(international cooperation) 司法互通(jurisdictional interoperability) 共同治理(inclusive governance)

国际协调: 为确保治理方法的合法性,需要囊括多利益相关方,包括政府、民间社会、学术界、工业界以及受影响的社群,基于对人工智能社会经济影响的协作评估,确保各方的意见得到充分考虑。 制定可兼容的标准: 为防止标准出现重大分歧,相关国家机构应提高兼容度,并努力与国际标准化计划合作。 为了广泛采用国际标准,标准制定必须有各国参与,能够代表各国意见。 灵活的监管机制: 为了跟上人工智能发展能力的速度,及时调整创新和治理框架,应迅速而具有高适配性。(灵活的监管机制需要考虑社会因素,且能随着生成式人工智能技术的发展,依旧适配不同文化、领域。)

公平开放的人工智能技术获取渠道: 基础设施:算力、云服务提供商和能源资源获取不足 数据:模型训练的数据和设计不足 人才:获取教育和技术专业知识的途径不足 治理:机构能力和政策制定不足 开发生成式人工智能系统需要庞大的计算和云基础设施,需要高投入、高能耗。 研究和开发生成式人工智能模型所需的计算基础设施主要只有少数几个拥有足够资金的行业实验室可以接触。 全球南方因此无法参与先进人工智能模型开发。 当前主要的生成式人工智能模型主要由美国和中国开发,并使用来自北美、欧洲和中国的数据进行训练。在生成式人工智能的发展和治理中积极纳入发展中国家的多样化声音至关重要。 全球南方的学生通常无法获取开发新兴技术(如生成式人工智能)所需的教育和指导。 这可能导致生成式人工智能研究人员和工程师的全球代表性不足,后续可能导致生成式人工智能产品中出现算法偏见和歧视现象。 全球南方打造高质量教育和生成式人工智能专业知识,对于建立可持续的人才储备,并扩大生成式人工智能研究的区域范围至关重要。 此外,来自全球南方的更多研究人员和工程师将带来生成式人工智能思想的多样性 经济弱势国家往往缺乏制定有效人工智能治理政策所需的财政、政治和技术资源,这些国家内的监管机构严重缺乏资金。 人工智能治理能力的不平等可能加强现有的权力失衡,且无法从生成式人工智能获益。没有关于数据和人工智能的治理政策可能导致隐私侵犯、滥用以及无法充分利用人工智能促进社会经济发展等问题。 此外,资金不足的监管机构可能无法应对人工智能的伦理、法律和社会影响。 人工智能创新能够赋能全球各地区实现经济增长和发展目标,在卫生服务、提高教育质量、提高农业生产率等方面改善人们生活。 目前,全球南方在基础设施、数据、人才和治理四个方面都面临结构性不平等、权力失衡问题。 共同治理人工智能: 为了充分解决独特的地区性问题,防止发展中国家在人工智能价值链中仅仅成为端点,必须重新制定治理框架,确保全球南方能够参与人工智能创新和治理。

将全球南方纳入人工智能治理

主理人丨刘典

关于我们

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢