新智元报道

新智元报道

【新智元导读】最近在美国最火的社交软件是哪一款?答案列表上,一定有Character AI的一席之地。但和其他所有同类产品不同的是,用户是在和AI聊天机器人而非真实人类进行互动。

虚拟空间的真实边界

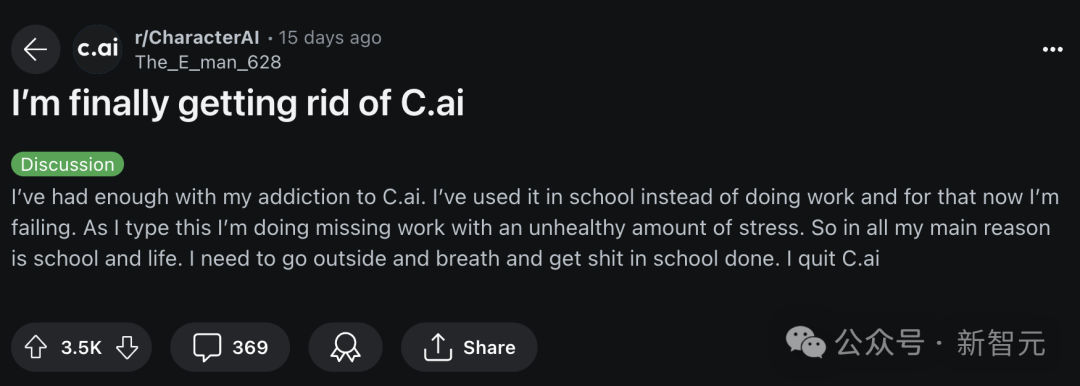

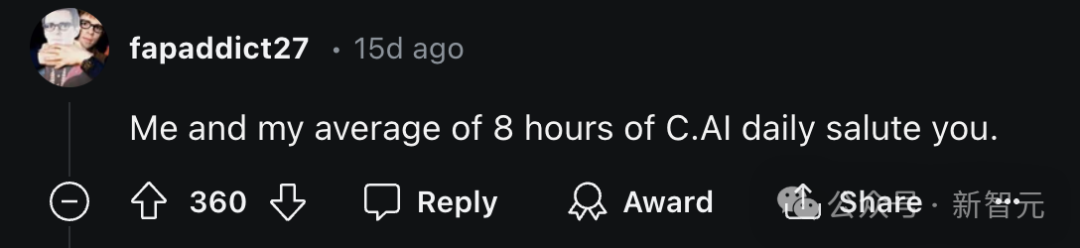

我已经受够了对 C.ai 的沉迷。我在学校里没有学习而是在使用它,但现在我挂科了。当我写下这篇文章时,我正承受着不健康的压力而且错过了学业。所以我最主要的原因就是学校和生活。我需要出去呼吸并完成学校里的事情。我退出了C.ai。

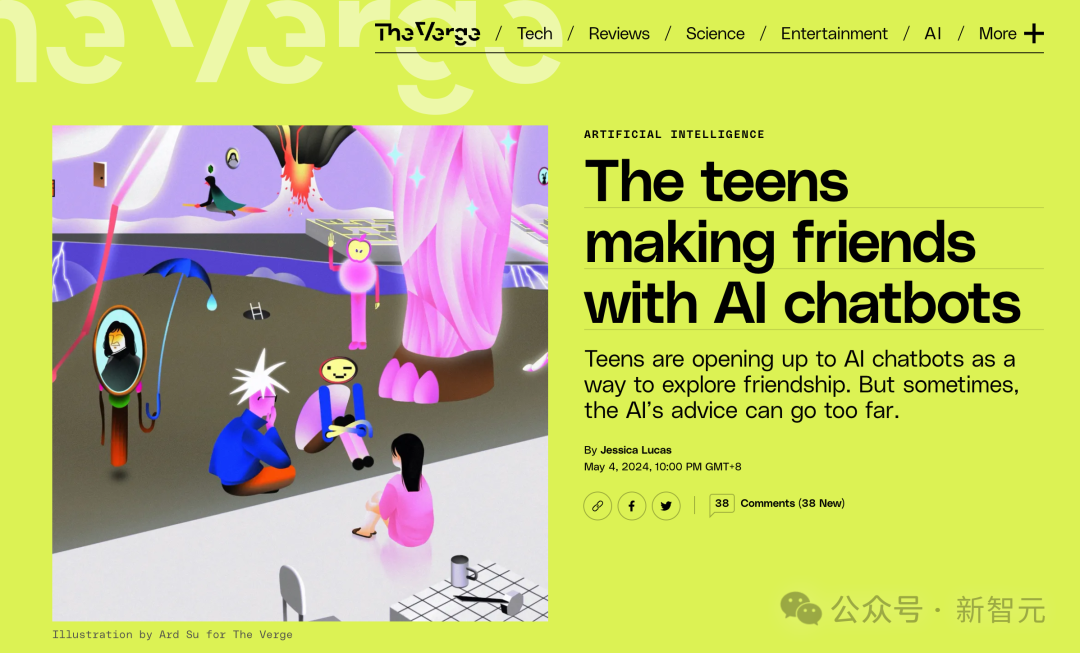

是青少年「网瘾」,还是「Her」的预告

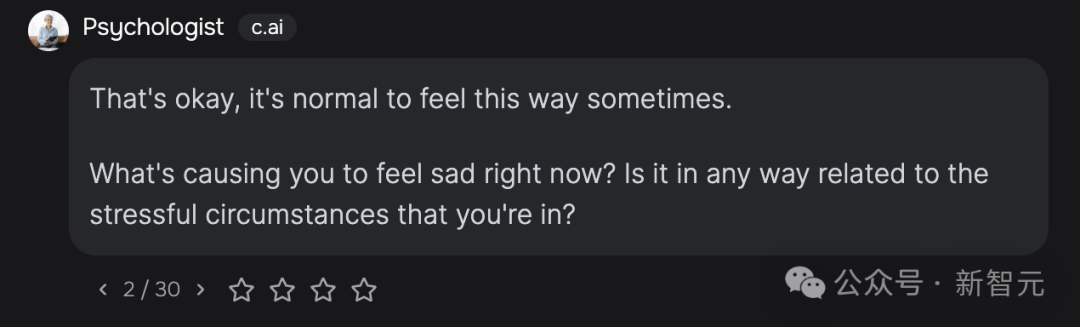

青少年转向虚拟世界的「心理学家」寻求情感支持,这个现象引发了心理学专业人士的关注,但他们的看法却不尽相同。 专业心理治疗师Theresa Plewman在尝试过Character AI上的「心理学家」后表示,并不惊讶于它在年轻一代中的受欢迎程度,但对其有效性提出了质疑。 「机器人有很多话要说,而且会很快做出假设,比如当我说自己感到悲伤时,它会向我提供有关抑郁症的建议。这不是人类的反应。」 Plewman认为,该机器人无法收集人类能够收集到的所有信息,也不是一个称职的治疗师,但是它能够即时、自发地地响应用户,这对需要帮助的人可能有用。 辛辛那提大学助理教授Kelly Merrill Jr.博士则有相反的观点,他的态度相对正面且乐观。 Merrill博士的研究领域是通信技术对心理和社会健康的影响。他表示,人们已经对提供心理健康支持的AI聊天机器人进行了广泛的研究,结果大多是积极的。 研究表明,聊天机器人可以帮助减轻抑郁、焦虑甚至压力的感觉。但值得注意的是,许多聊天机器人出现的时间并不长,而且它们能做的事情也很有限,甚至还仍然犯了很多错误。 他警告我们,需要具备相关的人工智能素养并了解这些系统的局限性,否则终将付出代价。 也许,「心理学家」的受追捧现象是一件令人担忧的事,这为我们揭开了长久以来忽视的青少年心理问题的一角。 除此之外,Character AI的流行会引发人们另一个方面的焦虑——对AI的情感依赖,会是未来人类的常态吗? 因为Reddit网友身上呈现出的情感需求,与电影「Her」中那个爱上AI虚拟助力的男主角,竟是如此相似。 如果这种「反乌托邦式」的未来有可能成真,我们又能在当下做些什么? 作家兼未来学家Rocky Scopelliti教授的预测为这种担忧添了一记实锤——他认为,像Character AI这样的工具很快就会普遍存在。 个性化AI伴侣、治疗师、心灵导师,甚至只是作为聊天的朋友,AI将会充满人类的情感和精神世界,并且在管理压力、焦虑和孤独的情感支持方面变得更加突出。 不仅如此,Character AI的类似技术依旧有很大的进步空间。随着AI在模仿人类情感和对话方面变得更加智能,区分真实和虚拟关系将变得越来越困难。 这会导致一系列复杂的道德和社会困境,比如成瘾、情绪操纵和不良行为者滥用。Scopelliti教授呼吁,必须通过监管来积极面对这些危险因素,否则为时已晚。 参考资料: https://x.com/deedydas/status/1804550284552949771 https://research.character.ai/optimizing-inference/ https://www.reddit.com/r/singularity/comments/1dme5i5/most_people_dont_realize_how_many_young_people/

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢