论文题目:Exploring Probabilistic Models for Semi-supervised Learning

作者:Jianfeng Wang

类型:2023年博士论文

学校:University of Oxford(英国牛津大学)

下载链接:

链接: https://pan.baidu.com/s/1pwQhoEpsGKFbs6Nx0pHvAw?pwd=x2hy

硕博论文汇总:

链接: https://pan.baidu.com/s/1Gv3R58pgUfHPu4PYFhCSJw?pwd=svp5

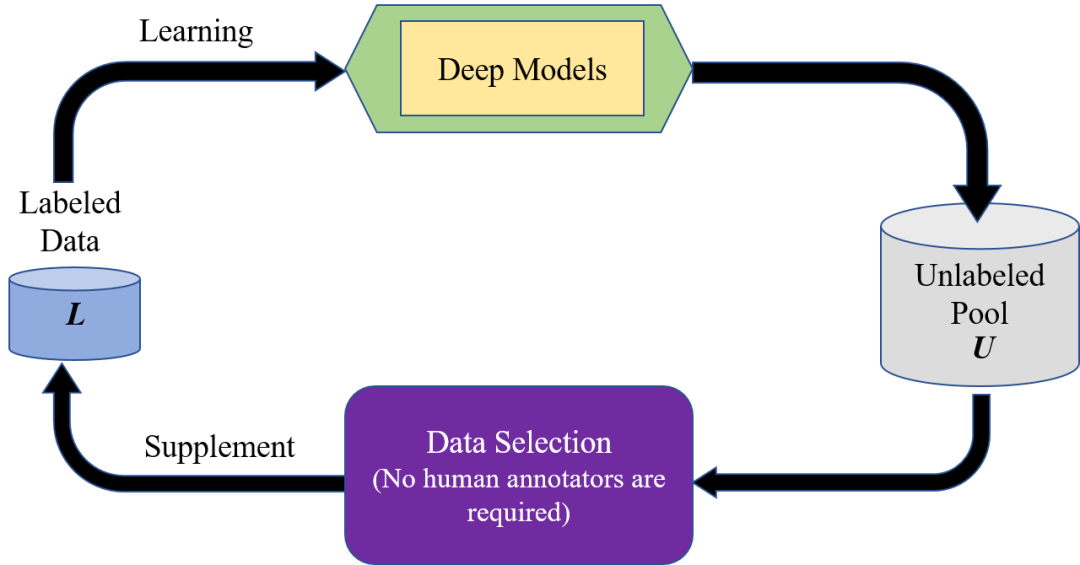

SSL 流程概述。与主动学习不同,SSL 不需要用户参与选择数据。所选数据用于扩大原始标记数据集,是否使用伪标签取决于所采用的训练策略(例如,伪标记策略或一致性策略)。

SSL 流程概述。与主动学习不同,SSL 不需要用户参与选择数据。所选数据用于扩大原始标记数据集,是否使用伪标签取决于所采用的训练策略(例如,伪标记策略或一致性策略)。

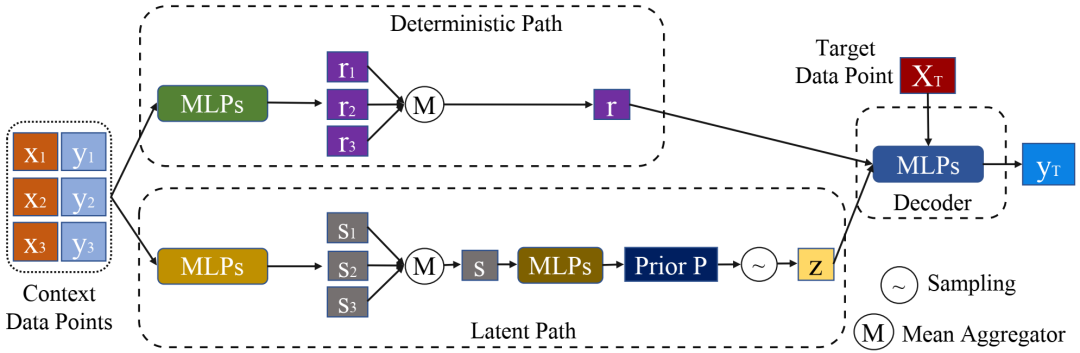

原始 NP 的概述。

原始 NP 的概述。

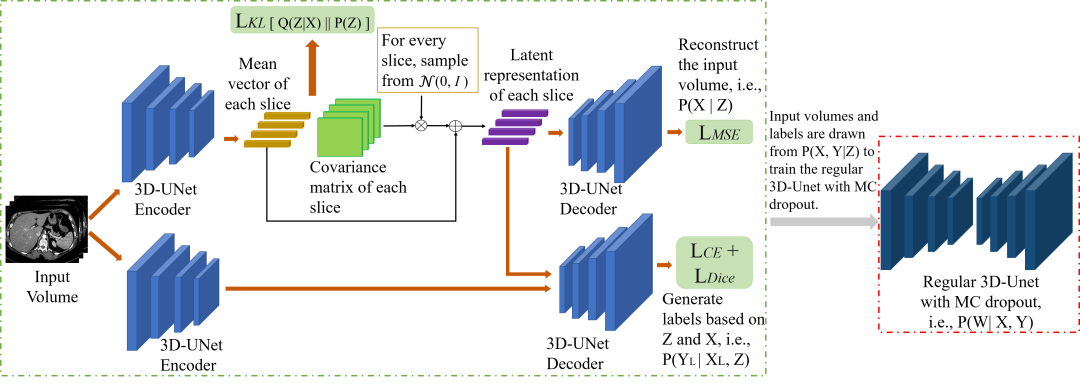

GBDL 用于半监督体积医学图像分割,包括潜在表示学习 (LRL) 架构(绿色虚线框中)和带有 MC dropout 的常规 3D-UNet(红色虚线框中)。测试期间仅使用带有 MC dropout 的常规 3D-UNet。为简单起见,省略了配对 3D-UNet 编码器和解码器之间的快捷连接。

GBDL 用于半监督体积医学图像分割,包括潜在表示学习 (LRL) 架构(绿色虚线框中)和带有 MC dropout 的常规 3D-UNet(红色虚线框中)。测试期间仅使用带有 MC dropout 的常规 3D-UNet。为简单起见,省略了配对 3D-UNet 编码器和解码器之间的快捷连接。

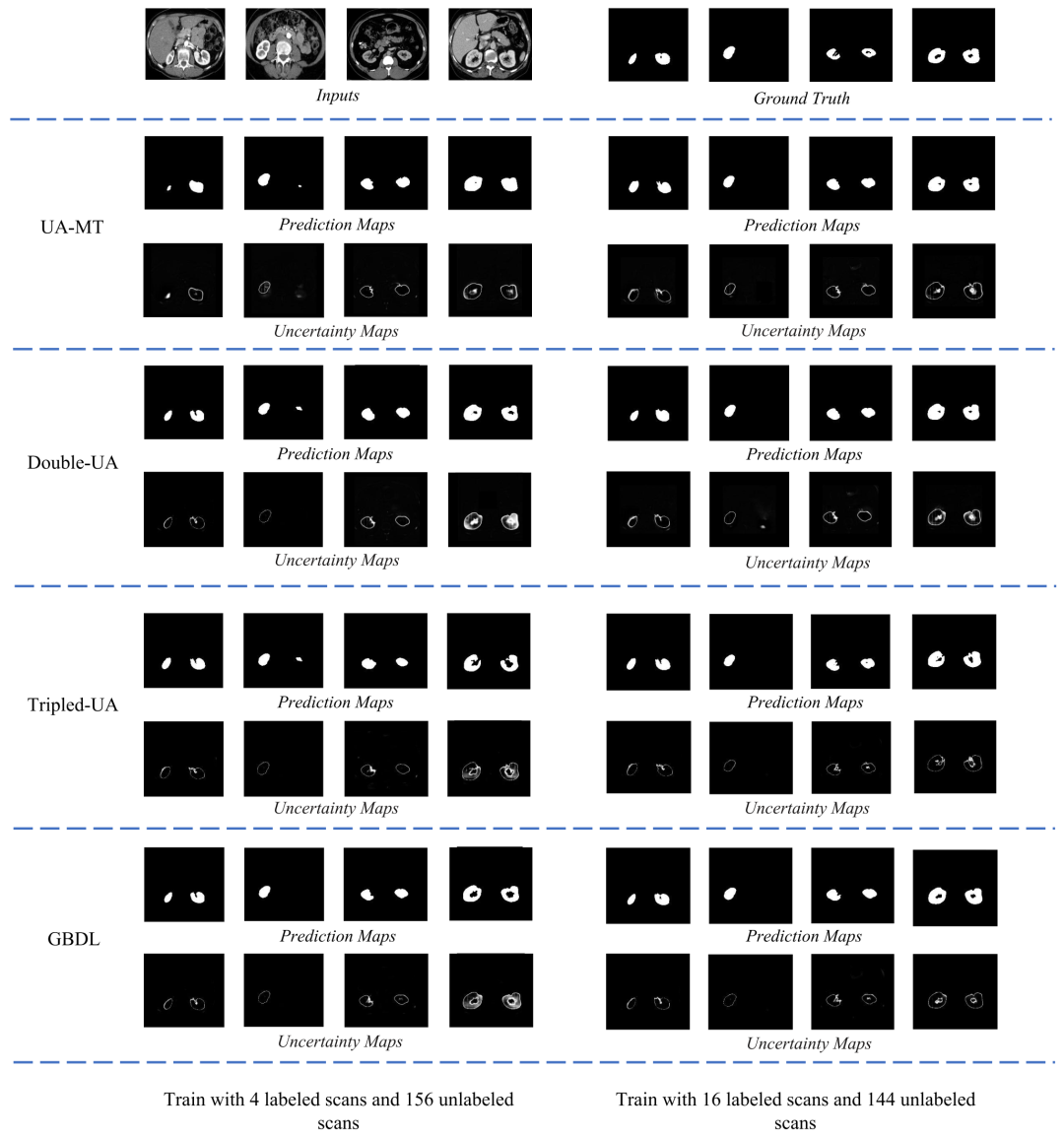

对 KiTS19 数据集中一些预测切片进行可视化,以适应不同的基于贝叶斯深度学习的方法。

对 KiTS19 数据集中一些预测切片进行可视化,以适应不同的基于贝叶斯深度学习的方法。

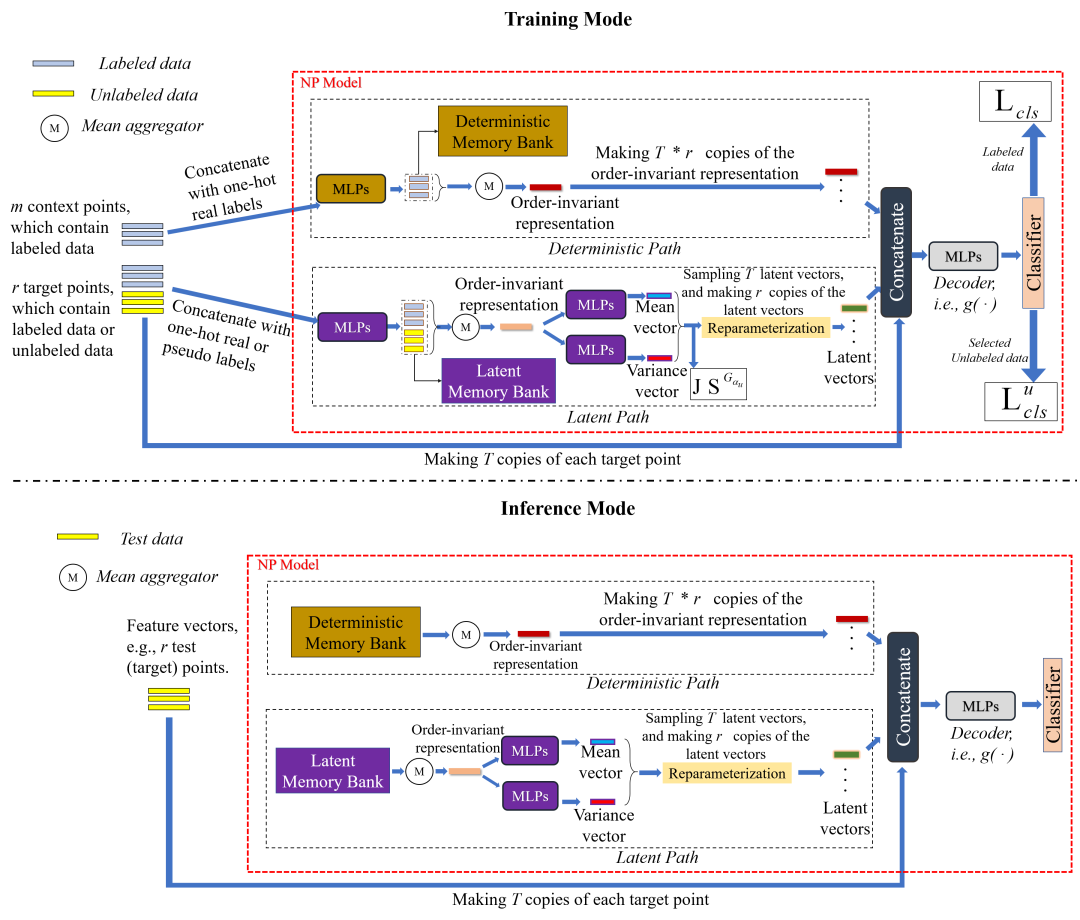

NP-Match 概述。NP 模型显示在红色虚线框中,其输入特征向量来自卷积神经网络 (CNN) 中的全局平均池化层。为简单起见,图中省略了 CNN。

NP-Match 概述。NP 模型显示在红色虚线框中,其输入特征向量来自卷积神经网络 (CNN) 中的全局平均池化层。为简单起见,图中省略了 CNN。

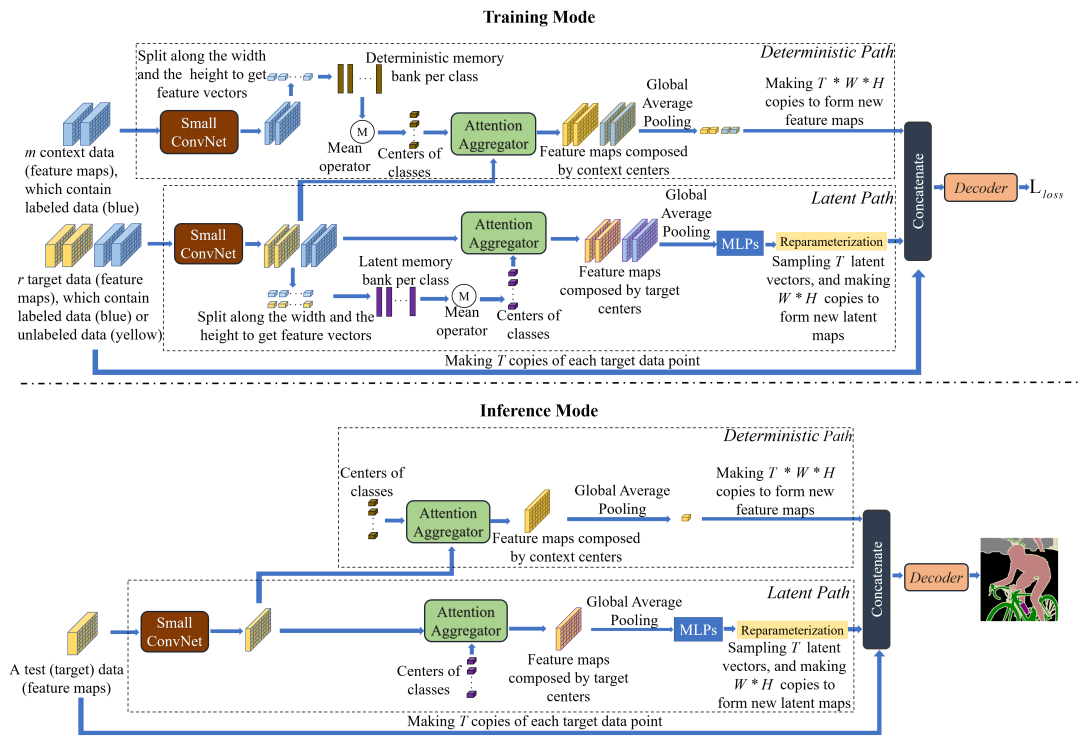

NP-SemiSeg 概述。小型 ConvNet 和注意力聚合器均由确定性路径和潜在路径共享。T、W 和 H 分别表示采样的潜在向量数量以及输入特征图的宽度和高度。

NP-SemiSeg 概述。小型 ConvNet 和注意力聚合器均由确定性路径和潜在路径共享。T、W 和 H 分别表示采样的潜在向量数量以及输入特征图的宽度和高度。

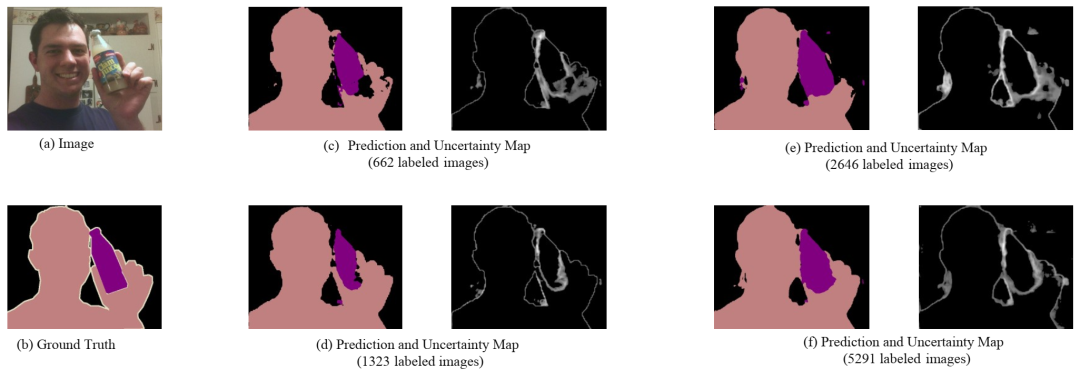

第二组可视化结果在 PASCAL VOC 2012(blender)上根据不同的训练协议得出。图中显示了预测结果及其对应的不确定性图。

第二组可视化结果在 PASCAL VOC 2012(blender)上根据不同的训练协议得出。图中显示了预测结果及其对应的不确定性图。

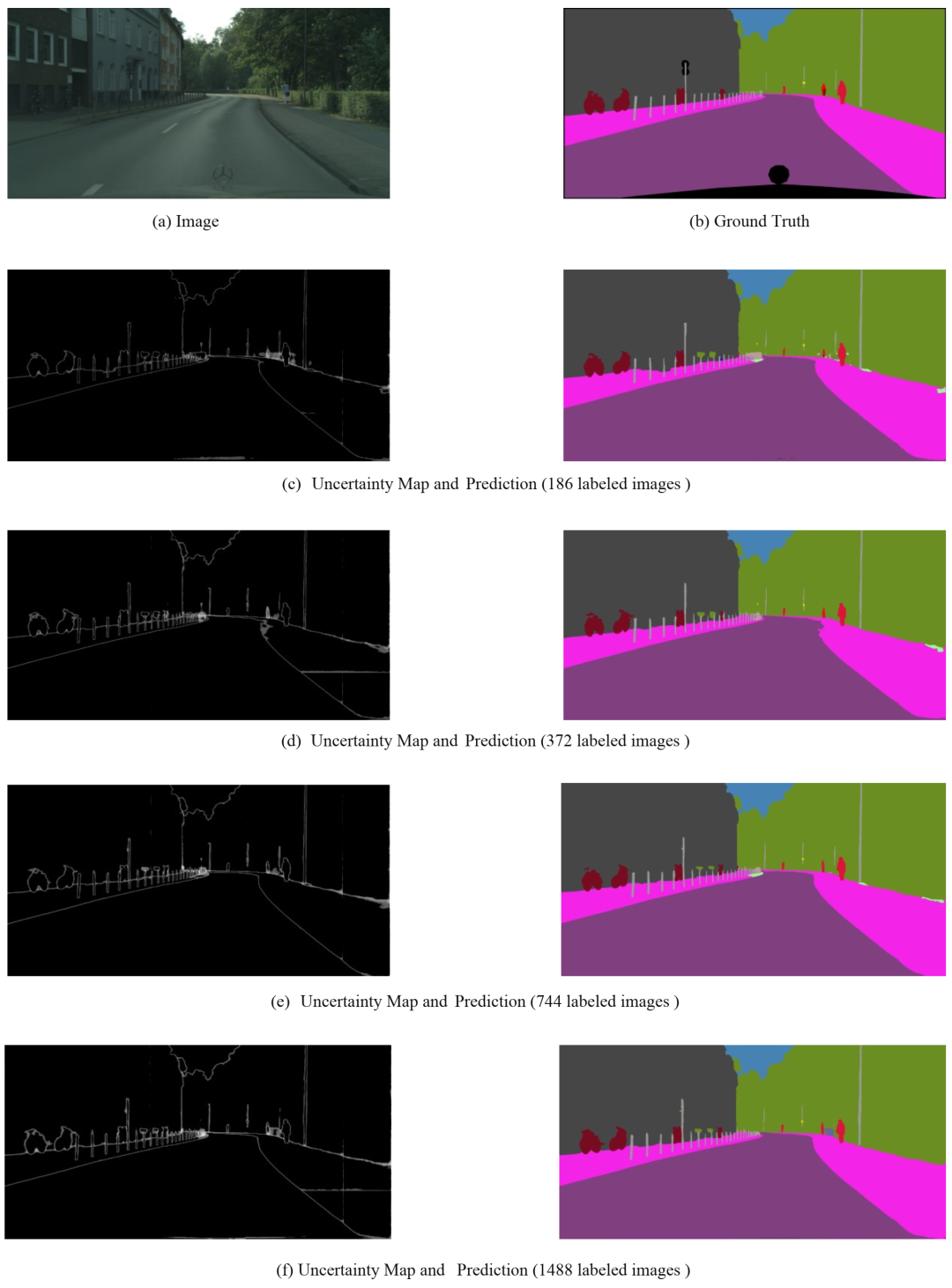

第三组在不同训练协议下对 Cityscapes 的可视化结果。图中显示了预测及其对应的不确定性图。

第三组在不同训练协议下对 Cityscapes 的可视化结果。图中显示了预测及其对应的不确定性图。

微信群 公众号

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢