新智元报道

新智元报道

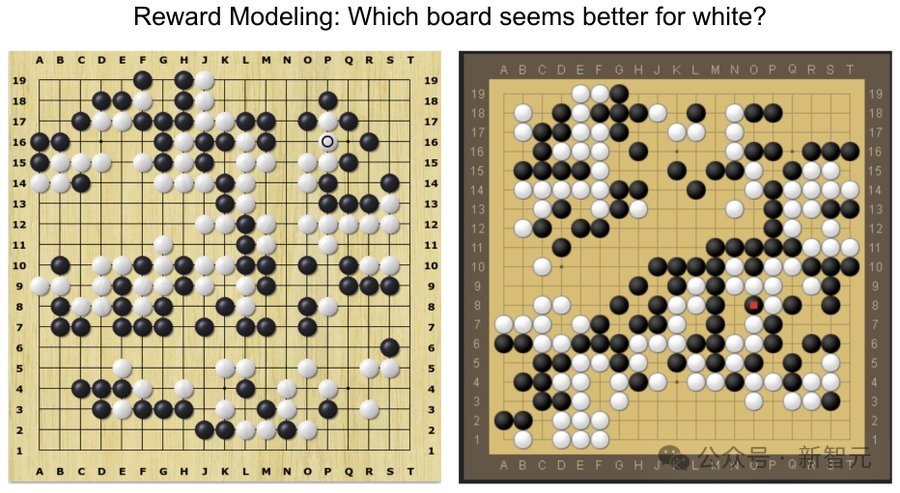

【新智元导读】RLHF到底是不是强化学习?最近,AI大佬圈因为这个讨论炸锅了。和LeCun同为质疑派的Karpathy表示:比起那种让AlphaGo在围棋中击败人类的强化学习,RLHF还差得远呢。

昨天,Andrej Karpathy又发了长推,不过用了一句很有争议的话开头——「RLHF只是勉强的RL」。

这条推特可谓「一石激起千层浪」,瞬间点燃了LLM社区的讨论热情。

毕竟RLHF作为刚提出没几年的方法,又新颖又有争议。一边遭受质疑,一边又在工业界和学界迅速流行。

5G冲浪的LeCun也赶来声援Karpathy,但他的话很短,只有一句——「RLHF不是真正的RL」。

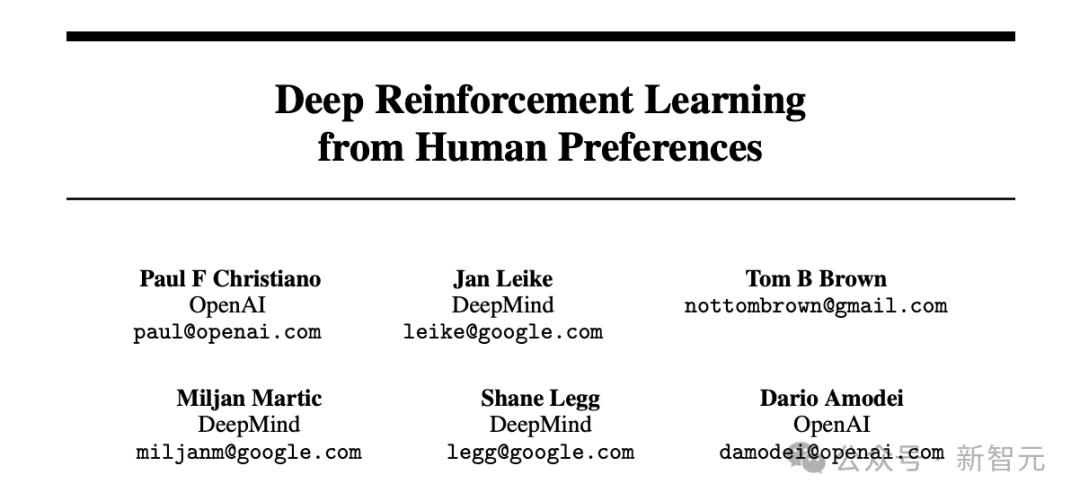

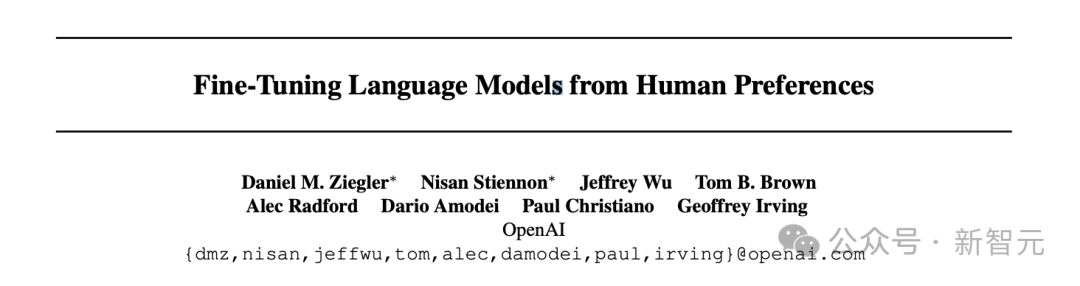

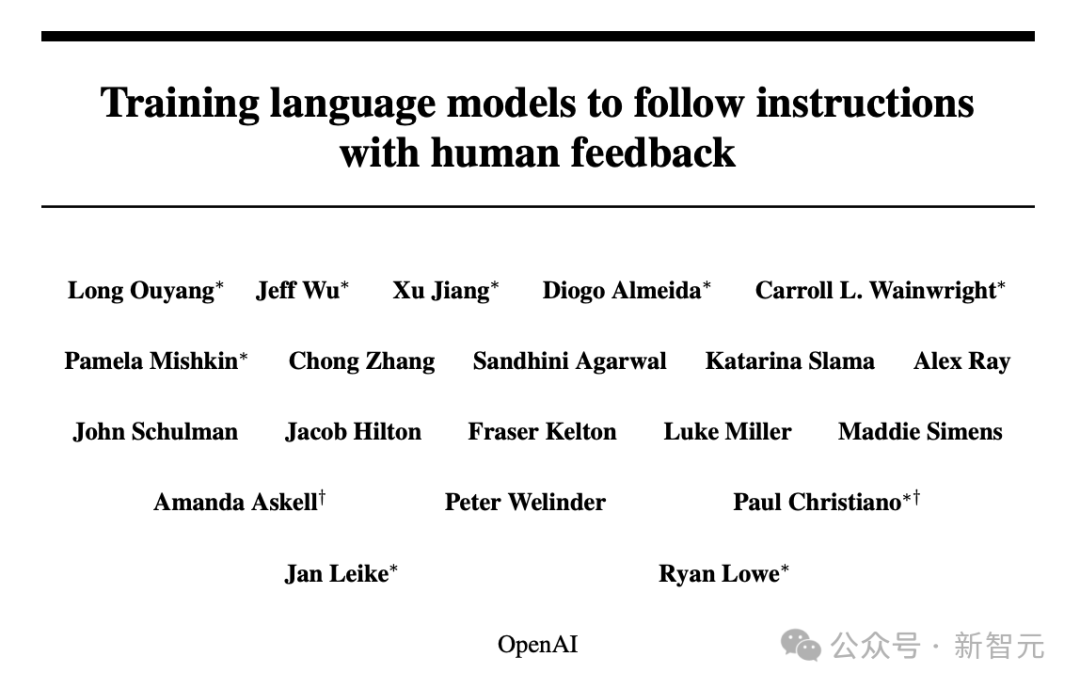

RLHF最早可以追溯到OpenAI安全团队2017年发表的论文:

论文地址:https://arxiv.org/abs/1706.03741

当时,Jan Leike还在DeepMind、Dario Amodei还没创办Anthropic,而OpenAI还没all in语言模型,仍是一家研究范围更广泛的AI公司。

他们提出,通过人类反馈,让AI模型更好地学习「如何翻出一个漂亮的后空翻」。

强化学习到底是什么

如果RLHF「不是RL」,那真正的RL是什么? Karpathy的描述比较简洁而直观——就是AlphaGo用的那种。 幸好,「强化学习」是一个人为提出的概念,更容易厘清;而且「强化学习之父」Richard Sutton专门写过一本书来解释这个领域的基本问题。

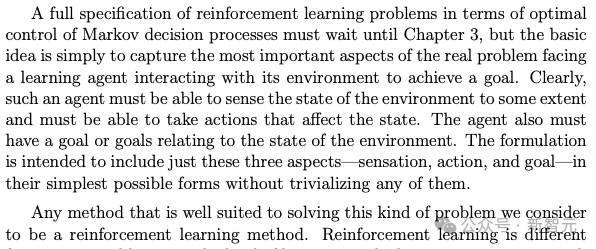

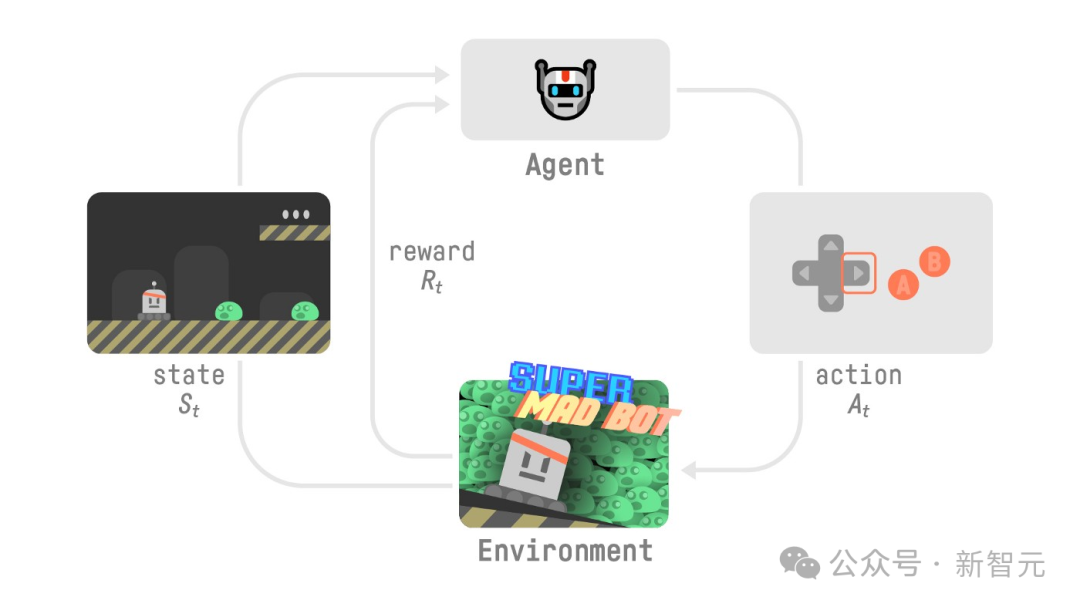

基本思想是,一个正在学习的agent与环境交互,如何捕捉到它面临的最重要的实际问题。 显然,这样的agent必须能够在某种程度上感知环境状态,且必须能够采取某种行动以影响状态。agent也必须有关于环境状态的目标。这一表述旨在包含三个方面:感知、行动和目标,以可行的最简洁的形式,而不会让任何一个方面只有平凡解。 任何适于解决这类问题的方法,我们都认为是强化学习方法。

策略(policy),定义正在学习的agent在指定时间的行为 奖励信号(reward signal),定义强化学习问题的目标,是对agent行为的即时反馈 值函数(value function),定义长期的优化目标 环境模型(model of the enviroment),模拟环境行为

谁赞同,谁反对?

非常明显的是,Karpathy的观点吸引了许多LLM领域的学者和研究员的关注。 谷歌大脑、DeepMind研究科学家Kevein Murphy:

完全同意。我认为RLHF更像是行为(action)值是字符串的上下文多臂赌博机,其中提示词作为上下文,而不是完整的强化学习。但为日常任务制定明确的奖励机制是困难的部分。(我想这被称为「模型对齐」?)

Allen AI机器学习研究员Nathan Lambert回复:

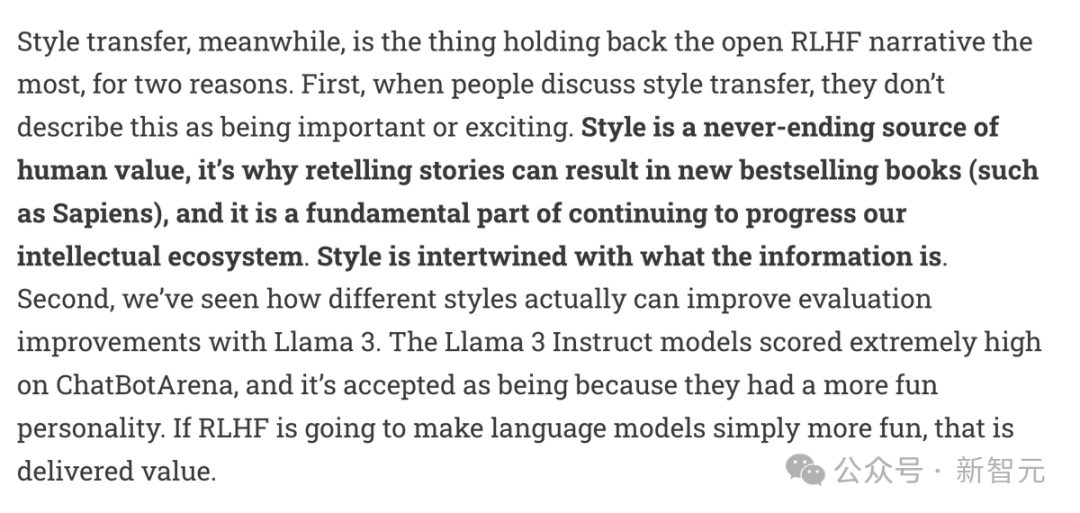

同意,很棒的总结。就其提供的价值而言,下面是我最喜欢的引用,说明了RLHF的「风格」部分为何有用。 但这与为LLM解锁完整版本的RL相比,仍然微不足道。

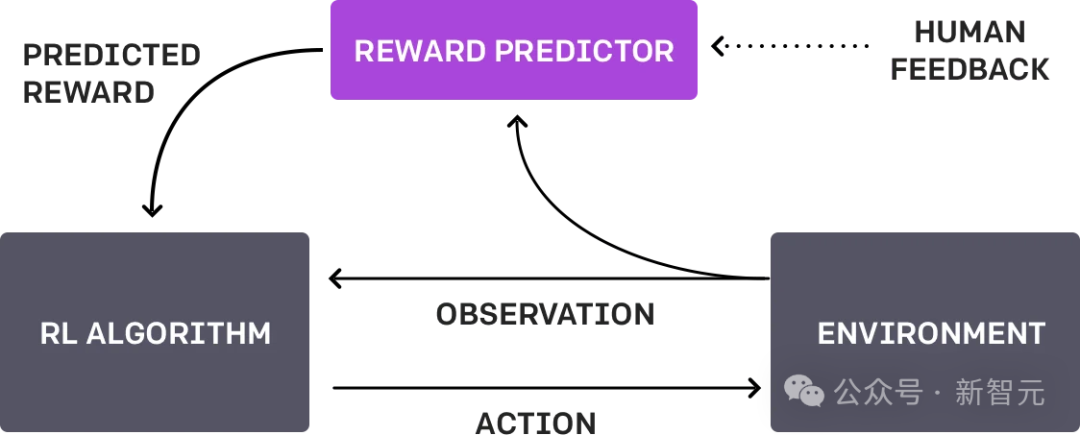

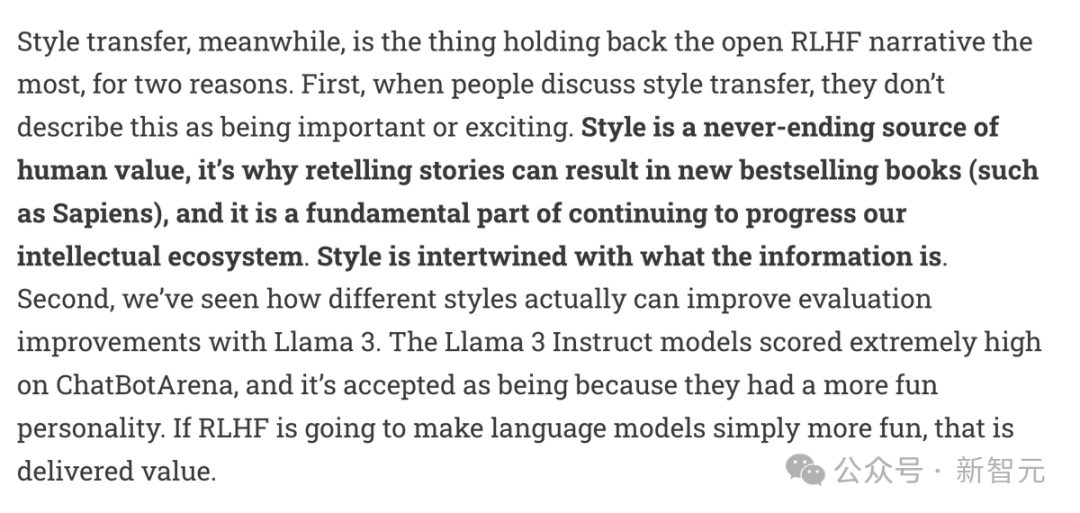

这张图出自Lambert自己撰写的博客:

之后,他又专门发推进一步解释:

RLHF勉强算是 RL,但 - 它仍然使RL比以往任何时候都更重要,并且 - RLHF可能比至今为止其他的RL更有影响力

很罕见的是,以上是为数不多力挺Karpathy的观点。多数人还是站在了Karpathy的对立面反驳他。 评论区有网友直接回怼:「你就是看奖励函数不顺眼」。

Karpathy只能继续解释: 我的主要动机是想说,LLM远未达到原则上所能达到的高度,它们还没有像其他最近/流行的ASI演示那样有相同的训练方式。我想要直观地指出这种差距的根源。

马里兰大学副教授Furong Huang的观点更强调RLHF对LLM的价值。

当模型已经非常优秀时,RLHF是有帮助的,你只需通过收集用户反馈来「修补问题」。 RL对于推理和规划等更复杂的任务确实很重要,把LLM放到RL循环中有助于泛化和「热启动」RL。

Mila在读博士、Meta研究员Pierluca D'Oro自己就在为agent开发奖励模型,他同意Karpathy「RLHF不是真正的RL」的说法,但并不认为Karpathy预期的那种奖励模型能够实现。

我是一名科学家,致力于为智能体创建更好的奖励模型,我不同意这篇推文的主要观点。使用你无法完全信任的奖励进行的RL也是RL,而且我认为这正是我们应该研究的RL。 是的,毫无疑问,当奖励明确定义时,RL能够最大程度地发挥作用。比如围棋中的获胜条件,就是明确的!我们不在乎智能体如何获胜,只要它符合游戏规则即可。这些规则非常简单,可以由人类直接编码到智能体的设计中,或者智能体通过计算推断出来。 但是如果对于一个复杂任务,不仅仅是「做什么」重要,而是「怎么做」也很重要呢?「怎么做」往往不像在围棋中要求智能体下有效棋步那样容易实现。对于人类来说,这通常来自于人类的常识、期望或荣誉。LLM的对齐正是通过RLHF来提取这种「怎么做」。 这也可以延伸到那些看似容易定义明确目标的(智能体)任务。想要一个好的电子游戏中的NPC?可以试试正式定义一个你可以100%信任的「乐趣」的概念,祝你好运。想要一个好的网络智能体?试试正式定义一个你可以100%信任的「预期行为」的概念,祝你好运。想要一个好的分子?定义一个你可以100%信任的「毒性」的概念,祝你好运。 AI智能体旨在做对人类有益的事情。人类不仅有内部多样性,而且极其复杂,显然超出了我们能够完全理解的范围。我可以编写一个我认为是「在NetHack游戏中实现这个目标」的代码,然后发现我对「实现」的理解比智能体的定义更为细致,就像我们最近在Motif上的工作中所做的那样。 我认为追求「完美奖励」的雄心是无望的,我不认为大多数我们希望智能体表现出的行为存在这样的概念。然而,我认为有一些方法有望在奖励不完美的情况下实际提高RL的性能: - 尽可能活跃的反馈循环,以优化智能体的奖励函数 - 对错误奖励更稳健的RL机制 - 减少人类与AI合作的摩擦 不过,我同意推文标题所说的,RLHF在用于微调LLM时几乎不能算是RL。但对我来说,这主要是因为它的半离线性质,以及智能体缺乏主动收集自身数据的机会。这些可能是RL在处理模糊、复杂,以及潜在可被利用的奖励函数时奏效的关键因素。

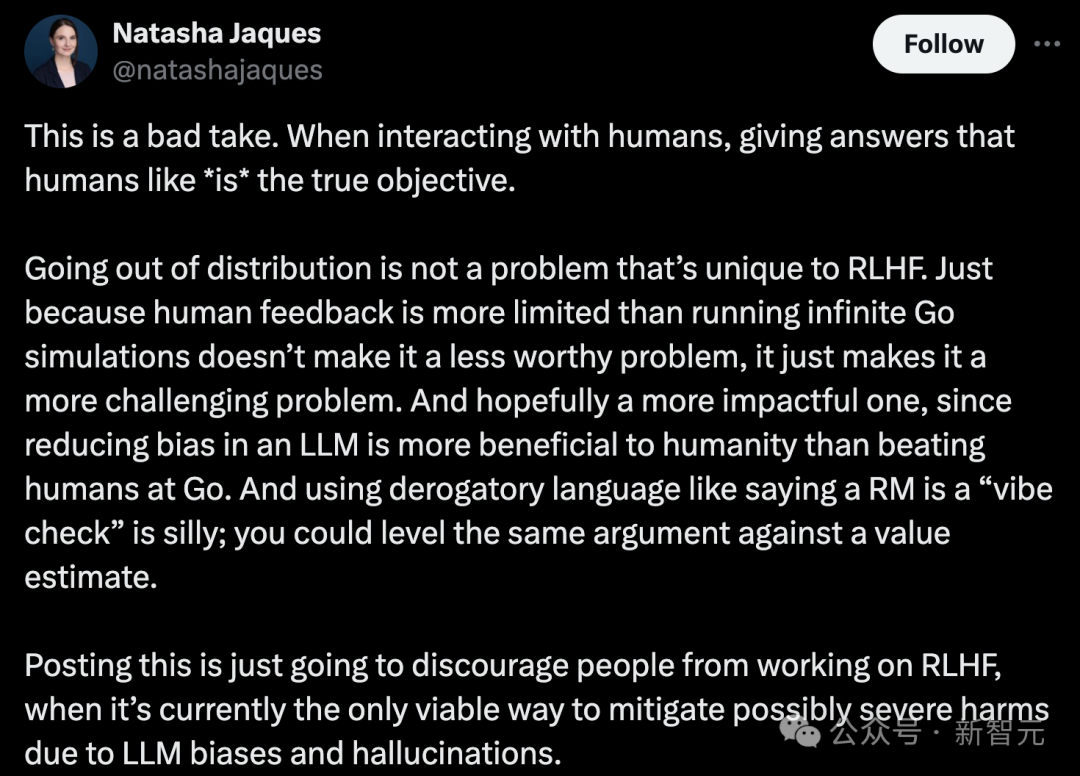

华盛顿大学助理教授、谷歌AI高级研究科学家Natasha Jaques的反对态度更鲜明,力挺RLHF方法:

这是一个不好的看法。在与人类互动时,给出人类喜欢的答案就是真正的目标。

超出分布不是RLHF独有的问题。数据集中的人类反馈比运行无限的围棋模拟更有限,但这并不意味着是不值得研究的方法,它只是一个更具挑战性的问题,并且我们希望它是一个更有影响力的问题,因为减少LLM的偏见对人类的益处显然多过比在围棋上击败人类。使用贬义语言称RM为「直觉判断」是愚蠢的;你可以对价值估计提出同样的论点。

发布这样的内容只会阻碍人们研究RLHF,而目前这是唯一可行的方法来缓解LLM偏见和幻觉可能造成的严重危害。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢