导语

内容简介

内容简介

关键词

关键词

分享大纲

分享大纲

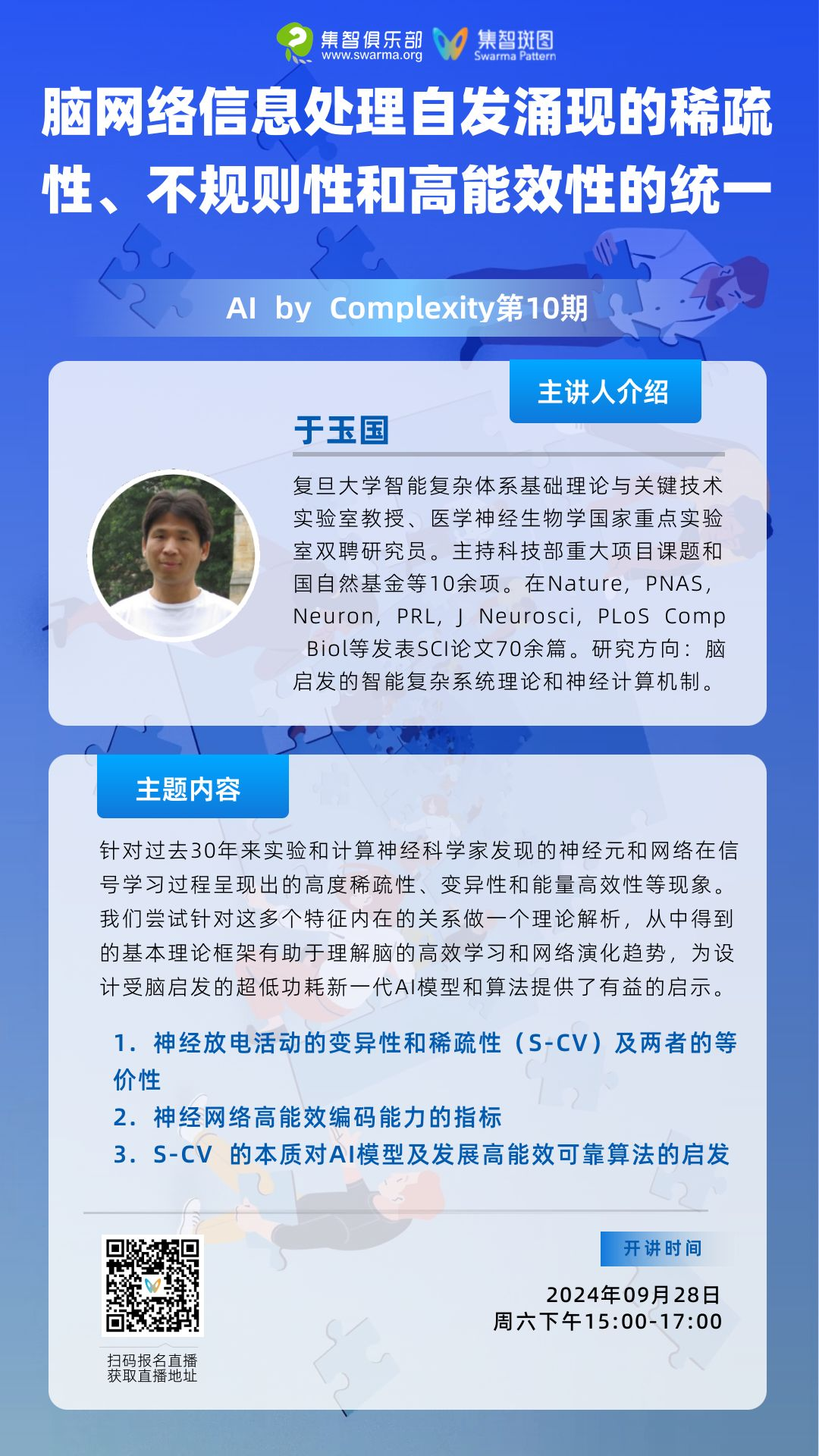

1. 研究的科学背景

2. 神经脉冲放电活动的变异性和稀疏性(S-CV)及两者等价性

3. 神经网络高能效编码能力的指标:放电不规则性和稀疏性

参考文献

参考文献

Huang, M., Lin, W., Roe, A., & Yu, Y. (2024) A Unified Theory of Response Sparsity and Variability for Energy-Efficient Neural Coding. Preprint on BIORXIV/2024/614987. Rolls, E. T., & Tovee, M. J. (1995). Sparseness of the neuronal representation of stimuli in the primate temporal visual cortex. Journal of Neurophysiology, 73, 713-726. Treves, A., & Rolls, E. (2009). What determines the capacity of autoassociative memories in the brain? Network Computation in Neural Systems, 2, 371-397. Haider, B., Krause, M. R., Duque, A., et al. (2010). Synaptic and network mechanisms of sparse and reliable visual cortical activity during nonclassical receptive field stimulation. Neuron, 65, 107-121. Olshausen, B. A., & Field, D. J. (2004). Sparse coding of sensory inputs. Current Opinion in Neurobiology, 14, 481-487. Softky, W. R., & Koch, C. (1993). The highly irregular firing of cortical cells is inconsistent with temporal integration of random EPSPs. Journal of Neuroscience, 13, 334-350. Lengler, J., & Steger, A. (2017). Note on the coefficient of variations of neuronal spike trains. Biological Cybernetics, 111, 229-235. Yu, Y., Migliore, M., Hines, M. L., & Shepherd, G. M. (2014). Sparse coding and lateral inhibition arising from balanced and unbalanced dendrodendritic excitation and inhibition. Journal of Neuroscience, 34, 13701–13713. Yu, Y., McTavish, T. S., Hines, M. L., Shepherd, G. M., Valenti, C., & Migliore, M. (2013). Sparse distributed representation of odors in a large-scale olfactory bulb circuit. PLoS Computational Biology, 9, e1003014. Marder, E. (2011). Variability, compensation, and modulation in neurons and circuits. Proceedings of the National Academy of Sciences, 108, 15542-15548. Faisal, A. A., Selen, L. P., & Wolpert, D. M. (2008). Noise in the nervous system. Nature Reviews Neuroscience, 9, 292-303.

主讲人

主讲人

直播信息

直播信息

直播时间:9月28日(周六)15:00-17:00

AI By Complexity读书会招募中

大模型、多模态、多智能体层出不穷,各种各样的神经网络变体在AI大舞台各显身手。复杂系统领域对于涌现、层级、鲁棒性、非线性、演化等问题的探索也在持续推进。而优秀的AI系统、创新性的神经网络,往往在一定程度上具备优秀复杂系统的特征。因此,发展中的复杂系统理论方法如何指导未来AI的设计,正在成为备受关注的问题。

集智俱乐部联合加利福尼亚大学圣迭戈分校助理教授尤亦庄、北京师范大学副教授刘宇、北京师范大学系统科学学院在读博士张章、牟牧云和在读硕士杨明哲、清华大学在读博士田洋共同发起「AI By Complexity」读书会,探究如何度量复杂系统的“好坏”?如何理解复杂系统的机制?这些理解是否可以启发我们设计更好的AI模型?在本质上帮助我们设计更好的AI系统。读书会于6月10日开始,每周一晚上20:00-22:00举办。欢迎从事相关领域研究、对AI+Complexity感兴趣的朋友们报名读书会交流!

往期分享:

第一期 张章 于玉国 田洋 牟牧云 刘宇 杨明哲:复杂性怎样量化和驱动下一代AI系统 第二期 徐奕舟 翁康宇:统计物理与信息论视角下,结构化噪声与神经网络初始化研究 第三期 刘宇:“压缩即智能”与算法信息论 第四期 程奥华 熊巍:从高阶相互作用到神经算子模型:启发更好的AI 第五期 蒋春恒:网络属性决定神经网络模型性能 第六期 杨明哲:因果涌现启发AI的“思考” 第七期 朱群喜:从复杂系统到生成式人工智能

点击“阅读原文”,报名读书会

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢