点击蓝字

关注我们

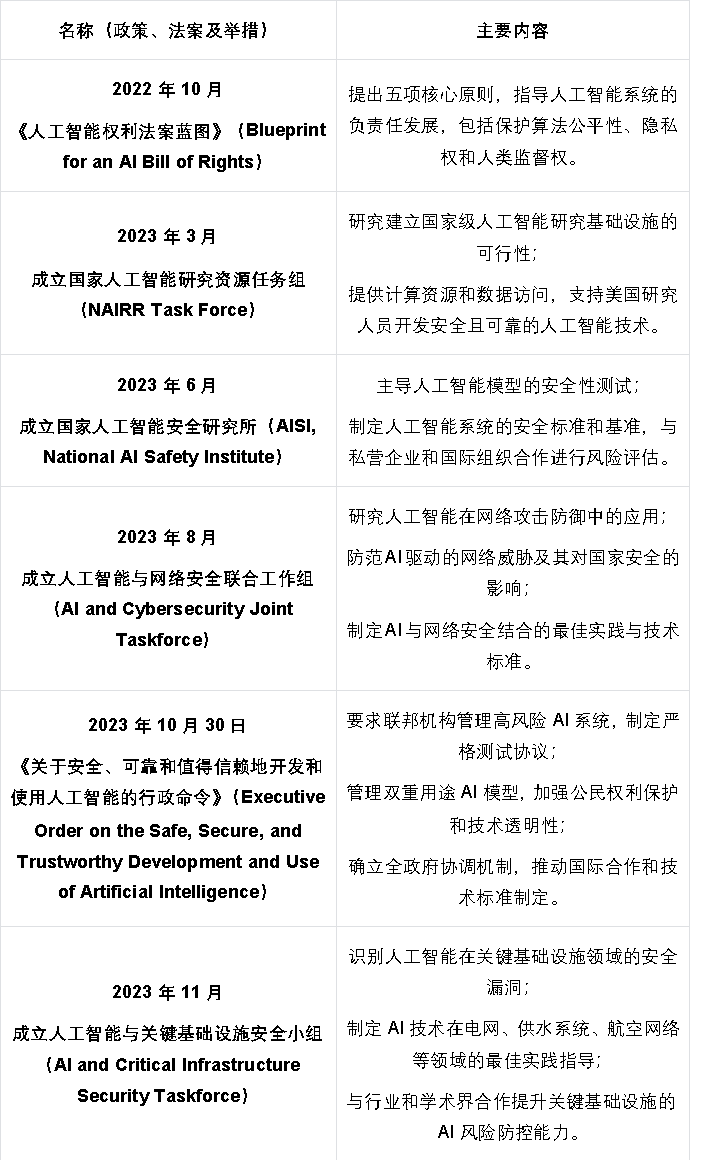

随着全球技术竞争加剧和安全形势日益复杂,人工智能(AI)已逐渐成为美国国家安全的核心技术领域。近期,美国政府及相关机构相继推出一系列政策与战略,包括美中经济与安全审查委员会(USCC)建议启动“曼哈顿计划”式的通用人工智能(AGI)研发项目,以及美国国际安全顾问委员会(ISAB)发布数份与技术发展相关的研究报告。

同时,美国人工智能安全研究所(AISI)宣布成立“国家安全人工智能测试风险”(TRAINS)工作组,美国土安全部发布《关键基础设施中人工智能的角色与职责框架》,明确AI在关键领域的安全风险并提出应对方针。通过这些政策和战略行动,美国正进一步将人工智能深度嵌入国家安全框架。人工智能将在维护国家安全、巩固经济主导地位和推动战略创新中发挥关键作用,也将直接影响美国应对新兴威胁、巩固全球领导力和保持安全优势的能力。

Part1

1.美国土安全部发布《关键基础设施中人工智能的角色与职责框架》

Part2

“火力全开”:人工智能正在重塑美国国家安全?

2.“将人工智能纳入国家安全委员会”:人工智能重塑美国国家安全

1

美国土安全部发布

《关键基础设施中人工智能的角色与职责框架》

2024年11月14日,美国国土安全部(DHS)发布了《关键基础设施中人工智能的角色与职责框架》(以下简称“框架”),旨在指导人工智能(AI)在电网、供水系统、航空网络等关键基础设施中的负责任应用。该框架发布于人工智能技术在关键基础设施领域广泛应用的背景下,旨在应对日益严峻的安全与伦理挑战。

2015 年 2 月 25 日,华盛顿新闻发布会上出现了美国国土安全部的标志。来源:美联社照片/Pablo Martinez Monsivais

关键基础设施(Critical Infrastructure,CI)是国家运行的核心支柱,包括能源、通信、交通和金融等领域。尽管AI技术的快速应用显著提高了这些领域的效率和可靠性,但也暴露出一系列安全隐患,如AI系统遭受攻击、数据隐私泄露、算法偏见及关键功能失效等问题。这些风险的广泛性与复杂性引发了高度关注,促使美国政府采取行动,确保AI技术在关键基础设施中的安全性与可控性。

国土安全部部长亚历杭德罗·马约卡斯(Alejandro Mayorkas)在框架发布时表示,“这一框架将是一份动态文件,能够随着行业的发展不断演进”,强调了框架的灵活性和适应性。通过这一框架,美国试图在推动AI技术发展的同时,优先解决其潜在的安全威胁,保障国家关键基础设施的稳健运行。

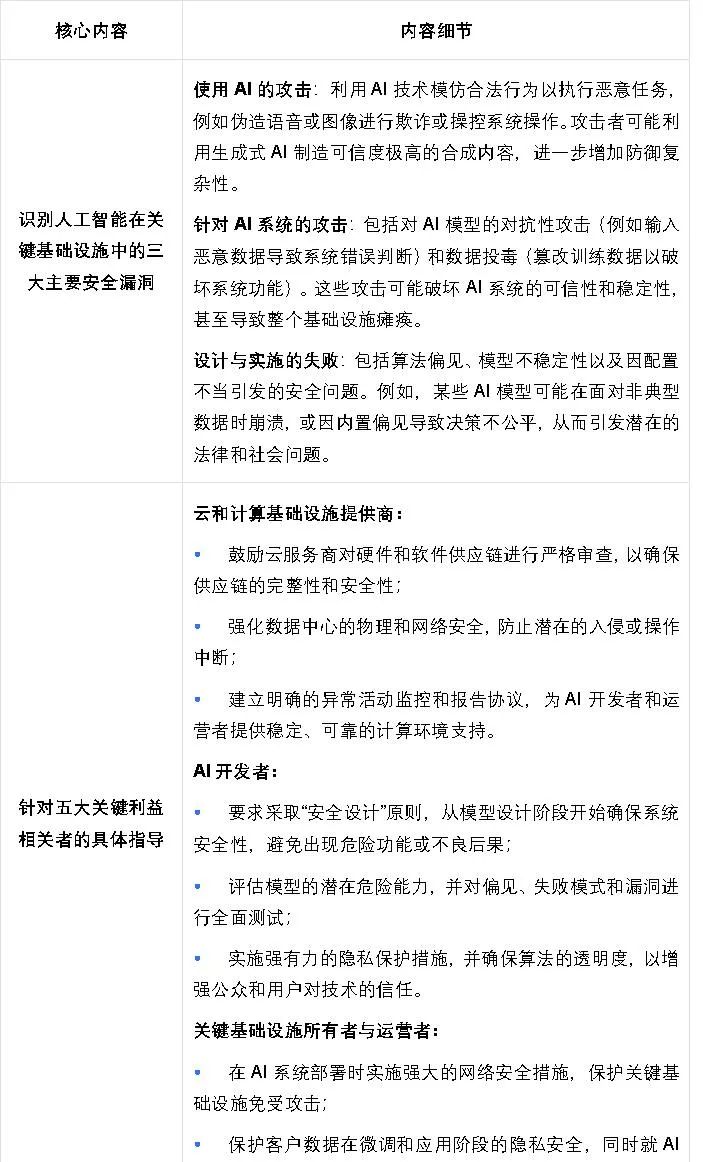

框架由人工智能安全与保障委员会(AISI)协商制定,覆盖从AI开发到部署的全周期安全指导。其核心内容包括以下几个方面:

框架为应对人工智能在关键基础设施中的潜在威胁提供了一套系统性的安全指导。电网、供水系统和航空网络等关键基础设施在广泛应用AI技术的同时,也面临着安全漏洞、隐私泄露和系统失效等问题。框架提出建立AI风险评估机制和加强数据隐私保护,旨在防止因AI系统漏洞或滥用而引发的大规模安全事故。通过要求云服务商对硬件和软件供应链进行严格审查,框架为数据中心等敏感设施的安全运行提供了具体指导。这种系统化的管理措施,不仅提高了关键基础设施的安全性,也为其他国家的类似项目提供了借鉴。

框架明确要求AI开发者和运营者在技术设计阶段就将安全性和隐私保护纳入核心考量,强调对算法偏见和伦理问题的深入评估。这种“安全设计”理念对AI行业的发展具有重要的规范意义。随着AI技术在商业、社会和军事领域的广泛应用,算法失控或滥用的风险逐渐增加。框架要求开发者采用严格的评估标准,以提高AI系统的公信力,为行业设立责任化发展的基准。这种以责任为导向的监管模式,不仅可以增强公众对AI技术的信任,也为国际社会提供了一种平衡技术创新与安全管理的可行路径。

框架通过集成国内外专家意见,试图打造成为全球AI安全治理的标杆。随着AI技术在国际合作中的角色日益重要,美国希望通过制定关键基础设施中的AI应用规则,确立其在国际治理中的主导地位。这种标准化和规则化的努力将为全球关键基础设施的AI应用提供模板,同时推动国际社会在技术治理上的一致性。框架鼓励云计算企业、开发者和关键基础设施运营者共同制定风险评估和透明度标准,以提升全球AI治理的协调性和规范性。

框架强调了安全与信任之间的正反馈关系。通过倡导透明度和责任制,框架致力于提升社会对AI技术的接受度,从而推动更广泛的技术应用。具体来说,通过要求关键基础设施的运营商在使用AI时向公众提供清晰透明的信息,框架希望在技术和公众之间建立起信任桥梁。这种信任建设不仅有助于AI技术的普及,也为技术创新创造了更大的空间,形成“安全促进信任,信任加速采用,采用推动创新”的良性循环。

在中美技术竞争日益激烈的背景下,中国在AI技术研发及其在基础设施中的应用领域取得了显著进展,这引发了美国对国家安全的担忧。通过制定精细的指导方针,美国试图在AI领域保持领先地位,同时限制中国在关键技术上的追赶步伐。框架不仅规范了AI技术在关键基础设施中的应用,还通过加强风险测试和评估,提高美国在AI技术治理领域的标准化水平。这种标准化努力也为美国在国际社会争取更多技术和治理话语权提供了有力支持。

白宫人工智能行政令一周年:

人工智能如何影响美国的国家安全?

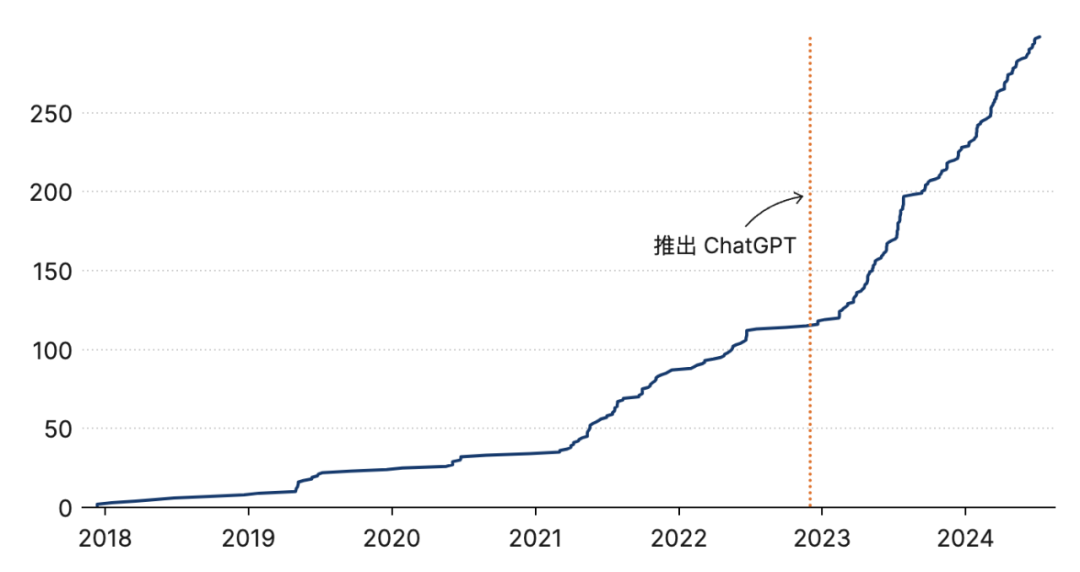

ChatGPT 推出后,美国众议院和参议院针对人工智能治理和使用的法案数量呈指数级增长,来源:布鲁金斯学会

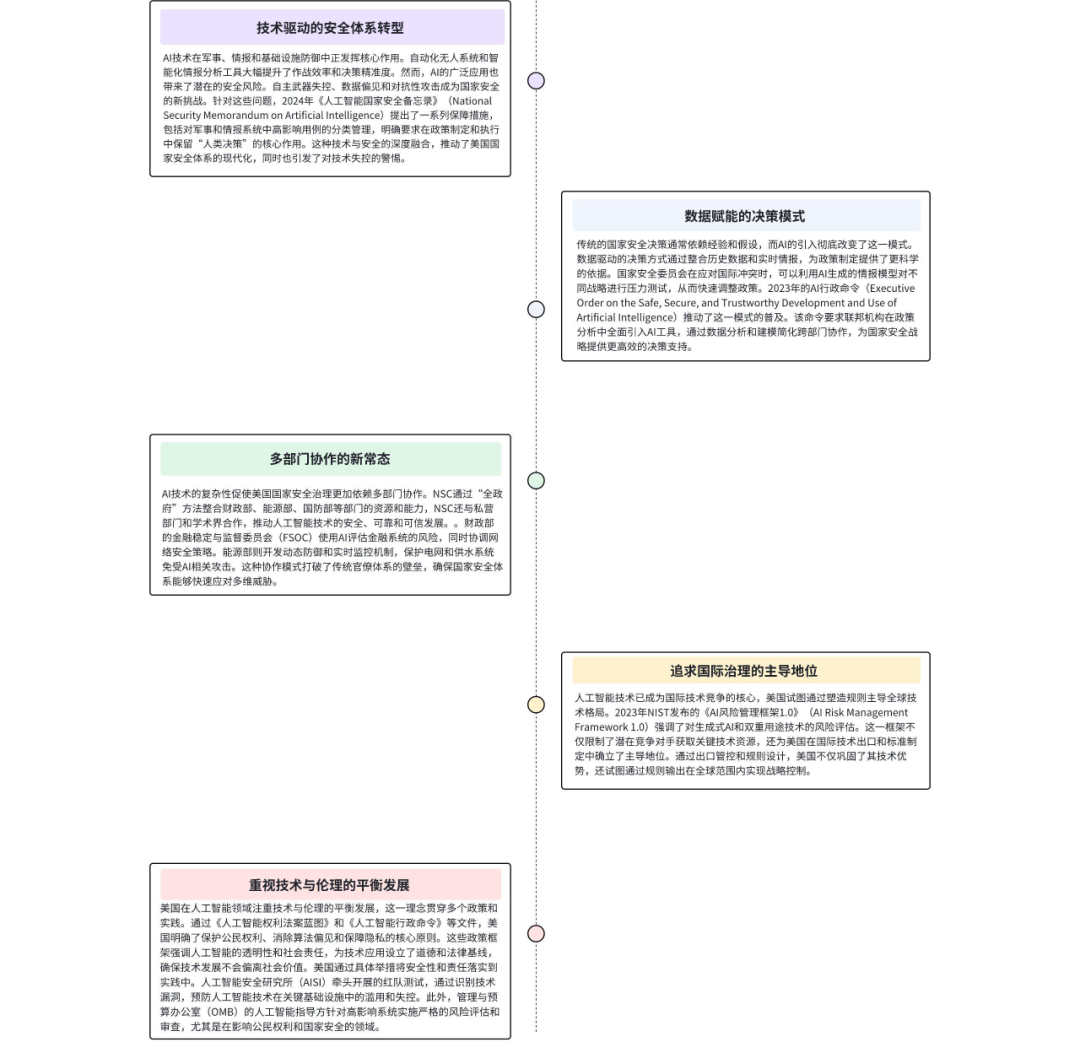

人工智能的军事化应用是美国国家安全战略的重要支柱之一。AI驱动的自动化情报分析、无人系统和作战支持工具,显著提升了美国在情报收集和军事决策中的效率与精确性。《人工智能国家安全备忘录》明确将高风险AI模型纳入安全评估范围,强调自动化军事决策系统需要通过严格的测试和验证,以防止潜在失控和误判。此外,美国国防部依托《国防生产法》(DPA),进一步强化了私营部门在军用AI开发中的角色,通过强制要求关键技术安全测试数据提交,确保军事AI系统的可靠性与可控性。这种政府与产业协作模式既推动了技术创新,也防范了可能危害国家安全的技术漏洞。

美国关键基础设施(Critical Infrastructure, CI)的运行日益依赖人工智能,但也因此暴露在更复杂的安全风险中。《AI国家安全备忘录》及相关文件明确要求,通过动态防御和实时监控技术,保护电网、供水系统和航空网络等基础设施免受AI驱动的攻击。美国人工智能安全研究所(AISI)与私营企业合作,利用红队测试等方式,对用于关键基础设施的AI模型进行全面评估和优化。这不仅减少了AI系统被滥用或攻击的风险,还树立了AI安全管理的行业标杆。通过强调基础设施领域的AI安全,美国构建了从政策制定到实践应用的闭环保障体系,确保AI在增强运营效率的同时不削弱基础设施的安全性。

人工智能技术的跨领域特性促使美国通过调整政府结构来适应其发展需求。美国成立了多个专门机构和工作组,例如人工智能安全与保障委员会(AI Safety and Assurance Board)和国家人工智能安全研究所(AISI)等,这些机构负责跨部门协作,聚焦于AI系统的测试、风险评估和应用规范,为国家安全提供系统化支持。同时,美国通过一系列法律和政策文件明确了AI技术在国家安全中的应用框架。管理与预算办公室(OMB)发布的指导文件将AI应用分为“权利影响”和“安全影响”类别,提供了精细化的风险管理路径。特别是对涉及个人权利和关键安全领域的高影响AI用例,设立了严格的评估和监管机制。这种以分类为基础的管理方式,既保证了技术应用的安全性,也为其他国家提供了参考标准。

“将人工智能纳入国家安全委员会”:

人工智能重塑美国国家安全

人工智能(AI)正以前所未有的速度塑造美国国家安全的新格局。作为国家安全政策的顶层设计者,国家安全委员会(NSC)在协调、分析和决策过程中,正逐步将人工智能纳入战略体系。这一转型不仅体现在技术工具的应用,更深刻地反映了人工智能对美国国家安全理念和治理模式的重塑。

(本文编辑:朱政宇)

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

来源 | 本文转载自“刘典 ”,点击“阅读原文”获取更多内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢