点击蓝字

关注我们

2024 年 12 月 2 日,由清华大学、新加坡国立大学、香港科技大学联合主办的 2024 人工智能合作与治理国际论坛,在新加坡国立大学耶鲁-新加坡国立大学学院礼堂(Yale-NUS College Hall)开幕。本次论坛以“人工智能治理国际合作”为主题,汇聚来自全球人工智能领域的顶级专家学者、政府代表、国际组织和企业人士,旨在共同探讨如何利用国际合作平台, 支持发展中国家提升自身的人工智能技术研发能力和治理水平,缩小智能鸿沟,确保所有国家都能从人工智能的快速发展中受益,并期望推动建立一个开放包容、互利共赢的人工智能国际治理体系,共同迎接未来发展的机遇与挑战。

论坛开幕式环节的致辞嘉宾包括新加坡国立大学副教务长陈西文(Simon CHESTERMAN),清华大学副校长杨斌,香港科技大学首席副校长郭毅可,新加坡资讯通信媒体发展局局长柳俊泓( LEW Chuen Hong ), 联合国大学校长兼联合国副秘书长奇利齐· 马瓦拉

(Tshilidzi MARWALA)。

陈西文(Simon CHESTERMAN)主持了开幕式环节。他表示,当前世界各地正在积极探索如何平衡人工智能带来的收益与风险。此次会议汇聚了来自全球的科研人员、行业领袖与监管机构,共同探讨人工智能国际合作的路径,重点解决人工智能治理面临的两大核心挑战:其一,治理框架往往过于局限,仅关注美国、欧洲等少数国家的视角;其二,治理讨论常流于表面,仅停留在抽象原则层面,而缺乏具体细节的深入探讨。他最后表示,非常荣幸新加坡国立大学能够主办此次会议,并向清华大学、香港科技大学等合作伙伴,以及所有为会议成功举办而付出努力的工作人员表达衷心感谢。

陈西文(Simon CHESTERMAN)致辞

杨斌对参会者表示了欢迎,并对此次论坛的所有参与机构和工作人员表示感谢。杨斌指出, 人工智能能力和自主性的大幅提高进一步放大了其技术外部性,在创造巨大机遇的同时,也带来了各种风险和复杂挑战,这已成为各国需要共同面对的重要问题。中国为此贡献了重要的研究成果、治理理念和实践经验。人工智能全球治理要坚持联合国在国际发展合作中的统筹协调作用,坚持真正多边主义,基于主权平等、发展导向、以人为本、普惠包容、协同合作原则,通过南北合作、南南合作和三方合作等形式,切实落实联合国《未来契约》《全球数字契约》,特别是联大关于加强人工智能能力建设国际合作相关决议。最后,杨斌提到, 清华大学希望通过包容性的国际论坛来更好地凝聚国内外政产学研各界专家学者的智慧,以此实现以下目标:一是通过进一步包容性和开放的人工智能科学研究,在国际科学界共同解决当前人工智能发展的技术局限;二是通过跨国界的跨学科、跨领域交流合作,以技术机理阐释和研判预测风险,为实现人工智能“善治”与“善用”提供科学可靠的智力支撑,为推动人工智能治理国际合作与交流做出更大贡献。

郭毅可在致辞中分享了他在AI 领域的研究和实践经历,强调了 AI 治理与伦理对齐的重要性,并计划将更多的精力投入到价值对齐以及安全和伦理治理问题的研究中。他提到,当前最大的研究挑战就是找到对齐点,这涉及到治理问题和不同生态系统的对接。不同生态系统和治理模式间存在差异,技术、伦理和治理之间存在复杂关系,使得价值对齐成为一项挑战。具体而言,涉及到如何调整机器的价值体系,以及这些价值如何随着社会需求演变等。因而,需要综合技术与政策的力量解决。他期待未来五年在人工智能治理研究中能够取得进展,并强调了领导力在其中的作用。最后,他对全球学术界和实践者的参与表示欢迎,并强调这一领域的研究需要整个国际社会的共同努力。

论坛主旨演讲环节由中国新一代人工智能发展战略研究院执行院长、信创海河实验室主任、 清华大学人工智能国际治理研究院学术委员会委员龚克主持,图灵奖得主、美国斯坦福大学电气工程名誉教授马丁·赫尔曼(Martin HELLMAN),清华大学人工智能国际治理研究院院长薛澜,南安普顿大学计算机科学钦定讲座教授、美国计算机协会前主席温迪·霍尔(Wendy HALL),以及香港科技大学首席副校长郭毅可等分别进行了主旨演讲。

龚克表示,近两年来,我们见证了如 ChatGPT、Sora 等先进人工智能技术的快速发展,也见证着人工智能治理的快速跟进。他强调,人工智能发展需要同人类社会“对齐”, 既需要同人类的常识对齐,也需要与人类的可持续发展对齐。为此,我们需要更广泛的国际对话,进而推动安全、负责、可信赖的人工智能发展。随后,龚克主持了主旨演讲环节。

龚克主持主旨演讲

薛澜主旨演讲

温迪·霍尔(Wendy HALL)指出,从去年开始,世界各国以及国际社会对人工智能的关注重点正在逐渐发生改变。2017 年以来,英国政府投入大量资金发展人工智能技术和人才培养,致力于确保英国处于全球人工智能领域的领导地位,并从去年开始将人工智能监管上升 为国家战略。2023 年 3 月 29 日,英国发布相关政策文件,强调了 AI 监管方面的创新和迭代方法,投资 3100 万英镑用于由南安普顿大学领导的人工智能安全研究项目。这一转变的重要原因在于,以 ChatGPT 为代表的大语言模型快速发展引发全球对于深度仿造、内容版权等问题的担忧,特别是温迪·霍尔所担心的人工智能导致多样性缺失的问题。由此众多学者和企业家自发推动了一系列全球范围内的合作,以减少潜在的人工智能风险,并认为人类发明人工智能产品,就应该对其负责。之后各国政府和国际组织也加强了人工智能国际治理的参与,如召开了人工智能安全峰会、人工智能高级别咨询机构成立并发布报告等。最后, 温迪·霍尔展望未来并提到我们还需要继续加强相关合作和关注,通过深度国际合作进一步确保人工智能安全。

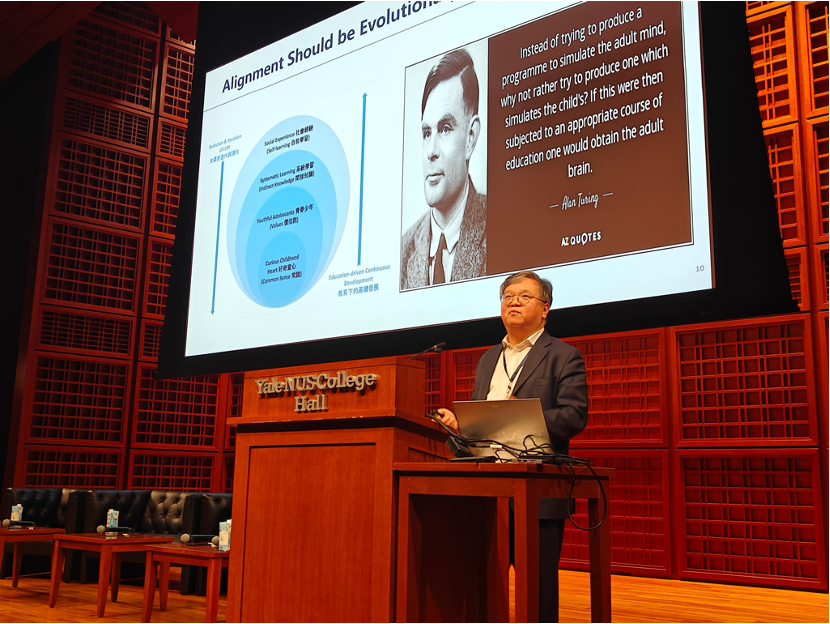

郭毅可作了题为《安全且可解释的大语言模型推理:工程视角》的主旨演讲,并围绕理性大 语言模型的 OpenAI o1 范式、基于价值的推理对齐、法律推理的大语言模型训练以及大语言模型在法律科技领域的典型示例 LexiHK 应用等方面内容展开了精彩发言。郭毅可指出,构建人工智能系统时需要超越个人或组织的利益,通过合法和合理的方式完成,并应考虑到多 样性和差异化的挑战。同时,大多数机器学习模型都表现为黑箱模型,但 OpenAI o1 模型的发布为可信赖的人工智能的“黑箱”问题提供了新的可解释性解决方案,并能够生成合理的推 理过程。自然语言中的推理在很大程度上是基于价值的,它成为后期训练对齐的一部分并从 人类和经验中学习。郭毅可还表示,对齐应当是循序渐进的,并且要构建与人类意图和价值观对齐的人工智能系统,需遵循但又不应局限于 3H 标准,即有帮助的(Helpful)、无害的(Harmless)、诚实的(Honest)。最后,他强调,基于价值的推理是对齐技术的核心,并且阐明思维或推理过程为解决安全性和可解释性问题提供了一个有前景的解决方案。

郭毅可主旨演讲

关于我们

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢