表示学习已经发展成一种多功能工具,能够在提供足够数据的情况下解决各种问题。本论文聚焦于两个主要方向:(1) 利用深度学习的力量应用于基础物理学;(2) 使用物理启发的工具来改进并为那些大规模、难以捉摸的黑箱算法提供一些启示。我们探索了一系列应用,这些应用改进了核物理和粒子物理研究的不同方面,涵盖从在线数据选择到离线数据分析的各个阶段。我们还探讨了深度学习如何通过机制可解释性的视角开启全新的研究方向,以(重新)推导基础理论以及重新诠释物理测量的全新方法。最后,我们研究了物理工具如何有助于更好地理解深度学习的动态,并为扩展机器学习前沿的算法和训练范式提供坚实的基础。

论文题目:Exploring the Intersection of Physics Modeling and Representation Learning

作者:Kitouni, Ouail

类型:2022年博士论文

学校:Massachusetts Institute of Technology(美国麻省理工学院)

下载链接:

链接: https://pan.baidu.com/s/1Dams_5o-Ju7E-wTH5lCASw?pwd=pmez

硕博论文汇总:

链接: https://pan.baidu.com/s/1Gv3R58pgUfHPu4PYFhCSJw?pwd=svp5

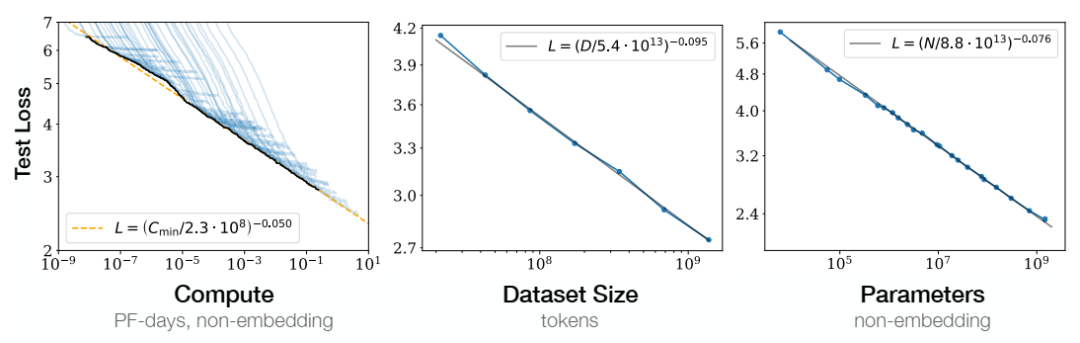

随着模型大小、数据集大小和用于训练的计算量的增加,语言建模性能会平稳提升。为了获得最佳性能,必须同时扩大这三个因素。当不受其他两个因素的瓶颈影响时,经验性能与每个单独因素具有幂律关系。

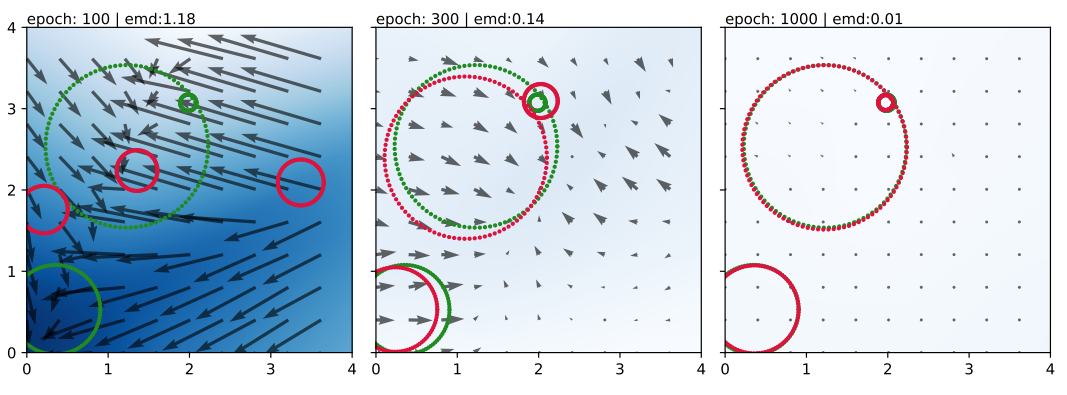

使用 NEEMo 拟合三个合成簇(绿色)和三个圆圈(红色)(参见第 4.3 节)。热图是 Kantorovic 势,参数化为 Lipschitz 有界网络,它在圆圈上产生力(如箭头所示),使它们与目标分布完美对齐(仅显示拟合演变中的几个步骤)。

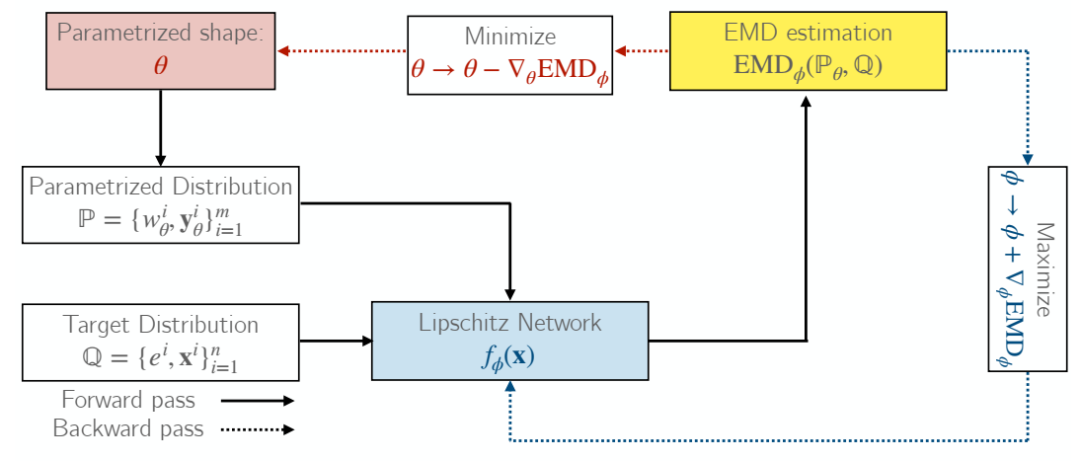

训练程序将参数化形状 Pθ 拟合到分布 Q。NEEMo 将标准 SHAPER 程序中的 ϵ-Sinkhorn 估计替换为 Lipschitz 网络,该网络评估 Kantorovic 势以获得 EMD。

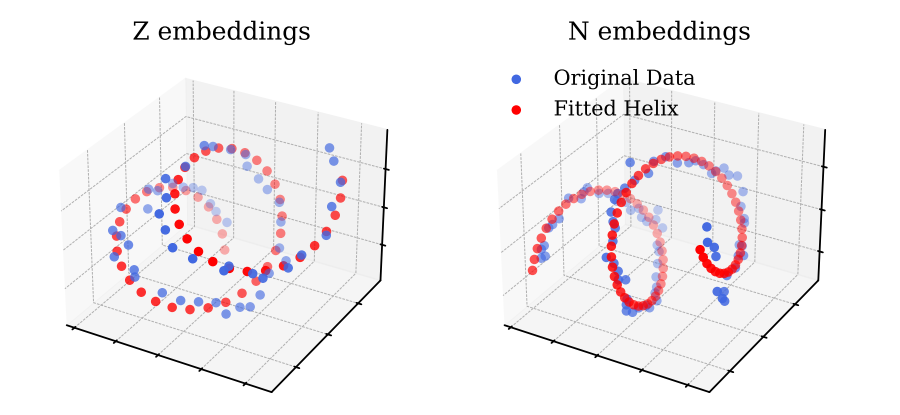

将螺旋线拟合到 PC 投影嵌入中。

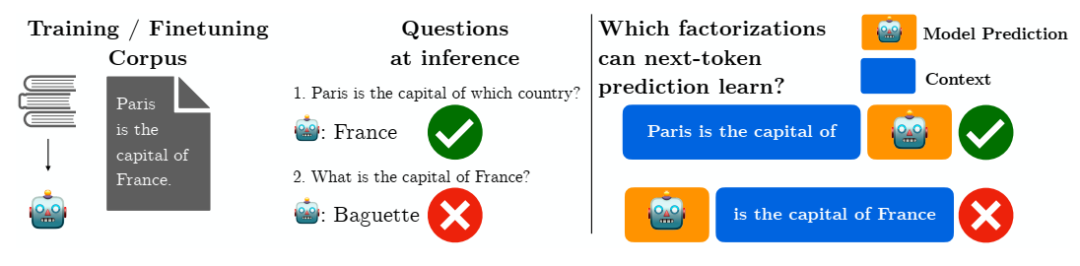

(左)在“法国”之前使用“巴黎”的句子训练模型时产生的逆转诅咒。(右)从左到右的目标不会学习如何从后面的标记预测前面的标记,即使信息内容相同。该模型过度拟合标记联合分布的特定分解,无法回答需要推理不同分解的问题。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢