AI 领域的发展速度令人惊叹,回想一年前我们还在为生成正确手指数量的人像而苦苦挣扎的场景,恍如隔世 😂。

过去两年对开源模型和艺术创作工具而言具有里程碑意义。创意表达的 AI 工具从未像现在这般触手可及,然而这仅仅是冰山一角。让我们共同回顾 2024 年 AI 艺术领域的关键突破与创新工具,并展望 2025 年的发展趋势 (剧透预警 👀: 我们将启动月度资讯精选的订阅👇)。

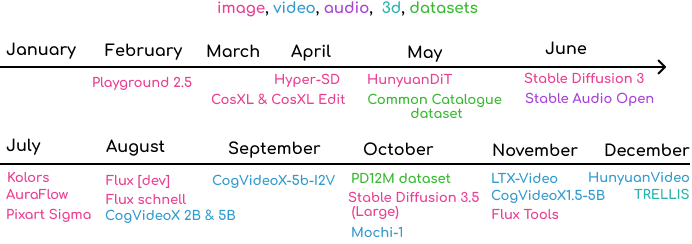

2024 年哪些创意 AI 工具最引人注目?我们将重点盘点艺术创作领域的重要发布,特别关注文生图、视频生成等热门任务中的开源进展。

自初代 Stable Diffusion 掀起开源文生图浪潮已逾两年,如今在文本到图像生成、图像编辑和可控生成领域,开源模型已能与闭源产品分庭抗礼。

2024 年见证了扩散模型的范式转变——从传统 U-Net 架构转向扩散 Transformer (DiT),同时目标函数也进化为流匹配 (flow matching)。

技术速览: 扩散模型与 高斯 流匹配本质相通。流匹配通过不同的向量场参数化方式,为网络输出提供了新视角。

推荐阅读 Google DeepMind 的技术博客 ,深入了解流匹配与扩散模型的关联。https://diffusionflow.github.io

实践进展: Stability AI 率先推出

Stable Diffusion 3 https://hf.co/stabilityai/stable-diffusion-3-medium 腾讯混元 DiT https://hf.co/Tencent-Hunyuan/HunyuanDiT AuraFlow https://hf.co/fal/AuraFlow Flux.1 https://hf.co/black-forest-labs/FLUX.1-dev Stable Diffusion 3.5 https://hf.co/stabilityai/stable-diffusion-3.5-large

在开源图像生成模型的里程碑中,

图像模型的进步带动了个性化生成技术的飞跃。2022 年 8 月,

Textual Inversion https://textual-inversion.github.io DreamBooth https://dreambooth.github.io

然而,微调模型的质量受限于基础模型性能。Stable Diffusion XL (SDXL) 的发布为开源个性化生成树立新标杆,当前多数个性化方案仍基于 SDXL 架构。随着对扩散模型各组件语义角色的深入理解,我们不禁思考: 能否实现不进行额外繁琐优化的高质量生成?

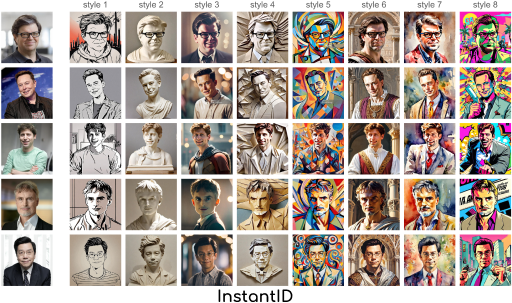

Zero-shot 技术风暴来袭 ——2024 年见证了仅需 单张参考图 即可生成高质量人像的技术突破。

IP-Adapter FaceID https://hf.co/spaces/multimodalart/Ip-Adapter-FaceID InstantID https://hf.co/spaces/InstantX/InstantID PhotoMaker https://hf.co/spaces/TencentARC/PhotoMaker-V2

图像编辑与可控生成 (如边缘/深度/姿态控制) 也取得长足进步,这既得益于基础模型的发展,也源于社区对模型组件的深入理解 (

Instant Style https://hf.co/spaces/InstantX/InstantStyle B-LoRA https://hf.co/spaces/Yardenfren/B-LoRA

未来展望: 尽管 DiT 架构模型 (如 Flux、SD3.5) 已开始探索个性化的应用,但对 DiT 组件语义角色的理解尚不及 U-Net 深入。2025 年或将揭开 DiT 的组件奥秘,释放新一代图像模型的全部潜能。

相较图像生成,视频生成仍任重道远。但必须承认,我们已取得显著进步。OpenAI 的 Sora 极大提升了行业预期,正如 fofr 在

近期开源视频模型的爆发 (

CogVideoX https://hf.co/THUDM/CogVideoX-5b Mochi https://hf.co/genmo/mochi-1-preview Allegro https://hf.co/rhymes-ai/Allegro LTX Video https://hf.co/Lightricks/LTX-Video 混元视频 https://hf.co/tencent/HunyuanVideo 开源视频生成模型现状 https://hf.co/blog/video_gen

虽然多数用户仍难以本地运行视频模型,但这也预示着 2025 年将迎来更大突破。

音频生成在过去一年突飞猛进,从制作简单的声音效果到创作完整的歌曲都取得了很大进步。尽管面临信号复杂度高、训练数据稀缺等挑战,2024 年仍涌现

OuteTTS https://hf.co/OuteAI/OuteTTS-0.2-500M IndicParlerTTS https://hf.co/ai4bharat/indic-parler-tts Whisper large v3 turbo https://hf.co/openai/whisper-large-v3-turbo Kokoro https://hf.co/hexgrad/Kokoro-82M LLasa TTS https://hf.co/HKUSTAudio/Llasa-3B OuteTTS 0.3 https://hf.co/OuteAI/OuteTTS-0.3-1B JASCO https://hf.co/models?search=jasco YuE https://hf.co/m-a-p/YuE-s1-7B-anneal-en-cot

下方歌曲由 YuE 生成🤯

开源之美在于集社区之力探索模型新可能。本年度众多创意工具正是这种协作精神的结晶:

ostris https://hf.co/ostris AI 工具包 https://github.com/ostris/ai-toolkit Flux 微调模型 https://hf.co/spaces/multimodalart/flux-lora-the-explorer

受

face-to-many https://github.com/fofr/cog-face-to-many Face to All https://hf.co/spaces/multimodalart/face-to-all Instant ID https://hf.co/spaces/InstantX/InstantID

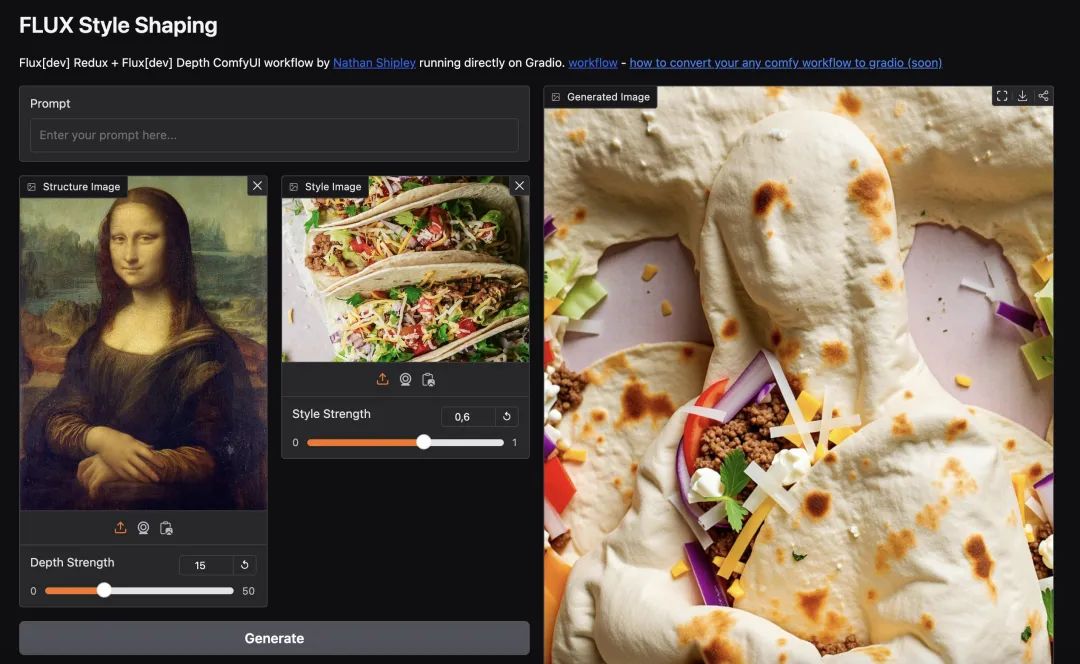

基于

Nathan Shipley https://x.com/CitizenPlain Flux 风格塑形 https://hf.co/spaces/multimodalart/flux-style-shaping

Live Portrait https://hf.co/spaces/KwaiVGI/LivePortrait Face Poke https://hf.co/spaces/jbilcke-hf/FacePoke

2025 年将是开源社区在视频、动态与音频模型领域迎头赶上的一年。随着高效计算与量化技术的突破,开源视频模型有望实现跨越式发展。当图像生成进入自然平台期,我们的目光将转向多模态创新。

YuE 音乐生成模型

Apache 2.0 协议开源的

YuE https://hf.co/m-a-p/YuE-s1-7B-anneal-en-cot 在线体验 https://hf.co/spaces/fffiloni/YuE

3D 生成三剑客

继 TRELLIS 之后,

混元 3D-2 https://hf.co/tencent/Hunyuan3D-2 SPAR3D https://hf.co/stabilityai/stable-point-aware-3d DiffSplat https://hf.co/chenguolin/DiffSplat

Lumina-Image 2.0

这款 20 亿参数的

文生图模型 https://hf.co/Alpha-VLLM/Lumina-Image-2.0 在线体验 https://hf.co/spaces/benjamin-paine/Lumina-Image-2.0

ComfyUI 转 Gradio 指南

这份

从本期开始,我们 (

Poli https://hf.co/multimodalart Linoy https://hf.co/linoyts

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢