在人工智能技术迅速发展的当下,欧盟《人工智能法案》的推进与实施无疑成为了全球瞩目的焦点。从企业合规成本与监管效能的权衡,到数据保护与数字经济发展的平衡,各方争议的本质在于:如何确立技术发展的“安全阈值”,在保障基本权利与释放创新动能之间寻求最大公约数。而2025年巴黎人工智能行动峰会的召开,更是为欧洲人工智能政策的调整与未来走向提供了关键的指引,也对全球人工智能技术的发展格局产生了深远的影响。本文将深入剖析欧洲人工智能法案的争议焦点、峰会的政策转向以及其多维度的影响,探讨在技术创新、产业发展、国际合作与竞争等方面,这一法案将如何塑造欧洲乃至全球人工智能的未来。Part1 欧盟人工智能法案争议剖析:创新与监管的博弈

1.学术界 vs 监管机构:理想与实践的争议

2.企业界 vs 监管机构:创新与合规的平衡

3.欧洲议会 vs欧盟成员国:局部与整体的分歧

4.欧洲议会 vs 欧盟委员会:保守与激进的权衡

5.咨询机构间:监管力度的尺度之争

1.政策导向:监管创新平衡机制的重构

2.监管体系:基于风险演化的适应性治理

3.扶持方向:创新要素的系统性培育

1.技术创新:合规成本与研发激励的双向作用

2.产业发展:市场重构与行业整合加速

3.国际合作与竞争:地缘技术格局的重塑

自2021年欧盟《人工智能法案》提案发布以来,其立法进程了引发多重利益博弈。这部全球首部全面规制AI的法案,既承载着构建可信人工智能的愿景,也折射出技术创新与风险管控的深层张力。剖析这些政策博弈,不仅关乎欧洲数字主权的塑造,更为全球人工智能治理提供制度设计的镜鉴——当技术演进速度超越既有法律框架,如何在动态平衡中构建适配数字文明的新型治理范式,将成为决定AI造福人类能力的关键命题。接下来分别就法案进程的各个阶段,选取关键性争议事件进行分析。

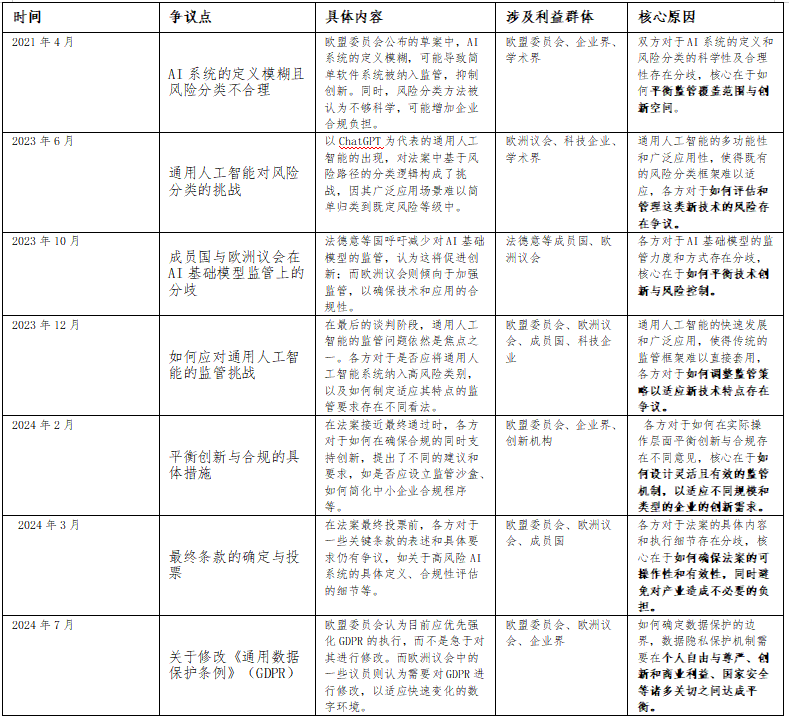

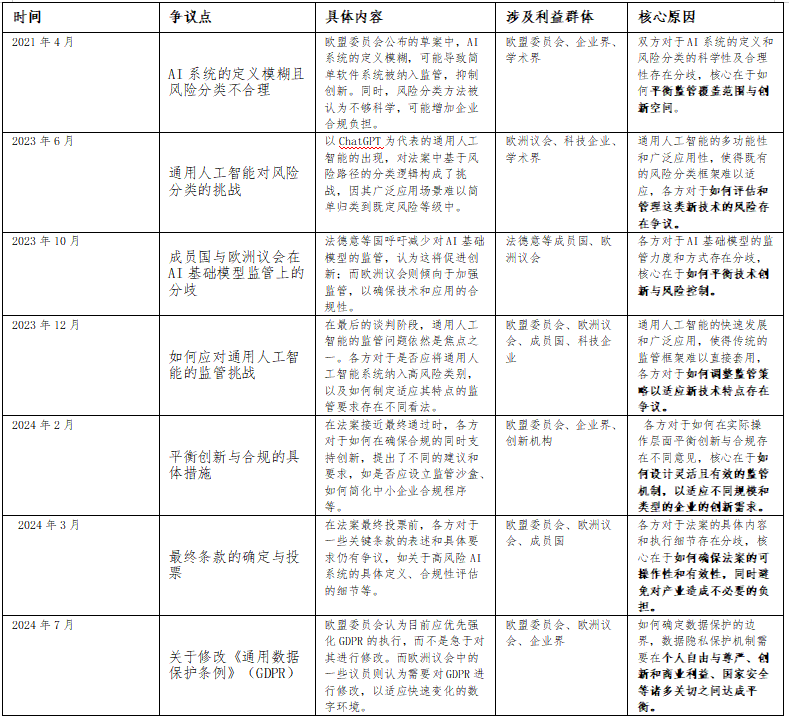

图2《人工智能法案》立法进程核心争议时间线(2021-2024)

学术界和监管机构就人工智能系统的定义和范围有争议,核心原因是双方在人工智能发展的视角和关注点上存在差异,学术界倾向于从技术本质和未来发展潜力的角度来定义人工智能,强调技术的纯粹性和创新性;而监管机构则更关注人工智能在实际应用中的风险和管理难度,倾向于采用更宽泛和灵活的定义以确保监管的全面性和适应性。企业界和监管机构的核心矛盾是技术发展速度与风险控制的优先级冲突。企业界认为法案的规定过于严格,可能会限制技术发展和创新,增加合规成本,从而影响企业的竞争力和市场活力;监管机构则强调确保人工智能系统的安全和合规,认为严格的监管是保护公众利益和基本权利的必要手段。欧洲议会与部分欧盟成员国争议,核心原因是各成员国在人工智能发展和监管上的利益诉求不同。例如2023年10月,法国、德国和意大利等国强调人工智能的本质风险在于应用而非技术本身,因此反对对基础模型进行严格监管,认为这将妨碍创新和产业发展;然而欧洲议会倾向于对基础模型进行更严格的监管,以确保人工智能的安全发展和保护基本权利。欧洲议会和欧盟委员会分歧的本质在于如何在保护个人数据隐私和促进数字经济发展之间找到最佳平衡点。欧盟委员会倾向于通过强化现有法规的执行来实现这一平衡,而欧洲议会则希望通过修改法规来更好地适应新的技术和经济环境。这种分歧的核心原因是双方在个人自由与尊严、创新和商业利益、国家安全等诸多关系平衡的优先级不同。

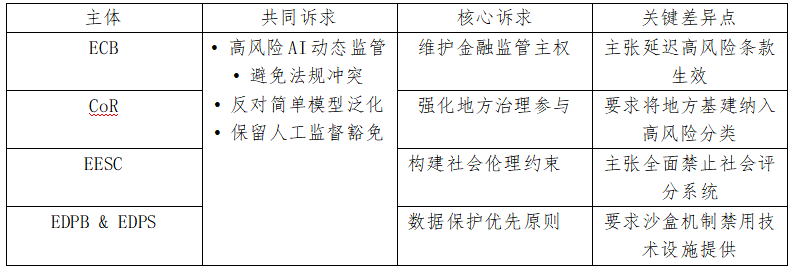

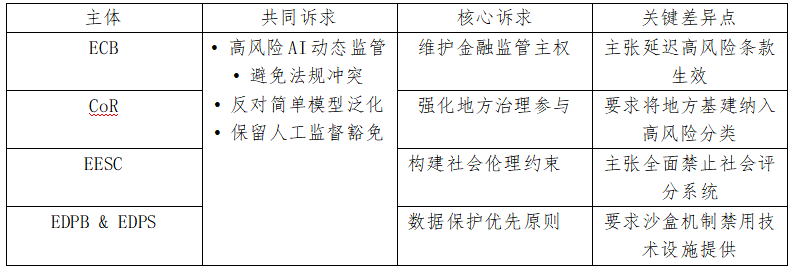

其他欧盟机构和咨询机构(无立法权)在监管范围与力度上产生争议,核心原因是这些机构在技术创新与风险控制之间的平衡有差异。我们主要考察欧洲中央银行 (ECB)、地区委员会 (CoR)、欧洲经济和社会委员会 (EESC) 以及欧洲数据保护委员会和欧洲数据保护监督机构 (EDPB+EDPS)机构在共同诉求、核心诉求、关键差异点等方面的情况。

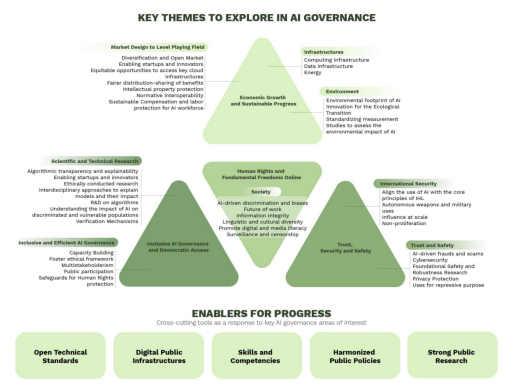

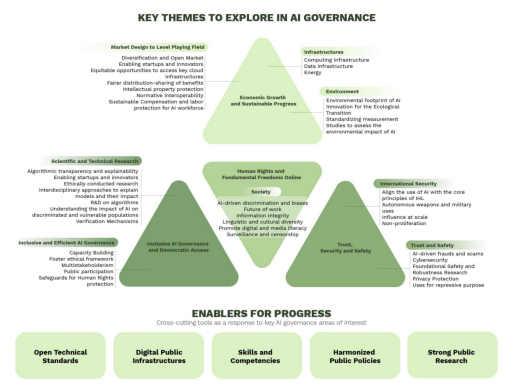

2025年巴黎人工智能行动峰会(AI Action Summit)是欧盟调整人工智能发展战略的重要转折点。从2025年2月6日至11日期间,巴黎举办了许多活动,旨在加强支持人工智能为公众利益服务的国际行动。会议期间,欧洲领导人明确了未来在政策导向、监管重点和产业扶持等方面的具体转向。欧盟此次对人工智能监管政策的调整,不仅将对欧盟的科技产业产生深远影响,也将为全球人工智能技术的发展格局带来新的变化。通过平衡创新与监管、改善监管体系以及转变扶持方向,欧洲正努力构建一个既安全又充满活力的人工智能生态系统。在监管原则上,从预防性原则转向创新驱动范式。法国总统马克龙在巴黎人工智能行动峰会上宣布,欧盟将对人工智能技术开发的监管流程进行简化,这一政策调整标志着欧盟正在积极探寻监管与创新之间的全新平衡点。同时欧洲的技术自主性建设展现出系统性突围的战略野心。硬件层面、数据主权网络、算法自主化不断突破创新,软规则层面欧盟将合规审查转化为技术标准制定权争夺工具,本质上是在全球数字权力重组中构建欧洲的技术护城河。最后,进行治理理念的全球输出:在AI治理主题方向上以社会为中心,将经济增长的可持续发展、包容性的民主治理进程与安全同时作为治理着力点。这种治理范式的比较优势在于其系统整合能力,相较于中国的国家主导模式和美国的市场驱动模式展现出独特的制度创新。

在人工智能技术迭代速度突破摩尔定律的当下,欧洲构建起全球首个风险演化适应性治理模型。该体系的核心在于通过数字孪生技术实时捕捉AI系统的风险熵变,依托监管平台,将全部监管节点接入动态监测网络,使伦理风险评估响应时间大大压缩。基于《人工智能法案》定义的“不可接受风险、高风险、有限风险、最小风险”四级分类框架,AIRMS(动态分级监测系统)通过实时数据采集和分析,动态调整AI系统的风险等级。通过整合欧盟27国的监管节点数据,AIRMS可预测未来6个月内可能突破风险阈值的AI应用领域,提前向企业发出预警。针对“不可接受风险”类AI应用,AIRMS部署了智能合约自动执行禁令,确保在检测到违规行为时能够迅速采取行动。在峰会召开之际,欧盟委员会主席乌尔苏拉·冯·德莱恩(Ursula von der Leyen)在巴黎宣布了一项名为InvestAI的倡议。该倡议旨在筹集2000亿欧元的投资,用于支持人工智能的发展,其中包括设立一个规模为20亿欧元的新欧洲发展基金,专门用于建设大型人工智能基础设施(giga-factories)。这些基础设施将用于开发最复杂的人工智能模型,并推动欧洲成为全球人工智能领域的领导者。除此之外,未来扶持需聚焦技术架构的轻量化与普惠化,建设开源社区驱动的AI开发平台,降低中小企业的技术准入门槛。在应用场景方面实现全链条赋能,推动人工智能技术在更多领域的高价值场景实现规模化落地,为各行业的发展带来新的机遇和动力。

人工智能法案对高风险AI系统的透明度和可解释性提出的要求,虽增加了企业研发成本,部分中小企业可能被迫退出市场,但从长远来看,法案推动的“可信AI”标准将催生新型技术方向,如同态加密数据网络的隐私增强技术,实现了跨境医疗数据联合建模,以及法国Mistral AI绿色AI技术在轻量级模型和开源策略方面降低了能耗,此外,欧盟还计划通过1090亿欧元投资建设主权AI基础设施,预计2026年数据中心芯片国产化率将提升至35%,这无疑为AI技术的未来突破提供了新的机遇和方向。欧洲人工智能法案的实施,合规成本的增加虽然对中小企业构成挑战,但长期来看,通过政策激励和技术突破,将为欧洲乃至全球的人工智能发展注入新的活力。

欧盟新法案对AI系统的严格要求,提升了市场准入门槛,所有在欧盟运营的AI系统都需通过风险评估认证,这使全球AI企业进入欧洲市场的合规成本预计增加25%-40%,如微软Azure AI就因透明度不足被罚款27亿欧元,迫使跨国企业调整技术架构。这一法案导致行业创新活力出现分化,在医疗、工业质检等强监管场景,欧洲企业依托本土数据合规优势扩大市场份额。同时,法案实施后,并购浪潮持续,2024年欧洲AI并购交易占比超全球1/3,预计行业整合将进一步加速,英国AI初创公司被美国巨头收购案例增长,凸显了技术主权危机。欧盟《人工智能法案》沿用以往通过单方面制定法律制度,对全球商业环境和规则体系形成“布鲁塞尔效应”的路径,即通过欧盟内部市场和制度架构,单方面影响全球监管标准,进而获取谈判资本和再次利益分配权。同时,中美欧三极竞争格局逐渐形成,美国通过“星际之门”计划构建技术闭环,中国依托DeepSeek等开源生态扩大影响力,欧盟则以监管为壁垒形成“第三极”。欧盟迫不及待地出台法案,名义上是防止人工智能技术无节制发展,将来可能危害人类,实际上更直接的目的是保护其人工智能相关产业,通过法案制约不利于欧盟的技术,防止美国或中国的人工智能产品快速占领欧盟市场。https://artificialintelligenceact.eu/

https://artificialintelligenceact.eu/documents/

https://www.elysee.fr/emmanuel-macron/2025/02/11/les-actions-de-paris-pour-lintelligence-artificielle

https://commission.europa.eu/index_en?wt-search=yes

https://finance.sina.com.cn/stock/hkstock/ggscyd/2025-02-11/doc-inekccef3388118.shtml

https://news.qq.com/rain/a/20250217A09KSP00

https://news.sina.com.cn/w/2023-12-12/doc-imzxtxcv0850146.shtml

http://www.whwx.gov.cn/xxh/hyfzyw/202408/t20240815_2442183.shtml

审核丨梁正 鲁俊群

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢