点击蓝字

关注我们

梁正

清华大学人工智能国际治理研究院副院长、人工智能治理研究中心主任、中国科技政策研究中心副主任、公共管理学院教授

近几年,智能驾驶一直都是汽车厂商的主要卖点。然而,大众对于智能驾驶的理解并不一致,有人直接认为智能驾驶就是自动驾驶,无须驾驶员也能开,这可能是过度营销与大众认知的错位。需要理解“辅助驾驶”与“自动驾驶”的不同底层逻辑,不过度宣传,也避免不必要恐慌,真正让技术进步护航安全。

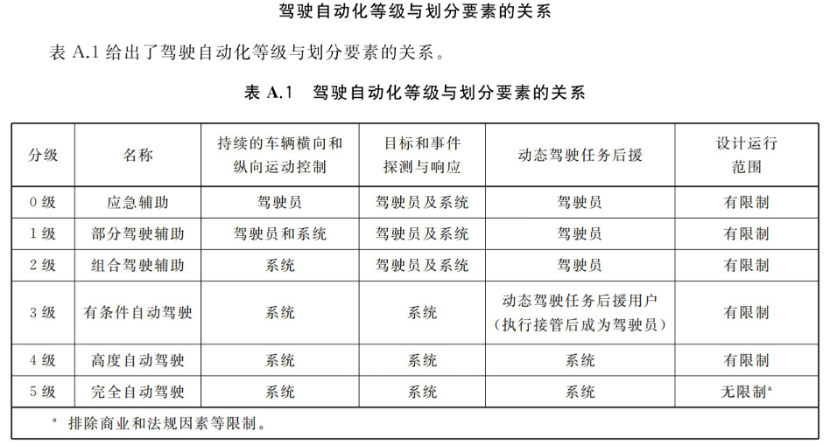

辅助驾驶不等于自动驾驶,L2(组合驾驶辅助)和L4(高度自动驾驶)并非同一技术的不同阶段,而是完全不同的物种。它们的差异体现在技术实现、安全逻辑、责任分配存在明显差异。

一是技术能力方面,从L2到L4无法跃迁,就像诺基亚的功能机不会变成iPhone。

二是安全逻辑方面:L2的“人机共驾”与L4的“系统主导”。相当于L2是人给辅助驾驶系统当保姆,L4是自动驾驶系统给人类当保镖。L2级辅助驾驶的本质是“人机共驾”,其设计初衷是减轻驾驶员负担,而非完全替代人类。组合辅助驾驶可以自主加速、转向和刹车,但对于全天候环境感知能力和解决方面能力不足,尤其是在暗光、逆光、反光、光影变化、雨雪、雾霾等环境条件下,感知能力仍有待提升。辅助驾驶状态下,本质上驾驶员仍为驾驶主体,相当于“人机共驾”模式。过度依赖辅助驾驶可能引发的应变不及时、驾驶员分心等问题。

L4则要求车辆在特定场景内,无需人类驾驶员干预,独立、安全地应对所有突发状况。这种设计逻辑从根源上避免了“预警时间不足”的致命缺陷。

三是事故责任分配方面:L2其法律责任始终锚定在人类主体。当车辆在辅助驾驶状态下发生事故,驾驶员始终是责任承担者。L4的驾驶行为,并非由人类驾驶员判断,因此事故责任分配主体也更多,当前多地的地方性法规都已开展探索。L4事故责任分配更清晰,也能避免当前L2用“辅助驾驶”规避产品责任,却用“自动驾驶”诱导消费者,形成责任真空。

自动驾驶是人工智能在现实世界中最成熟的应用。在以大模型为代表的新一轮人工智能技术爆发的推动下,自动驾驶从规则驱动向数据驱动演进,更多长尾场景被覆盖和解决。此前传统AI支持下的自动驾驶更多基于规则驱动,通常针对单一任务设计,感知-决策-规划-控制等功能独立运行,信息在传递过程中容易产生损耗,且人为设定的规则难以应对复杂多变的交通场景,体现在很多长尾场景的覆盖和解决方面能力不足。大模型为代表的新一轮人工智能技术,多模态数据、端到端技术,视觉语言动作模型(VLA)等,实现更精准的环境理解,大幅提升了自动驾驶的能力上限。90%以上的交通事故都是人为原因造成的,无人驾驶比有人驾驶更安全的理念正在被越来越多的人意识到。谷歌旗下Waymo的数据显示,自动驾驶在避免导致受伤的碰撞等方面比人类驾驶员表现更好。截至2024年12月,Waymo自动驾驶的里程数超过8000万公里。与凤凰城、旧金山的人类司机相比,与人类司机相比,Waymo整体交通事故可减少64%,导致伤亡的交通事故减少81%。

自动驾驶打破物理世界和数字世界的壁垒,是人工智能更好理解复杂物理世界的重要入口,也成为美国争夺通用人工智能(AGI)入场券的重要领域。美国自动驾驶发展持续加速,Waymo每周自动驾驶付费出行单量已达20万次,更是抢先全球布局,已在日本东京开展首次国际自动驾驶测试;特斯拉将提前至今年6月在德克萨斯州奥斯汀推出其首个自动驾驶出租车服务。

近期,美国滥施关税不断加码贸易战,而外部环境越是严峻复杂,我们就越要修炼科技创新的“内功”,增强抵御外部冲击的底气。扎实推动科技创新和产业创新深度融合,加快高水平自动驾驶和人工智能技术及产业应用,把发展的主动权牢牢掌握在自己手中。

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢