随着生成式 AI 的迅猛发展,AI 云服务正成为支撑模型训练与部署的关键基础设施。

在传统超大规模云平台之外,CoreWeave 与 Nebius 作为两家新兴的 GPU 云服务商,分别代表了当下产业中“大模型训练机器”与“生产级推理平台”两种不同的技术路线与市场定位。尽管两家公司表面上有诸多相似之处,如快速部署新一代 GPU、大规模建设数据中心等,但其本质差异远不止硬件层面。

作者 | Kevin Xu & Howe Wang

OneFlow 编译

翻译|张雪聃

生成式 AI 行业正迅速从“愿景与梦想”阶段,迈入真正“落地见真章”的阶段。

在这一重大转变中,一类被称为“GPU 云”的企业扮演着关键角色。CoreWeave 正是这类公司的典型代表,已于今年三月底正式 IPO,成为美股历史上规模最大的 AI 公司。另一家迅速崛起、并且已经上市的 GPU 云企业是 Nebius。当然,市面上还有其他 GPU 云服务提供商,但 CoreWeave 和 Nebius 是目前真正专注于 GPU 云服务且已上市的公司。

虽然 CoreWeave 和 Nebius 在表面上有不少相似之处,但我们认为,与其泛泛地谈“看得见”的共性,不如深入挖掘它们在关键层面的实质差异——这样我们才不会误把“苹果”和“橘子”混为一谈,把本质不同的东西当成一类来看待。

因此,这篇文章将从三个维度对 CoreWeave 和 Nebius 进行对比分析:核心技术、客户群体以及财务结构,并探讨其权衡与差异。(为保持对比的简洁性,我们将不涉及 Nebius 的其他子公司内容。)

1

核心技术层面:

极速扩展 GPU 的能力 vs 全栈平台

CoreWeave 的核心战略是:抢在所有竞争者之前,以最快速度上线英伟达最新款 GPU,并通过多年期租赁的方式,以极具竞争力的价格提供这些 GPU。这种以硬件为核心的模式,在 CoreWeave 对英伟达的 Hopper 和 Blackwell 系列 GPU 的迅速部署上体现得淋漓尽致——通常从 Dell 、SuperMicro 等 OEM 厂商收到完整服务器设备后的两周内,便能投入使用。

CoreWeave 创始人出身于对冲基金行业,曾从事能源套利,因此非常擅长协调复杂的基础设施部署流程:包括获取电力资源、土地、数据中心配套装置以及安装 GPU 服务器。他们能以极快速度完成整个流程,为客户提供 AI 模型训练所需的基础算力资源。本质上,CoreWeave 提供的是快速可靠、规模庞大的裸机 GPU 服务——一次可提供成千上万,甚至可能达百万级别的 GPU 设备。由于是“裸机”服务(即几乎不附带软件层),这类资源的性能表现极为出色。这正好契合了客户的核心需求:这些客户通常具备高技术能力,迫切需要直接获取市面上最快的 GPU,来承载大规模、高强度的 AI 负载,例如从零开始训练基础模型;这类客户反而不太需要额外的软件服务。

相比之下,Nebius 的策略更全面和“全栈”。除了拥有自己的一批 Hopper 和 Blackwell GPU 之外,它还构建了多个软件层,类似于 AWS 或 GCP 提供的服务,比如托管数据库、MLOps 工具、容器注册服务、存储系统等。这种策略基于这样一个假设:AI 行业的未来发展,不仅需要强大的裸 GPU 算力,更需要构建在其之上的全方位云服务功能,以便最终打造真正可用的 AI 应用。

与 CoreWeave 相似,Nebius 的差异化战略源自其背景。 Nebius 是从 Yandex(俄罗斯搜索引擎巨头)资产剥离发展而来,Nebius 从中继承了“精简的软件栈”和一个超过 500 名工程师的团队,其中许多人曾参与构建和运营 Yandex Cloud。这个团队在为第三方客户建设基础设施和运行云服务方面积累了丰富的经验。Nebius 有 Yandex Cloud 作为基础,同时拥有强大的软件开发能力,这使其抽象化基础设施层的战略变得水到渠成,从而简化开发者的使用体验。

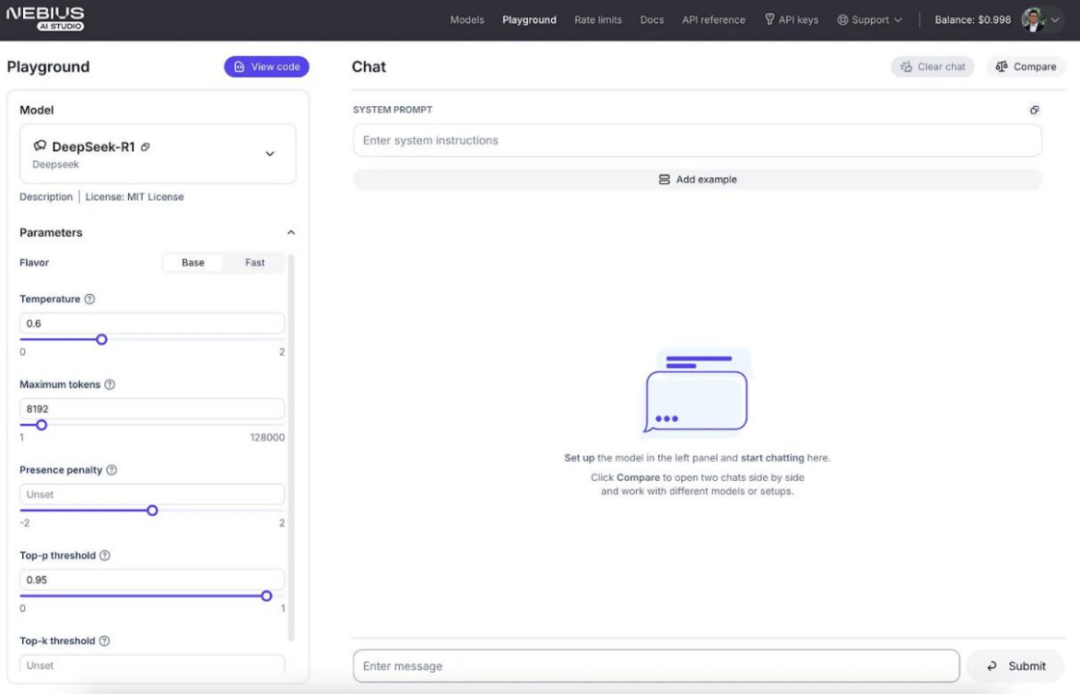

由于 Nebius 曾经从零开始构建自己的云平台,所以它没有与 Dell 和 SuperMicro 这样的服务器 OEM 厂商合作。它跳过了这一环节,设计了自己的服务器机架,以建立一个更加垂直整合的系统,从数据中心架构到托管式 Kubernetes 服务,再到像 Nebius AI Studio 这样的应用层工具(该工具为 DeepSeek、Llama 和 Flux 这样的开源模型提供推理 API)。(视频:Nebius 工程师在 Open Compute Project 大会上介绍其内部服务器在设计方面的技术实力:https://www.youtube.com/watch?v=jPLbKjYAado)

权衡对比:构建 GPU 云平台并没有固定方式。CoreWeave 和 Nebius 的方法差异正展示了这种分歧及其必要的权衡。要么从提供快速且资源充足的裸机租赁服务开始,要么从一个功能多样、开发者友好的全栈平台开始,尽管后者的性能表现可能相对逊色。

话虽如此,无论最初来自哪个技术栈,云平台通常会随着时间推移趋同。因为这是唯一能够保持长期竞争力的方式。这一点在 CoreWeave 和 Nebius 的发展中都能看到。

CoreWeave 开始通过内部开发提供一些软件服务层,比如托管 Kubernetes 和 Slurm,并与外部合作伙伴(如 Together.ai 和 Fireworks AI)进一步整合以提供推理服务。最近,CoreWeave 还收购了 Weights and Biases,以加速其软件服务的扩展。与此同时,Nebius 则专注于优化其服务器设计,通过提高硬件组件的效率,确保在总体拥有成本(TCO)方面不落后于 CoreWeave。可以说,CoreWeave 正在向上构建技术栈,不断丰富软件层;而 Nebius 则向下深耕底层基础设施。虽然两家公司路径不同,但目标一致——都希望突破早期产品定位所带来的客户局限,拓展更广泛的市场。

2

客户群体层面:

少数大模型训练者 vs 众多有潜力的 AI 应用创业公司

CoreWeave 的客户群主要集中在一个狭窄但极具价值的细分市场:拥有自研能力、专注于训练大模型的大型科技公司。这也是微软占据了其 2024 年营收 62% 的原因。而就在三月,OpenAI 也与 CoreWeave 签署了一份金额高达 119 亿美元的为期五年的大单。另一位标志性客户则是英伟达。在 IPO 路演中,CoreWeave 透露,全球六大顶级 AI 实验室中,有四家是它的客户。

CoreWeave 的定位就是为那些走在大模型开发最前沿的团队提供“首选训练机器”。正如前文所提,它提供的裸机 GPU 服务对这些前沿实验室极具吸引力,这些团队拥有足够强的工程能力,可以最大程度发挥直接调用 GPU 的优势,而无需依赖上层各种软件封装。这类客户通常需要的是大规模、同构化 GPU 集群,用于从零开始训练模型,而不是微调或部署推理服务,并具备自主管理软件栈的技术能力。同时,他们也有足够的资金,或有能力融资,来签署长期合作协议——而这正是 CoreWeave 必须握在手中的筹码,用来建设更多的数据中心以及采购更多算力与 GPU 资源。

换句话说,市场上有 95% 的公司并不需要 CoreWeave 所提供的服务,或用不好它的产品。不过,那 5% 的资金雄厚、野心勃勃的前沿 AI 实验室客户对它趋之若鹜,这个市场小而深,价值巨大。

相比之下,Nebius 的客户构成就显得更为分散。它的用户既包括大型的 AI 训练机构,也包括初创企业和企业内部的 AI 团队,但这些客户签署的合同期限通常较短。这种客户结构有点像 AWS 初创时期的样子——当时的客户大多是愿意尝试“云计算”这一新概念的早期创业公司。AWS 的赌注是:这些初创企业中总有一家会成功,并成长为“云原生”(即专为云平台设计与部署)公司,从而带来稳定营收,并验证云计算作为新一代基础设施平台的可行性。对 AWS 来说,那家企业就是 Netflix。

Nebius 也在押注——希望下一个“生成式 AI 领域的 Netflix”就诞生在自己的云平台之上。因此,它选择走一条客户群更加分散、多元的路线,这也完全合理。但问题在于,大家都在做这个赌注。好在,如今用云计算已不再是一个需要说服客户接受的新概念。不过,谁能成为下一家 AI 独角兽初创公司的“摇篮”,这场争夺战仍旧异常激烈。不只是 GPU 云服务厂商之间竞争白热化,他们还面临来自 AWS、Google Cloud 等超大规模云平台的强大压力。

很多事情其实并不在 Nebius 的掌控之中。其唯一能掌控的,就是专注打磨自己的核心产品定位——打造一个能成为“生产级推理平台”的端到端云服务。我们特别强调“生产级”,是因为目前大多数 AI 应用仍处于研发、实验和概念验证阶段。像 CoreWeave 所擅长的预训练本质上属于研发范畴。而将研发成果真正部署到生产环境服务中运行和响应用户请求,这才是 Nebius 想要建立差异化优势的重点方向。

Nebius 的客户群体和服务也体现了它这种更长远、更广泛的愿景。虽然 Nebius 也服务于那些训练自有基础模型的生成式 AI 初创公司(这与 CoreWeave 的核心客户群类似),但它同时也吸引了很多大企业内部的小型或中型开发与研究团队。这类客户往往不是纯技术公司,比如物流公司、制造企业等,他们技术实力相对有限,远不如像 OpenAI 那样的顶尖科技公司,因此更看重 Nebius 提供的全套软件抽象层服务。

权衡对比: 两者在客户类型上的差异非常明显。CoreWeave 客户高度集中,但每个客户都大名鼎鼎(如微软、OpenAI);而 Nebius 的客户分布广泛,虽然在科技圈之外鲜有耳熟能详的名字,但胜在“撒网广、机会多”。下图梳理并对比了这两家 GPU 云服务商在整个技术栈各层面的情况。

CoreWeave 的新用户上手体验对小团队来说可能不太友好。新用户必须先通过一个“预约会谈”页面,填写一份联系表格,详细说明自己的使用需求。这种“人工筛选式”的流程对小型团队或经验不足、希望开箱即用的开发者不太友好。但对 CoreWeave 的主要客户——那些已经预定了大量 GPU 资源的大型企业客户来说,这种流程是合理的,他们知道自己需要什么,也清楚想使用哪些资源。

为了优化开发者使用体验,CoreWeave 正在通过合作、收购以及部分自研手段,扩展其提供的服务内容。目前,其软件栈已经包括 CoreWeave Kubernetes 服务(CKS),用于大规模容器调度管理;运行在 Kubernetes 上的 Slurm(SUNK),用于高效的任务调度;集成了 Weights & Biases 工具(https://www.youtube.com/watch?v=tHAFujRhZLA),支持对机器学习实验过程的全流程追踪和管理;以及一套实时可观测性工具,用来监控系统性能。这些工具使 CoreWeave 成为非常适合处理大规模机器学习和生成式 AI 工作任务的平台。

Nebius 提供的是一个简洁且开发者友好的平台,通过完全集成的端到端环境,显著简化了 AI 模型的训练与推理流程。平台中的大多数工具均为自主研发,包括支持大规模调度的托管 Kubernetes、基于 Slurm 的集群调度系统、用于实验管理的 MLflow、自研的可观测性工具,以及一个具备安全保障的云端基础设施控制平台。用户的接入过程非常顺畅,无需预付费用,也不需要任何前期承诺。平台还提供一定额度的免费配额,并以较低的词元计价(例如 Meta Llama 3.1-8B-Instruct 的模型输入每 1000 词元仅需 0.02 美元,输出为 0.06 美元),足以支持初步实验和尝试。配合 AI Studio 工具,用户可轻松进行模型微调和部署操作,使开发流程几乎无缝衔接,极大降低了初期使用的门槛,提供了良好开发者体验。对于希望在统一的 AI 技术体系内快速构建、迭代和扩展的团队来说,这样的平台很合适。

不过,Nebius 的用户体验也并非全无短板。尤其在售后支持方面,仍存在一些挑战。根据一位用户反馈,与 CoreWeave 和 Lambda Labs 等竞争对手相比,Nebius 的客服响应时间偏长,问题解决周期也相对更久。

鉴于两类客户各有所长,一个关键问题是:哪种 GPU 云服务的商业模式更具可持续性。这就引出了本文最后一个对比维度财务结构,也就是债务模式与现金储备模式的差异。

3

财务结构层面:

债务模式 vs 现金储备模式

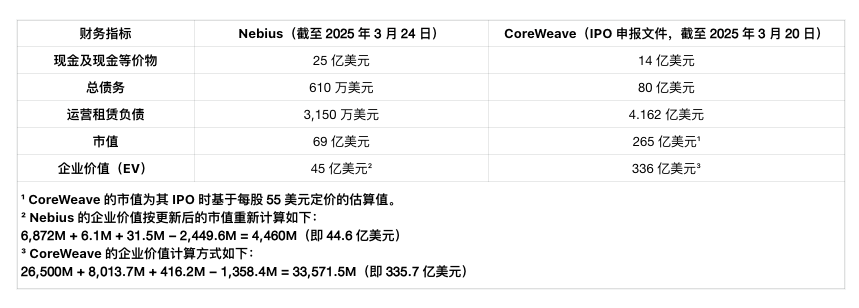

CoreWeave 正在实行一种高杠杆(即高负债运作)的融资策略(https://procurefyi.substack.com/p/coreweaves-s-1-is-finally-here-ais)。到 2024 年底,CoreWeave 的总债务已高达约 80 亿美元,外加 4.16 亿美元的运营租赁负债,而它的现金储备却相对较少,仅有 14 亿美元。这种激进的融资结构主要依赖一种叫做“延期提取定期贷款”(DDTL,Delayed Draw Term Loans,允许借款人在约定期限内根据资金需求分批提取已承诺的贷款额度,而非一次性提完全款) 的专项资产支持贷款方式。

特别是,这些债务大多数并不直接体现在 CoreWeave 的资产负债表上。相反,它通过设立“特殊目的载体”(SPV,Special Purpose Vehicles)来承担债务,这些 SPV 是独立的法律实体,其发行的债务由有形、可产生收入的资产(比如 GPU、网络设备和数据中心)作为抵押担保。

这种复杂的“资产支持证券化模式”在房地产和基础设施行业中较为常见,但在云计算行业则是一种较新的尝试。CoreWeave 的做法确实带来了一些好处,比如因强抵押担保而降低了放贷方的风险,也可能比传统的公司债务或股权稀释方式获取更优惠的融资条件。但与此同时,这种模式也限制了 CoreWeave 的经营灵活性。根据其 S-1 文件披露,公司必须优先将现金流用于偿还债务本息——仅 2024 年的利息支出就达到约 3.61 亿美元。这种刚性义务使 CoreWeave 难以将利润再投资于扩张或新项目,也难以轻易扩大基础设施,更别提未来向股东分红了。

CoreWeave 的融资模式中最独特的一点是:浮动利率与客户信用挂钩,尤其体现在 DDTL 融资工具(包括用于客户合同资本支出的DDTL 1.0 和 DDTL 2.0)中。该结构下,CoreWeave 借贷成本直接关联客户信用评级:比如与投资级企业客户 Microsoft 签订的合同利差较低——约为SOFR 利率(有担保隔夜融资利率,当前约 4.3%)(https://sofracademy.com/current-sofr-rates/)上浮 6.5% 或基准利率上浮 5.5%。而由非投资级客户(例如初创公司或新兴 AI 企业)收入担保的债务利率最高可达 SOFR 上浮 13.0%,或基准利率上浮 12.0%。

至此,大家可能已经被这么多贷款术语和利率数字绕晕了。虽然结构复杂,但这种融资模型确实使 CoreWeave 的资本成本与客户群的财务稳定性紧密挂钩——优化了融资成本,但也引入了客户信用波动带来的不确定性与风险。

相较之下,Nebius 的财务结构则要稳健得多,其资产负债表也更加容易理解。到 2024 年底,Nebius 拥有约 25 亿美元的现金储备,债务总额仅为 610 万美元,运营租赁负债也只有 3150 万美元。其资金主要来自于从 Yandex 业务剥离后获得的收入以及 英伟达和 Accel 的投资。得益于和英伟达的关系(Yandex 曾是英伟达在美国和中国以外最大的客户),Nebius 将能优先获得英伟达的新一代产品,例如 Blackwell Ultra,并以最快速度投入市场,就像 CoreWeave 一样。

短期来看,这些现金储备可能还不算决定性优势,毕竟当前 GPU 云市场还处于抢占市场与扩大份额的阶段,这一阶段通常并不以单位经济效益和即时盈利能力为优先目标。但从长期看,Nebius 对其 AI 基础设施的完全所有权与 CoreWeave 则更多依赖举债与客户合同作为抵押的“所有权”之间可能形成关键差异,Nebius 比 CoreWeave 拥有更大空间来探索积极、可持续的单位经济效益。尤其是,Nebius 当前计划在两年内实现基础设施规模增长 40 倍,而这一扩张完全由其自有资金支撑,并不依赖债券人,投资者应该牢记这一点。

尽管现在还难以预测战局会如何演变,但 GPU 云服务领域的价格战已经打响。我们已经观察到市面上 Hopper GPU 的计算价格几乎已接近盈亏平衡点 —— 根据我们的估算,每小时成本大约是 1.6 美元(第一年)(https://x.com/WangUWS/status/1904535860260851822)。而且业内都知道,公开标价并不等于最终价格,大客户通常能获得大幅折扣。随着 Blackwell 架构的 GPU 大量涌入市场,它在未来两到四年能否维持价格优势,将成为观察的关键。

唯一可以确定的是:如果一家 GPU 云厂商提供的只是“GPU 本身”,那么大家的差异其实并不大,价格战不可避免。要想长期生存并发展,必须能优先提供市场所渴望的最新 GPU,同时在其之上构建出差异化的软件栈,以吸引并留住开发者,防止他们转投他处。

4

结语:有 GPU 云就足够了吗?

从某种意义上说,CoreWeave 和 Nebius 并不算是直接竞争对手。它们都在争先恐后地实现一个由英伟达主导的未来范式,即在云数据中心只需一间装满由黄仁勋创造的设备的房间。他们更像是战友,而不是敌。两者的命运都和英伟达紧紧绑定,要么一起腾飞,要么一起沉没。

如果英伟达失败了,那这两家 GPU 云厂商也很难幸免。话说回来,如果英伟达失败了,整个“AI 革命”可能也会偃旗息鼓,美国股市的一半可能都要塌掉。我们认为这种情况并不会发生,除非我们哪天真的被现实打脸,开始把现金塞到床垫底下去避险,否则眼下更有建设性的讨论搞清楚以下问题:GPU 云到底是怎么运作的?像 CoreWeave 和 Nebius 这样的云服务提供商,它们之间真正的差异在哪里?这些差异是否能帮助我们预测谁更可能在未来胜出?

希望这篇文章至少能为你解答其中的一部分问题。

即刻体验DeepSeek R1

cloud.siliconflow.cn

扫码加入用户交流群

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢