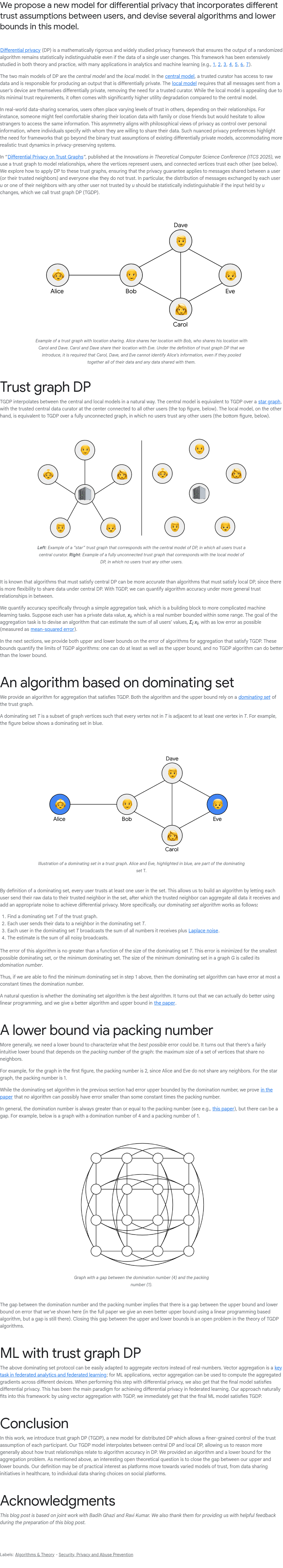

本文提出了一种新的差分隐私模型,该模型结合了用户之间的不同信任假设,并设计了该模型下的若干算法和下界。差分隐私(DP)是一种严谨的数学隐私框架,确保随机算法的输出在单个用户数据改变时仍保持统计上不可区分。DP在理论与实践中均被广泛研究,应用于数据分析和机器学习等领域。传统的DP模型主要包括集中模型和本地模型。集中模型假设存在一个可信赖的管理者,负责对原始数据进行处理以生成满足差分隐私的输出;而本地模型要求用户设备发送的所有消息本身即需满足差分隐私,从而无需依赖可信第三方。尽管本地模型因较低的信任需求而具有吸引力,但其性能通常不如集中模型。新模型通过引入不同的信任假设,在隐私保护与实用性之间提供了更灵活的权衡。

本专栏通过快照技术转载,仅保留核心内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢