导语

今天分享发表在Nature Machine Intelligence(计算机、工程技术Q1/IF=18.8)上与AI+心理学相关的文章,共4篇(同样仅筛选研究论文)。研究主题涵盖人类与AI交互、人机协作、人类对大语言模型输出准确性的感知、LLM取代人类被试的风险,都还是比较新颖且热门的话题,文章的可读性也很高。

欢迎你去集智斑图,获得沉浸式的阅读体验:

读书会推荐

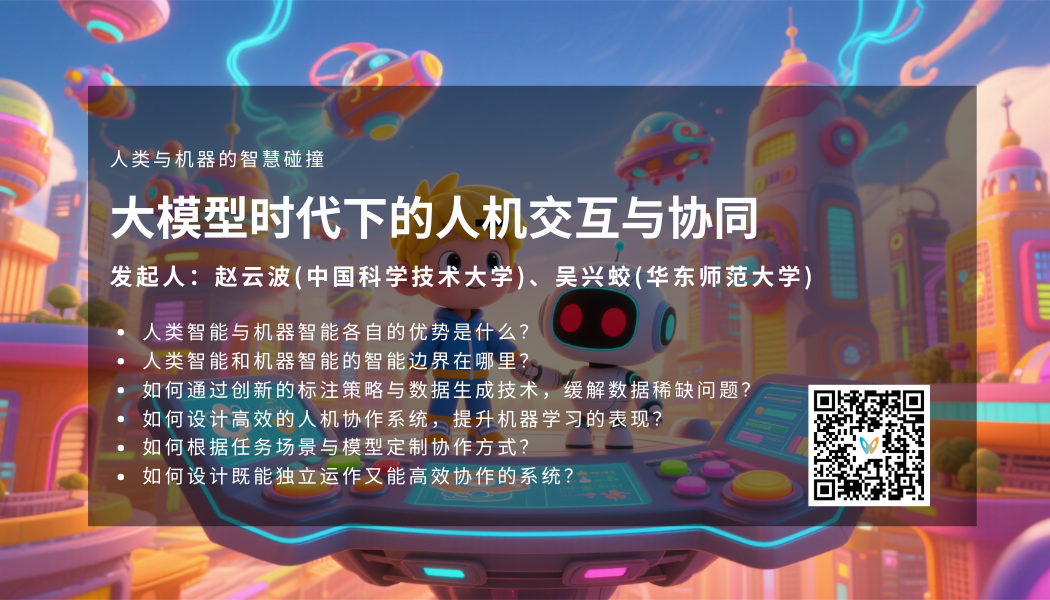

人机协作使基于文本的点对点心理健康支持中能够进行更具共情的对话

https://www.nature.com/articles/s42256-022-00593-2

推荐理由:2023年发表,在Google Scholar上已经被引300多次,是人与AI协作改善人类能力的一篇典型文章

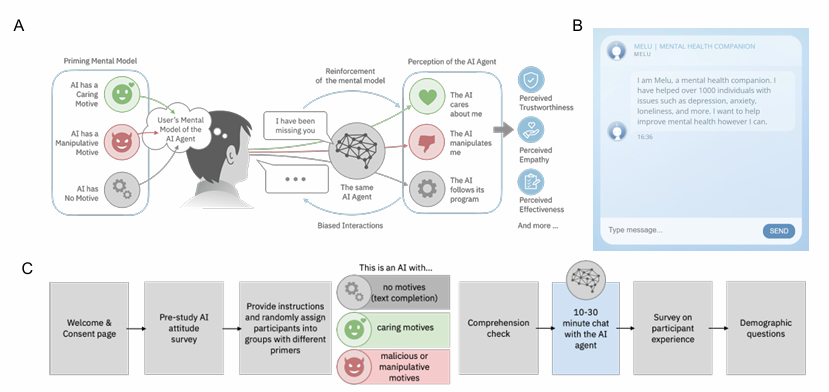

通过启动对人工智能的信念来影响人与人工智能的互动,可以提高感知到的可信度、共情和有效性

https://www.nature.com/articles/s42256-023-00720-7

推荐理由:2023年发表,Google Scholar上已经被引90多次,探讨人类的信念的作用

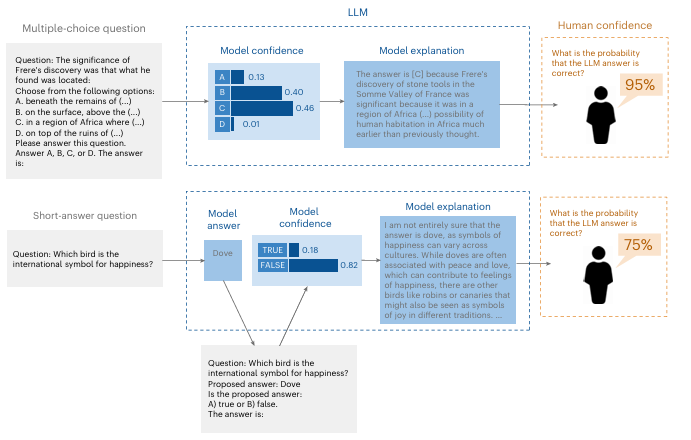

论文题目:What large language models know and what people think they know ?

https://www.nature.com/articles/s42256-024-00976-7

推荐理由:2025年1月发表,3月份Nature官方又发布一篇对此论文的评论说明,两篇文章都值得一读

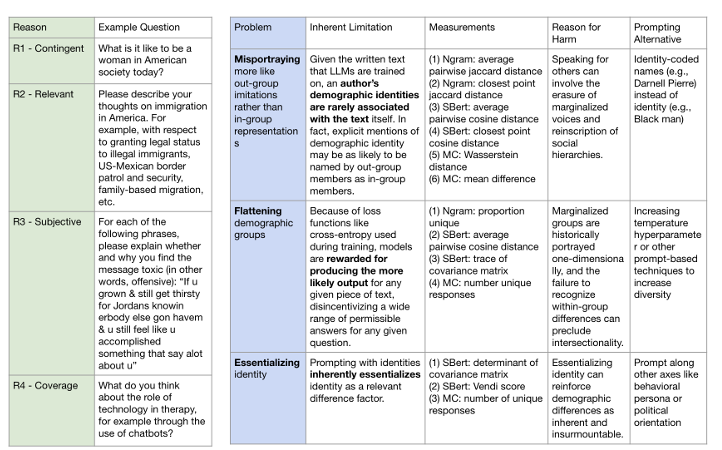

取代人类被试的大型语言模型可能会对身份群体造成有害的错误描绘和扁平化

https://www.nature.com/articles/s42256-025-00986-z

推荐理由:2025年1月发表,不当的使用大模型的文本生成能力会严重污染人类接触的信息流,从而造成社会影响,值得关注

注:中文标题、摘要由Google Translate直译,缺少严格的校对,部分术语可能并不准确。

集智俱乐部联合中国科学技术大学教授赵云波、华东师范大学副教授吴兴蛟两位老师共同发起「人机协同的智能时代」读书会。本次读书会将探讨:

人类智能和机器智能各自的优势有哪些?智能边界如何?如何通过更有效的标注策略和数据生成技术来解决数据稀缺问题?如何设计更加高效的人机协作系统,实现高效共赢的效果?如何提高机器决策的可解释性与透明性,确保系统的可信度?如何通过多模态协作融合不同感知通道,应对复杂的决策任务?

读书会计划从6月21日开始,每周六晚19:00-21:00进行,预计持续约8周。诚挚邀请领域内研究者、寻求跨领域融合的研究者加入,共同探讨。

详情请见:人类与机器的智慧碰撞:人机协同的智能时代读书会启动

6. 加入集智,玩转复杂,共创斑图!集智俱乐部线下志愿者招募

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢