RegGS团队 投稿

量子位 | 公众号 QbitAI

想象一下,你随便用手机拍了几张家里的照片,没有精确的相机位置,甚至照片之间重叠都很少。

现在,一个新算法能把这些零散的2D图片,“拼”成一个厘米级精度的3D数字模型,效果好到可以直接放进VR头显里“云旅游”。

在许多实际场景中,图像间的重叠有限、拍摄角度跨度大,且往往缺乏准确的相机姿态信息。

传统NeRF虽能联合优化位姿和辐射场,但计算代价高、难以收敛;而NoPose类的feed-forward模型虽然高效,却只能处理极少张图片,无法泛化到大规模场景。

这就引出了一个核心矛盾:基于优化的方法不够鲁棒,前馈式的方法不够灵活。

那么能否鱼与熊掌兼得?来自香港科技大学(广州)的一项研究工作RegGS,通过对局部3D高斯表示进行注册与融合,为这一挑战提供了新的解决方案。

方法核心机制:高斯之间的结构配准(Registration)

港科广团队提出了一种面向稀疏无位姿图像的三维重建方法——RegGS,结合前馈式的高斯表示与结构级配准机制,探索了在实际数据约束下实现可用3D重建的一种新路径。一套新的配准框架:

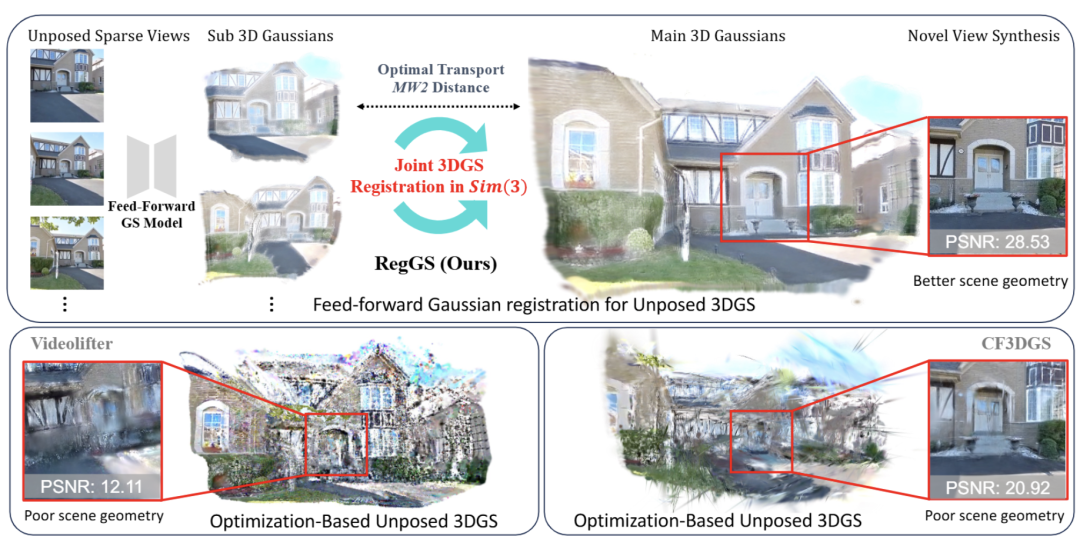

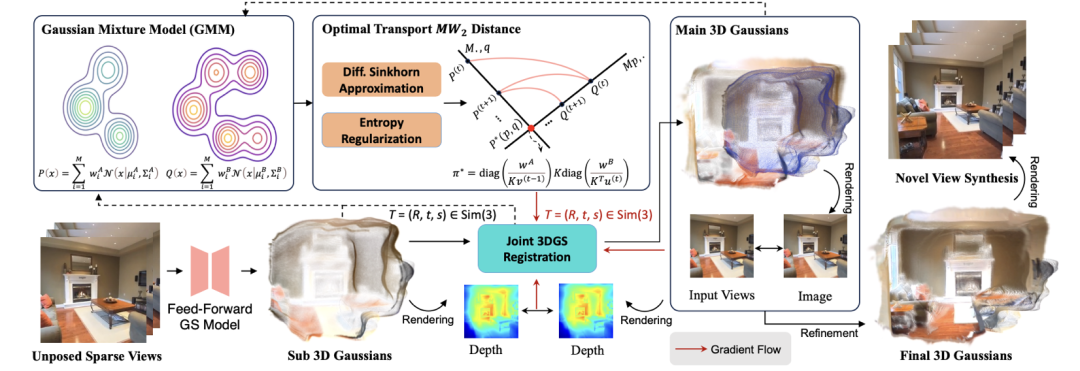

△图:RegGS整体流程图

RegGS的核心机制是对局部3D高斯混合模型进行配准(registration),并逐步构建全局3D场景:

引入熵正则化的Mixture Wasserstein-2距离(MW2)作为高斯分布间的结构对齐度量; 在Sim(3)空间中对尺度、旋转和平移联合优化,尺度自适应; 融合MW2距离、颜色一致性和深度一致性联合3DGS配准模块,由粗到细稳定配准;

这种设计避免了依赖 SfM 的初始化过程,也不要求图像输入数量较多,适用于更宽松、现实的数据环境。

实验与开放资源

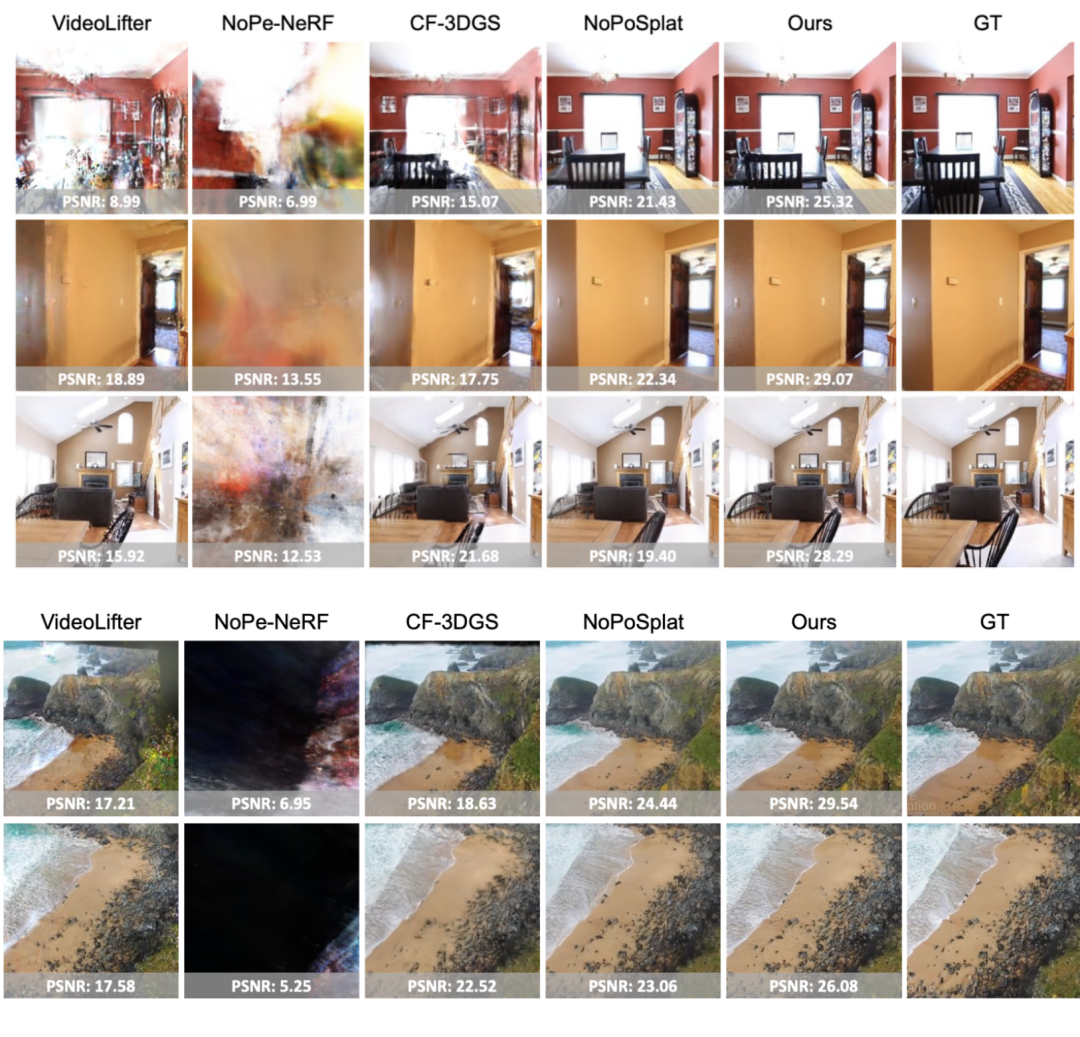

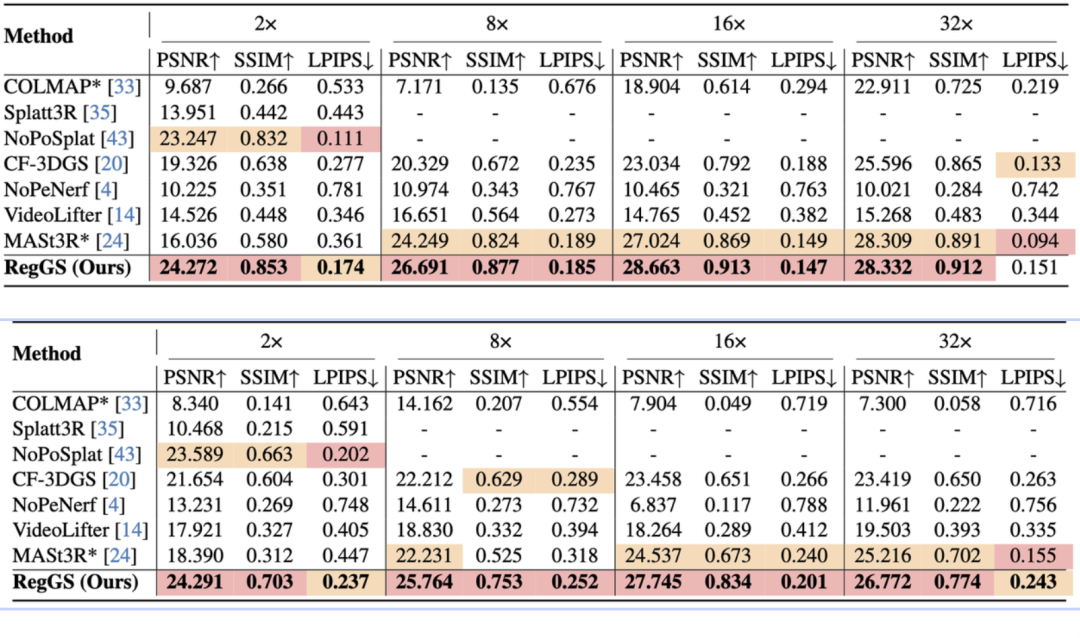

在RE10K和ACID两个数据集上,RegGS在不同输入帧数(2×/8×/16×/32×)下,PSNR、SSIM和LPIPS等指标全面领先现有主流方法。

△图:RegGS新视角合成结果

△图:RegGS定量的评估结果

应用潜力:适配多种“非理想输入”重建任务

RegGS 所解决的“稀疏+无位姿”问题在多个应用中极具现实意义:

- 个人/UGC视频的3D化:

用户拍摄的短视频通常没有相机参数,但RegGS可以实现从少量画面中直接还原空间结构;

- 无人机航拍建图:相比多视图几何和SLAM,RegGS对于视角跨度大、帧率低的航拍视频更鲁棒;

- 历史图像/文档还原:博物馆、新闻档案等场景中仅存几张不同角度照片,RegGS有望在没有精确姿态的情况下进行三维重建;

与传统基于SfM或Bundle Adjustment的重建方法相比,RegGS不需要全局可视性或特征匹配,结构性要求更低,在“非结构化输入”的应用中更具可行性。

同时,研究团队也分析了方法的局限性,当前方法的性能和效率在一定程度上受限于上游前馈模型的生成质量,以及MW_2距离计算带来的开销,这些都是未来值得继续优化的方向。

总之,RegGS 提供了一种将最优传输、可微配准与高斯表示相结合的稀疏3D重建框架,不仅拓展了3DGS方法在无位姿/稀疏数据下的应用能力,也为更多现实场景下的空间理解任务提供了新思路。

论文链接:arxiv.org/abs/2507.13285

项目主页:https://3dagentworld.github.io/RegGS/

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!

— 完 —

🌟 点亮星标 🌟

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢