导语

智能向善是统筹人工智能发展与安全的重要目标。但是人工智能发展与安全治理的规范滞后性和治理碎片化导致多种系统风险的加剧。本文提出“以开源开放塑生态、以标准先行控风险、以评价监管促向善”的三位一体协同联动推进路径,为构建人工智能发展与安全的全球治理新标准和新秩序提供中国方案。

作者

王黎萤 余佩玲 陈劲 梁正 蔡灵巷 文佳 谢雯欣

2025年4月25日,习近平总书记在主持中共中央政治局就加强人工智能发展和监管进行第二十次集体学习时指出,“人工智能带来前所未有发展机遇,也带来前所未遇风险挑战。要把握人工智能发展趋势和规律,加紧制定完善相关法律法规、政策制度、应用规范、伦理准则,构建技术监测、风险预警、应急响应体系,确保人工智能安全、可靠、可控。”早在2018年,习近平总书记在政治局第九次集体学习就已强调“加强人工智能发展的潜在风险研判和防范,确保人工智能安全、可靠、可控发展”。

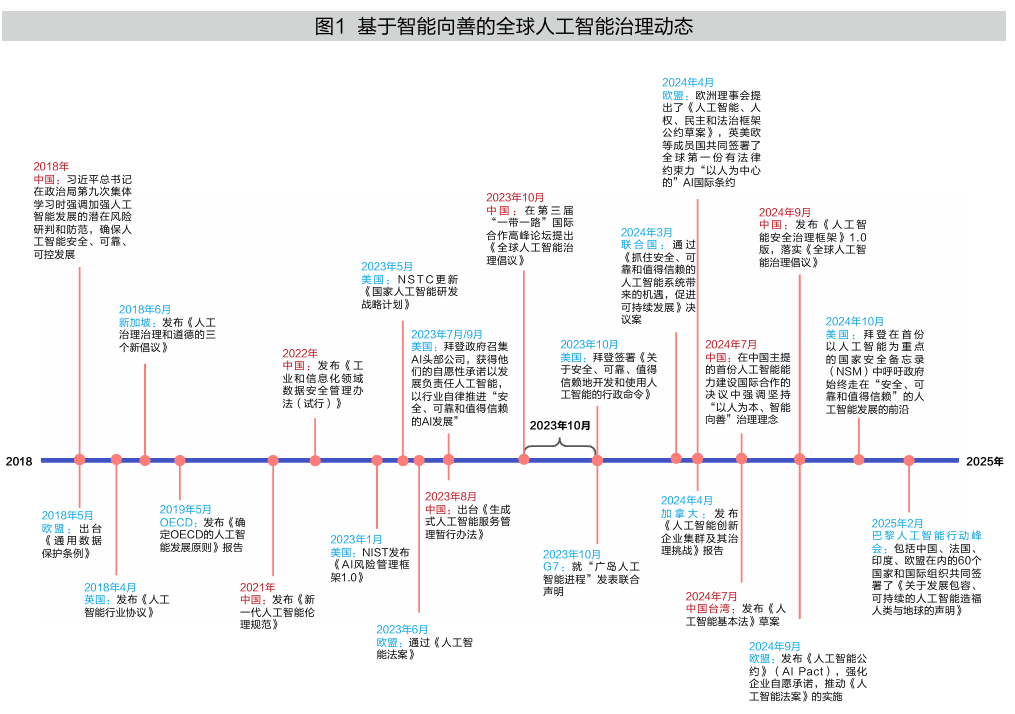

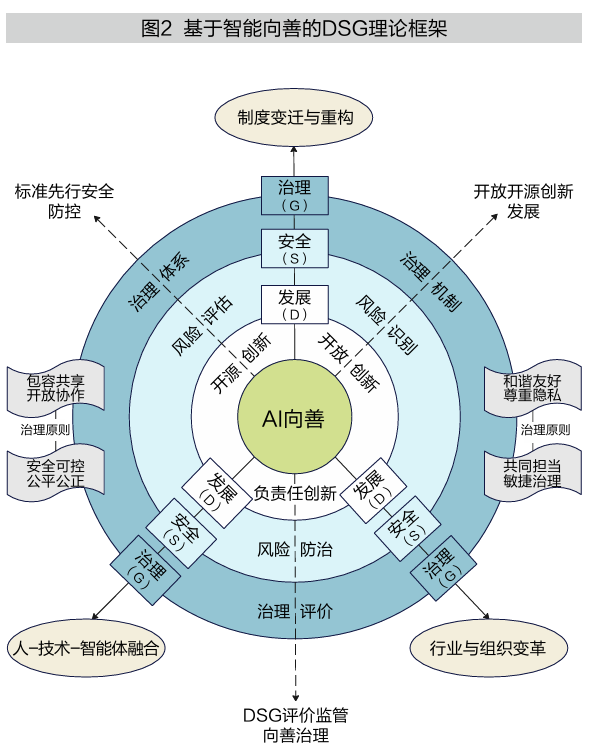

近年来,中国积极投身全球人工智能治理体系构建。2023年《全球人工智能治理倡议》、2024年《加强人工智能能力建设国际合作决议》均提出“以人为本、智能向善”构建人工智能发展、安全与治理的中国方案。2025年人工智能行动巴黎峰会聚焦如何让人工智能造福人类实现智能向善,强调亟需建立一个包容而高效的人工智能国际治理框架。但是,伴随着技术权力扩张与社会控制能力失衡引发的技术控制困境,人工智能发展与安全治理出现规范滞后性和治理碎片化等问题,导致人智信任危机、组织变革冲击、制度竞争失序等系统风险加剧。统筹人工智能发展与安全已成为全球亟待解决的重要议题。为回答“智能何以向善”的问题,本文基于人-技术-智能体融合、行业与组织变革、制度变迁与重构等多维视角,系统构建统筹人工智能发展(Development)、安全(Security)、治理(Governance)的“DSG”治理框架,提出“以开源开放塑生态、以标准先行控风险、以评价监管促向善”的三位一体协同联动推进路径,为构建人工智能发展与安全的全球治理新标准和新秩序提供中国方案。

统筹人工智能发展与安全的治理趋势与挑战

基于智能向善的全球人工智能治理动态

传统意义上的人工智能向善(AI for Good)泛指通过技术设计、开发、应用和管理等环节,确保人工智能技术服务于社会公共利益,遵循道德和法律规范,提升人类福祉。中国治理语境下,对人工智能向善的解读逐渐从技术本身的道德合法性转向人工智能技术对整个社会生态系统的潜在影响,聚焦技术在法律、伦理和人道主义层面的价值取向,专注于促进政府、非政府机构、公民社会和国际组织建立包容、非营利、可扩展的人工智能治理方案。基于智能向善的全球人工智能治理动态(见图1)呈现治理刚性逐步增强的趋势,从以“以人为本”为原则的软性规范和行业自律(2018—2020年),发展到以“合规监管”为规则的硬性法规制和风险防控(2021—2023年),再到以“多元共治”为载体的协同治理升级和生态重构(2024年至今),面向智能向善的评价监管已经成为统筹人工智能发展与安全治理的重要内容。

人-技术-智能体融合发展倒逼治理机制升级

人-技术-智能体融合发展引发安全风险指数级上升,主要呈现四类风险。第一,伦理边界模糊风险。脑机接口、增强智能等人工智能技术模糊了人类与智能体的界限,人机身份重构导致意识上传、记忆修改等伦理边界模糊化风险日益加剧,引发“人类主体性”争议。第二,人机混合责任风险。传统法律框架难以覆盖人机混合责任的风险后果,智能体深度介入医疗诊断、司法量刑等会引发决策权分配冲突,导致责任归属复杂化。第三,数据与生物安全风险。人机融合依赖脑电信号、基因信息等生物数据,生物数据泄露可能引发身份盗用、神经攻击等新型犯罪,进而形成数据与生物安全威胁。第四,系统失控与对抗性风险。智能体自主学习能力增强后,可能会突破预设边界,与人类目标发生利益冲突,甚至通过算法权力扩张介入情绪调控、行为引导等人类生活,个体自主权被技术寡头侵蚀的系统失控与对抗性风险不容忽视。

现有人工智能技术迭代速度远超相关规则制定速度,全球尚未形成针对人-技术-智能体融合的监管框架,治理机制难以应对融合技术的系统性风险。人-技术-智能体融合作为人工智能发展的重要趋势,正在倒逼治理机制升级,亟需通过开源开放重塑人工智能发展生态,将伦理与安全要求嵌入技术研发底层,平衡技术精英与社会大众的治理话语权。

行业与组织变革发展推动治理范式创新

行业与组织变革发展对治理结构和治理生态提出新挑战。人工智能技术驱动层级分明和部门割裂的传统组织结构向分布式团队和数据中台转型,对原有的组织治理结构提出新的要求,需要更便捷的跨部门合作方案,甚至需要企业适应决策权部分让渡给算法系统的“AI原生组织”的新型治理结构。人工智能开源开放创新使算法研发等核心环节从少数头部企业扩散至中小厂商,但是产业链供应链各环节采用异构框架,数据接口及协议兼容性差,数据采集方、算法开发者、应用厂商等产业链供应链各环节对数据所有权和收益分配规则仍存在分歧,跨层级产业链供应链上下游缺乏互操作性标准,缺乏对核心技术的知识产权与标准的协同保护机制,难以形成产业链供应链各环节协同共治的发展生态。

倡导构建“责任式开源开放创新”的产业链供应链协同治理共识,将统筹人工智能的DSG治理框架深度融入产业链供应链各环节,在统一评价监管框架下对人工智能赋能的产业链供应链开展多主体和多层级的协同共治新范式。

制度变迁与迭代驱动治理体系重构

制度变迁与迭代对传统治理体系的刚性结构与路径依赖发起新挑战。制度变迁不仅涉及法律、政策的调整,更包含价值观念、权力结构和利益分配的重塑,多元价值冲突与合法性危机日益凸显。全球化与数字化转型催生隐私至上与数据共享的多元价值观冲突,导致传统治理的一元权威模式难以调和价值分歧,加剧了技术标准等国际制度竞争的失序状态。全球化与本土化治理失衡引发治理合法性争议,国际规则与国内制度难以兼容,主权国家面临创新激励与安全管控的两难平衡。制度变迁迭代深刻影响全球治理体系重构,世界各国政府与国际组织积极投身于人工智能的全球治理博弈,力图争取人工智能治理标准、治理规范和治理准则的竞争话语权。智能向善需要全球共治,积极推动人工智能国际标准互认,采用标准迭代平衡人工智能创新发展与风险管控,积极构建分级治理体系和多元共治框架成为统筹人工智能发展、安全、治理的全球治理共识。

DSG治理框架与评价体系

DSG治理框架内涵和外延

DSG治理框架以人工智能技术与社会系统深度互嵌为基础,以“智能向善”为宗旨,基于包容共享、开放协作、和谐友好、尊重隐私、安全可控、公平公正、共同担当、敏捷治理等原则,面向人-技术-智能体融合、行业与组织变革、制度变迁与重构三大维度,对人工智能的发展和安全治理开展系统评价和动态监管(见图2)。DSG治理框架倡导以负责任创新和开源开放创新范式迭代实现人工智能可靠发展,运用风险识别、风险评估、风险防控助推人工智能安全发展,开展多级评价、多元共治、动态监管实现人工智能可控发展。开源开放创新发展、标准先行安全防控、评价监管向善治理是DSG治理框架统筹人工智能发展与安全治理的三大推进路径。DSG治理框架为破解规则滞后性与治理碎片化提供了新思路,通过“个体-组织-制度”的协同演化,在理论层面将智能向善的伦理主张转化为可操作的评价监管机制,在“技术-市场-社会”的实践层面为“政产学研用”提供统筹人工智能发展与安全的治理体系。DSG治理框架为促进新质生产力与高质量发展、深化现代化产业体系建设、推进国家安全体系与治理能力现代化提供治理方案,助力我国在全球人工智能治理体系中实现从规则接受者向范式引领者的战略转型。

DSG治理评价体系

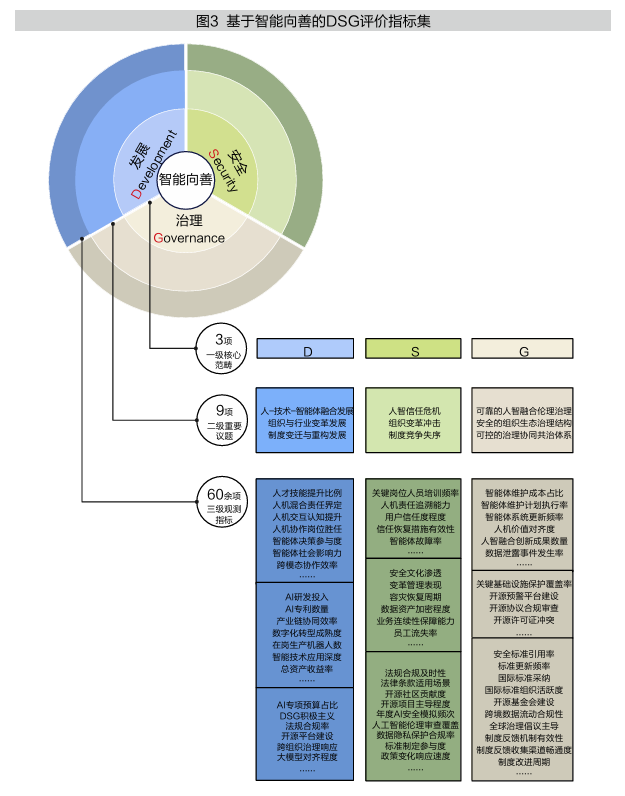

DSG治理评价体系以人工智能全产业链内“政产学研用”多元异质主体为评价对象,以统筹人工智能发展、安全与治理共识为核心,倡导以评价促发展、以监管筑安全的DSG积极主义,遵循客观性、审慎性、前瞻性、主动性等原则确立评价维度和量化指标权重,构建DSG动态评价指标集、评价方法、评价方式,实现智能向善目的和宗旨。

DSG评价指标集

DSG治理评价体系构建了动态评价指标集,具体包括3项一级核心范畴、9项二级重要议题、60余项三级观测指标(见图3)。随着数字技术向人智融合演进,人工智能技术风险呈现非线性爆发特征,治理规则需要不断更新迭代。传统静态指标在快速变化中容易失效,传统环境和社会治理框架在应对技术失控、安全漏洞与治理滞后等系统性风险时显得力不从心。DSG治理评价体系要求主体动态调整防护与合规策略,以动态指标量化人工智能的发展、安全与治理。DSG动态评价指标集并非强制清单,而是通过关注一系列前瞻性观测指标,为企业、产业、政府等主体提供新的治理方向。

DSG评价方法

DSG治理评价体系采用自下而上依次计算的综合评价方法,系统整合多源数据,全面分析受评对象在统筹人工智能发展、安全与治理方面的表现。首先,根据行业异质性在DSG治理评价指标集中弹性选取观测指标。其次,结合专家评分差异化设置各层级各观测指标的权重。再次,动态监测受评对象在观测指标的具体表现。最后,计算观测指标得分并生成DSG综合评价结果。该结果实时反映企业 DSG 表现,引导企业关注潜在风险与机遇,输出适配性强的治理策略建议,推动人工智能向善发展与有效治理。

DSG评价方式

DSG治理评价体系针对受评对象的差异化属性实施DSG评价,主要分为企业自评、政府监管及第三方机构认证三种方式。企业自评通过构建常态化的内省机制,引导市场主体特别是初创型科技企业完成潜在风险自检与伦理决策优化,为智能向善的创新发展提供内生动力。政府监管通过整合产业链多维数据构建安全防控指数,形成覆盖人工智能全产业链条的全景式评价框架,通过标准迭代与政策规制双重路径强化产业安全防控的制度性保障。第三方机构认证通过技术审计工具开展生态系统级评价,将DSG认证标识作为市场信用凭证,提升受评主体的市场辨识度,形成优质技术供应商筛选机制,引导风险投资与供应链资源向高分评价主体定向聚集。DSG受评对象的评价越好,表示受评对象对于人工智能发展、安全与治理的统筹能力越强,最终体现在受评对象组织内部的伦理规范性、市场资源的吸附性和社会价值的外部辐射性上。

DSG评价目的与宗旨

DSG治理评价体系以实现人工智能持续向善为目的与宗旨,通过“开源开放”促进人工智能技术创新生态向善发展,通过“负责任且可评价”的人工智能引导人工智能公司治理体系向善升级,通过“弹性监管指标”推动人工智能产业链供应链韧性向善提升,通过“标准先行”获取全球人工智能向善治理话语权,最终统筹人工智能发展、安全与治理,为回答“智能何以向善”提供兼具理论解释力与实践可行性的中国方案。

发展生态:基于DSG治理框架推进开源开放创新

在人工智能技术加速迭代与全球化竞争深化的背景下,开源开放不仅是技术共享的工具,更是治理升级的载体。开源技术输出与伦理嵌入是企业可持续发展的核心动力,开放生态整合与标准共建是产业融合发展的关键纽带,制度引领与动态监管是政府向善治理的规则锚点。三者基于DSG框架形成闭环,推动人工智能可持续向善发展。

引导开源创新赋能人工智能可持续发展

基于DSG治理框架鼓励企业开源底层算法框架,以开源分布式创新吸引全球开发者参与,降低中小企业技术准入门槛,推动人工智能技术的快速迭代和优化;加强企业开源伦理审查,开发开源人工智能伦理评估工具,在代码库中嵌入伦理检测模块,确保技术应用符合社会责任。引导产业构建跨行业开源联盟,共建开源开放平台,促进生态整合与资源共享;通过建立开源供应链风险管理体系,动态监控开源许可证冲突,避免生态闭源隐患。政府需加强制度支持,加快自主可控开源生态创新发展相关支持政策出台;通过设立专项资金与税收激励加速企业、产业开源步伐。通过企业主导技术输出、产业整合生态、政府制度护航,DSG框架下的开源创新将成为人工智能可持续发展的核心引擎。

深化开放创新促进人工智能融合发展

基于DSG治理框架驱动产业构建协同创新生态,推动产业链上下游企业、高校、科研机构协同,打造“基础研究—技术开发—产业应用”全链条,推动技术互通与资源共享。在纵向协同层面,通过建立联合开放研发基金、知识产权共享协议等机制,跨越高校理论突破到产业落地的“死亡之谷”。在横向标准互通层面,主导制定跨行业人工智能技术标准,推动异构系统互操作性,引导企业加强跨界合作与资源共享,开放技术资源,吸引生态伙伴协作创新。政府需强化政策引领与资金支持,鼓励搭建国家级公共服务开放平台与基础设施,如算力共享平台等,降低中小企业技术接入门槛。通过产业主导生态融合、企业开放协作、政府基础设施支撑,DSG框架下的开放创新将促进人工智能跨域融合发展。

落实负责任创新推动人工智能向善发展

基于DSG治理框架引导政府落实负责任创新,通过制度约束与动态监管确保人工智能技术向善。政府主导建立“负责任人工智能中心”,整合伦理学家、技术工程师、法律顾问及社会学者组成跨学科智库,针对自动驾驶“电车难题”决策逻辑、生成式人工智能内容版权归属等争议场景制定可操作的伦理指南;完善第三方伦理审计制度,引入DSG治理评价体系对金融风控、医疗诊断等高风险人工智能应用实施年度强制审计,对未通过DSG审查认证的企业限制市场准入;设立“负责任创新基金”激励企业合规向善发展;引导企业在开发全流程嵌入伦理审查,成立跨部门伦理委员会,统筹人工智能合规与问责,确保技术决策兼顾商业目标与社会责任;引导产业开展人工智能伦理培训与普及,培养技术开发者的责任意识。通过政府加强监管、企业驻守底线、产业普及教育,DSG框架下的负责任创新将推动人工智能向善发展。

安全防控:基于DSG治理框架倡导标准先行

人工智能呈现出内生安全风险与应用安全风险相互交织的广域安全态势,传统方法已难以有效应对人工智能时代的系统性风险与安全挑战。标准化对人工智能向善发展具有基础性、支撑性、引领性作用,是对新一代人工智能进行安全治理的“先手棋”。标准先行,构建科学合理的人工智能标准化体系,不仅能明确人工智能内生安全风险界限,还能实现人工智能应用安全风险可控,更为抢占全球人工智能安全治理话语权提供了重要战略支撑。

标准合规明确人工智能内生安全风险界限

基于DSG治理框架的人工智能标准合规旨在以统一标准明确认知行为与技术操作的合法性边界,规范模型算法安全、数据安全、系统安全三类人工智能内生安全,引导人工智能朝着符合社会伦理、保障个人隐私和公共安全的方向发展。为统筹推进人工智能安全标准体系建设,各标准化组织、行业协会、产业联盟等应协调配合,率先研制人工智能安全基础共性标准,规范人工智能安全相关术语定义、分类分级、通用要求与参考架构,明确人工智能研发设计目标和行为边界。政府应引导企业加强内部合规文化培养与制度建设,推进人工智能安全团体标准制定,助力产业界研制人工智能安全行业标准,拉齐行业合规水准,有序推进国际标准、国家标准、行业标准、团体标准等全面的人工智能安全标准合规体系建设。

标准评估实现人工智能应用安全风险可控

基于DSG治理框架的标准评估为人工智能发展提供了更为明确的技术规范与发展边界,有助于确保网络域、现实域、认知域、伦理域等人工智能应用安全风险处于可控范围内。根据功能、性能、应用场景,可以由领军组织牵头,联合产业链上下游企业共同研制有关人工智能安全的一系列团体标准,实现多领域、多维度垂直场景应用安全的测试评估。同时,政府应引导人工智能技术开发者、服务提供者或第三方评估机构建立人工智能安全等级测试评估体系。脑机接口等用户交互的技术研发者应在人工智能开发初期开展内部研讨、组织专家评议、与用户沟通交流,切实遵循科技伦理规范,并结合目标市场的法律要求和风险管理,评估人工智能产品和服务能力成熟度。服务提供者应预先评估人工智能产品对使用者的影响,防止对使用者造成伤害,并提高人工智能风险防范意识,建立健全实时风险监控管理。

标准先行建构人工智能总体安全话语体系

基于DSG治理框架的标准先行体现了柔性规则与硬性法律融合的治理理念,为争夺全球人工智能安全标准制定权和治理话语权提供支撑。标准先行作为治理策略,有助于在早期技术开发阶段嵌入伦理价值要求,在中期应用部署阶段推行DSG安全认证制度,在后期处理阶段提供溯源追责路径。政府应支持企事业单位参与ISO、IEC、ITU、IEEE等国际标准化活动,与国外人工智能安全相关组织开展标准化交流与合作,积极参与或主导基于DSG安全认证类国际标准制定和修订工作。科技领军企业应深化标准国际化战略,通过技术输出打造事实标准。行业组织机构应建立开放性平台,为基于DSG安全认证标准的出海提供指导与帮助。我国应把握时机,利用关键重大场合提出深化人工智能安全认证标准的相关倡议,主动加强与各国的交流合作,共享资源,不断提升中国在国际人工智能标准制定中的权威性和影响力,形成标准先行的人工智能国际安全防控与治理的话语体系。

向善治理:基于DSG治理框架加强评价监管

人工智能“长尾风险”持续涌现已然凸显了技术发展与伦理挑战相互交织的多元治理难题。具身智能等新型对象呈现出使现有知识体系和认知方式产生深刻变革的“治理人工智能”和“用人工智能治理” 的双向治理逻辑,由“事后诸葛亮”的传统治理方式向事前防治、多元共治的敏捷治理模式转变已成当务之急。DSG治理评价框架依托智能向善评价体系的多元主体协同机制,通过系统化推进DSG治理框架的迭代优化与全球应用,将DSG动态评价体系转化为可量化、可验证、可推广的我国在人工智能治理领域的先行经验,打造统筹人工智能发展、安全与治理的中国方案,抢占全球人工智能治理话语权。

以多元协同与多级联动构建人工智能治理生态

基于DSG治理框架的智能向善评价体系建构与推进路径遵循“政府牵头-行业协同-社会共治”的多元协同与多级联动模式。政府作为监管主体,运用动态响应与弹性监管机制为DSG评价设立安全红线;企业作为实施主体,通过DSG动态评价加强技术创新与伦理规范融合发展,打造负责任开源开放创新生态;个体作为参与主体,遵守DSG积极主义和伦理原则,主动参与社会监督并反馈技术风险,保障人工智能发展的透明性与公正性;国际组织与第三方认证机构作为DSG推进主体,通过推广DSG安全标准认证体系构建协同共治的多级治理生态。

以DSG积极主义倡导人工智能主动向善治理

DSG 治理框架倡导“DSG 积极主义”推动人工智能向善发展。在正向激励方面,通过设立开源生态成熟度评价,引导资本流向可持续发展领域,促进资源的优化配置与行业的良性进步。在规范引导方面,构建算法偏见修正强制披露制度,同时对相关超标企业实施算力配额管理,并借助供应链责任追溯覆盖率要求,促使全产业链实现安全合规发展。在弹性约束方面,DSG动态适应性体现为三级指标集的弹性阈值设计,技术评价指标随技术进步动态下调,制度评价指标随国际合作深化阶梯式提升,形成“指标定义治理—治理重塑指标”的自演进逻辑,实现治理措施与行业发展的精准匹配与协同共进,以科学、灵活的评价方式引导人工智能在向善之路上行稳致远。

以DSG评价运用抢占人工智能治理话语权

DSG 治理框架从治理理念、评价运用和标准话语权三方面系统推进。在治理理念上,DSG 治理框架将人工智能技术可持续发展考量纳入其中,既能激发人工智能创新活力,又能有效管控潜在风险。在评价运用上,强化政府、企业、科研机构、行业协会、第三方认证机构等在 DSG 评价实施中的分工协作,形成全方位、多层次的监管合力,制定相应激励机制和政策措施鼓励企业积极参与 DSG 评价和监管治理,推动评价结果在市场准入、风险投资、产业布局、国际发展、政策扶持等方面的应用,提高DSG治理框架的影响力和国际认可度。在标准话语权提升上,通过积极参与ISO、IEC、IEEE等国际标准组织技术规则制定,依托“一带一路”数字基建推进DSG安全认证和技术援助机制实现DSG治理框架的“软性输出”,优先将DSG动态评价体系转化为国际技术基础设施的默认配置,推动DSG治理框架在沿线国家的应用,为全球人工智能治理贡献中国智慧和中国方案,抢占人工智能治理话语权。

关于作者 | 王黎萤:浙江工业大学中国中小企业研究院教授;

余佩玲:浙江工业大学管理学院博士研究生;

陈劲:清华大学经济管理学院苹果公司讲席教授、清华大学技术创新研究中心主任;

梁正:清华大学公共管理学院教授、清华大学人工智能国际治理研究院副院长;

蔡灵巷:康奈尔大学工程学院硕士研究生;

文佳:浙江工业大学管理学院博士研究生;

谢雯欣:浙江工业大学管理学院博士研究生。

责任编辑 | 刘永选(liuyx6@sem.tsinghua.edu.cn)

清华大学人工智能国际治理研究院(Institute for AI International Governance, Tsinghua University,THU I-AIIG)是2020年4月由清华大学成立的校级科研机构。依托清华大学在人工智能与国际治理方面的已有积累和跨学科优势,研究院面向人工智能国际治理重大理论问题及政策需求开展研究,致力于提升清华在该领域的全球学术影响力和政策引领作用,为中国积极参与人工智能国际治理提供智力支撑。

新浪微博:@清华大学人工智能国际治理研究院

微信视频号:THU-AIIG

Bilibili:清华大学AIIG

来源 | 本文转载自“清华管理评论”,点击“阅读原文”获取更多内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢