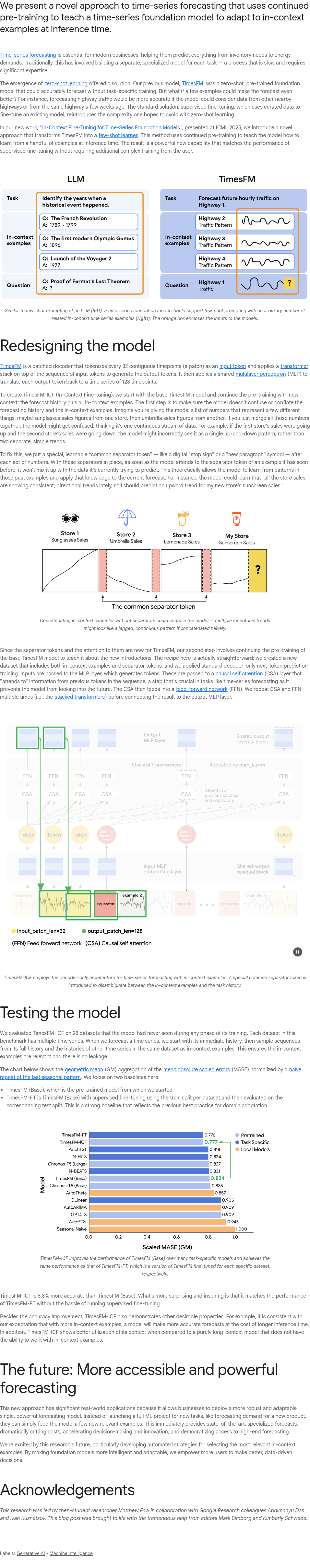

本文提出一种基于持续预训练的时间序列预测新方法,通过让时间序列基础模型在推理时学习上下文示例,实现更优预测。传统方法需为每个任务单独建模,耗时且依赖专家经验。零样本学习为此提供了突破,如先前的TimesFM模型可在无需任务微调的情况下进行准确预测。然而,少量相关示例可进一步提升预测精度,例如利用历史或邻近路段交通数据优化公路流量预测。传统的监督微调虽有效,但依赖大量标注数据。本文方法通过继续预训练,使模型具备在推理阶段根据输入上下文自适应调整的能力,兼顾泛化性与个性化,显著提升零样本场景下的预测性能,尤其适用于数据稀缺或快速部署的实际业务场景。

本专栏通过快照技术转载,仅保留核心内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢