小记:

自23年以来,电商多模态表征模型MOON历时3年的持续建设与升级,在阿里妈妈搜索广告主场景全面落地,以精排CTR预估模型为例,共全量5期,累计带来大盘CTR+20%的显著提升。一、概览

MOON (Multimodal Representation Learning for E-commerce Product Understanding) 是由阿里妈妈搜索广告算法团队自研的面向电商领域商品理解的通用多模态表征。目前已全面应用到手淘搜索广告场景全链路的各个阶段,包括召回、相关性、排序、创意等。其中,在精排点击率预估(CTR)任务上取得的收益尤为显著,自 23 年以来共全量 5 期,累计带来大盘CTR+20%的显著提升,是搜索广告近3年最大可持续优化的提效方向。MOON具备良好的通用性,广泛适用于多项任务,目前已经成为搜索广告系统全链路各模块的标配。

早在22年下半年,基于对当时业界多模态大模型技术飞速发展、GPU算力突破、以及传统以ID特征为中心的CTR建模范式所存在局限性的分析和研判,我们坚信多模态和预估相结合的稀疏稠密大模型是下一代预估模型技术的突破方向,并果断立项投入研发。关于预估为什么要结合多模态,并无明显争议,但两者该怎么结合,当时并无一条成功的参考路径。包括在搜索广告内部,关于图像引入到CTR模型中前后也经历了多轮尝试,并未取得明显的收益。我们总结,过去主流的方案是端到端,多模态模型通常作为简单的图文编码器来提取表征,然后交由CTR模型在内部做复杂的特征交互。这种方式效果不显著的主要原因是稀疏(CTR)和稠密(多模态)模型是两种截然不同的架构,两者在收敛特性、模型结构和空间分布上都有显著的差异,二者的结合更适合走多阶段的路线。具体体现在以下3个方面:

稀疏ID特征分布变化剧烈,而稠密特征分布相对平稳。两者收敛速度不同,点击率预估模型通常训练1轮即可收敛,而CV/NLP模型需要训练多轮才会稳定。

稀疏模型更侧重特征交互,而稠密模型更侧重结构设计。当将稀疏和稠密特征端到端结合时,模型需要同时兼顾特征交互和结构设计,这增加了模型的复杂性和训练难度。

图文内容空间与点击兴趣空间差异大。图文内容特征主要描述商品的视觉和文本信息,如颜色、款式和材质等,而用户点击兴趣受多种因素影响。同样两件外观相似的商品,但用户只对其中一个品牌感兴趣。

基于以上差异,我们对表征应用方式的认知也产生了变化。从原先的端到端,侧重表征应用,到全面转向多阶段,侧重高质量表征生成。经过探索,我们逐步确立了PreTrain-PostTrain-Application三阶段的迭代范式,其中关键是PostTrain阶段图文内容空间到点击兴趣空间的对齐。在多阶段范式下,如何找到有效的任务和中间指标,实现表征和下游目标的对齐是关键。我们发现,以图搜行为数据和对比学习任务为主,可以实现表征与下游目标的有效对齐,其中图搜召回率作为中间指标很有效。除架构差异外,我们坚持多阶段路线的另一个原因是迭代的可持续性。从22年大语言模型兴起,我们就坚信,随着GPU算力和数据的提升,未来多模态模型也会朝着Scaling的方向发展。而多阶段的路线,因为与下游应用解耦,在表征训练阶段可以充分发挥基座模型、数据质量和规模效应的优势。MOON系列能从1期持续迭代到5期,主要也是围绕上述3个方向在持续优化,不断提升表征质量。有了⾼质量表征后,下游CTR模型只需采⽤简单的 Target Attention交互,即可取得显著的效果,这种轻量交互⽅式适⽤于任意模态之间(包括图⽂稠密特征内部及稠密和稀疏 ID 特征之间),且具备良好的 Scaling Up 性质。

在MOON的探索和迭代过程中,我们逐步积累了宝贵的见解和实践经验,因此整理成技术报告的形式与业界分享,期望能给多模态大模型和搜推广相结合的应用方向带来启发。同时,最新基于MLLM生成式架构的表征优化工作也中稿WSDM'26。目前论文已经挂载到arXiv,欢迎阅读和交流。

技术报告:MOON Embedding: Multimodal Representation Learning for E-commerce Search Advertising (https://arxiv.org/abs/2511.11305)

WSDM'26:MOON: Generative MLLM-based Multimodal Representation Learning for E-commerce Product Understanding (https://arxiv.org/abs/2508.11999)

关于为何选择稀疏稠密大模型作为下一代预估模型技术的突破方向,我们始终坚信,预估应当从用户决策本源出发,朝着模型所见与用户所见内容一致的原生多模态预估模型演进,让模型具备视觉感知和认知能力,背后有两点原因:

图文特征具备原生性优势:图文特征是影响用户点击的原生因素,可以突破ID特征的局限。⽤户是否点击本质上是受图⽂内容所吸引,引入图文特征符合第⼀性原理,而ID 特征存在⻓尾和冷启动的固有局限,且存在边际收益递减的问题。

用户存在非结构化兴趣表达:结构化兴趣比如品牌、功能、价格可以通过Query和商品结构化信息表达,也叫文本语言,而非结构化兴趣比如图案、风格、布局只能通过图像来表达,也叫视觉语言。用户不会主动搜索非结构化兴趣,而是暗含在他的行为序列中,因此也引申出下游需要基于行为序列来建模用户多模态视觉偏好。

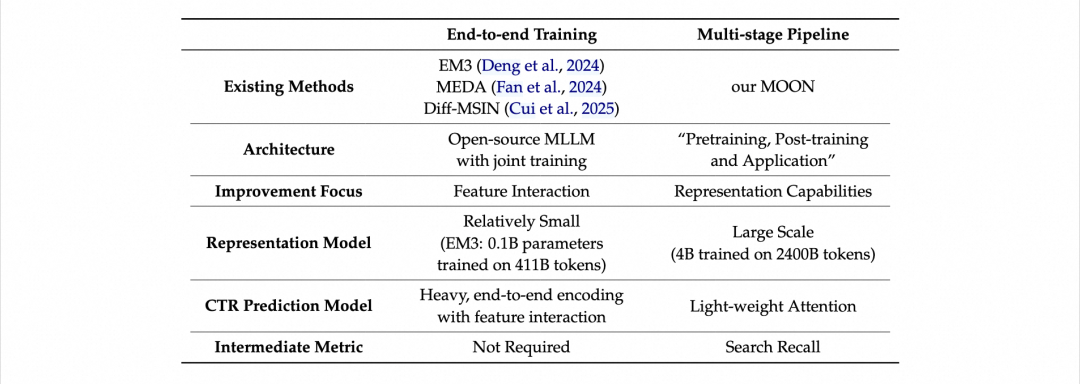

如概览所述,关于多模态和预估模型结合应该走哪种架构路线,并没有一条确定性的参考路径。如下表所示,业界当前的主流方案仍以端到端为主,其特点是侧重特征交互,理论上多模态模型与CTR模型联合训练,能和下游目标完全对齐,但由于稀疏和稠密模型的架构差异,实际无法充分发挥多模态模型的作用,而且CTR模型的计算很重,相应多模态模型的数据和参数规模都比较小,无法充分发挥大模型在Scaling Law方面的优势。相较之下,多阶段路线,由于表征训练与下游应用解耦,在表征训练阶段可以充分发挥基座模型、数据质量和规模效应的优势,MOON从1期扩展到当前5期4B参数×2400B Token的规模,且持续释放 Scaling Law的威⼒,也证明了这⼀架构路线的旺盛⽣命⼒。

相较之下,多阶段路线更侧重表征质量,对表征质量有更高要求。在多阶段范式下,如何找到有效的任务和中间指标,实现表征和下游目标的对齐是关键。同时,解耦模式下,表征模型和CTR模型可以独立迭代,不同阶段模型优化的侧重点不同,在MOON系列的迭代过程中,我们也逐步积累了丰富的实践经验。此外,由于多阶段范式下表征从训练、推理到应用路径更长,对Infra基建也提出了更全面的挑战,包括数据存储、模型训练、表征推理、在线预测等各个环节,都需要建设一套全面、高效、可扩展的多模态Infra架构。

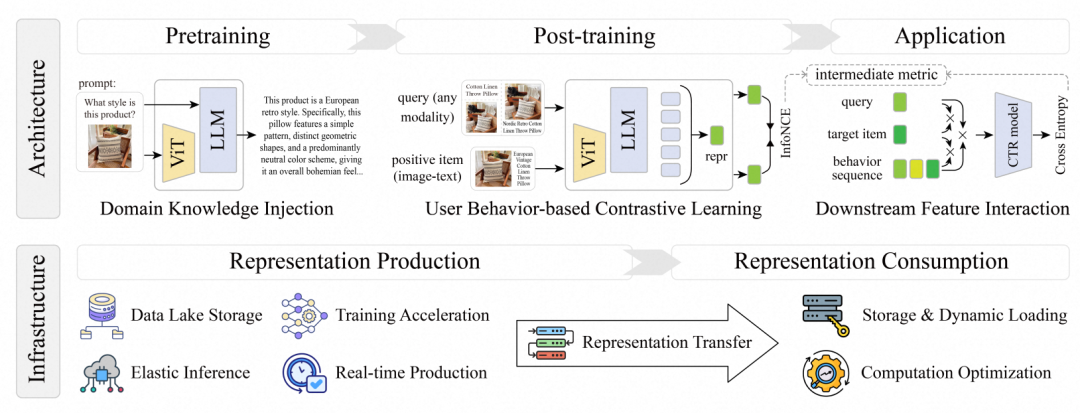

因此,在MOON中我们提出了一整套面向电商多模态商品理解和CTR预估任务的全面可持续优化的解决方案。如下图所示,具体包括:

提出了PreTrain-PostTrain-Application三阶段的多模态预估模型建模新范式,以及图搜召回率作为衡量表征和下游目标对齐程度的核心中间指标。

总结了MOON系列从1期到5期迭代过程中,表征和CTR模型在训练模式、模型结构、数据质量和下游应用四个方向的优化和经验,包括系统性的探究了Scaling Law在多模态表征模型上的规律。

建设了一套全面、高效、可扩展的多模态Infra架构,涵盖了多模态表征从生产到消费的完整周期,解决了其中诸多性能瓶颈,包括存储管理、数据IO、计算效率和实时感知等。

实验表明,MOON不仅在离线中间指标上取得了显著的提升,而且在线AB累计带来大盘CTR+20.0%的提升,同时热力图可视化也显示多模态表征捕捉到了商品的关键属性,图文模态实现了有效的对齐。

如下图所示,过去三年,MOON经历了五次全量迭代,形成了一条明确可持续迭代的路径。显著提升了多模态模型在电商场景下的理解能力和应用价值,构建了预估方向的第二增长曲线。每轮迭代都持续在以下四个方向做优化:

模型架构与训练任务:不断升级基座模型能力,并引入更丰富的训练任务,提升多模态表征理解和对齐能力。

数据构建与处理策略:持续优化高质量数据构建流程,确保样本质量、丰富度和难度不断提升。

模型和数据规模扩展:结合基座模型、数据质量、多模态Infra能力升级,不断扩展训练规模,包括参数规模、Token规模等,发挥多阶段架构在Scaling Law方面的优势。

下游应用场景拓展:升级多模态表征在CTR模型中的应用方式,提升用户视觉偏好建模的准确度和泛化性。

我们提出了面向电商领域商品理解的通用多模态表征MOON Embedding,目前已全面应用到手淘搜索广告场景全链路的各个阶段,包括召回、相关性、排序、创意等。其中,围绕CTR任务,我们提出了PreTrain-PostTrain-Application三阶段解耦的迭代范式,以及图搜召回率作为衡量表征和下游目标对齐程度的核心中间指标。在多模态Infra架构的支持下,MOON已经在CTR预估方向上全量迭代和发布了5期,并取得AB口径累计大盘CTR+20.0%的显著提升,我们总结了过程中积累的宝贵经验和教训并与业界分享,期望能对多模态表征在搜推广系统中的应用带来启发。展望未来,我们将继续探索多模态表征的质量优化以及在更广泛场景中的应用,包括但不限于以下方向:

数据质量和规模效应:挖掘更广泛的场景数据,引入更全面的模态特征(包括视频、音频、ID等),以及基于大模型的样本合成和特征增强,提升多模态表征训练数据的多样性和样本难度。打破Scaling Law在数据质量方面的局限,充分发挥训练Token数、模型参数和负样本规模进一步扩大的效果。

训练模式:通过更丰富的多阶段、多任务设计,提升多模态表征细粒度对齐能力,并结合MOE专家网络、跨模态Attention等网络结构优化,提升模型参数容量,同时解决不同模态联合训练中可能存在的跷跷板问题,提升表征的质量和通用性。

多模态基建:基于RecIS等框架,进一步推进稀疏稠密一体化的架构升级,提升多模态表征稠密模型的训练推理加速比和数据IO吞吐量,以支持10B及以上参数规模模型的全参数微调。同时,下游预估等稀疏模型进一步提高对多模态表征的存储容量和计算效率,以支持用户全生命周期(长度100K+)的视觉偏好建模,进一步提升表征质量优化对于下游模型应用效果提升的置换比。

更广泛的应用:除预估方向外,多模态表征目前也已经广泛应用在搜索广告系统全链路的各个环节,包括召回、相关性、机制、创意等。本文主要介绍了多模态表征跟预估方向的结合,未来该系列会进一步介绍多模态表征和其他方向的结合。

阿里妈妈搜索广告多模态团队负责广告业务中多模态技术的研发和应用,专注于多模态大模型、智能创意、图搜广告、多模态多场景建模等方向。近年在KDD、SIGIR、WSDM等学术会议上发表多篇论文,同时真诚欢迎具备CV、NLP和推荐系统相关背景的同学加入!

📮 简历投递邮箱:wanxian.gwx@taobao.com

也许你还想看

阿里妈妈LMA2新进展:集成大语言模型与电商知识的通用召回大模型URM

淘天集团全面升级AIGX技术体系,AI赋能电商经营所需全部场景

CCF-阿里妈妈科技袋基金第二期正式发布,聚焦多模态智能方向

关注「阿里妈妈技术」,了解更多~

喜欢要“分享”,好看要“点赞”哦ღ~

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢