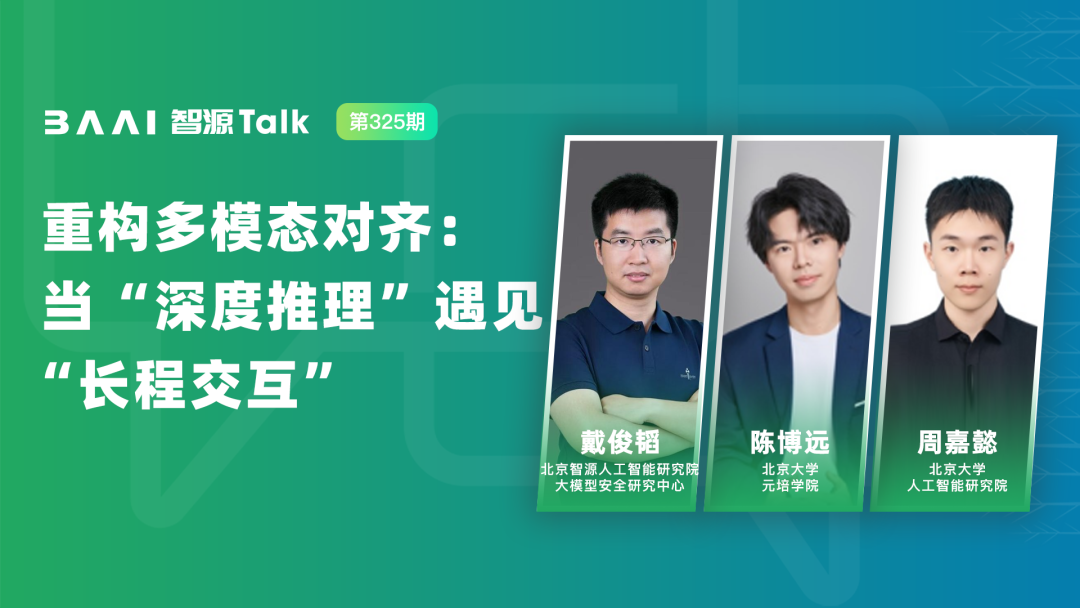

报告主题:重构多模态对齐:当“深度推理”遇见“长程交互”

报告日期:11月28日(周五)10:30-11:30

现有的多模态模型对齐正面临两大痛点:一是奖励模型“只打分不解释”,泛化性差;二是面对真实世界的“多轮图文穿插”交互,模型往往难以维持逻辑连贯性。

本次活动特邀北京大学 PKU Alignment 研究团队的两位成员,为您带来两篇具有范式转移意义的工作解读:

· NeurIPS 2025 Spotlight | InterMT: 它是如何解决多模态对齐“最后一公里”的问题?为何说“教好模型前三步,它就能学会走完后五步”?我们将通过首个多轮图文交错偏好数据集,揭示长程交互中的偏好演化规律。

· NeurIPS 2025 | Generative RLHF-V: 这是一个从“标量回归”向“生成式推理”进化的新框架。研究发现,让奖励模型“像人一样思考和辩论”,不仅能突破传统 RLHF 的天花板,更能利用计算量换取更高质量的对齐效果。

从微观的奖励机制设计,到宏观的长程交互建模,让我们一起探索更懂人类意图的多模态 AI 助手是如何炼成的。

戴俊韬,北京智源人工智能研究院大模型安全研究中心研究员,研究方向是大模型安全与价值对齐。在浙江大学取得博士学位、中国科学技术大学取得学士学位。在计算机领域顶级会议和期刊上发表了二十余篇论文,包括四篇口头/亮点论文,谷歌引用三千余次,获奖包括 ACL 2025最佳论文奖、2025年华为火花奖。

扫码报名

更多热门报告

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢