报告主题:从基建、算法到机理的全栈协同优化ROLL,阿里&上交&港科

报告日期:12月02日(周二)10:30-11:30

本期报告将由淘天集团未来生活实验室算法专家王维埙、阿里巴巴智能引擎团队熊绍潘、香港科技大学刘嘉顺、上海交通大学陆晗和上海交通大学郦洋5人进行分享。

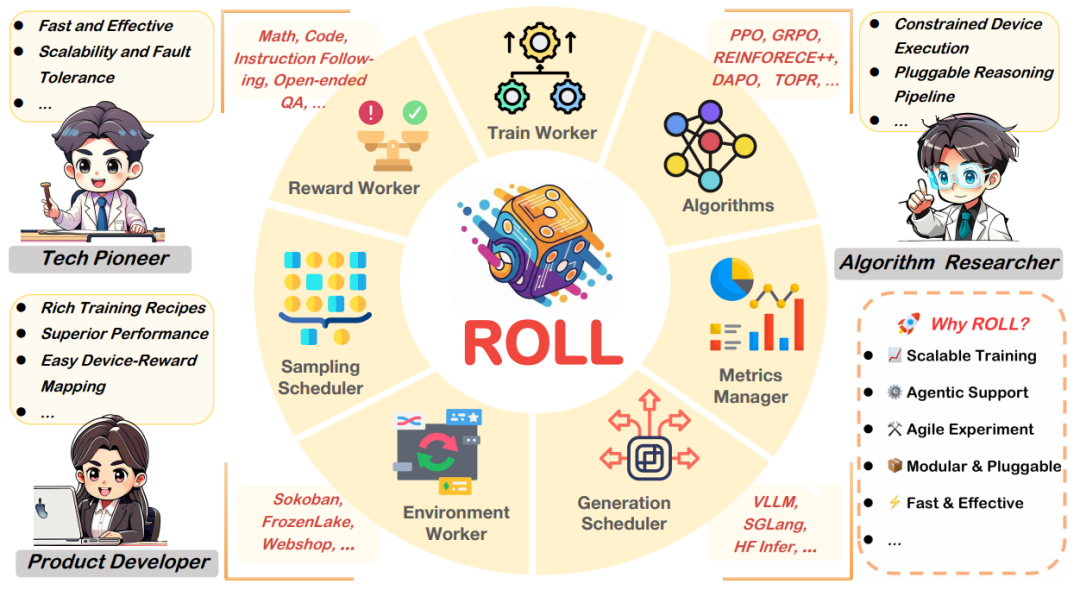

ROLL是阿里巴巴自研的开源强化学习框架,ROLL 团队联合上海交通大学、香港科技大学推出「3A」协同优化框架 ——Async 架构、Asymmetric PPO 与 Attention 机制。

1、ROLL Flash 将生成、环境交互、奖励计算与模型训练流水线化,实现全链路异步执行,同时采用「异步比」机制、集成主流 Off-policy 算法等,使异步训练效果与同步训练相媲美;

2、算法架构层面,AsyPPO 首次系统论证了评论家的参数规模与其价值估计能力并无必然关联,仅需两个小型评论家,即可显著降低计算资源消耗,同时提升推理性能与训练鲁棒性。

3、团队创新性地对 Attention 进行重新定义,设计了一种推理结构感知的动态奖励分配机制,使强化学习的优化目标与模型内生的推理节奏精准对齐,显著提升了训练效率与策略可解释性。

「3A」深度耦合,致力于推动“强化学习用于大语言模型”(RL4LLM)迈向高效、精细与可解释的新范式。

最后,团队最新开源了强化学习环境开发框架 ROCK(Reinforcement Open Construction Kit),与ROLL深度联动,一起推动 LLM 强化学习走向更广阔的实用化与规模化未来!

论文截图

熊绍潘,阿里巴巴智能引擎团队大模型强化学习框架工程师,研究兴趣为:大模型后训练、强化学习训练框架的工程实现与性能优化。ROLL核心成员,旨在为大模型提供稳定、易用的强化学习训练基础设施。

刘嘉顺,香港科技大学博士一年级, 主要研究方向为深度强化学习及其在大规模语言模型上的应用。以第一作者身份在ICML,ICLR,NeurIPS等机器学习顶会顶刊发表论文8篇。大语言模型后训练相关的工作被机器之心等知名媒体多次报道。

陆晗,本科毕业于上交acm班,现为计算机学院博士生,加入吴文俊人工智能班。研究兴趣包括组合优化、主动学习和大模型后训练。曾在TPAMI、NeurIPS、ICLR等期刊会议上发表一作/共一论文5篇,并担任过NeurIPS、ICLR和ICML的审稿人。

郦洋,上海交通大学人工智能学院博士生,研究方向为生成式模型和组合优化。目前第一作者/共同第一作者发表相关论文11篇,包含CCF/CAAI A类顶级会议论文9篇,共发表A类论文19篇,包括机器学习三大顶会NeurIPS、ICML、ICLR论文16篇,曾获NeurIPS和ICML的Spotlight论文(前5%)。主导机器学习求解离散优化多项开源项目,开源社区获超三千星。曾获本科生、研究生国家奖学金、上海市优秀毕业生、华为奖学金、鹰角奖学金等荣誉。

扫码报名

更多热门报告

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢