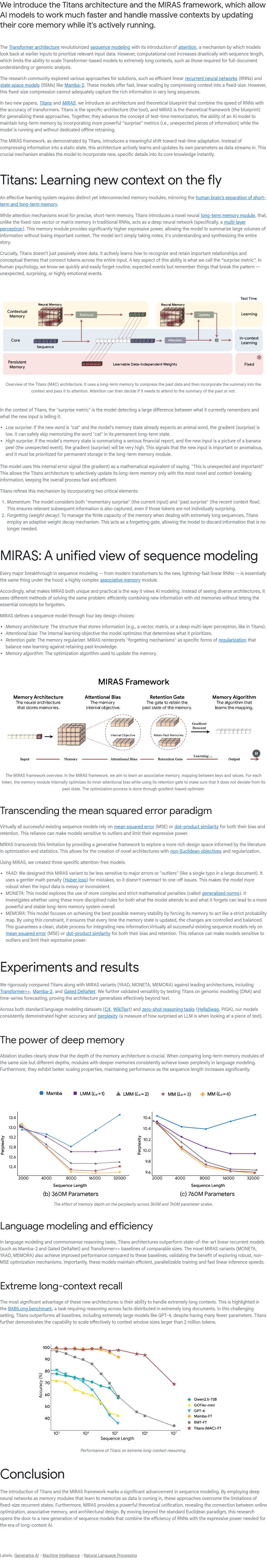

Titans架构与MIRAS框架通过在模型运行时动态更新核心内存,显著提升AI模型处理超长上下文的效率。传统Transformer依赖注意力机制,但计算成本随序列增长急剧上升,难以扩展至极长上下文。现有方案如线性RNN和Mamba-2等状态空间模型虽实现线性扩展,但因采用固定大小压缩上下文,无法充分保留长序列中的丰富信息。两项新研究提出Titan架构,结合动态内存更新机制,在保持高效运算的同时支持超大规模上下文处理,突破当前模型在文档级理解与基因组分析等任务中的局限,为下一代长上下文AI系统提供新路径。

本专栏通过快照技术转载,仅保留核心内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢