点击蓝字

关注我们

2025年12月11日,《自然》(Nature)杂志社发表题为《世界应积极参与中国推动的人工智能治理进程》(The world should engage with China’s AI-regulation push)社论,聚焦全球人工智能(AI)技术的发展现状、潜在风险以及各国在AI监管方面的差异化路径。这篇社论特别关注了中国提出的全球人工智能合作组织(WAICO)倡议,呼吁各国摒弃将AI视为地缘政治竞赛的思维,转而通过国际合作来确保AI技术在推动科学进步和经济增长的同时,能够有效管控其带来的风险。

在全球AI治理面临领导力真空的背景下,如何在加速创新与防范风险之间找到平衡,已成为各国共同面临的紧迫挑战。

人工智能在过去几年取得了惊人进展,展现出加速科学研究和促进经济增长的巨大潜力。AI技术在自然语言处理、计算机视觉、自动化控制和预测分析等领域的突破,不仅推动了商业模式创新,也为科学研究提供了强大工具。在医疗、金融、交通、教育等关键领域,AI的应用日益深入,为解决复杂问题开辟了新路径。

然而,AI技术的快速发展也伴随着严峻挑战。AI模型虽然能力强大,但并未完全理解世界,可能以不可预测的方式失效。当前AI系统面临的问题包括:加剧社会不平等、助长犯罪活动、传播错误信息和虚假信息等。一些知名研究者甚至警告,超级智能AI未来可能对人类构成生存威胁。

更为严峻的是,在快速推进AI发展的竞赛中,这些风险并未得到应有的重视。许多人担心,这场竞赛已经形成了一个濒临破裂的经济泡沫。全球范围内,虽然不乏国际对话、白皮书和咨询建议,但在将这些转化为全球共识的规则、以最大化AI收益并最小化其危害方面,一直存在领导力真空。

现有的全球AI监管努力——例如经济合作与发展组织(OECD)的AI原则和欧洲理事会的AI框架公约——要么不具约束力,要么缺乏执行机制。单个国家的法规往往难以应对AI技术的跨国界流动和应用所带来的全球性问题。

美国:自我监管与政策碎片化

美国是许多最强大、应用最广泛AI模型的诞生地,但在国家层面缺乏统一的AI监管法规,仅有各州层面的零散法律。美国的AI治理主要依赖企业自我监管和内部防护机制,同时企业之间又处于激烈竞争之中。

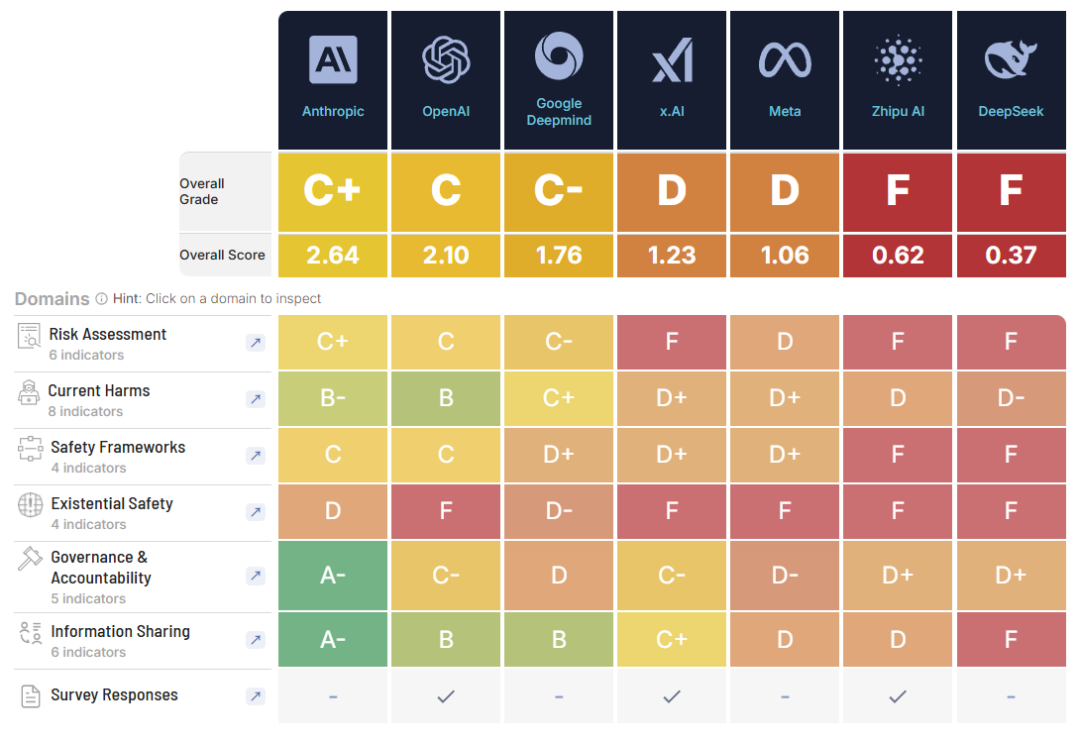

美国加州坎贝尔的生命未来研究所(Future of Life Institute)于2025年12月3日发布的AI安全指数显示,在A到F的评分标准中,没有一家美国公司的安全与风险政策得分高于C+。这表明,尽管美国公司在技术上领先,但在安全治理方面存在明显不足。

2025年11月,特朗普总统启动了名为"创世纪任务"(Genesis Mission)的计划,为开发AI模型的企业和研究人员提供前所未有的政府数据集访问权限。政府将这一计划比作登月的阿波罗计划。然而,这一雄心勃勃的举措也引发了关于数据隐私、安全性以及如何在推动创新的同时加强监管的广泛讨论。

欧盟:立法先行的监管模式

欧盟在AI监管方面采取了更为积极的立法路径。2024年通过的《人工智能法案》(AI Act)要求最强大的先进AI系统制造商加强对其模型所构成威胁的分析。该法案正在分阶段实施,对高风险AI应用要求进行系统性风险评估,并确保其透明度和公平性。

欧盟试图通过法律框架来规范AI技术应用,防止技术滥用,并确保人工智能符合伦理标准。然而,该法案的实际效果尚不明朗,特别是在大额罚款威慑下的企业合规表现。据媒体报道,一些企业正在对欧盟施压,要求放松监管要求。此外,由于AI技术的快速演进,现有法律框架可能难以跟上技术发展的步伐,如何在法律框架内灵活应对新兴的AI风险,成为欧盟监管面临的持续挑战。

中国:积极监管与技术标准化

中国开辟了自己独特的治理路径。中国政府在大力推动AI技术在社会各领域的应用——从地方政府聊天机器人到能够加速生产的工厂机器人——的同时,监管机构也在积极推动AI输出的可追溯性和企业问责制。

值得注意的是,根据生命未来研究所的评估,中国主要AI公司在AI安全指数上的得分甚至低于西方同行,部分原因在于未能充分应对灾难性误用风险。然而,中国在监管制度建设方面展现出强大的执行力。

自2022年以来,中国推出了一系列法律和技术标准,要求开发者在部署生成式AI模型前向监管机构提交预部署安全评估,并在AI生成的内容中嵌入可见且不可删除的水印,以防范欺诈和虚假信息传播。据北京咨询机构Concordia AI的数据,中国在2025年上半年发布的国家级AI要求数量,相当于此前三年的总和,监管推进明显加速。

南加州大学法律研究员、技术监管专家张安琪(Angela Zhang)指出,中国希望防止AI动摇政治稳定,但仍允许其用于促进经济增长。神经科学家兼AI企业家加里·马库斯(Gary Marcus)在2025年10月伦敦的一次活动中对记者表示,在许多方面,中国的动机与其他国家"非常相似"——"他们不想被机器人消灭。"

中国的免费或低成本"开放权重"模型政策意味着全球各地的企业越来越多地在中国AI基础上构建服务。因此,理解中国的AI标准对所有人都至关重要。同时,中国研究人员参与多边对话,帮助评估何种全球治理既有效又现实,也显得尤为重要。

据《自然》报道,中国正推动建立一个全球性机构来协调AI监管,即全球人工智能合作组织(WAICO)。建立这样一个机构符合所有国家的利益,各国政府应当积极参与。

WAICO的提出代表着填补全球AI治理领导力真空的重要尝试。围绕AI的大量修辞将其框定为地缘政治竞赛,似乎一国的安全取决于技术主导地位。然而,对大多数国家而言,"获胜"并非选项,而AI军备竞赛也无法保证人们更安全或更富裕。

更好的方案是各国共同商定何为安全,以及世界希望如何利用AI。为有效监管AI,需要独特的解决方案。WAICO可以借鉴的一个模式是位于维也纳的国际原子能机构(IAEA)监管核能的方式——各国同意对发展设限,并开放核设施供检查,使各国能够验证其他国家是否遵守体系规则。中国的这一倡议应当受到欢迎,世界各地的研究人员和监管机构都应积极参与。通过促进跨国界、跨领域的合作,全球有望在未来实现更加有效的人工智能治理。

为确保人工智能技术的可持续发展并最大化其带来的益处,未来应采取以下措施:

推动WAICO成为有效的全球治理平台

在人工智能的监管问题上,建立全球性合作和统一治理框架是最为迫切的任务。随着AI技术的跨国界流动和广泛应用,单个国家的法规和政策往往难以应对全球性问题。

WAICO应发展成为促进各国共同制定AI发展伦理规范、技术标准和监管制度的国际平台。这一平台不仅应推动技术共享,还应围绕AI带来的社会伦理问题展开讨论,确保技术进步的同时最大程度降低潜在风险。例如,WAICO可以协调各国在AI数据共享、伦理审查及风险评估等方面的合作,建立全球协作与监督机制。

借鉴国际原子能机构的经验,这一全球性AI治理框架应具备灵活性,能够适应技术的快速变化,同时确保其具有必要的约束力和执行机制,使各国在AI发展过程中不偏离全球共识。这种治理框架能够促进不同国家之间的信任建设,并避免因技术竞争而导致的对抗升级。

完善国内AI立法体系

各国应借鉴彼此在AI立法方面的有益经验。中国可以继续加强立法,完善国内的AI法规体系,特别是在医疗、金融和自动驾驶等高风险领域,确保对AI技术的开发和应用进行全面的安全评估与监管。

具体而言,应对AI技术进行风险分类,建立更加细致的监管制度,对高风险AI系统进行严格的安全性审查,同时确保开发者提供足够的透明度,公开算法和决策过程,增强公众对技术的信任。通过完善法规,既能推动技术创新,又能确保AI技术的社会责任与伦理合规。

建立AI伦理与社会影响评估机制

各国应加快建立专门的AI伦理与社会影响评估机制,确保技术发展不仅促进经济增长,也能保障社会公平与稳定。特别需要强化对AI技术在就业、数据隐私、社会公平等方面潜在影响的评估,确保技术应用的社会可接受性。

这可以通过要求AI企业在技术开发前提交社会影响评估报告,完善相关评估标准,同时加强AI伦理教育,培养更多具备社会责任意识的专业人才来实现,推动全社会共同参与AI技术的伦理讨论与规范建设。

促进国际研究合作与知识共享

中国研究人员应积极参与多边对话,与各国同行共同探讨有效且现实的全球治理方案。理解不同国家的AI标准和政策动机,对于构建包容性的全球治理框架至关重要。

通过开放的学术交流和技术合作,各国可以共同应对AI带来的共同挑战,而非陷入零和博弈的困境。正如《自然》社论所呼吁的,世界应当参与中国的AI监管倡议,通过国际合作来最大化AI的益处并最小化其风险。

人工智能技术的发展正处于关键时刻。全球需要摒弃将AI视为地缘政治竞赛的狭隘思维,转而通过务实的国际合作来应对共同挑战。中国提出的WAICO倡议为全球AI治理提供了重要契机,值得各国政府、研究机构和企业的积极响应。

只有通过建立有效的全球治理框架,平衡创新与安全,我们才能确保AI技术真正造福人类,而非成为新的风险源。这需要所有利益相关方的共同努力和真诚合作。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢