报告主题:NeurIPS 2025 Best Paper|人工蜂群思维:语言模型在开放式任务中的同质化现象及其影响

报告日期:12月23日(周二)10:30-11:30

本期报告将由华盛顿大学姜力炜进行分享。

大型语言模型(LLMs)在生成多样化、具有人类风格的创造性内容方面往往存在困难,这引发了一个重要担忧:在长期反复接触相似模型输出的情况下,人类思维可能逐渐趋于同质化。然而,用于评估语言模型输出多样性的可扩展方法仍然十分有限,尤其是在超越随机数或姓名生成等狭窄任务、或超越对单一模型进行重复采样的情形下。

为填补这一空白,我们提出 Infinity-Chat,一个大规模数据集,包含 26,000 条多样化、真实世界的开放式用户查询。这些查询允许广泛而合理的多种回答,不存在唯一的标准答案。我们进一步提出了首个系统性刻画语言模型开放式提示完整谱系的分类体系,涵盖 6 个一级类别(如创造性内容生成、头脑风暴与构思等),并细分为 17 个二级子类别。

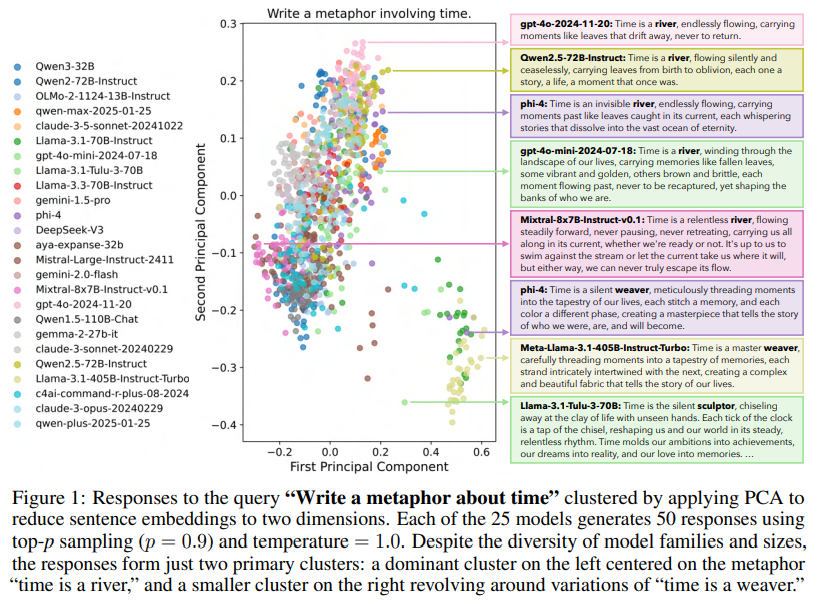

基于 Infinity-Chat,我们开展了一项大规模的语言模型模式坍塌(mode collapse)研究,揭示了在开放式生成场景中显著存在的 “人工蜂群思维(Artificial Hivemind)”效应。该效应主要体现在两个方面:(1)模型内重复性,即同一模型在不同生成中反复产出高度相似的回答;以及更为显著的(2)模型间同质性,即不同模型之间生成的内容高度相似、令人惊讶地趋同。

Infinity-Chat 还包含 31,250 条人工标注数据,涵盖绝对评分与成对偏好判断,每个样本平均由 25 位独立标注者进行评估。这使我们能够系统性地研究人类在开放式问题上的群体偏好与个体特异性偏好。我们的研究发现,尽管当前最先进的语言模型、奖励模型以及 LM 评判器在整体质量上表现相近,但在面对激发出显著个体差异偏好的生成结果时,它们与人类评分之间的校准程度明显不足。

总体而言,Infinity-Chat 是首个用于系统研究语言模型在真实世界开放式查询上的大规模资源,揭示了“人工蜂群思维”所带来的关键现象,并为缓解其潜在的长期 AI 安全风险提供了重要洞见与研究方向。

扫码报名

更多热门报告

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢