报告主题:NeurIPS 2025 Best Paper Runner-up Award|大模型把过多概念挤在有限小空间中导致了规模定律

报告日期:12月25日(周四)10:30-11:30

本期报告将由麻省理工学院刘逸舟进行分享。

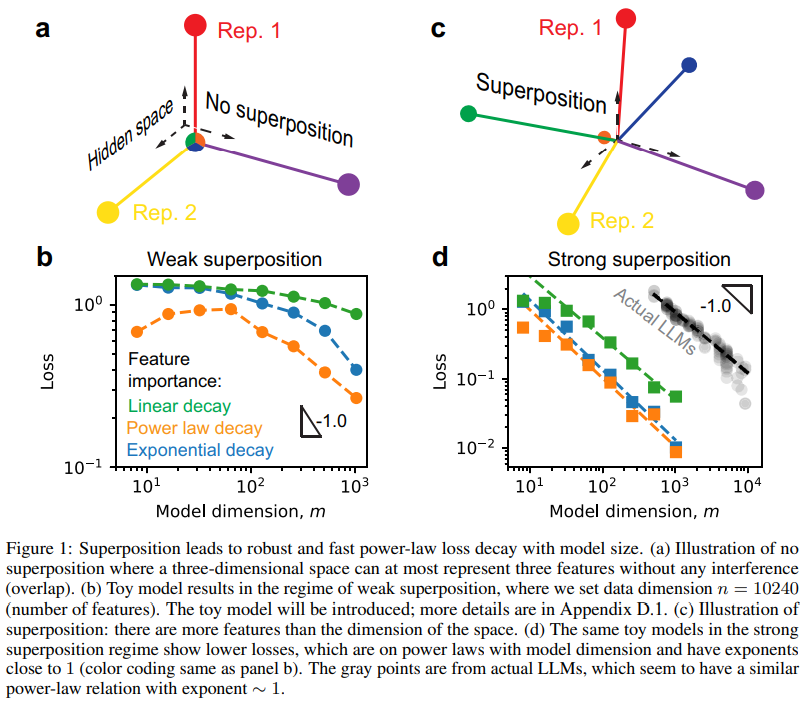

现今大型语言模型(LLMs)的成功依赖于一个经验性观察:模型越大,性能越好。大模型把过多概念挤在有限小空间中导致了规模定律。然而,这种神经规模定律(neural scaling law)——即损失函数随模型规模以幂律形式下降——的起源仍不清楚。我们提出,表征叠加(representation superposition),即LLM在有限的表征维度中表示了多于维度数量的特征,是误差产生并导致神经规模定律的关键。

基于 Anthropic 的表征叠加模型,我们使用权重衰减来控制叠加的程度,从而系统性地研究损失如何随模型规模变化。当叠加较弱时,只有在数据中的特征频率服从幂律分布的情况下,损失才呈现幂律缩放。相反,在强叠加条件下,由于表征向量之间的几何重叠,损失会在一大类特征频率分布下与模型维度成反比。我们验证了开源大模型运行在强叠加机制下,其损失与模型维度成反比缩放。并且 Chinchilla规模定律也与这一行为一致。我们的结果表明表征叠加是神经规模定律的核心驱动因素,并为诸如神经规模定律何时可以改进、何时会失效等问题提供了新的洞见。

扫码报名

更多热门报告

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢