点击蓝字

关注我们

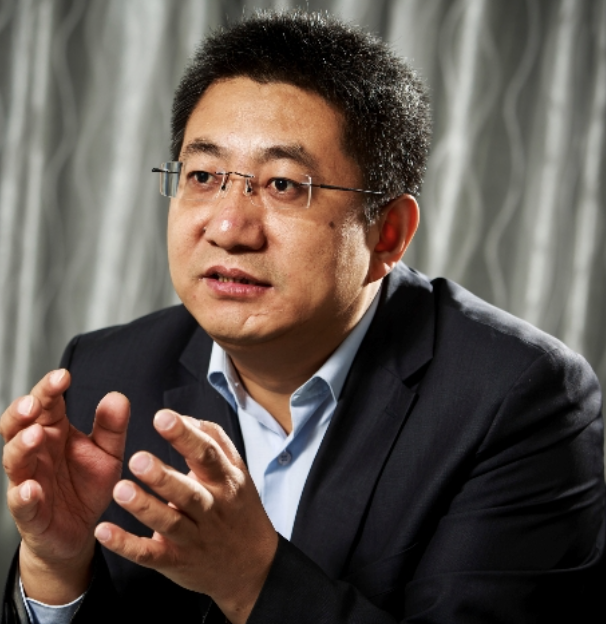

申卫星

清华大学人工智能国际治理研究院人工智能法律法规方向首席专家、中国法学会民法学研究会常务理事、北京市法学会物权法研究会副会长、中国卫生法学会副会长

12月13日,第十届东湖国际法律论坛在武汉举办。清华大学法学院教授、清华大学智能法治研究院院长、人工智能国际治理研究院人工智能法律法规方向首席专家申卫星报告的题目是《我国人工智能立法的价值取向与制度设计》。他指出,在人工智能的应用广泛深入的情况下,人工智能立法提上了日程,但是对于人工智能立不立、何时立、如何立以及立什么法这四个问题都充满争议。对此,申卫星主要分享了三部分内容。

清华大学法学院教授、清华大学智能法治研究院院长申卫星

第一部分关于人工智能的立法的价值取向和定位。

申卫星指出,这一问题和人工智能的制度设计紧密相关。具有明确的人工智能立法定位或价值取向,才能够组织科学的立法体系。在人工智能立法领域,中国不仅强调国家安全,也强调个人权利保障。未来的人工智能立法到底是发展优先还是安全优先,这是人工智能制度设计的一个核心问题。申卫星认为,随着包括人工智能在内的技术不断创新,风险就必然会增大,要破除零风险迷信,应该容忍和包容风险的存在。

第二部分关于中国立法如何对待人工智能。

申卫星指出,首先要树立底线思维,要确保人工智能不影响基本人权和人格尊严,留给人工智能一些发展空间。所以,在协调人工智能的安全和发展之间的关系时,不发展是最大的不安全,停滞发展是最大的风险。人工智能立法立法并不是阻碍技术创新,恰好是让它跑得更快。人工智能立法关键在于,如何科学界定人工智能的定义,从而界定人工智能法的调整范围。

第三部分关于人工智能发展的一些基本原则。

当前,国际社会以优先鼓励创新为基本原则,制度设计也应体现这种理念。合作治理,特别是公众参与,强调AI的安全治理的透明性、公平性以及可控性,而不是达到零风险。申卫星强调,人工智能立法并不只是一个问责机制。并非每个风险都需要通过监管消除,还可以通过企业自律和行业自律来实现这一结果。申卫星提到借鉴欧盟人工智能风险管理分类分级机制的可能性。此外,还要鼓励协同治理和行业自律,通过风险预警、风险预测、风险共享、风险管理来实现风险可控。申卫星最后指出,我们应勇敢拥抱人工智能这一新兴技术。2023年,中国发布人工智能立法倡议,得到国际上的高度认可。未来如何让倡议变成现实,应该推动人工智能立法,为我国人工智能产业和技术发展创造一个良好的环境。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢