点击蓝字

关注我们

张钹

中国科学院院士,俄罗斯自然科学院外籍院士,清华大学教授,清华大学人工智能研究院名誉院长,人工智能国际治理研究院学术委员

CJAI2026

2026 中国司法人工智能大会(CJAI2026)在上海举办,会上,中国科学院院士、清华大学人工智能研究院名誉院长张钹教授作题为《人工智能时代与司法》的报告。

重要观点一:语义的构成源于周围语词的定义,从这个意义看AI已经可以识别语义。

重要观点二:只是增强技术的内置与外挂优势区分:凡是需要“可引用、可质证、可更新”的内容,应外置;凡是体现 “语言能力、推理结构、任务技能”的内容应内化。

重要观点三:司法基础模型的六种范式,从最“最共享”到“最隔离”的延展。

重要观点四:伦理概念存在可计算化的方法,但是可计算不等于全部可量化。

重要观点五:司法人工智能的中的知识增强分为两种,其一是内置参数,其二是外挂知识库。

重要观点六:司法AI的成功,不在于让它多像人,而在于让它如何可靠、透明、可控地辅助人,最终守护司法程序的庄严与正义。

重点问题梳理

一、司法对人工智能的特殊要求

需要更强的合规与治理能力、更可审计的证据链、更严格的可解释与可质证机制,以及对偏见与不确定性的显式控制。

1.结果影响到“权利一自由一财产”,容错率极低

司法结论可能直接影响定罪量刑、羁押与否、人格名誉、财产处分等基本权利的保护。一旦误导决策,损害往往不可逆、救济成本极高。因此对错误类型(误判、漏判、不当建议)与风险上限的控制要求明显高于一般业务系统。

2.司法是“程序系统”,不仅追求正确,还追求“可被程序证明的正确”

司法不仅要“对”(准确率、效率、成本),还要满足程序正义:证据规则、举证责任、质证对抗、裁判理由、回避与中立、公开与救济等。AI结论必须能够被嵌入这些程序节点,并支持当事人质疑、法院审查、上级复核。

3.事实认定依赖证据链,模型输出必须“可回溯、可复核、可质证”

司法需要证据能力与证明力的组合推理:证据来源、合法性、关联性、真实性、证明标准等。AI的检索、摘要、类案推荐、风险提示都必须能回到证据与法律依据,给出引用定位、版本一致性、推理路径或至少“理由结构”,并允许对抗方质证。

4.数据天然“偏、稀、敏感”,且强依赖地域与时间语境

司法数据分布极不均衡:某些罪名、案由、特定群体、特定地区、特定时期样本稀缺;同时包含大量敏感个人信息、未成年人信息、国家秘密/商业秘密等。法律法规和裁判尺度随时间变化显著(新法、司法解释、指导案例、会议纪要),导致模型容易“过时”。因此司法 AI 必须具备更强的数据治理、脱敏与可控更新机制。

5.“解释”不是锦上添花,而是裁判合法性的组成部分

在司法中,理由本身是裁判的一部分:为何采信某证据、为何不采信,法条如何适用,裁量为何如此。AI若参与“建议”层,就必须提供结构化理由与可核验引用;否则只能停留在低风险辅助(格式校对、流程提醒、检索)层。

6.角色与权力结构特殊:法官裁判权不可被技术替代

司法体系强调独立审判与责任归属。AI应定位为“工具与助手”,而非“决策者”。必须设计明确的人机边界:哪些环节可自动化,哪些只能建议,哪些必须人工裁决;并落实“人类最终负责”的制度与技术措施(可中止、可回退、可追责)。

二、人工智能之于司法语义建构

分布式语义从共现中学习意义。J.R.Firth(1957)教授认为,把稀疏的高维共现信息变成致密空间的几何结构=语义关系。”You shall know aword by the company it keeps."

1. 司法模型落地的要求:符号不仅在符号系统内部互相定义,还要能连接到现实中的对象、感知、行动与可验证事实。

2. LLM存在以下缺失指称缺口:词向量只学到“文本角色”,不保证“指向谁/什么”,真值与因果缺口:

3. 共现学的是相关性,不是因果与可检验事实。语用缺口:意义高度依赖语境、意图与规范。

4. 多义与动态语境:静态 embedding难以处理一词多义。

5. 闭环行动缺失:没有感知与行动,就缺少“语义纠错回路”。

小结:语词的意义是由语词的含义决定。数据越多、上下文越长,语词的含义就越接近语义定义,从这个意义看,AI可以理解语义。如维特根斯坦,一旦掌握了语言,你就掌握了世界,语义掌握的意义不言而喻。

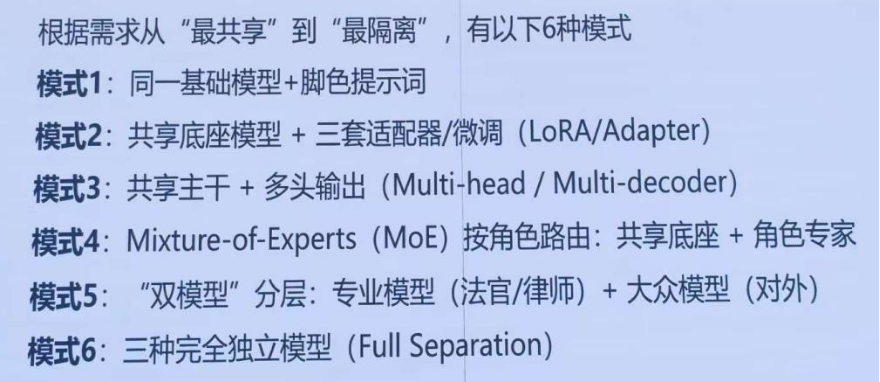

三、面向法官、律师和大众的六种司法基础模型

面向法官、律师和大众的司法基础模型,根据需求从“最共享”到“最隔离”,有以下6种模式:

模式一,所有使用者共用同一基座,属于最共享的模式,具有极大安全隐患,实务中基本不用。

模型六,完全建立三种独立的模型,最隔离,但是成本过高,也无法互通,实务中亦不可采。

共享底座加三套适配器的模式二、内外分离的模型五,是张钹院士比较推荐的类型。

四、司法人工智能中的知识增强路径

现阶段有两种增强模式,其一是内置参数,其二是外挂知识库。

1. 内置参数模式:知识放在模型内部(写进权重)

优点是:其一,速度快,不用每次检索大量文本。其二,表达与推理更顺,模型更懂法律语言、要件结构、论证套路。其三,对噪声更鲁棒,不完全依赖检索质量。

缺点是:其一,不可证明,模型“记住了什么”无法作为可质证依据;很难做到条文级引用、版本可追溯。其二,易过期,法律、解释、规范性文件更新后,模型参数不会自动更新。其三,难治理,一旦发现错误或偏差,修复周期长且影响面大。其四,合规风险,训练数据来源、授权、涉密与隐私控制更难做精细化隔离。

2. 外挂知识库模式:外挂检索(知识库/RAG)

优点是:其一,可追溯、可审计、可回滚:每次回答绑定“引用片段+版本号+生效状态+适用范围”。其二,可及时更新,法规更新只需更新知识库,不必重训模型。其三是,可控权限与分级,不同角色/案件敏感级别可检索不同数据域。其四是,更易合规,数据入库可做授权、脱敏、访问控制、审计留痕。

缺点是:其一,对检索质量敏感:召回不准会影响答案。其二,延迟与工程复杂度,需要索引、过滤、排序、反注入、引用验证等一整套组件。

3.小结:凡是需要“可引用、可质证、可更新”的内容,应外置;凡是体现 “语言能力、推理结构、任务技能”的内容,应内化。

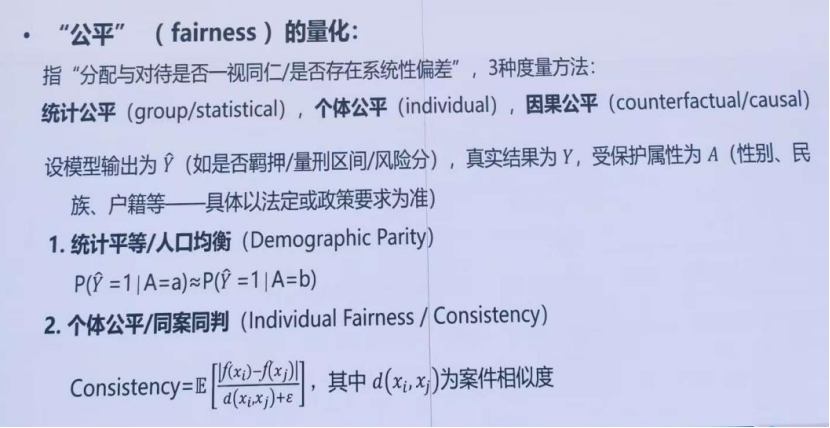

五、伦理抽象概念的量化路径

伦理等抽象概念的量化方法是可计算的约束,但是可计算不等量化。

1.可计算

把抽象概念转成可操作的“原则-规则-约束-证据”,并为每个约束建立证据与审计闭环。先定“公平”的范围与对象:

程序公平:当事人/律师获得同等的陈述与质证机会;系统不因资源差异造成“可达性不公平”。

群体公平:不同群体在系统辅助下不发生系统性不利(差别影响/差别错误率)。

个体公平:相似案件/相似要素应得到相似建议;差异应能被“要素差异”解释。

2. 可量化

“公平”(fairness)的量化:指“分配与对待是否一视同仁/是否存在系统性偏差”,三种度量方法:统计公平,个体公平,因果公平。

司法判断写成“变量+约束”,实现量化结果公平、程序公正、同案同判、比例性、可纠错性等。

六、AI重塑法官与律师的角色

AI不会取代法官和律师,但会深刻改变他们的工作方式

法官成为AI治理者:核心职责从单纯裁判,延伸为审查和监督AI工具的使用。需明确使用边界(如可用AI整理时间线,不可用AI替代心证),并对所有以法官名义产出的内容负最终责任。程序上,可能要求披露AI的使用情况。

律师转向人机协同专家:AI将接管大量重复性检索、起草、审阅工作。律师的核心价值将更集中于策略制定、复杂判断、伦理审查和当事人沟通。职业责任要求律师必须理解AI的风险,并对AI产出的内容进行实质性核验。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢