关键词:具身智能, 3D模仿学习, 物体-动作一致性

导 读

本文是对发表于机器人和自动化领域顶级会议 ICRA 2026 的论文 Imagine2Act: Leveraging Object-Action Motion Consistency from Imagined Goals for Robotic Manipulation 的解读。该论文由北京大学董豪团队主导完成。

该研究聚焦家庭服务机器人高精度操作的核心难题,为插花,放盘,叠杯等关系性物体重排任务提供了全新的解决方案。

论⽂地址:

https://arxiv.org/abs/2509.17125

效果展示:

01

研究背景

关系性物体重排是家庭服务机器人的核心能力之一,典型任务包括“将花插入花瓶”“将盘子放入碗架”“将笔插入笔筒”等。这类任务不仅需要机器人理解“什么物体应该放在哪里”的语义关系,还必须满足精确的几何约束——例如,盘子必须垂直插入碗架的狭窄槽位,存在微小偏差就可能导致任务失败。

当前机器人操作的主流方法存在两大明显瓶颈:

传统 3D 模仿学习方法,虽然能够直接从 RGB-D 观测映射到机器人动作,但它们通常缺乏对物体间复杂几何关系的显式推理能力,只能在隐式空间学习约束,高精度对齐任务中表现极不稳定;

一些方法尝试利用生成模型生成目标状态观测,为策略提供语义几何先验,然而这些方法往往直接将生成的物体变换作为机器人动作执行,或者仅将其作为策略的辅助输入而未建立显式关联。由于生成过程不可避免地存在噪声,直接执行会导致误差累积,而松散关联则无法有效利用几何信息。

于是,我们提出了 Imagine2Act——一个将物体的语义几何约束融入策略学习的 3D 模仿学习框架,旨在增强几何感知能力,并通过想象物体变换信号的引导实现精确的动作预测。

02

核心方法

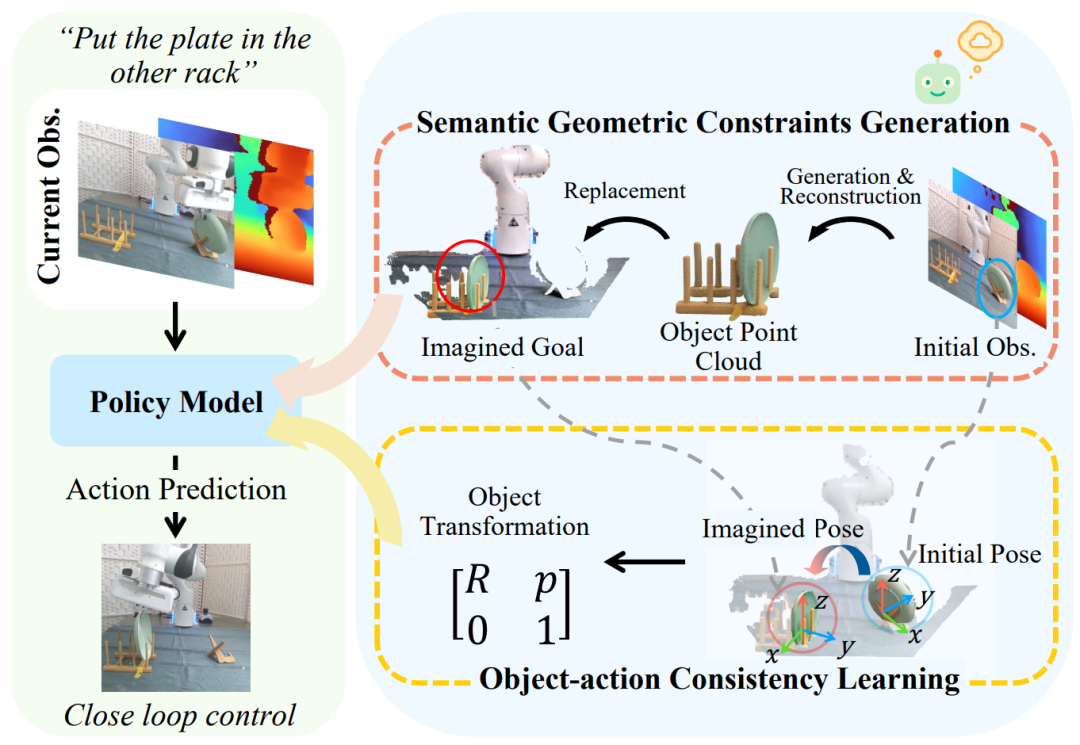

如上图所示,Imagine2Act 的整体架构包含语义几何约束生成模块和物体-动作一致性学习模块两大核心,整个流程包括在机器人执行前生成想象目标,并在训练中通过软监督机制对齐动作与物体变换。

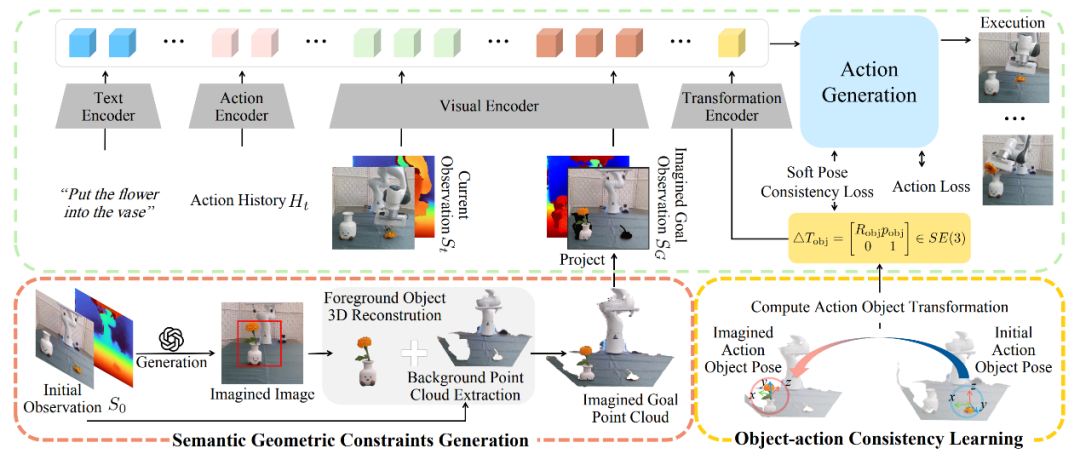

上图为 Imagine2Act 两大核心模块的详细执行流程图。

语义几何约束生成模块:生成与真实场景对齐的想象目标

这个模块的核心是基于人类的语言指令,生成一个与实际场景对齐的、包含正确语义几何关系的目标图像,再将其转化为 3D 点云,为机器人提供高质量的几何先验,如上图左下方所示,整个过程分为三步:

第一步是图像编辑:如上图左下方所示,我们首先使用图像编辑模型(如 GPT-Image),输入初始观测图像与语言指令,生成一幅描绘任务完成场景的图像。生成图像与初始观测保持相同的相机视角,为后续 3D 对齐奠定基础;

第二步是点云重建:为了减少生成噪声,我们确保只修改与任务相关的物体,而保持场景其余部分不变。具体来说,我们通过分割模型(如 Grounded-SAM)从生成图像中分割出前景物体(即运动物体和锚定物体),利用 3D 重建模型(如 TripoSR)为前景物体生成点云。这些点云编码了想象中的几何约束;

第三步是几何对齐:从初始观测中估计锚定物体的 6D 姿态,并将生成的前景点云以该姿态和适当比例变换到世界坐标系中。背景点云则直接从初始观测中提取,保持不变。最终拼接得到的想象目标点云既包含了任务所需的语义布局,又与实际场景在几何上对齐。

有了想象目标点云后,我们对它进行投影以获得相应的想象目标观测的 RGB 图和深度图,进而以对当前观测数据的处理方式来对想象目标观测进行特征提取处理,将其作为模型的额外输入。

物体-动作一致性学习模块:让机器人动作匹配物体变换

如上图右下方所示,通过想象的目标观测,我们可以计算将可移动物体从初始姿态移动到想象目标姿态所需的刚体变换。由于末端执行器是物体运动的直接执行器,其轨迹本质上与物体的变换相似,使两者高度相关。然而,直接将生成物体运动作为末端执行器的作用运动,可能导致生成过程中潜在的误差,导致误差累积。因此我们设计了双重对齐机制:编码变换 token 与软姿态一致性损失。

编码变换 token:通过计算运动物体从初始状态到想象目标状态的刚性变换(旋转矩阵与平移向量),将其编码为一个紧凑的变换 token。该 token 与视觉、语言、历史状态 tokens 一同输入动作生成模块,为动作预测提供明确的物体运动先验;

软姿态一致性损失:设计了一种阈值化的损失函数,仅在预测的末端执行器运动与物体变换之间的偏差超过容忍阈值时才施加惩罚。具体包括计算预测旋转与物体旋转之间的测地距离,以及计算平移的欧几里得距离,使用 Sigmoid 函数实现平滑惩罚,避免硬约束导致的训练不稳定。这一设计既利用了物体变换的强信号引导策略,又通过软监督容忍了生成噪声与小偏差,防止误差在动作序列中累积。

03

实验验证

为了验证 Imagine2Act 的效果,我们在仿真环境 RLBench 和真实世界机器人平台开展了全面实验,测试任务均围绕家庭服务机器人的日常家务操作展开,同时设置了 3D Diffuser Actor、Imagine Policy 等主流基线模型进行对比。

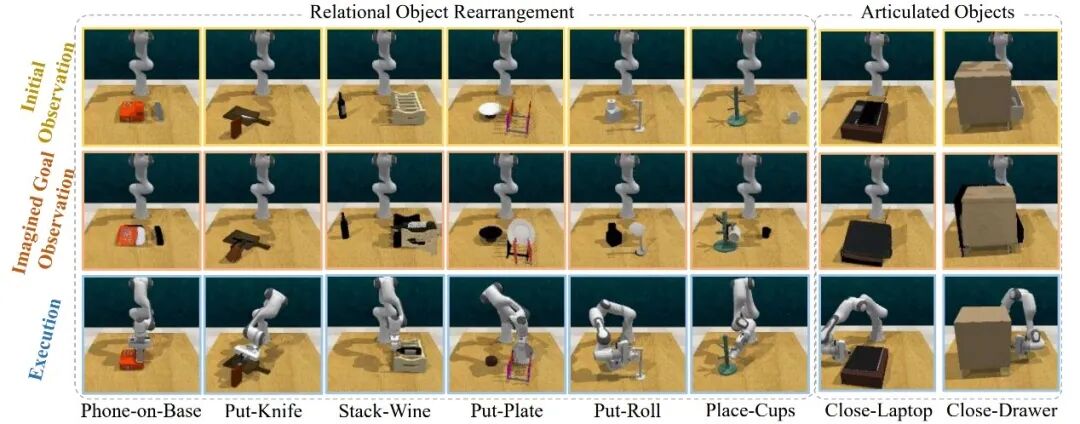

仿真实验:高精度完成家庭物体重排任务

我们在仿真环境 RLBench 与真实世界机器人平台上进行了全面验证,并进行了详细的消融实验。RLBench 仿真实验中,我们选取了 7 个具有挑战性的关系性重排任务,如 Put-Knife、Stack-Wine、Place-Cups 等,每个任务需 100 条演示进行训练,25 次测试评估。对比基线包括基于 3D 场景表示的扩散策略 3D Diffuser Actor、生成目标点云并直接作为动作执行的 Imagine Policy,以及基于语言条件点云 Transformer 的 3D-LOTUS。实验所涉及的任务类型与验证维度如下图所示。

实验结果显示,Imagine2Act 在 7 个任务上的平均成功率达到 0.79,显著优于所有基线模型:相比 3D Diffuser Actor,通过语义几何约束大幅提升了空间推理精度;相比 Imagine Policy,通过物体-动作对齐机制彻底避免了生成噪声的直接传播。

通过系统的消融实验,我们验证了各模块的贡献。完整模型在变换 token、软损失和想象点云都使用的情况下取得了 0.79 的平均成功率。相比之下,当移除想象模块时,性能下降至 0.67,这证明了语义几何先验的有效性。仅使用想象目标生成的配置取得了 0.72 的成功率,与使用真实目标状态的 0.74 接近,说明我们的生成模块能高质量逼近真实目标状态。分别添加变换 token 或软损失都带来了性能提升,且二者结合效果最佳,验证了双重对齐机制的必要性。这些结果表明,想象目标生成、变换 token 输入和软姿态一致性损失共同构成了一个有效的学习框架。

为了进一步测试方法的泛化性,我们还在 RLBench 上额外评估了 5 个铰链物体操作任务,包括关盒子、关抽屉、开微波炉等。Imagine2Act 在这些任务上取得了与 3D Diffuser Actor 相当的性能,证明了其对不同任务类型的适应性。

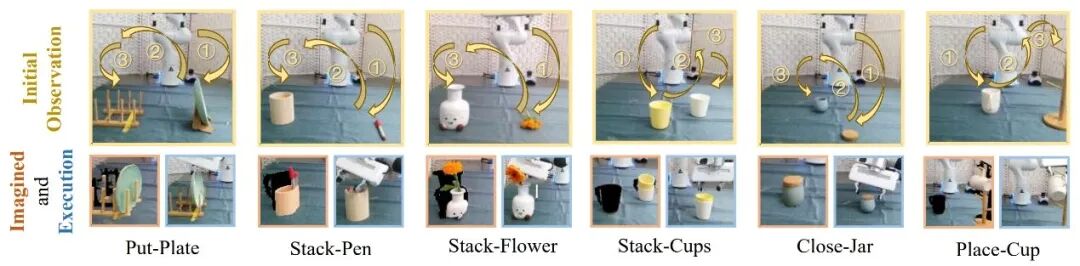

真实世界实验:适配真实家庭的噪声环境

真实世界实验中,如上图所示,我们在 Franka Emika 机器人平台上部署了 Imagine2Act,执行包括叠杯子、关罐子、插花、放盘子等 6 个日常操作任务。

实验结果显示,Imagine2Act 在真实世界的平均成功率达到 0.68,远高于 3D Diffuser Actor 的 0.43,这些结果证明了该框架不仅能解决仿真任务,更能迁移到真实世界的噪声、不确定性环境中,具备实际部署潜力。

04

总结与展望

Imagine2Act 的核心创新,是让家庭服务机器人学会 “先想象、再动手”:通过生成与真实场景对齐的想象目标点云,为机器人提供了丰富的语义几何先验,解决了传统方法缺乏空间推理能力的问题;通过物体-动作一致性学习的双重对齐机制,在利用生成目标信号的同时避免了生成噪声的误差累积,解决了高精度操作的核心难题。

该框架在仿真和真实世界的家庭服务任务中均表现出色,为家庭服务机器人的高精度操作提供了一种可解释、可泛化的解决方案。未来,我们将进一步优化想象目标生成的效率和精度,适配更多样、更复杂的家庭服务场景,让家庭服务机器人能更精准、更智能地完成各类家务,真正走进普通家庭的日常生活。

视频介绍:

团队介绍

实验室由北京大学前沿计算研究中心长聘副教授董豪指导,团队专注于机器人视觉,物体操作,语义导航和具身自主决策等领域的前沿技术,致力于为家用、商用和工业场景创建具有成本效益的人形机器人。

扫码浏览实验室主页

https://zsdonghao.github.io/

图文 | 衡亮

北京大学 董豪实验室

实验室近期科研动态

ICML 2025 | BiAssemble: 双臂机器人几何拼合问题的协同可供性学习

— 版权声明 —

本微信公众号所有内容,由北京大学前沿计算研究中心微信自身创作、收集的文字、图片和音视频资料,版权属北京大学前沿计算研究中心微信所有;从公开渠道收集、整理及授权转载的文字、图片和音视频资料,版权属原作者。本公众号内容原作者如不愿意在本号刊登内容,请及时通知本号,予以删除。

点击“阅读原文”转论文链接

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢