今天,我们发布并开源 Ling-2.5-1T。

深度思考模型(thinking model)拉升智能上限,即时模型(instant model)则凭效率与效果的平衡拓宽智能覆盖,它让 AGI 不只更强,也更普惠。作为百灵家族最新的旗舰级即时模型,Ling-2.5-1T 在模型架构、token 效率、偏好对齐等维度全面升级,期待为用户带来更优质的普惠智能体验。

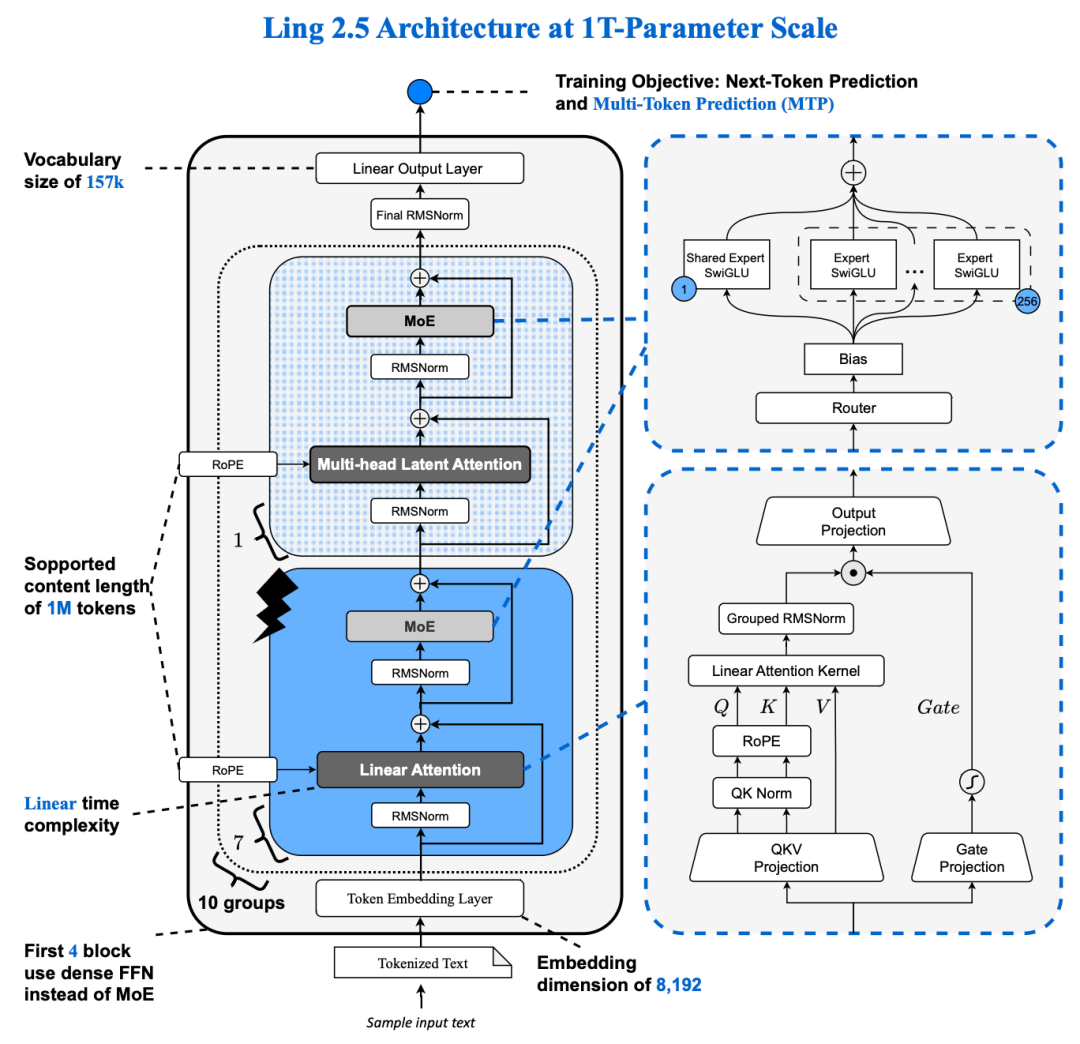

万亿参数与百万上下文:Ling-2.5-1T 具有 1T 总参数(激活 63B),预训练语料从前代的 20T 扩展至 29T,凭借高效的混合线性注意力架构与精细的数据策略优化,模型能够以高吞吐处理长达 1M token 的上下文。

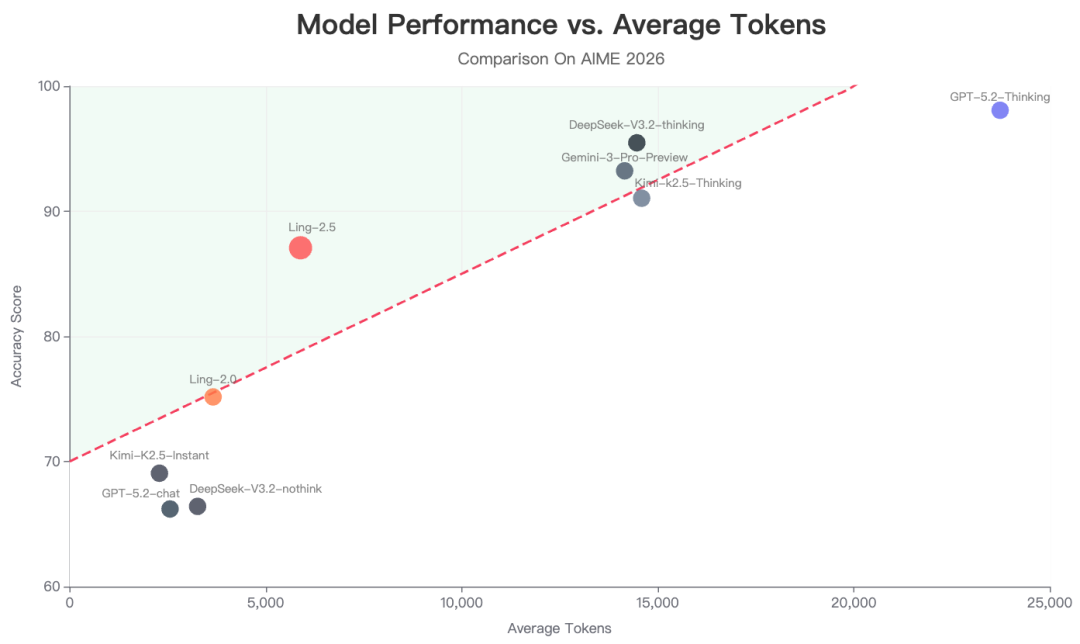

更高的 token 效率:引入“正确性 + 过程冗余”复合奖励机制,进一步拓展了即时模型效率与效果的平衡边界。在相同 token 效率条件下,Ling-2.5-1T 的推理能力显著超越前代,接近需消耗约 4 倍输出 token 的前沿思考模型水平。

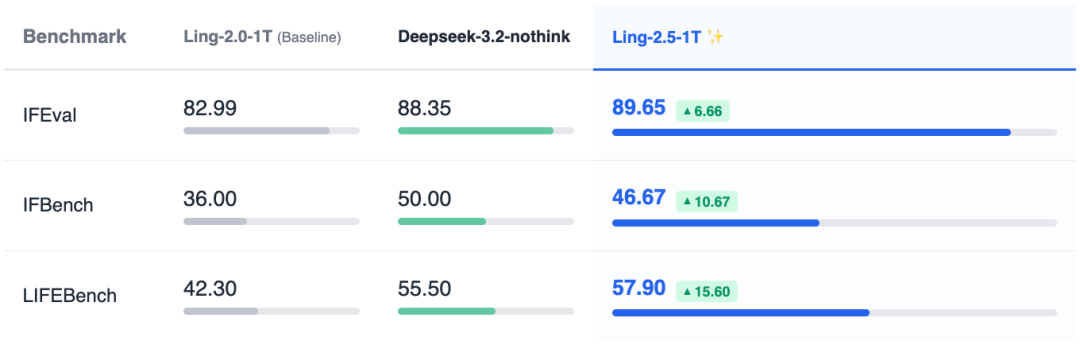

精细化偏好对齐:通过引入双向强化学习反馈、Agent-based 指令约束校验等精细化对齐策略,使 Ling-2.5-1T 在创意写作、指令遵循等偏好对齐类任务上相比前代模型实现大幅提升。

高效的原生智能体交互:基于大规模高保真交互环境进行 Agentic RL 训练,Ling-2.5-1T 可适配 Claude Code、OpenCode、OpenClaw 等主流智能体产品。在通用工具调用基准 BFCL-V4 上达到开源领先水平。

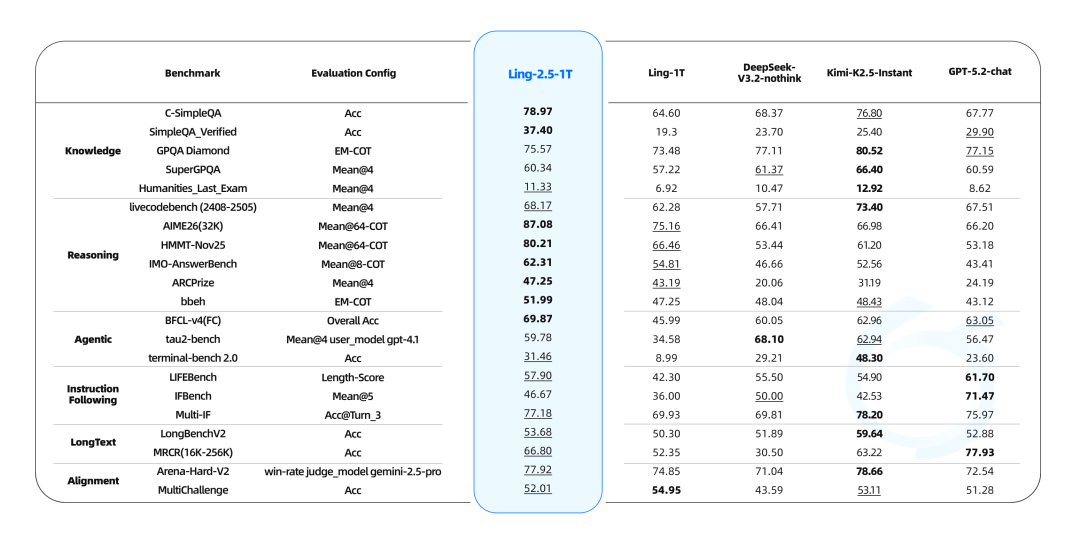

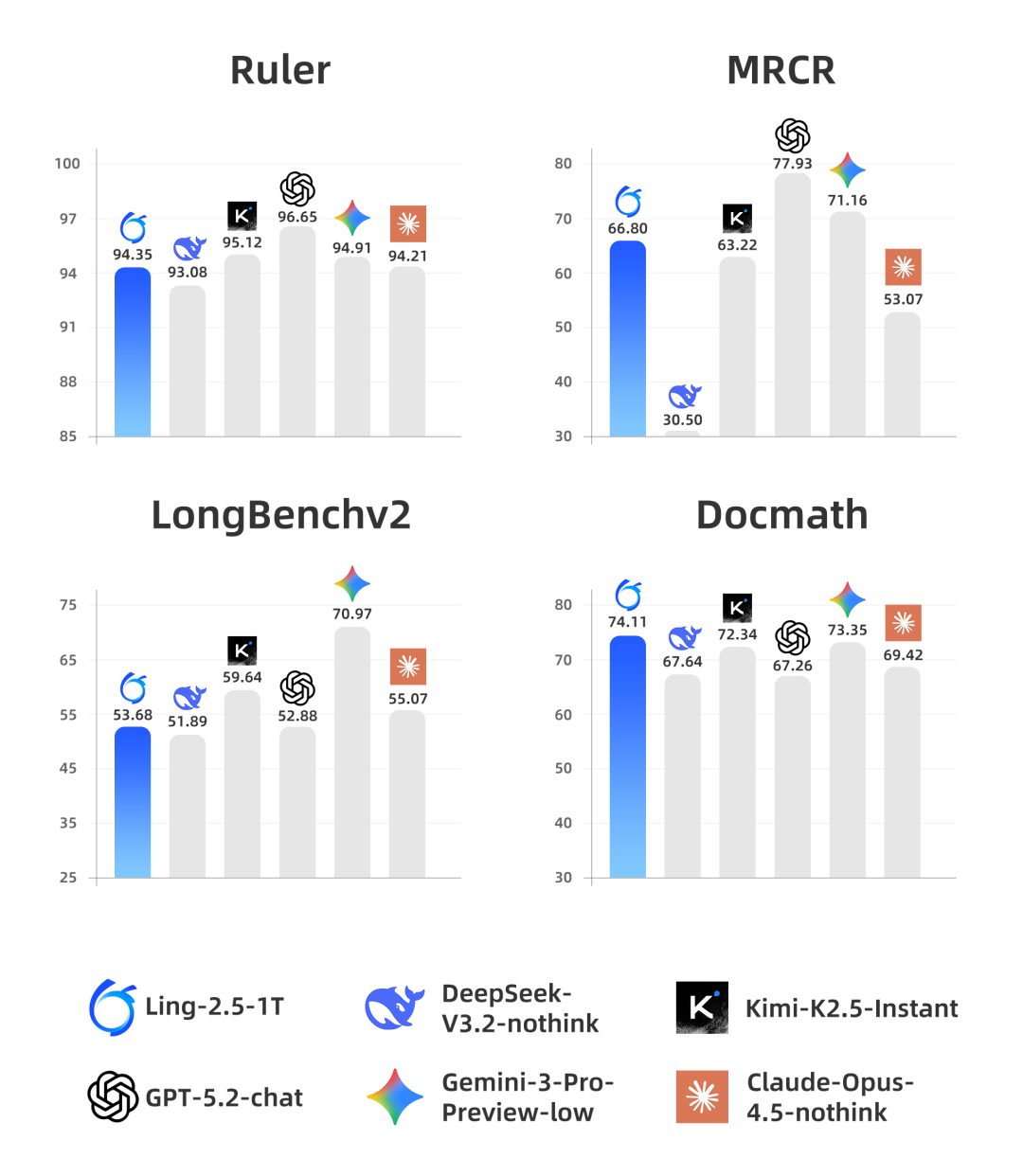

我们全面评估了 Ling-2.5-1T 在知识、推理、智能体交互、指令遵循、长文本处理等多个权威基准评测上的表现。Ling-2.5-1T 与前代模型 Ling-1T 对比,实现了全方位的能力提升,是百灵家族当前最强大的即时模型。在与主流的大尺寸即时模型(DeepSeek V3.2、Kimi K2.5、GPT 5.2)对比中,Ling-2.5-1T 在复杂推理、 指令遵循能力具有明显优势。

高效智能

Ling-2.5-1T 延续了演进式思维链(Evolutionary CoT)的后训练方法,并将强化学习奖励升级为兼顾“正确性”与“过程冗余”的复合指标。在 AIME 2026 这一最新高难数学基准上,它在平均输出约 5890 token 的情况下显著超越前代,逼近平均消耗 15k–23K token 的前沿思考模型。通过“由浅入深”的激活策略,长链条推理被高效折叠为直觉式响应,进一步拓展了即时模型效率与效果的平衡边界。

Ling-2.5-1T 的高效推理能力

拓展了即时模型效率与效果的平衡边界

偏好对齐

针对生成式模型常见的“空洞辞藻”与“机械文风”问题,Ling-2.5-1T 在 RLHF 阶段引入了双向强化学习反馈机制。在惩罚端,联合专家构建细粒度惩罚项,针对逻辑谬误、事实幻觉及机械文风实施精准扣分,确立质量红线;在奖励端,摒弃长度导向,构建基于有效信息增益的奖励模型。在此机制下,模型显著抑制了泛泛而谈的说教倾向,实现高信息密度与逻辑真实性的输出。

另外,Ling-2.5-1T 对指令遵循能力进行了系统性重构。我们构建了 Agent-based 校验机制,针对细粒度约束,编写了由 Rubric(评分规则)与 Code(代码断言)构成的硬性校验奖励。在 IFEval 等指令遵循基准测试中,Ling-2.5-1T 在多重约束下的执行准确率与逻辑一致性显著提升。

智能体交互

Ling-2.5-1T 基于自主研发的大规模高保真交互环境进行 Agentic RL 训练,模型内化了多步规划与工具执行策略。在 Claude Code、OpenCode 等 Agentic Coding 框架适配时,模型的意图理解与操作连贯性显著提升,并在 BFCL-v4、Terminal-Bench 等基准测试中得到了效果验证。

万亿混合线性架构与百万上下文窗口

Ling 2.5 架构在 Ling 2.0 架构基础上引入了混合线性注意力机制。通过增量训练方式,将Ling 2.0架构的 GQA 升级为 1:7 的 MLA + Lightning Linear 结构。具体而言,我们基于此前发布的 Ring-flash-linear-2.0 技术路线,将部分 GQA 层改造为 Lightning Linear Attention,以显著提升长程推理场景下的吞吐能力。为进一步压缩 KV Cache,我们将其余 GQA 层近似转换为 MLA,并对其中的 QK Norm、Partial RoPE 等特性进行了针对性适配,以增强 Ling 2.5 架构在混合注意力架构下的表达能力。

Ling 2.5 架构

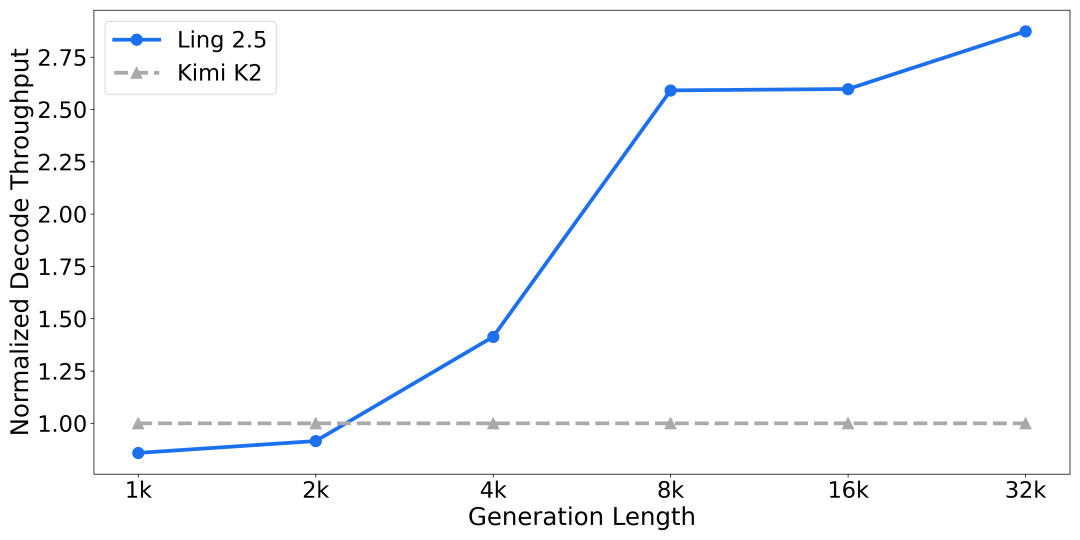

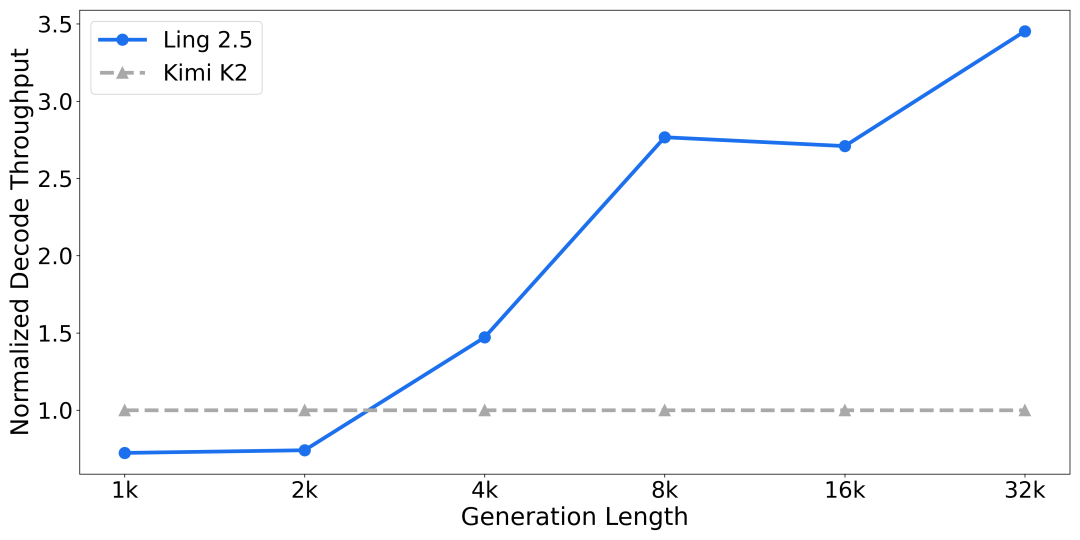

改造后,Ling-2.5-1T 的激活参数量从 51B 提升至 63B。但在混合线性注意力架构的支持下,其推理效率相比 Ling-1T 仍实现了大幅提升。即便与激活参数仅为 32B 的 KIMI K2 架构相比,1T规模下的 Ling 2.5 架构在长程推理场景下的吞吐依然具有显著优势;且生成长度越长,吞吐优势越明显。

单机8卡H20-3e,batch size = 64,

不同生成长度下的解码吞吐(decode throughput)对比

单机8卡H200,batch size = 64,

不同生成长度下的解码吞吐(decode throughput)对比

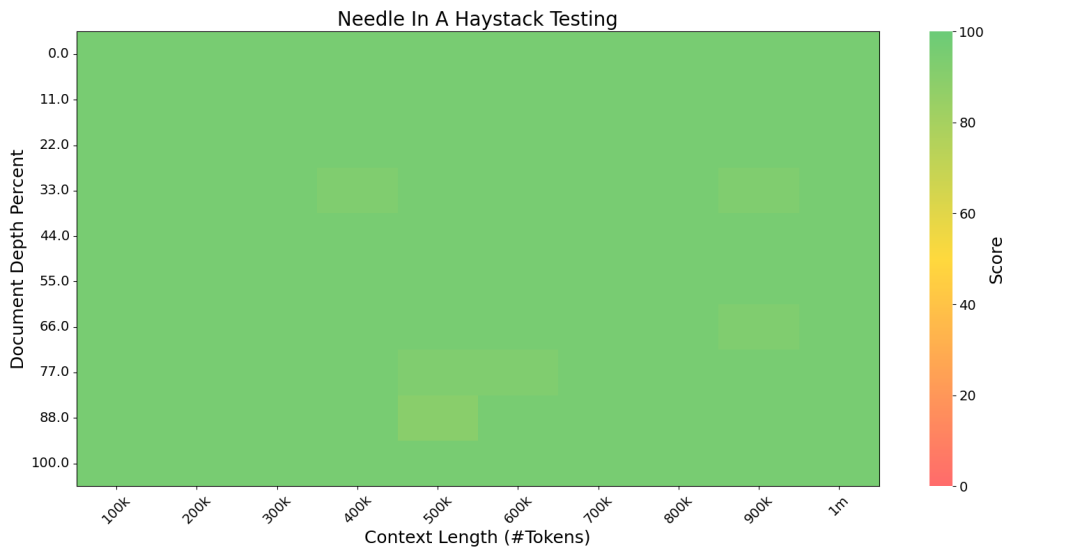

在架构改造之后,我们对 Ling-2.5-1T-base 进行了基于 9T 优质语料的持续预训练,重点强化了预训练基座的世界知识覆盖与智能体交互的基础能力。同时,凭借混合线性注意力架构在长文本处理上的极高计算效率与可扩展性,我们将上下文窗口扩展训练至 256K tokens,并通过 YaRN 外推稳定支持最高 1M tokens 的超长上下文处理能力。

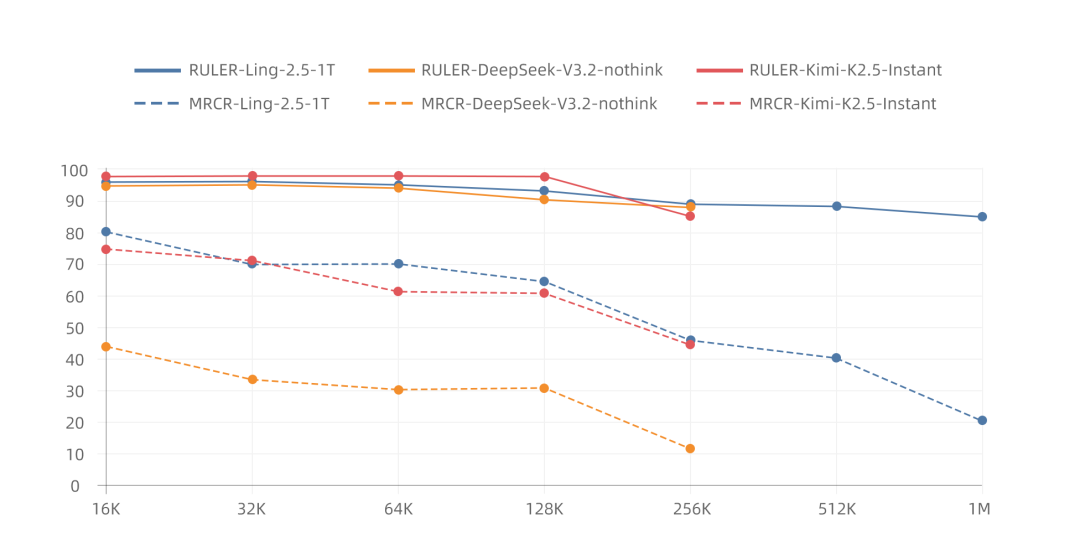

此前,社区对混合线性注意力在超长上下文推理的有效性仍存在一定争议。针对这一问题,我们对 Ling-2.5-1T 开展了系统性的超长上下文基准评测。结果显示,Ling-2.5-1T 在对比采用 MLA 和 DSA 架构的大型即时模型(如 Kimi K2.5、DeepSeek V3.2)时,在多项超长上下文任务中展现出效果优势;同时也可以看到,与领先的闭源 API 模型(如 GPT-5.2、Gemini 3 Pro)相比,仍存在一定差距,后续版本将持续推进相关能力的进一步提升。

Ling-2.5-1T 的大海捞针测试,

在 1M tokens 的上下文窗口内均表现优异

不同模型 16K ~ 1M tokens 上下文窗口

在 RULER 与 MRCR 基准上的对比

长文本基准对比

(Ruler 与 MRCR 为 16K~256K tokens 的平均分)

案例展示

写作

高效获取信息,也能感受到贴心陪伴,收获一份会心一笑的轻松与愉悦。

指令遵循

关于《知识产权质押纠纷》的案例,展示了模型可以在严格遵循10余项关于内容框架、内容细节、格式、字数等指令下,有条理的连续回答若干法律问题。

长文本

Berkeley Lights 公司 2019H2 与 2020H1 财报对比的案例,展示了模型可以对一篇数值密集型的金融财报进行信息抽取汇总,并能对重点财务衍生指标进行复杂计算,并得到财报的深度分析结论。

可视化

PPT

一句话完成PPT演示文稿,自动完成 LLM 原理的内容梳理与 HTML 代码构建。

Prompt: 帮我用 HTML 生成一个介绍 LLM 基本原理的 PPT,画风要有科技感,术语严谨学术性强,16:9 的页面。

翻牌游戏

霓虹发光、阴影、玻璃质感提升沉浸感,动态噪声与慢速渐变动画营造复古未来感。兼具视觉艺术性与现代前端技术的结合。

请设计一个具有蒸汽波(Vaporwave)风格的精美记忆翻牌网页游戏应用,具体要求如下: 1. 核心玩法 标准记忆翻牌玩法 玩家每次翻开两张卡片,若图案一致则消除 直至所有卡片配对完成游戏结束 2. 视觉设计 蒸汽波主题:紫粉渐变背景、霓虹网格、日落元素 主色调:霓虹粉(票房预测(可视化报表)

Ling-2.5-1T 模型内置掌握蚂蚁开源可视化框架 AntV ,我们使用该框架的 G2 报表能力,多维度呈现 2026 年春节档票房预测,包括口碑关联分析、排片资源分布、受众流向等复杂业务场景;视觉上采用毛玻璃拟态化设计,打造春节档专属视觉氛围。

生成一个春节主题的《电影票房数据预测》Dashboard. 要求包含以下内容:\n口碑-票房关联散点(Point Chart):横轴为豆瓣/猫眼评分,纵轴为票房,气泡大小代表排片量。\n多片逐日增长曲线(Multi-line Chart):展示TOP 5影片的日增票房,采用曲线平滑处理,带发光滤镜。\n排片率动态占比(Stacked Rose Chart):南丁格尔玫瑰图,展示24小时内各片排片资源的变化。\n黄金场次渗透率(Bullet Chart):子弹图,展示电影在18:00-21:00黄金档的填充率。\n受众重叠度分析(Venn/Chord Chart):虽G2需转换,可用和弦图展示同时关注两部电影的观众流向。\n票房预测偏差图(Interval Chart):区间柱状图,展示AI预测票房与实际票房的差值。\n\n已知2026年春节贺岁档的电影有这些:《飞驰人生3》《熊出没·年年有熊》《镖人:风起大漠》《惊蛰无声》《星河入梦》《熊猫计划之部落奇遇记》 《重返·狼群》(重映)《消失的我》《夜王》.Code

Flappy Bird

从需求到可执行程序,一条指令完成轻量级应用。 仅用“编写一个可直接运行的清新风 Flappy Bird 游戏”作为需求,接入 Code Agent 即可自主完成从游戏设计、代码实现到安装部署的全过程,交付完整可执行项目,而不仅是代码片段。

Prompt:请你写一个能够直接运行的 Python Flappy Bird 小游戏,游戏画面风格需要是小清新风的。

Agentic 能力

Mini Alipay

从需求到可运行项目,仅需一次会话。在 Code Agent 驱动下,我们仅用一条涵盖前后端架构与新春主题的复杂需求,持续工作 40 分钟,直接产出一个架构完整、功能可用的 MiniAlipay 项目。这不再是代码片段演示,而是一个真正具备完整功能模块、可独立部署运行的生产级应用原型。

Prompt:请你写一个 minialipay,前后端分离架构 + 内存数据库存储,支持基础的用户登录、转账等功能,并且有新春特色的集五福功能,欢庆春节主题。

Opencode 接入(skills)

能够调用正确的 Skills,完整执行内部系统开发指令,Agent 自动化完成从基础架构搭建到多品牌主题逻辑的代码实现,将需求描述直接转化为具备导航、搜索及动态换肤功能的可运行原型。

设计一个完整的内部系统,需满足以下复杂需求:1. 构建一个首页,包含导航、搜索、主题切换用户界面,提供现代化交互体验与可扩展的前端架构。2. 实现多套品牌化主题,允许不同部门使用独立配色与字体,同时保持整体设计的一致性与可维护性,支持动态切换与定制。验证标准:完成一个可演示的最小原型,集成上述多数核心能力,并通过测试验证关键链路的正确性。

Minecraft 机器人任务执行

精准执行空间构建指令,Agent 自动化完成从底层铺设到顶层收缩的数百次方块放置,将自然语言直接转化为游戏内的实体建筑。(使用的 Agent 框架

https://github.com/mindcraft-bots)

用砂岩创建一个长宽高为16*16*8的金字塔,第一层长宽为16*16,第二层为14*14,每叠加一层长宽都减2块,依次叠加

局限性与未来计划

Ling-2.5-1T 已实现高吞吐解码与领先的超长上下文处理能力,并初步具备智能体交互能力,为通用智能体时代奠定基础。但在复杂智能体交互和长程任务上,它仍落后于前沿模型。下一版本将聚焦真实世界复杂任务的长程执行与交付效率优化,同时持续提升 Token 效率,以在效率与效果间取得更优平衡。

欢迎通过以下方式下载、访问和使用 Ling-2.5-1T。

🤗 Hugging Face:

https://huggingface.co/inclusionAI/Ling-2.5-1T

🤖 ModelScope:

https://modelscope.cn/models/inclusionAI/Ling-2.5-1T

Ling Studio(https://ling.tbox.cn/chat) 与 ZenMux(https://zenmux.ai/) 的 Chat 体验页和 API 服务将在近期上线。

本文由 Hugging Face 中文社区内容共建项目提供,稿件由社区成员投稿,经授权发布于 Hugging Face 公众号。文章内容不代表官方立场,文中介绍的产品和服务等均不构成投资建议。了解更多请关注公众号

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢