关键词:空间智能, 导航评测基准, 具身导航

导 读

本文是对发表于机器人和自动化领域顶级会议 ICRA 2026 的论文 NavSpace: How Navigation Agents Follow Spatial Intelligence Instructions 的解读。该研究由北京大学董豪课题组 & 上纬启元团队共同完成。

该研究聚焦让机器人真正理解空间关系的核心难题,系统构建了具身智能领域首个空间智能导航评测基准 NavSpace。通过涵盖六大类超 1200 条动态空间指令的专业“考题”,NavSpace 首次将评估从静态感知推向持续推理,为攻克机器人“听懂方位词却不会动”的技术瓶颈提供了关键标尺。

论⽂地址:

https://arxiv.org/abs/2510.08173

效果展示:

01

研究背景

当前具身智能正朝着通用人工智能的方向快速发展,具身智能提高的关键一步就是构建出能够根据人类指令在环境中移动的导航智能体。近年来,视觉语言导航(VLN)等任务得到了广泛研究,但现有的评估任务主要关注多模态语言和视觉语义的理解,没有系统地评估导航智能体的空间感知和推理能力。

为了全面暴露当前已有的导航模型的空间智能能力,并提供一套科学有效的评估基准,我们制作了 NavSpace,这是具身智能领域第一个基于空间智能的评估基准。基于 NavSpace,我们进行了提高空间智能能力的探索,并且提出 SNav 模型作为 NavSpace 的基线。

02

主要贡献

本文实现三大核心突破:

提出首个空间智能导航基准 NavSpace:

基于问卷调查,NavSpace 包含 1228 个高质量的轨迹-指令对,覆盖垂直感知(Vertical Perception)、精确移动(Precise Movement)、视角转换(Viewpoint Shifting)、空间关系(Spatial Relationship)、环境状态(Environment State)和空间结构(Space Structure)等六种空间智能能力,为评估导航智能体的空间智能提供了全面的基准,填补了具身导航在空间智能理解上缺少基准的短板。

全面评估 22 种导航智能体:

在 NavSpace 基准上,对包括轻量级导航模型、导航大模型、开源多模态大模型和闭源大语言模型在内的 22 种导航智能体进行了综合评估,体现空间智能基准对导航的重要性、多模态大模型在具身导航任务中的局限性、导航大模型相对于轻量级模型的优势以及提升导航智能体空间智能的有希望的方向等关键见解。

提出 SNav 模型:

SNav 是一个空间智能导航大模型,它在 NavSpace 基准和真实机器人测试中的所有类别都超越了现有模型,为未来的研究工作建立了一个强大的基线。

03

核心研究

NavSpace 基准测试构建

我们构建的 NavSpace 基准评测的定义遵循经典的指令导航任务 VLNCE 的设定,即给定 NavSpace 中的语言指令,给定导航智能体当前的第一视角观测,导航智能体需要在时间步 t 内预测下一个导航动作 a。由于设定与 VLNCE 相同,导航智能体一次可以预测的动作包括前进(forward)0.25米,左转(turn left)30度,右转(turn right)30度,停(stop)。如果智能体选择停止,其若与目标的距离低于预定义的阈值则认定为导航成功。

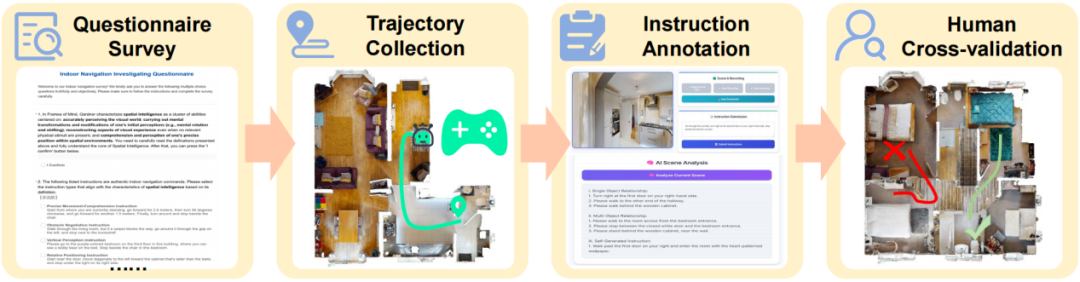

上图即是构建 NavSpace 基准测试的全部过程,整个过程一共分为四步。

第一步是问卷调查:受访者首先需要仔细阅读空间智能的详细定义,并确认自身已完全理解相关定义,随后受访者将看到 17 种可能需要空间智能的候选指令类型,受访者需要在 17 种候选指令类型中选择最多 6 种最符合空间智能定义的而且最符合具身智能需求的类别。最终我们一共收到 512 份问卷,通过完成时间等方式筛选出可靠的问卷得出 6 个最常被选中的类别:垂直感知、精确移动、视角转换、空间关系、环境状态和空间结构。

第二步是轨迹收集:我们基于 Habitat 3.0 模拟器和 HM3D 场景构建了数据收集平台,包括前端标注的网页和后端服务器,后端与模拟器接口并且存储相关数据。标注员登录之后通过键盘操控智能体运动,在第一人称的 RGB 观测下进行导航,在标注者熟悉场景布局后(即至少移动 200 步之后)开始记录轨迹。我们的前端平台会指定应当标注的指令类型,标注者会在熟悉类别后寻找到合适的起点和终点位置,点击“开始记录轨迹”按钮之后开始使用键盘操控智能体进行移动,到达终点之后点击“停止记录轨迹”按钮结束记录。

第三步是指令标注:为了提高标注效率,也为了确保语言的规范性,标注员可以使用 GPT-5 分析收集到的轨迹信息,GPT-5 会接收坐标信息,动作信息和第一人称视角的图片,但是由于 GPT-5 本身也不具备空间智能的能力,其生成的指令是模板状态的,仍然需要标注员依靠自身观测将其补全。

第四步是人工交叉验证:为了确保每条指令可执行,每条指令必须由未见过该指令的标注者再次验证。如果标注者能成功到达目标位置,则指令有效;否则,指令将被丢弃并重新标注。

经过这四步骤,我们构建出 NavSpace,其一共包含 6 类,共 1228 条高质量指令。

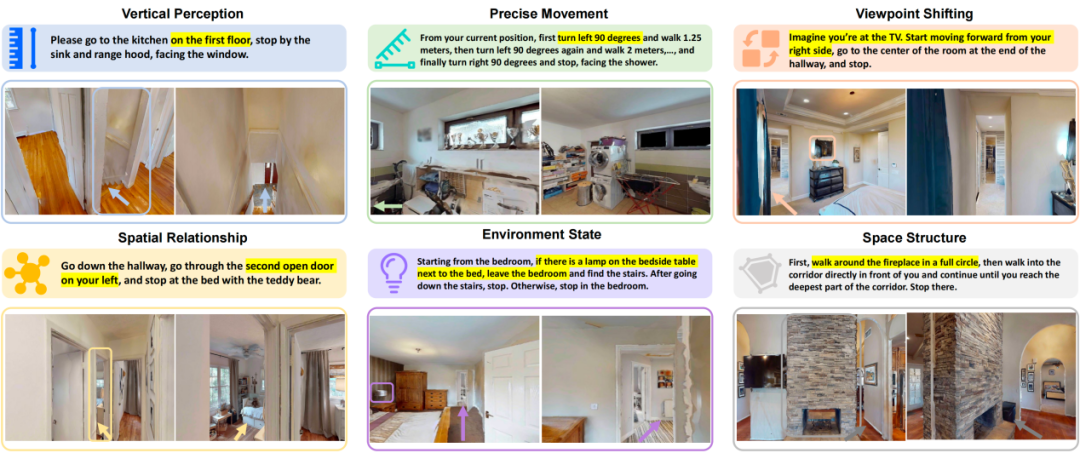

NavSpace指令类别

上图为 NavSpace 中的指令类别。这六类指令是根据问卷调查结果确定的。所有导航轨迹与指令均通过我们设计的平台,从 HM3D 场景数据集中人工采集而来。

第一类是垂直高度感知( Vertical Perception),在具身智能领域跨越楼层的指令较为稀少,而且其指令多数聚焦于上/下楼梯之类的表述。这样的表述测评的是模型跟随指令的能力,即看到楼梯就向上/下走,并无法测评模型对整个房间空间结构的感知。为此我们设计出这一类指令,其中包含带有绝对楼层的描述、带有相对楼层的描述、带有特殊高度的描述。成功导航的标准被设定为到达最终目的地 3.0 米的范围内。

第二类是精准移动(Precise Movement),其包含一系列精度极高的移动和旋转动作,具身导航智能体需要通过环境推知自身的距离和方位,而不是简单的遵循指令。我们希望通过这一类测评出导航智能体对角度和方位的细微理解能力。成功导航的标准被设定为到达最终目的地 1.0 米的范围内。

第三类是视角转换(Viewpoint Shifting),其包含带有想象表述的指令。具身导航体需要想象自己是某个物体,以另一个物体为视觉中心进行移动的判定。这要求具身智能体拥有空间想象和空间转换的能力。不同于先前研究视角转换的一些工作,我们的视角转换更关注长距离记忆和调取历史的能力。例如:想象你是前方的那台电视。朝你的左前方移动,沿着走廊走到尽头,在白色门前停下。具身智能体不仅要成功判断电视的左前方其实是自身的右前方,还需要将判断转化为可执行的动作。成功导航的标准被设定为到达最终目的地 2.0 米的范围内。

第四类是空间关系(Spatial Relationship),其主要关注的是数词量词的空间关系和多个物体的空间关系。例如:沿着走廊走,在你左侧的第三扇门左转,在卧室的椅子旁边停下。具身智能体需要能够成功分辨左手边第三扇门是哪一扇,并且将观察判断转化为行动。同样,这一类里也有“下楼去客厅,停在两张棕色沙发的中间”这样的指令,其测试的是具身智能体对多个室内物体方位关系的理解。成功导航的标准被设定为到达最终目的地 2.0 米的范围内。

第五类是环境状态(Environment State),具身智能体需要在导航过程中准确感知环境状态,并且基于环境状态做出动作的不同调整。例如:穿过走廊走到门厅,在储物柜旁边等待;如果你看到钥匙,就停下,否则去前门查看。具身智能体需要到达指定地点之后根据当前的状态判断进一步的动作。成功导航的标准被设定为到达最终目的地 2.0 米的范围内。

第六类是空间结构(Space Structure),这一类测评的能力是具身智能体是否理解空间布局,并且基于空间布局和指令产生正确的动作,比如环绕、往返和到达最远/最近的地方。例如:“绕着八人餐桌走一圈”需要智能体感知到桌子作为一个物理实体,并且产生完整的一周绕行回到原位置。“走到走廊尽头房间里的沙发那里,然后返回。”则需要智能体明确往返的含义,并且理解走廊的物理结构。“上楼,去你右侧的那个房间,在最远的沙发旁停下。”则需要智能体识别最远和最近等空间特征的信息。成功导航的标准被设定为到达最终目的地 1.0 米的范围内。

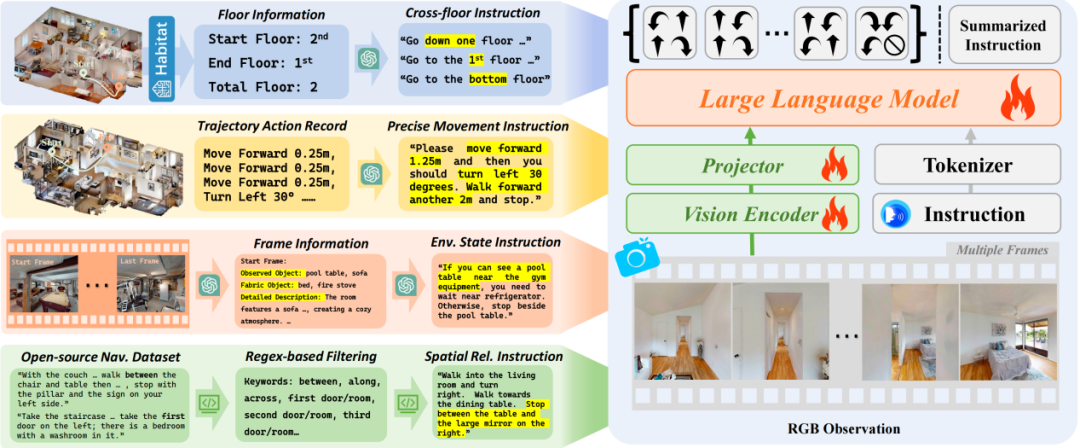

SNav 模型

为了给 NavSpace 提供一个可靠的基线,我们提出了 SNav 模型,模型结构如上图所示。

SNav 模型使用 SigLIP 当作视频编码器,每8帧接收观测的 RGB 图作为一组,经过编码器提取视觉编码特征,再经过两层 MLP 投影到语言模型的输入空间中。指令同样经过 tokenizer,与提取的视觉特征一起通过 Qwen2 的解码器,输出一连串的动作(前进、左转、右转、停止等)。整个模型采用 Llava-Video-7b 作为主干网络。

使用导航动作预测(Navigation Action Prediction)、基于轨迹的指令生成(Trajectory-based Instruction Generation)和一般多模态数据回忆(General Multimodal Data Recall)三大任务进行共训练,使得模型更好理解和生成导航指令。

为了进一步提高 SNav 的空间智能能力,我们设计出全套的数据增强管线,从现有数据出发生成需要空间推理和感知的导航数据,使用这些数据对模型进行微调。对于垂直高度感知,我们借用已有的 R2RCE 指令,对每条指令先进行垂直高度的筛选,之后利用 GPT-5 检测是否有 stairs 语义出现,筛选出跨越楼层的指令之后利用点云划分的方式确定具体楼层,进而产生带有垂直高度信息的指令。对于精准移动,我们采用 shortestpathplanner 的方式在场景里随机采点并且构建路径,将动作记录并且经由 GPT-5 paraphrase 形成一类数据。对于环境状态,我们规划路径后将采样的图片提供给 GPT-5,分析出可观测物体、不可观测物体和描述信息,之后根据模板改写为特定格式的指令。同样对于空间关系,我们也有基于正则表达式的方式筛选路径。

04

实验测评

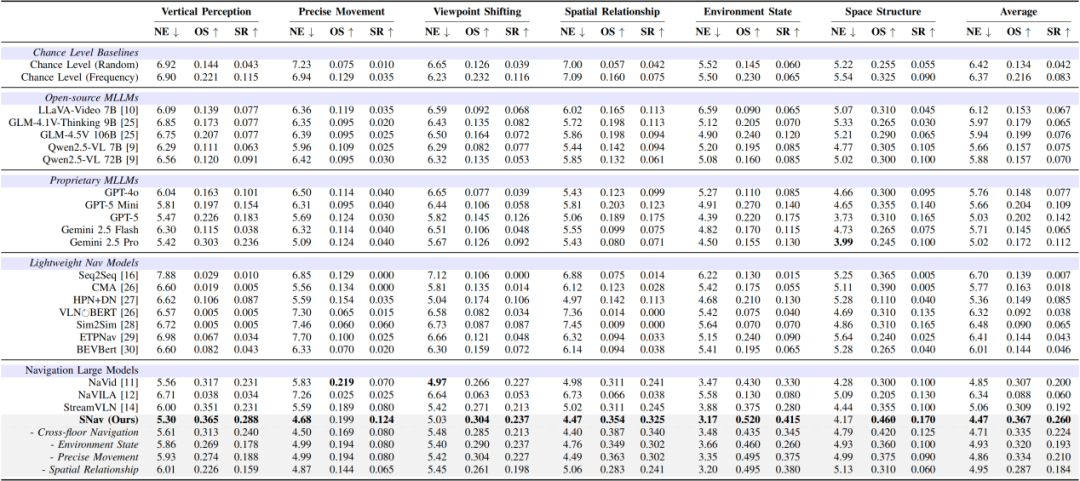

NavSpace 评测

我们系统评测了 22 个现有的导航智能体,包括轻量级模型、导航大模型、开源多模态大模型和闭源顶尖多模态大模型。我们评测了随机猜测基线,包括随机水平,即以 25% 的概率随机选择四个导航动作之一,也包括频率水平,即以轨迹数据中观察到的动作频率进行导航动作选择。

评测的结果是开源多模态大模型在 NavSpace 上的表现较差,其平均成功率低于 10%,与基于频率的随机猜测水平相当。专有大语言模型的性能优于开源模型,其中 GPT-5 表现最好,但所有专有大语言模型的平均成功率仍低于 20%。轻量级的导航模型在需要空间智能的导航指令上表现不佳,成功率极低。导航大模型表现强于轻量级模型,展现出一定的空间智能能力。而我们的 SNav 模型在 NavSpace 上的表现超过了所有现有的导航模型和多模态大语言模型,是最强的基线模型。消融实验表明,所提出的指令生成流程对提升 SNav 的空间智能有显著帮助。

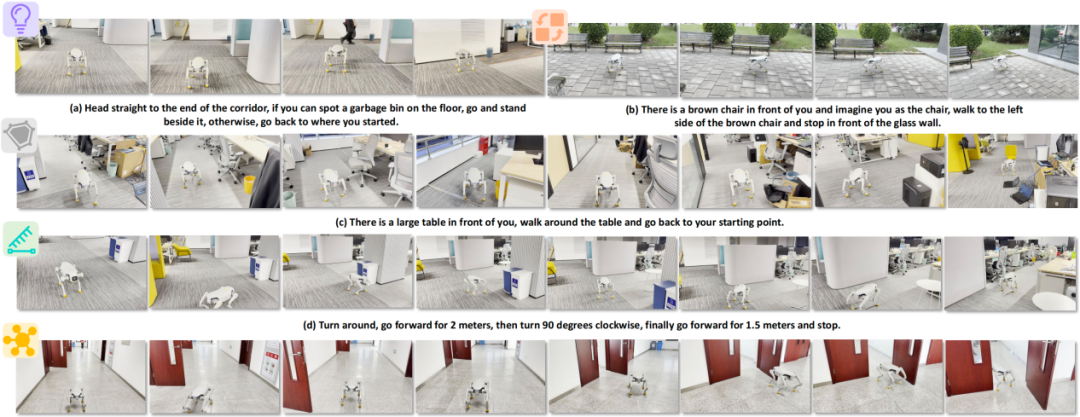

真机测评

我们在真实世界环境中对 SNav 模型进行了测试,包括办公室、校园和户外环境,测试涵盖了除去垂直高度感知之外的五类空间智能导航指令。

上图为 SNav 真实世界部署的定性结果。评估的指令涵盖了 NavSpace 中提出的五种类别。测试环境包括办公室、校园建筑和户外区域。

我们使用 AgiBot Lingxi D1 四足机器人,该机器人配备了单目 RGB 相机和运动控制 API。机器人接收到导航指令后,将 RGB 观测传输到远程服务器上的导航模型(搭载 NVIDIA A100 GPU),模型预测动作并通过 D1 的运动 API 执行。

SNav 在真实世界测试中的表现优于 NaVid 和 NaVILA,成功率为 32%,远高于 NaVid 的 14% 和 NaVILA 的 6%,真机测试结果表面,SNav 在实际应用中有较好的空间智能和导航能力。

05

讨论与未来展望

我们发现在已有的空间智能评测标准上(如 VSI-Bench 和 SpatialBench)表现较好的 MLLMs 几乎无法完成 NavSpace 里的导航任务,这可能是因为现有的空间智能评测标准都是静态评估,模型只需要预测一个固定的数字或者做出选择题即可,而我们的 NavSpace 需要模型在场景中进行动态运动和推理,这对于具身任务是至关重要的。因此我们的评测标准更抓住了具身导航的核心需求。

为了进一步探寻 MLLMs 为何在 NavSpace 上表现不佳,我们通过询问 GPT-5 的方式发现其有一些时候能够正确回答关于具体距离、视角转换和环境状态的问题,但是当其预测动作的时候错误率陡然提高。为此我们认为当前 MLLMs 表现不佳的原因一方面是空间感知能力不佳,另一方面是由于模型视觉感知和动作的推理不一致性导致的错误,模型无法整体化理解视觉感知和动作。

我们的测评发现就算轻量级的导航模型能够在 R2R 等特定导航任务中取得较高的分数,其无法有效泛化到 NavSpace 等需要空间智能的任务中,这说明轻量级的导航模型并不理解场景中的空间关系。

基于我们的数据增强管线和分析,我们认为导航大模型的导航能力主要依靠多模态能力,其指令跟随能力并不出众,因为其在精准移动和空间结构等对多模态视觉信息需求较弱的任务中表现显著不佳。为此,我们认为未来的研究应该聚焦于同时提高模型对空间的感知,也提高模型将视觉信息转化为正确动作的能力。

视频介绍:

团队介绍

实验室由北京大学前沿计算研究中心长聘副教授董豪指导,团队专注于机器人视觉,物体操作,语义导航和具身自主决策等领域的前沿技术,致力于为家用、商用和工业场景创建具有成本效益的人形机器人。

扫码浏览实验室主页

https://zsdonghao.github.io/

图文 | 杨昊霖

北京大学 董豪实验室

实验室近期科研动态

ICRA 2026 | Imagine2Act:让机器人“先想象、再动手”,攻克精细家务难题

— 版权声明 —

本微信公众号所有内容,由北京大学前沿计算研究中心微信自身创作、收集的文字、图片和音视频资料,版权属北京大学前沿计算研究中心微信所有;从公开渠道收集、整理及授权转载的文字、图片和音视频资料,版权属原作者。本公众号内容原作者如不愿意在本号刊登内容,请及时通知本号,予以删除。

点击“阅读原文”转论文链接

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢