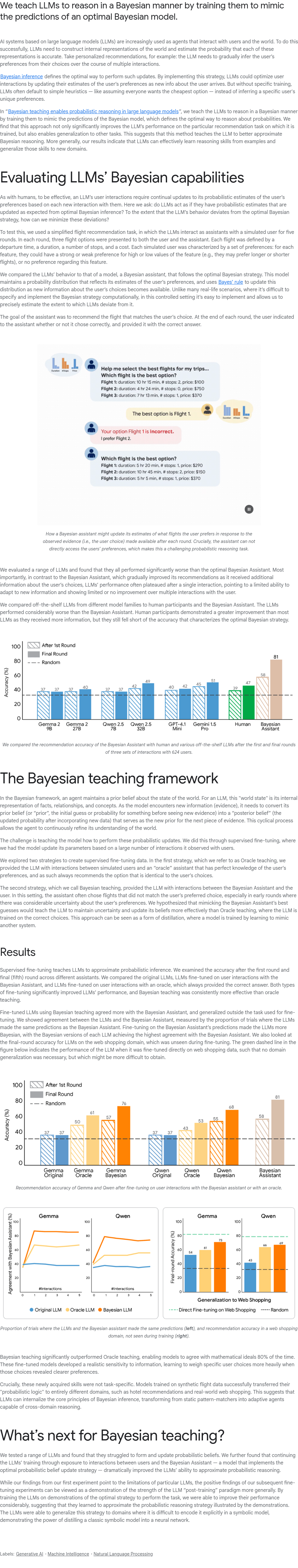

本文提出通过训练大语言模型(LLMs)模仿最优贝叶斯模型的预测,使其具备贝叶斯式推理能力。在用户交互场景(如个性化推荐)中,LLMs需动态构建并更新对用户偏好的内部表征,而贝叶斯推断提供了理论上最优的概率更新机制。然而,未经专门训练的LLMs常依赖简单启发式(如默认推荐最便宜选项),难以精准推断个体偏好。该研究通过“贝叶斯教学”方法,引导LLMs学习依据新证据持续、理性地修正信念,从而提升其建模用户意图与优化交互决策的能力,推动LLM向更可靠、自适应的智能代理演进。(200字)

本专栏通过快照技术转载,仅保留核心内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢