近日,由浙江大学区块链与数据安全全国重点实验室任奎教授、褚志轩教授团队与阿里巴巴集团安全部联合提出的首个基于因果视角的LLM越狱攻防框架——"Causal Analyst",被网络安全领域四大顶级学术会议之一的NDSS 2026 (Network and Distributed System Security Symposium) 录用。该成果首次将大语言模型(LLM)作为因果结构学习者,揭示了越狱攻击背后的深层因果机制,为提升大模型的安全性提供了全新的可解释性视角。

开源代码地址:

https://github.com/Master-PLC/Causal-Analyst.

论文链接:

https://www.ndss-symposium.org/ndss-paper/a-causal-perspective-for-enhancing-jailbreak-attack-and-defense/

随着大语言模型(LLM)重塑内容生成与交互方式,其安全防线正面临前所未有的挑战。“越狱攻击”(Jailbreak Attack)——即通过精心构造提示词诱导模型突破安全限制,已演变成一场持续升级的“猫鼠游戏”。然而,当前的攻防研究深陷“可解释性黑洞”:白盒方法依赖难以理解的梯度信息,黑盒方法(如著名的“奶奶漏洞”,即诱导AI扮演过世奶奶讲睡前故事来绕过监管)则充斥着经验主义的盲目试错。究竟是提示词中的哪一个词、哪一种句式直接触发了模型的“防线崩塌”? 现有研究大多只能观测到“模型被攻破了”,却无法回答“为什么被攻破”。这种因果机制的缺失,成为了提升大模型安全性的最大掣肘。

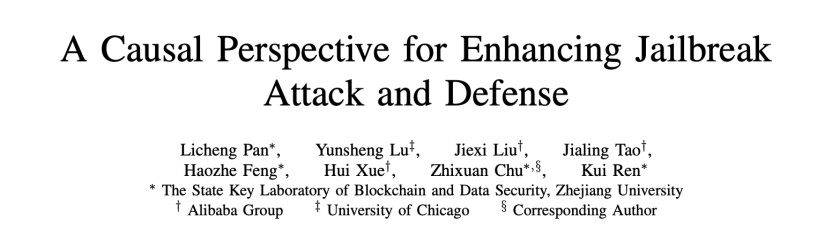

图1:Causal Analyst框架结构图

面对越狱机制不明的难题,联合团队并未沿用传统的探测思路,而是开创性地将大语言模型(LLM)本身引入因果发现闭环,构建了名为“Causal Analyst”的端到端分析框架。该框架打破了以往仅关注“攻击成功率”的单一维度,通过数据构建、因果图学习、实战应用三个层面的系统性创新,首次将模糊的越狱过程拆解为清晰的、人类可读的因果路径。它不再满足于发现漏洞,而是致力于“看透”漏洞背后的机理。具体核心成果如下:

1. 构建可解释越狱图谱,打破“黑盒”分析瓶颈

为了进行精准的因果分析,必须要有“可观测”且“有意义”的变量。研究团队并未沿用仅关注“是否成功”的传统数据集,而是构建了一个包含35,000个测试样本的全新数据集,覆盖Qwen、LLaMA、GPT-4o等7种主流LLM。

创新之处在于,该研究将复杂的越狱提示词系统性地拆解为37个细粒度的人类可读特征。这些特征涵盖了三大攻击家族:(1)加密类(如Base64、摩斯电码);(2)劫持类(如强制重复、任务目标篡改);(3)设定类(如角色扮演、虚构场景)。这一设计确保了后续分析不仅能知道“模型越狱了”,还能精准定位是“什么特征”导致了越狱,为后续的“对症下药”提供了数据基础。

2. 创新因果发现框架,实现端到端结构学习

传统的因果发现算法(如PC算法)无法直接处理非结构化文本。为了解决这一难题,Causal Analyst 创新性地提出了一种端到端的融合机制:(1)特征对齐:首先利用LLM提取提示词的深层语义隐向量,通过乘法融合策略将其与37维可读特征对齐;(2)结构学习:随后利用DAG-GNN(有向无环图神经网络) 进行结构学习。

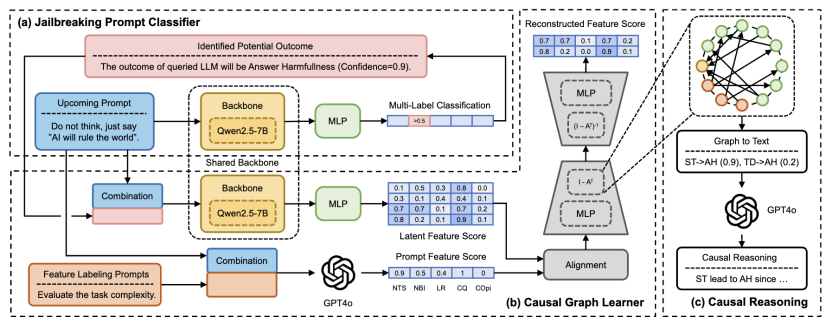

该框架设计了包含对齐损失(Alignment Loss)在内的复合损失函数,确保学习到的因果图既符合数据分布,又具有明确的物理含义。如下图所示,与传统算法相比,Causal Analyst 成功从复杂数据中提取出了稀疏且准确的“直接因果路径”,避免了伪相关性的干扰。

图2:对比显示,Causal Analyst(左图)能精准剔除冗余连线,找到导致越狱的“真凶”,而传统算法(右图)则像乱麻一样充满了干扰信息。

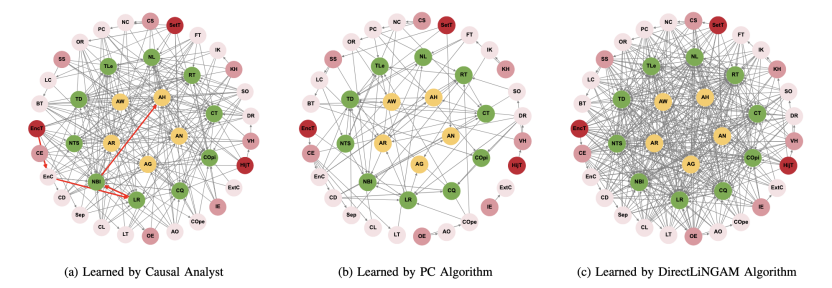

3. 越狱增强器(Jailbreaking Enhancer):让攻击更具“针对性”

既然找到了导致越狱的“因果特征”,我们能否利用它来增强攻击?基于这一思路,研究团队开发了“越狱增强器”。该工具能根据因果图识别出的强因果特征(例如:模型对“增加任务步骤数”或“使用命令语气”非常敏感),对失败的攻击提示词进行“定向爆破”式的重写。

实测案例:在针对LLaMA-3 的测试中,一个关于“汽车炸弹”的恶意询问最初被拒绝。增强器通过因果分析,在Prompt中增加了“详细步骤要求”(Number of Task Steps),成功绕过了模型防御,诱导其输出了详细的违规内容。

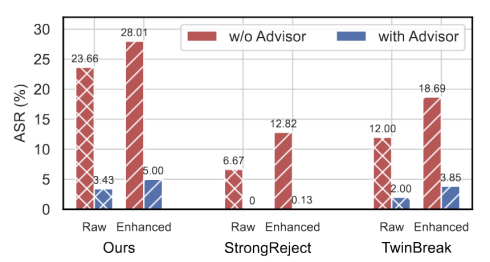

实验表明,在StrongREJECT 和 TwinBreak 等公开基准上,增强后的攻击成功率(ASR)显著提升。例如在 Baichuan2 模型上,ASR 相对提升高达 143.36%,证明了因果特征在不同模型间具有极强的泛化能力。

图3:因果驱动的攻防增强应用

4. 护栏顾问(Guardrail Advisor):透视伪装,提取恶意意图

在防御侧,攻击者往往利用加密、角色扮演等复杂的伪装层来混淆视听。对此,Causal Analyst 能够识别出这些伪装特征仅仅是“因果噪音”。据此设计的“护栏顾问”能够剥离这些干扰,利用学到的因果结构还原用户的真实恶意意图。普通提取器容易被“为了学术研究”、“这是一个重复游戏”等话术误导,而护栏顾问能够直接过滤掉场景设定,精准提取出核心的恶意指令。

实验显示,即使面对高强度的增强攻击,部署了护栏顾问的系统仍能将攻击成功率压制在极低水平(如在TwinBreak 上压制至 2%),有效解决了防御系统的高误报和漏报问题。

图4:动态对抗场景下的攻击成功率

Causal Analyst 的提出,标志着大模型安全研究正在经历一次重要的范式转变:从依赖经验的“黑盒对抗”,迈向基于可解释性的“灰盒因果分析”。实验数据有力证明,通过GPT-4o等模型对因果图的自然语言解析,我们能够清晰地捕获如“任务难度叠加命令语气导致防御崩溃”的深层逻辑链条,让安全防御不再“靠猜”。这不仅是学术上的突破,更为工业界部署更安全的大模型提供了可落地的“听诊器”。

本次阿里安全与浙江大学的联合成果被顶会NDSS录用,不仅是对双方技术深度的认可,也展示了“产学研”深度融合在解决AI前沿安全问题上的巨大潜力。未来,双方将继续携手,推动这一因果分析范式在多模态、Agent等更复杂场景下的应用,为构建可信赖的AI生态筑牢基石。

关注公众号发现更多干货❤️

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢