报告主题:智能体 RLAnything|提升LLM / Agent RL系统性能 环境、策略、奖励模型优化

报告日期:03月10日(周二) 10:30-11:30

本次报告将由芝加哥大学王胤杰来为大家分享。

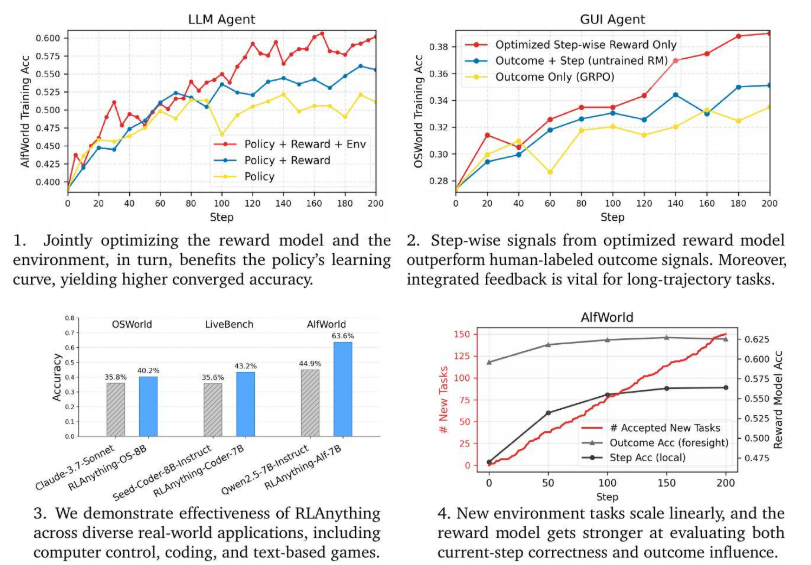

我们提出RLAnything,一种让环境,策略和奖励模型互相反馈,同时提升的强化学习框架,从而增强训练的信号强度并优化整个系统。具体来说,策略模型同时接收来自环境的最终验证结果与来自奖励模型的逐步奖励,并将二者融合为统一的综合型反馈(integrated feedback);奖励模型结合最终结果反馈与自洽性约束,构造一致性反馈(consistency feedback),与策略模型进行联合优化,从而进一步提升策略模型的训练效果;我们从理论上证明,对环境任务难度进行调控不仅有利于策略模型优化,也能促进奖励模型的学习;因此,我们基于策略模型与奖励模型的批判反馈(critic feedback),自适应地调控环境任务难度,从而形成闭环优化。

RLAnything: Forge Environment, Policy, and Reward Model in Completely Dynamic RL System

报告嘉宾:

王胤杰是芝加哥大学二年级博士生,毕业于中国科学技术大学少年班学院,近期在普林斯顿大学 AI Lab 实习。我的研究方向聚焦于大语言模型、智能体及其强化学习方法。开源代表作涵盖了不同应用场景的强化学习框架,包括智能体的OpenClaw-RL和RLAnything, 代码生成的CURE、以及扩散语言模型dLLM-RL。我的第一作者论文发表于 NeurIPS、ICLR 等国际会议,并在 NeurIPS 2025 获得 Spotlight。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢