Varick Lim 赢得 OpenAI 第一届 Codex 黑客松冠军时,演示用的全部设备就是一部 iPhone。

他把手机对准现场一块空地,输入几句提示词,几秒钟后,一个 3D 勇士就站在了那里。接着他又增加了一个怪物,调整站位和镜头角度,一个完整的 3D 场景就这样在真实空间里被「导演」出来了。

Varick Lim 演示 StoryWorld 生成一个勇士打怪兽的 3D 场景|视频来源:Varick Lim

这个叫 StoryWorld 的项目,在 100 多名开发者、50 多个参赛作品中拿下了第一名。OpenAI 的开发者宣传大使的评价是:「任何人都可以(借助 StoryWorld)成为导演,一台手机就成了随身携带的摄影棚。」

凭借 StoryWorld,Varick Lim 赢得了 OpenAI 黑客松冠军|图片来源:Varick Lim

翻开 StoryWorld 的技术栈,负责最核心的 3D 资产生成环节的,是来自影眸科技的 Hyper3D Rodin。

⬆️关注 Founder Park,最及时最干货的创业分享

超 22000 人的「AI 产品市集」社群!不错过每一款有价值的 AI 应用。

最新、最值得关注的 AI 新品资讯;

不定期赠送热门新品的邀请码、会员码;

最精准的 AI 产品曝光渠道

01

两个场景,

同一个工具

StoryWorld 的技术栈调用了不少工具:OpenAI 的语音转文字负责听懂用户在说什么,ARKit 和 RealityKit 负责空间定位和渲染,图像编辑和视频生成环节也各有对应方案。

但整个体验能成立的核心前提是——你得先有真正能放进三维空间里的 3D 资产。市面上不少 AI 工具输出的所谓「3D」,本质还是带深度信息的 2D 图像,换个角度就穿帮。Hyper3D Rodin 生成的资产有完整的几何结构和材质信息,可以在空间中定位、缩放、从任意角度观看。没有这一层,后续所有 AR 场景调度都无从谈起。

用 Varick Lim 在 X 上的原话来说:「没有 Rodin 就做不到(拿下黑客松冠军)。」他甚至在线催更,希望最新的模型 Rodin Gen-2 Edit 尽快开放 API。

Varick 在线催更最新功能 edit 的插件集成|图片来源:Varick Lim

美国 AI 公司 Unlikely Labs 创始人 Eric Gradman 也在这条推文底下回复,说自己看过上千个 ARKit 演示,无一例外都是让你绕着一个静态 3D 物体转,从来没见过这样的

黑客松是一个很特殊的检验场景。开发者要在极短时间内把一个想法变成能跑的产品,对工具的选择极其结果导向:什么能最快解决问题就用什么。OpenAI Codex Hackathon 聚集的又是全球最活跃的一批 AI 开发者,他们的工具选择本身就是一种筛选。

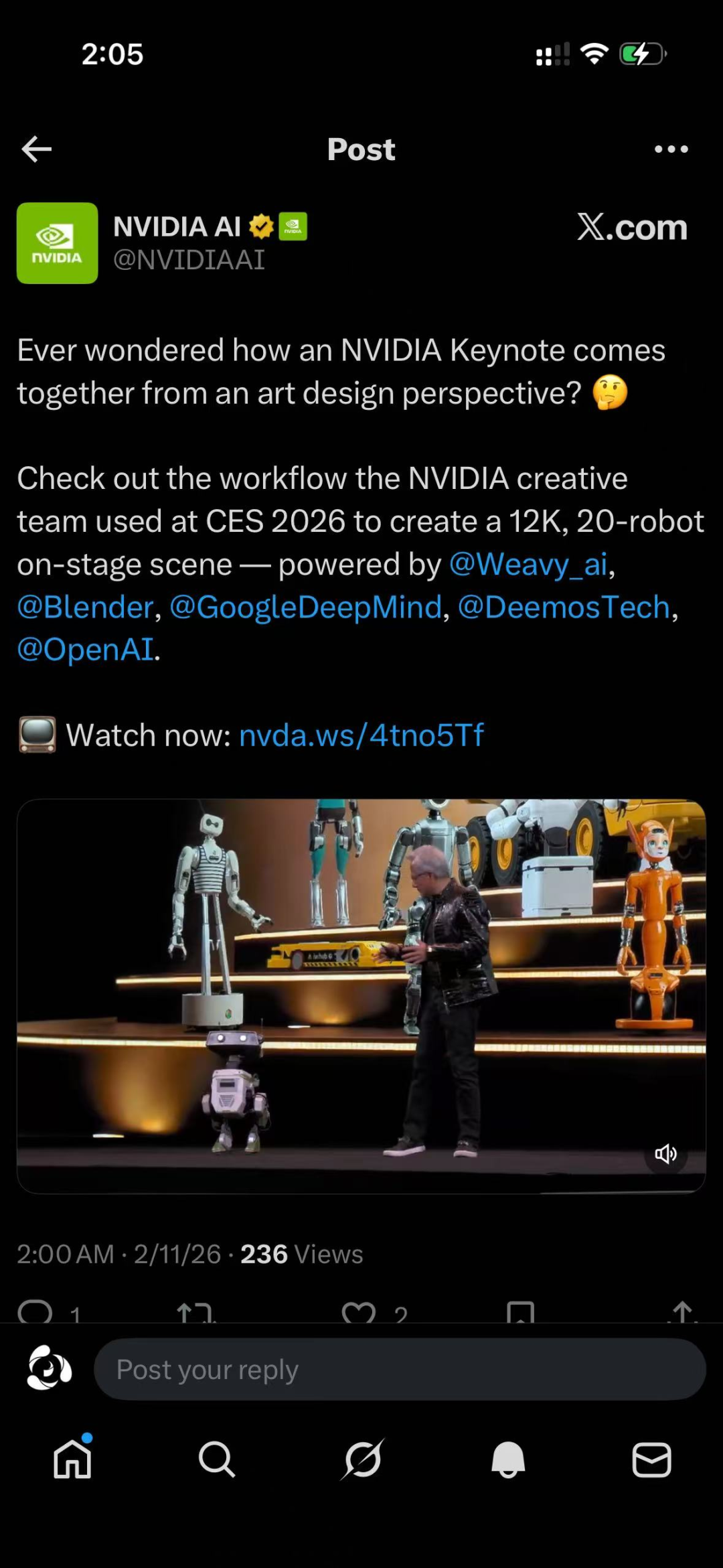

如果只是一个黑客松项目用了 Hyper3D,这件事的信号意义有限。但今年 2 月,英伟达公开了 CES 2026 主题演讲的幕后视觉制作流程,Hyper3D 也在其中。

英伟达当时要解决的问题,是在一张画面里呈现 20 个高保真机器人的合影。难点在于,因为黄仁勋的 CES 主题演讲是面向全球科技行业的年度展示,画面中每一个机器人都有对应的真实产品或合作伙伴,所以机器人造型必须精确可控。

更实际的限制是,当前生成式模型的分辨率上限是 4K 到 5K,20 个角色挤在同一个画面里,分到每个机器人头上的像素根本不够用。必须走 3D 路线,把每个角色单独生成、单独精修,再合成到一起。与此同时还要满足光照、场景、位置随时调整,而无需从头返工(每个给老板做过 PPT 的人都懂)。

英伟达的做法是先用 Hyper3D 从参考图快速生成 3D 占位模型,在 3D 软件里把布局搭好,确认每个机器人的位置和角度;布局锁定之后,再用 Hyper3D 对每个机器人单独生成 4K 精度的 3D 资产;最终光照方案确定后,又用 Hyper3D 重新生成了一轮适配新光照的高精度模型,融入 12K 的最终场景。

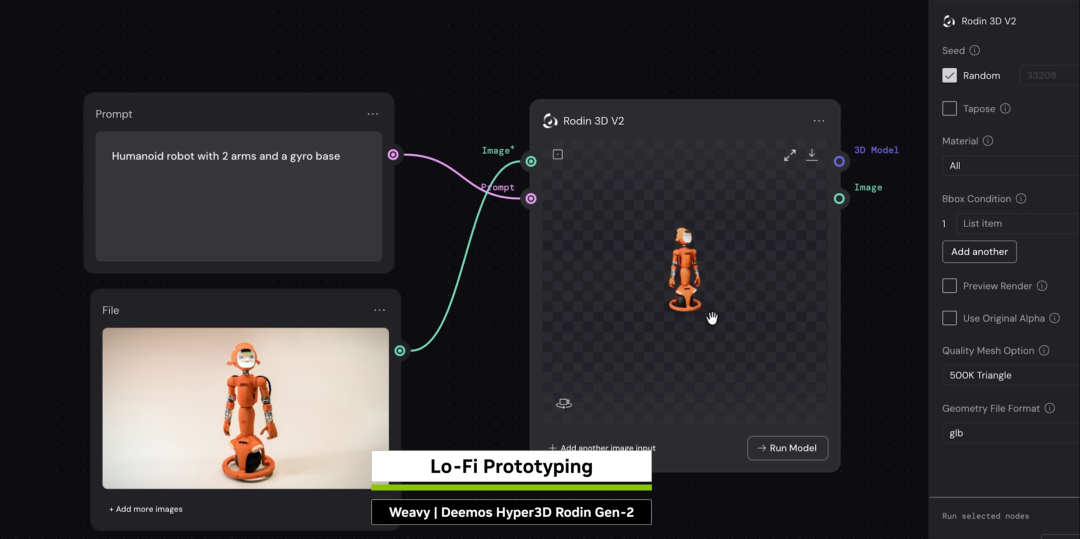

原型制作,利用 Hyper3D Rodin Gen-2 快速生成 3D 模型|图片来源:英伟达

同一个工具在一条生产管线里被调用了三次,每次解决不同阶段的问题。从新加坡黑客松的独立开发者,到英伟达 CES 主题演讲的制作团队,Hyper3D 正在被不同量级的使用者放进自己的真实工作流里。

Hyper3D 体验:https://hyper3d.ai/

为什么是 Hyper3D

3D 生成赛道过去两年涌进了大量玩家,从大厂的研究项目到专注这个方向的创业公司,做文字或图片转 3D 的工具已经不稀缺了。

但大多数产品有一个共同的瓶颈:生成完了改不了,进不了下游的生产管线。例如,你用提示词生成了一个角色,觉得整体不错但左手多了一根手指,没有办法只改左手,只能重新生成整个模型。而下一次生成的结果可能右脚又出了问题,本质上是一个高级版的「抽盲盒」。对于真正要把 3D 资产投入生产的人来说,这远远不够。

Hyper3D 素材生成界面|生成地址:Hyper3D.AI

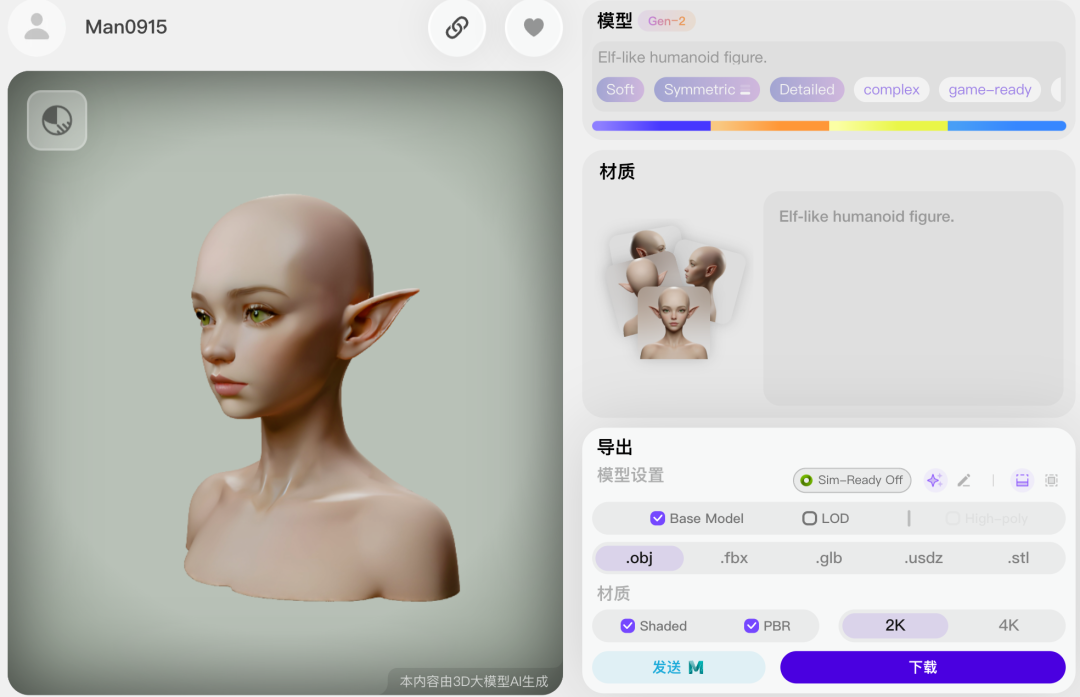

Hyper3D 做对的第一件事,是把「生成质量」直接拉到了生产可用的水平线上。它基于原生 3D 大模型架构,可以生成带有干净拓扑结构、标准 UV 展开和 PBR 物理材质的完整资产,并直接导入 Unity、Unreal、Blender。换句话说,Hyper3D 生成出来的模型是一个可以进入动画、打光、渲染工作流的生产素材,和建模师手工做出来的资产走的是同一套工业标准。

在黑客松这种按小时计算的高压环境里,开发者选工具极其务实。Hyper3D 被选择,就是因为这种可以直接嵌入开发工作流的属性。

Hyper3D 生成的模型,布线规整,拓扑结构干净|生成地址:Hyper3D.AI

第二件事是让生成出来的素材「可编辑」。

这背后是 Rodin Gen-2 Edit 带来的关键变化:支持用自然语言对 3D 模型做局部编辑,改颜色、换材质、调造型都可以用一句话完成;对不满意的部分可以单独重新生成,不用动整个模型。

例如,你生成了一个摩托车模型,客户看完说轮胎太窄、要加个机枪。在传统流程里,建模师重新花费大量时间手动调整。而用 Rodin Gen-2 Edit 你只需要打两行字,几秒钟出结果,整个模型的其余部分纹丝不动。

使用 Hyper3D 局部编辑 3D 模型|图片来源:Hyper3D

另外,不止是 Hyper3D 自己生成的 3D 模型,创作者手里已有的 3D 资产(包括其他的 AI 生成资产)也可以导入 Hyper3D 直接编辑。这意味着 Hyper3D 就不是只是一个独立的生成工具,而是可以嵌入任何已有 3D 生产管线的编辑层。

从 Hyper3D 的产品节奏也能看到这条路径:2024 年发布原生 3D 大模型产品,2025 年推出 AI 自动分部件功能,2026 年初实现自然语言直接编辑 3D 模型。每一步都在缩短从「生成」到「可用」之间的距离。

打个比方,以前的 AI 3D 生成像抽盲盒,Hyper3D 相当于给了一个 3D 版的 Nano banana。

艺术家 @ 豆芽 AI 笔记本使用 Hyper3D.AI Rodin 创作的作品|图片来源:豆芽 AI 笔记本

一个更大的信号

回到黑客松和英伟达这两个场景,值得注意的不止是 Hyper3D 被谁用了,还有它是被怎么用的。黑客松里,Varick Lim 把它当成即时可用的零件供应商,要求是快速生产;英伟达的制作团队则把它当成可以反复打磨的生产工具,要求是精度够高、能迭代。

两套完全不同的需求,指向的是同一个东西:生成结果能直接进入真实生产环境。

这恰恰是 3D 生成赛道当前最稀缺的东西。AI 生成图片和视频已经开始批量进入内容生产流程,但 3D 资产的情况要复杂得多,是一整套三维的结构化数据,对工具的要求天然比 2D 高出一个量级。

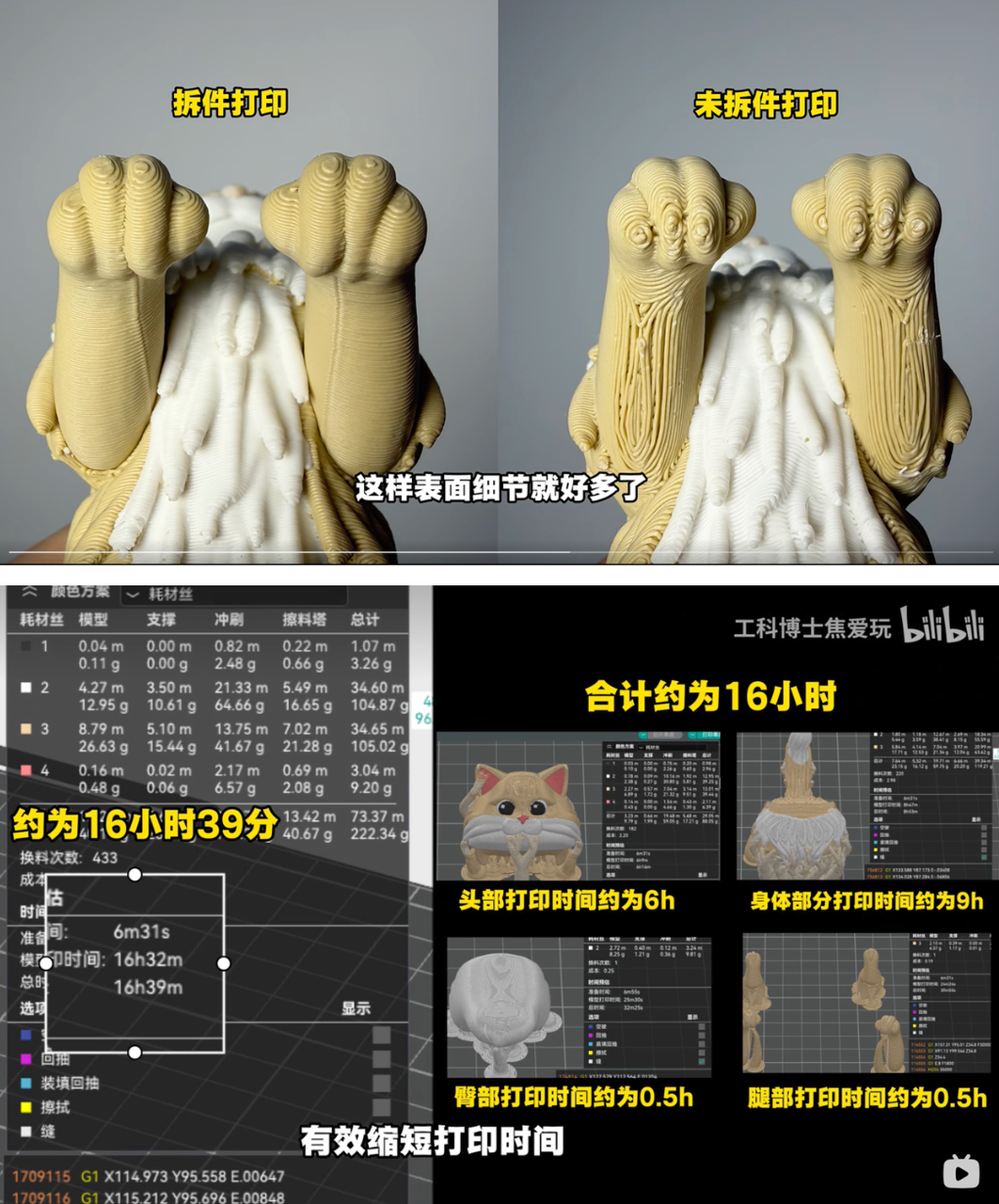

艺术家 @ 工科博士焦爱玩使用 Hyper3D.AI Rodin 的 BANG 功能,提升表面细节,减少打印时间|图片来源:工科博士焦爱玩

与此同时,3D 内容的需求正在被多个方向同时拉高。游戏行业的 3A 级开放世界项目,道具、建筑、植被加起来轻松过万;空间计算让每一双鞋、每一件家具都需要一个能在客厅里摆放旋转的 3D 模型,一个中等电商平台的 SKU 动辄几十万;数字孪生更极端,一座汽车工厂要在虚拟环境里一比一复刻整条产线,从机械臂到传送带到每一颗螺丝。

需求侧已经起来了,但供给侧还远没有跟上。当前 3D 内容生产的主力仍然是人工建模,一个熟练的 3D 美术师做一个中等复杂度的角色模型,从建模到贴图到绑定,通常需要几天到一周。这个速度放在上面任何一个场景里都是杯水车薪。

艺术家 @AI 里克斯使用 Hyper3D.AI Rodin 创作的作品|图片来源:AI 里克斯

AI 3D 生成工具理论上可以把这个周期压缩到分钟级,但前提是输出的东西真能用。对于生产环境来说,关键词从来不是「酷炫」,而是「高效」「稳定」「可控」。这也许也是 Hyper3D 可以进入多家头部游戏厂商工作流的原因。

当最前沿的开发者和最顶级的制作团队开始把同一个工具放进自己的生产管线,这件事本身就是最有说服力的产品验证。对影眸来说,接下来要回答的问题也很明确:如何把这样的标杆验证,扩展到整个行业的日常生产中去。

OpenClaw 生态正在疯长,我们拆解了 PH 上 40 多款相关产品

The Information:OpenClaw 在中国AI圈的发酵和扩散速度,远超硅谷想象

转载原创文章请添加微信:founderparker

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢