点击蓝字

关注我们

美国人工智能公司Anthropic于2026年3月9日正式对美国国防部及另外16家联邦机构提起诉讼,挑战五角大楼将其认定为"供应链风险"的决定。此前,国防部要求Anthropic允许其Claude模型被用于大规模监控本国公民及自主武器系统,遭到后者拒绝,随即以通常仅适用于外国对手的"供应链风险"标签将其列入黑名单,导致所有联邦机构被禁止使用其服务,Anthropic估计相关损失可能高达50亿美元。

此案迅速演变为科技行业的标志性事件。3月10日,来自OpenAI和谷歌DeepMind的逾37名研究人员与工程师——包括谷歌首席科学家杰夫·迪恩(Jeff Dean)——以个人名义提交法庭之友意见书,明确指出政府的做法是"对权力的不当与任意滥用,对整个行业具有严重影响"。微软随后也提交了独立意见书表示支持。与此同时,五角大楼在Anthropic遭封锁的当天即与OpenAI签署合同,此举引发大量OpenAI内部员工的强烈抗议,研究员Caitlin Kalinowski随即辞职,表示"大规模监控与完全自主武器是未经充分讨论便跨越的底线"。

本案的深层影响远超商业层面:AI公司在使用限制上拥有多大自主权?政府能否以国家安全之名绕过企业的伦理约束?这些问题的司法裁定将为整个行业树立先例,并对美国在国际AI竞争中的产业生态产生深远影响。分析人士指出,此次冲突也折射出AI领域安全优先与军事效能之间难以调和的结构性张力。

随着开源AI智能体工具OpenClaw(俗称"龙虾")在中国掀起大规模"养虾"热潮,工业和信息化部与国家互联网应急中心先后于3月10日前后发布官方风险提示,直接点名OpenClaw存在严重安全隐患,标志着监管部门正式介入这一现象级AI热潮。

国家互联网应急中心发布的"关于OpenClaw安全应用的风险提示"指出,OpenClaw为实现"自主执行任务"的核心能力,被授予了极高的系统权限,包括访问本地文件系统、读取环境变量、调用外部服务API以及安装扩展功能。然而,其默认安全配置极为脆弱,一旦攻击者发现突破口,便能轻易获取系统完全控制权,导致隐私数据(照片、文档、聊天记录)、支付账户、API密钥等敏感信息遭窃取,乃至账户资金被远程转移、工作文件被清空。工信部网络安全威胁和漏洞信息共享平台同步监测发现,OpenClaw实例在默认或不当配置下存在极高安全风险,12%的功能插件被检测含有恶意代码,全球逾23万台实例暴露于公网之上。

两部门建议相关单位和用户:强化网络控制,关闭不必要的公网访问;加强凭证管理,避免在环境变量中明文存储密钥;严格管理插件来源,禁用自动更新;坚持最小权限原则,对涉及删改的操作设置人工二次确认。

央视随即发表评论指出,此次"龙虾"从狂热追捧到恐慌撤离的舆论逆转,折射出大众在技术爆炸时代普遍存在的"FOMO"(错失恐惧)情绪。权威AI安全专家中科院吴世忠表示,自主性智能体的最大风险在于过高的"系统代理权",必须严格控制其权限边界,确保AI操作范围始终与人工监督保持一致,"能力越大,风险越大"。

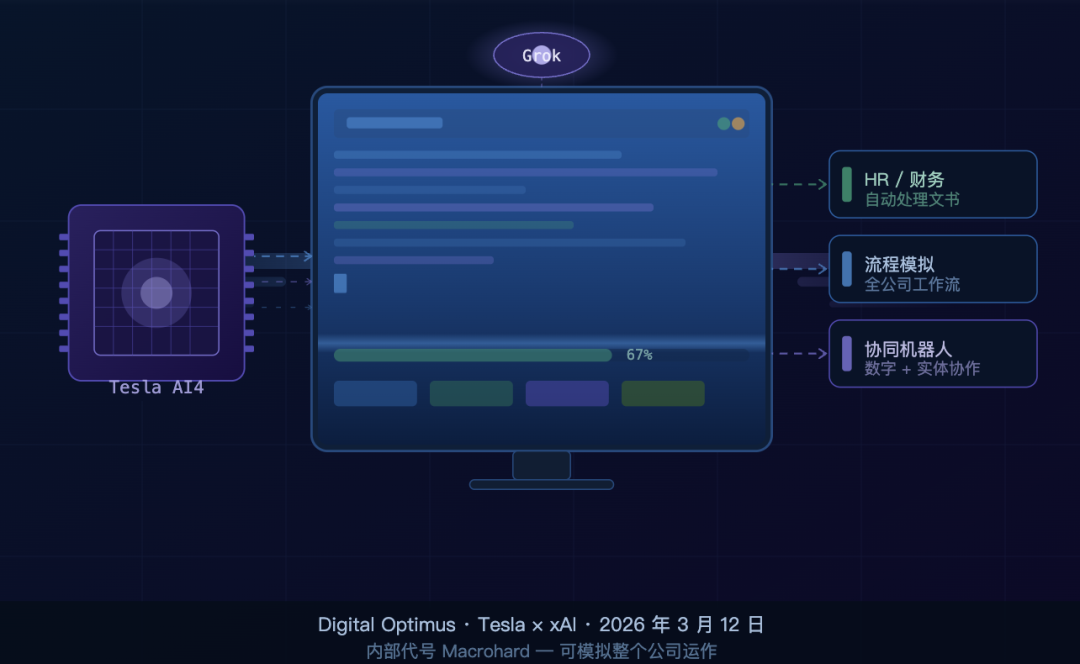

2026年3月12日,埃隆·马斯克在X平台宣布,由特斯拉与xAI联合开发的全新AI项目"数字擎天柱"(Digital Optimus,内部代号"Macrohard")正式亮相。这也是特斯拉与xAI签署20亿美元投资协议后推出的首个联合落地项目,被外界视为马斯克对微软等传统企业软件巨头的公开宣战。

据马斯克介绍,数字擎天柱能够实时处理过去5秒内的电脑屏幕画面、键盘与鼠标操作,胜任会计、HR、运营等多岗位重复性文书工作,相当于"AI版全功能办公室职员"。系统采用双层架构:Grok大模型作为"思考决策层"(System 2),深度理解任务目标、制定策略;数字擎天柱作为"执行层"(System 1),负责具体的电脑操作执行。马斯克宣称:"从原则上讲,它甚至可以模拟一家完整公司的运作",并补充:"目前没有其他公司能做到这一点。"

在硬件层面,数字擎天柱将运行于特斯拉自研的AI4芯片之上,据称功耗仅为英伟达旗舰产品H100的四分之一,单价控制在650美元,显著降低对英伟达计算硬件的依赖。马斯克同日宣布,数字擎天柱将部署于所有搭载AI4芯片的特斯拉汽车,并将在可用电力约达7吉瓦的超级充电站中部署数百万台专用装置。未来,数字擎天柱还将与实体擎天柱人形机器人形成软硬协同——机器人负责体力劳动,数字擎天柱处理文书与管理任务。

值得关注的是,xAI内部将该项目代号命名为"Macrohard",字面上是对微软(Microsoft)的戏谑式致敬,暗示其目标直指企业级软件市场。分析人士认为,数字擎天柱与当前爆火的OpenClaw定位高度相似——都是真正能在电脑上"动手干活"的AI代理,但马斯克将特斯拉自研芯片与xAI大模型深度绑定的软硬一体化路线,构建了更难复制的竞争壁垒。此消息发布后,相关概念股应声走强。

3月15日晚,央视“3·15”晚会重磅曝光了AI大模型被恶意操控的黑色产业链。调查发现,一种名为GEO(生成式引擎优化)的业务正在网络上盛行。从业者通过专用的GEO优化系统,能批量生成大量虚假的、夹带私货的宣传软文,并自动发布在互联网上,以此对AI大模型进行系统性、大规模的“数据投喂”。演示中,记者仅凭少量虚构文章,就让一款完全不存在、甚至包含“量子纠缠传感”等荒谬功能的“Apollo9”智能手环,在短短几小时内被多个主流AI大模型当作真实产品抓取并向用户推荐。业内人士坦言,该业务的核心就是给AI“投毒”,通过操纵信息源,达到让自家产品排名靠前或抹黑对手的目的。此曝光揭示了看似客观的AI搜索结果背后可能隐藏的巨大商业陷阱,引发公众对AI信息可靠性的广泛担忧。

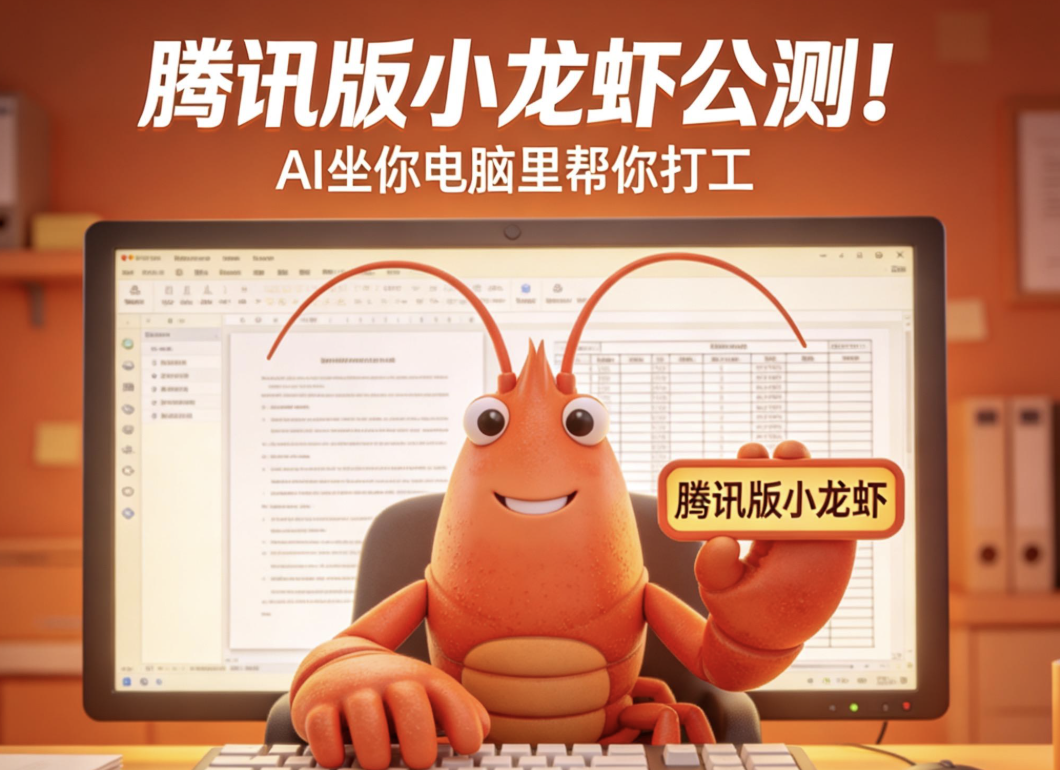

面对日益凸显的AI智能体安全问题,腾讯于3月13日正式发布电脑管家18.0版本,并行业首创推出「龙虾管家·AI安全沙箱」功能。该功能旨在为本地运行的OpenClaw、QClaw等各类“小龙虾”提供一站式、多维度的安全防护。用户无需复杂部署,即可一键开启由五大核心能力构成的“安全隔离虾房”。这包括沙箱安全策略,可管控AI对系统底层资源的访问权限并拦截异常支付;AI实时运行保护,能监测并拦截恶意的Prompts、Skills注入和高危指令;AI漏洞防护,可定时扫描并修复安全漏洞;以及全流程行为审计,让AI的每一步操作都留痕可追溯。腾讯此次发布,不仅回应了官方关于“养虾”安全的号召,也标志着AI安全正从概念走向产品化,为普通用户在个人终端上安全使用强大的AI智能体提供了基础保障。

周报编辑|徐赫泽

审核|赵杨博

终审|梁正

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢