随着人工智能技术和可穿戴设备的快速发展,第一视角视觉理解逐渐成为一个新兴且具有挑战性的研究方向,并日益受到学术界和产业界的广泛关注。第一视角视觉通过佩戴在人体上的摄像头或传感器采集视觉及多模态数据,提供了一种能够模拟人类视觉体验的独特视角。本文对第一视角视觉理解相关研究进行了全面综述,系统分析了第一视角场景的组成,并将相关任务划分为四个主要方向:主体理解、对象理解、环境理解以及混合理解。我们进一步对每个方向下的具体子任务进行了详细梳理,并总结了该领域当前面临的主要挑战与发展趋势。此外,本文还概述了若干高质量的第一视角视觉数据集,为未来研究提供了重要的数据资源参考。通过总结该领域的最新进展,本文展望了第一视角视觉技术在增强现实、虚拟现实以及具身智能等领域的广泛应用,并结合当前研究的发展提出了未来的研究方向。

图片来自Springer

全文下载:

Challenges and Trends in Egocentric Vision: A Survey

Xiang Li, Heqian Qiu, Lanxiao Wang, Hanwen Zhang, Chenghao Qi, Linfeng Han, Huiyu Xiong & Hongliang Li

https://link.springer.com/article/10.1007/s11633-025-1599-4

全文导读

随着人工智能技术的快速发展,计算机视觉领域在近年来取得了显著进展。在这些发展之中,第一视角视觉理解作为一个新兴且具有挑战性的研究方向,正日益受到学术界和产业界的广泛关注。第一视角视觉来源于佩戴在人体上的摄像头或传感器所采集的视觉数据,为机器提供了一种能够模拟人类视觉体验的独特视角,如图1所示。从这一视角获取的数据具有高度的动态性和交互性,能够为多种智能应用提供更加丰富且真实的环境信息。第一视角视觉理解的研究不仅具有重要的理论意义,也展现出广阔的应用前景。从理论层面来看,该领域融合了计算机视觉、机器学习以及认知科学等多学科知识,为探索人类视觉认知机制以及推动机器智能的发展提供了新的研究视角与方法。在实际应用方面,第一视角视觉理解技术已广泛应用于增强现实(AR)、虚拟现实(VR)、智能监控、人机交互以及机器人等领域,为人们的生活和工作带来了极大的便利。

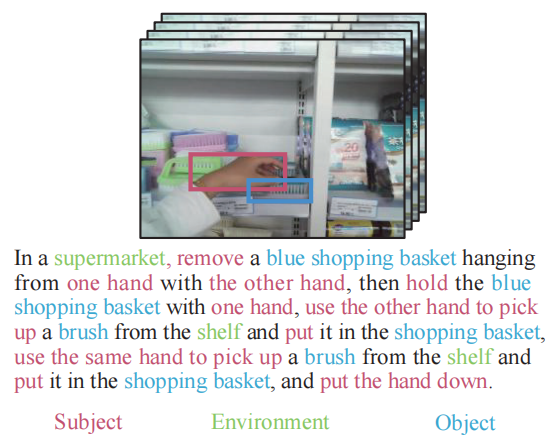

图1 一个第一视角场景示例,展示了一段视频片段及其对应的文本描述。红色文本表示与主体相关的描述,主要聚焦于动作;蓝色文本表示主体所交互的对象;绿色文本则描述了视频所处的环境。

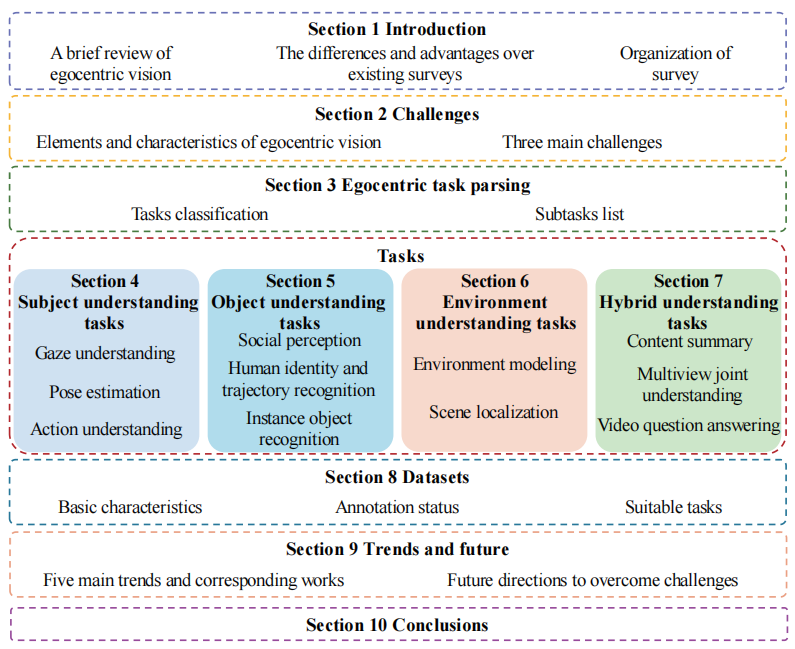

为了更好地支持未来在第一视角领域的研究与发展,本文对该领域近年来(主要是2020年之后)的相关研究工作进行了系统而全面的综述。与以往研究不同的是,本文特别强调了对当前挑战(第2节)的分析,这些挑战源于第一视角视觉本身的复杂性,以及亟待突破的技术瓶颈;同时还梳理了新兴发展趋势(第9节),这些趋势代表了近期研究中为应对上述挑战、推动领域发展的重要方向。Betancourt等人探讨了早期第一人称视角(First-Person Vision, FPV)视频分析的发展历程、主要特征及其面临的挑战。Del Molino 等人总结了第一视角视频摘要领域的相关文献与研究方法。Rodin等人研究了第一视角视觉中的多种预测任务,并对其应用场景、设备类型、现存问题、数据集以及模型进行了综述。Núñez-Marcos 等人回顾了第一视角动作识别的多种方法,并对现有方法提出了详细的分类框架。Bandini 和 Zariffa综述了以“手”为核心的第一视角视觉研究文献,重点总结了相关方法与数据集。Azam 和 Desai旨在系统梳理当前第一视角姿态估计研究的整体发展现状。Fan等人对第一视角手-物体交互相关的基准数据集与方法进行了综述,并总结了该领域面临的主要挑战。Plizzari 等人通过基于角色的叙事方式展望了第一视角技术在多种场景中的未来应用,并进一步综述了相关第一视角任务的研究工作。与上述研究相比,本文的一个重要创新之处在于对第一视角场景进行了系统化的结构拆解。我们将所有相关任务划分为四个主要类别,并根据任务目标的不同,在每个类别下进一步细分为若干子类别。据我们所知,本文是首篇对第一视角场景进行层次化分析的综述性研究。本文的整体结构如图2所示。

图2 本文结构

本文共包含九个部分。第1节对第一视角视觉进行了简要回顾,重点阐述了本文综述与现有其他综述工作的区别,并介绍了论文的整体组织结构。第2节总结了近年来相关研究所面临的主要挑战。第3节将第一视角场景任务拆解为三个关键要素,并分析了各要素的特性,同时将相关子任务划分为四大类别:主体、对象、环境以及混合类别。第4至第7节分别对各大类别下的相关子任务进行了系统梳理与分析。第8节对当前可用于第一视角视觉研究的数据集进行了详细总结。第9节归纳了近年来该领域的主要发展趋势。最后,在第10节中总结了本文的主要贡献,并对第一视角视觉未来的发展方向进行了展望。

结论

本文对第一视角视觉领域进行了系统而全面的综述。从主体、对象、环境以及混合理解四个主要方面出发,对该领域涉及的11类子任务进行了详细梳理。这些子任务包括:注视理解、姿态估计、动作理解、社交感知、人类身份与轨迹识别、物体识别、环境建模、场景定位、内容摘要、多视角联合理解以及视频问答。对于每一类子任务,本文首先给出简要介绍,随后深入分析其所面临的主要挑战。在此基础上,总结了该方向的重要研究工作及其代表性方法,尤其是当前取得最先进性能(SOTA)的相关研究。此外,本文还整理并列出了各子任务可用的相关数据集。

在综述第一视角视觉领域相关研究工作的过程中,本文重点关注了该领域的最新研究进展,并在此基础上总结了当前该领域面临的三大主要挑战。针对这些挑战,我们进一步从近期具有代表性的研究文献中提炼出五个关键的发展趋势。希望通过对这些挑战与趋势的总结,为未来第一视角视觉领域的研究提供方向与启示。此外,本文对第一视角场景的组成进行了系统分析,从而更清晰地刻画第一视角视觉的特点,并进一步明确相关研究的目标。在第一视角数据集方面,本文对21个不同的数据集进行了详细介绍,列出了每个数据集的基本特征及其标注信息,并标明了各数据集所适用的研究任务。随着技术的不断进步以及研究的持续深入,我们相信第一视角视觉领域在未来将迎来更加全面且深入的发展。

全文下载:

Challenges and Trends in Egocentric Vision: A Survey

Xiang Li, Heqian Qiu, Lanxiao Wang, Hanwen Zhang, Chenghao Qi, Linfeng Han, Huiyu Xiong & Hongliang Li

https://link.springer.com/article/10.1007/s11633-025-1599-4

BibTex:

@Article{MIR-2025-03-112,

author={Xiang Li, Heqian Qiu, Lanxiao Wang, Hanwen Zhang, Chenghao Qi, Linfeng Han, Huiyu Xiong, Hongliang Li },

journal={Machine Intelligence Research},

title={Challenges and Trends in Egocentric Vision: A Survey},

year={2026},

volume={23},

issue={1},

pages={1-33},

doi={10.1007/s11633-025-1599-4}}

特别感谢本文第一作者、电子科技大学李响博士对以上内容的审阅和修改!

MIR为所有读者提供免费寄送纸刊服务,如您对本篇文章感兴趣,请点击下方链接填写收件地址,编辑部将尽快为您免费寄送纸版全文!

说明:如遇特殊原因无法寄达的,将推迟邮寄时间,咨询电话010-82544737

收件信息登记:

https://lcn76mgd97vz.feishu.cn/share/base/form/shrcnsQ6cmRjqoxPF5WDowSBFVr

关于Machine Intelligence Research

Machine Intelligence Research(简称MIR,原刊名International Journal of Automation and Computing)由中国科学院自动化研究所主办,于2022年正式出版。MIR立足国内、面向全球,着眼于服务国家战略需求,刊发机器智能领域最新原创研究性论文、综述、评论等,全面报道国际机器智能领域的基础理论和前沿创新研究成果,促进国际学术交流与学科发展,服务国家人工智能科技进步。期刊入选"中国科技期刊卓越行动计划",已被ESCI、EI、Scopus、中国科技核心期刊、CSCD等20余家国际数据库收录,入选图像图形领域期刊分级目录-T2级知名期刊。2022年首个CiteScore分值在计算机科学、工程、数学三大领域的八个子方向排名均跻身Q1区,最佳排名挺进Top 4%,2023年CiteScore分值继续跻身Q1区。2024年获得首个影响因子(IF) 6.4,位列人工智能及自动化&控制系统两个领域JCR Q1区;2025年发布的最新影响因子达8.7,继续跻身JCR Q1区,最佳排名进入全球第6名;2025年一举进入中科院期刊分区表计算机科学二区。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢