当前,轻量级语音模型在处理多语言复杂语境及长篇内容配音时,往往难以兼顾自然度与部署效率。在实际应用中,语音智能体和内容播报不仅需要极高的语言理解力,还要求模型能在本地环境低延迟运行,并支持多语种的无缝切换。这些高要求的落地场景对现有开源模型的参数规模和工程化能力提出了挑战。

目前,HyperAI超神经官网已上线了「Voxtral 4B TTS 2603 多语言语音生成」,快来试试吧~

在线使用:https://go.hyper.ai/AoY2t

3 月 30 日-4 月 5 日,hyper.ai 官网更新速览:

* 优质教程精选:10 个

* 热门百科词条:5 条

* 4 月截稿顶会:6 个

访问官网:hyper.ai

公共教程精选

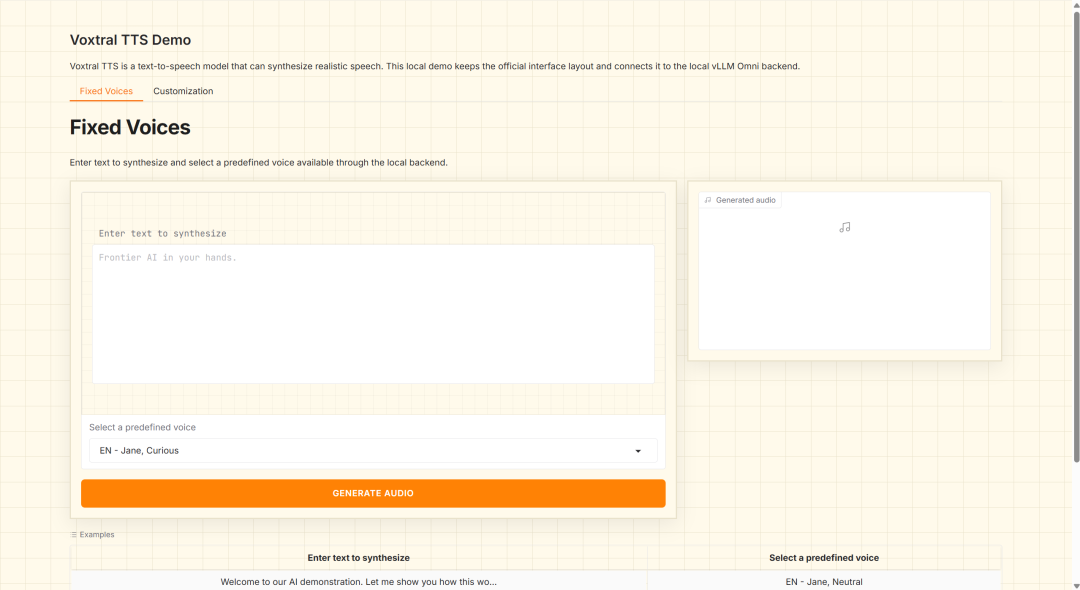

1. Voxtral 4B TTS 2603 多语言语音生成

Voxtral-4B-TTS-2603 是由 Mistral AI 于 2026 年 3 月发布的 4B 级文本转语音(TTS)模型,提供开放权重与多语言语音生成能力,支持将自然语言文本直接合成为可播放的语音音频。该模型面向语音代理、语音播报、内容配音与本地化 TTS 服务等场景,适合以标准化服务接口完成本地部署与调用。

在线运行:https://go.hyper.ai/AoY2t

Demo 页面

2. LingBot-World:开源世界模型

LingBot-World 是一个基于视频生成的开源世界模拟器。作为顶尖的世界模型,它具备高保真环境、长期记忆能力以及实时交互性。LingBot-World 采用了先进的视频生成架构,能够根据输入的图像、文本提示以及摄像机位姿信号(Camera Pose Signals),生成具有时空一致性的高质量视频。

在线运行:https://go.hyper.ai/fzF6R

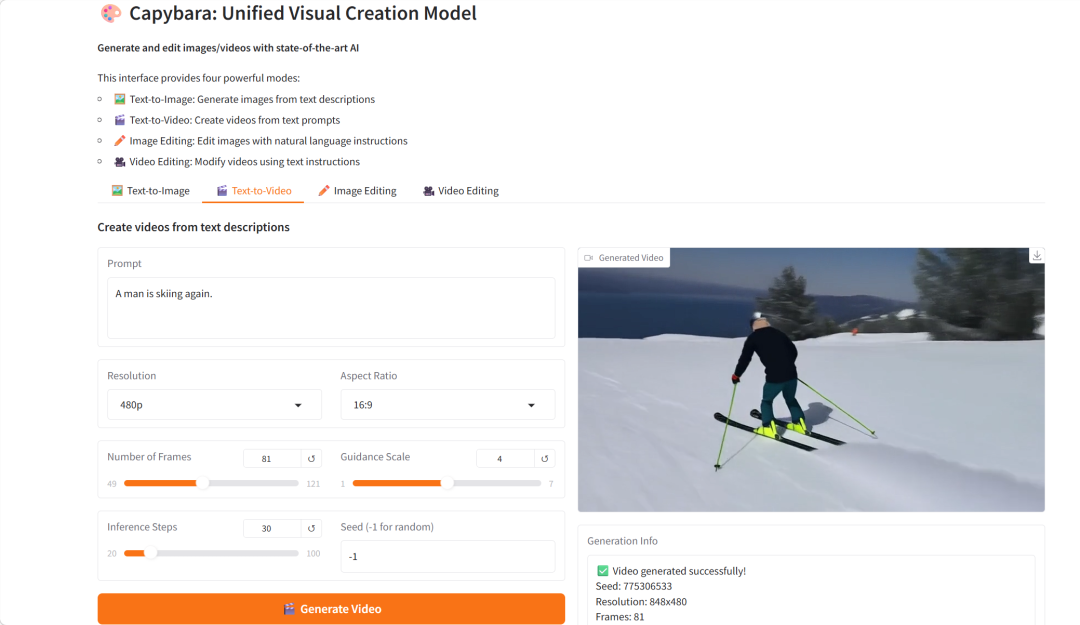

3. Capybara:统一视觉创作模型

Capybara 是由 xgen-universe 团队于 2026 年 2 月发布的一个统一视觉创作模型,旨在完成各种视觉创作任务,包括文本生成图像、文本生成视频、基于指令的图像编辑以及基于指令的视频编辑。Capybara 基于先进的扩散模型和 Transformer 架构构建,目标是提供一个统一且高效的视觉生成与编辑框架。

在线运行:https://go.hyper.ai/yX0Pc

Demo 页面

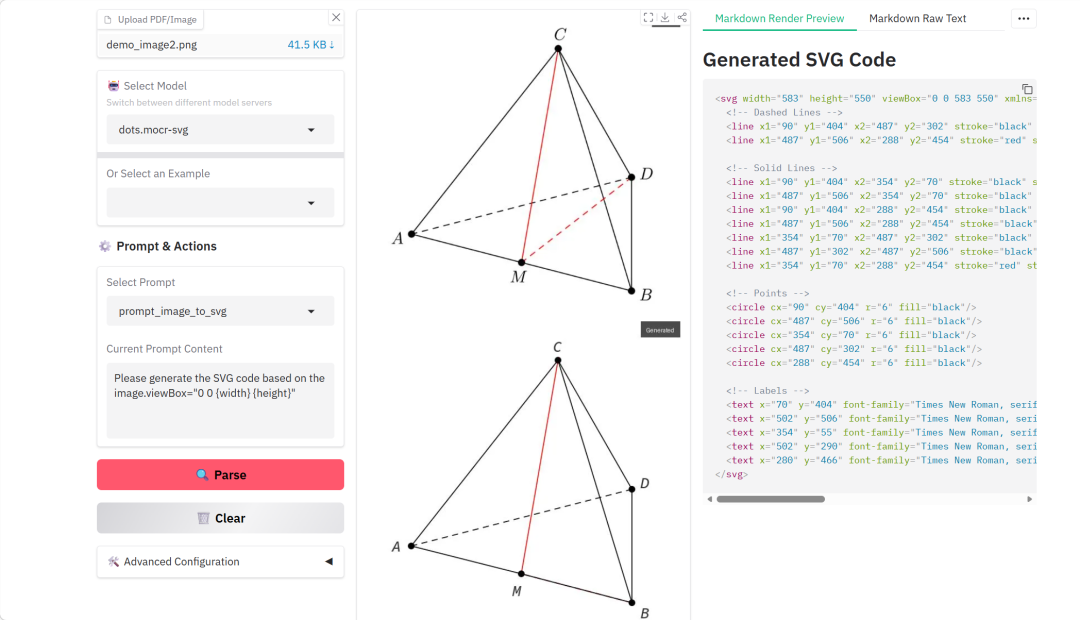

4. dots.mocr 多模态文档解析教程

dots.mocr 是由华中科技大学与小红书 HI-Lab 于 2026 年 3 月联合发布的一种多模态 OCR 文档解析模型。在同等规模的模型中,它在标准多语言文档解析任务上达到了当前最先进(SOTA的性能。除了文档解析之外,dots.mocr 还擅长将结构化图形(例如图表、UI 布局、科学图示等)直接转换为 SVG 代码。

在线运行:https://go.hyper.ai/g2oB3

Demo 页面

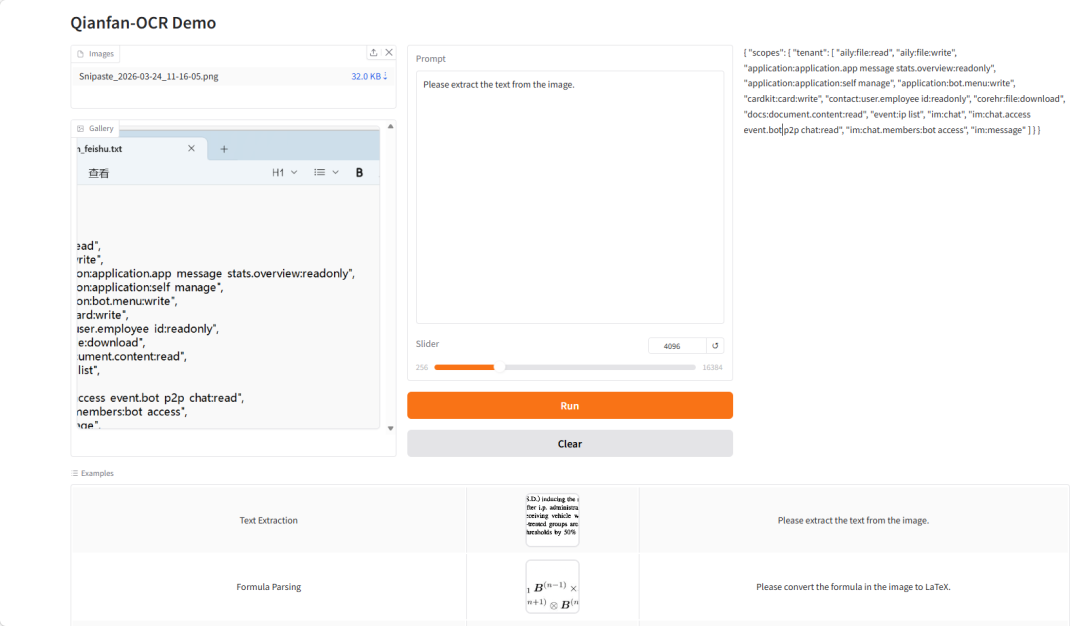

5. Qianfan-OCR:端到端文档智能模型

Qianfan-OCR 是百度智能云千帆于 2026 年 3 月开源的端到端文档智能模型,基于 4B 参数视觉语言架构,融合文档解析、版面分析、文字识别与语义理解。其核心创新在于 Layout-as-Thought 机制:模型在生成结果前进入「思考阶段」,通过显式建模文档结构(如元素位置、类型与阅读顺序),再完成整体解析,从而在统一框架下兼顾结构感知与语义理解,提升复杂文档场景的准确性与稳定性。

在线运行:https://go.hyper.ai/WZIRF

Demo 页面

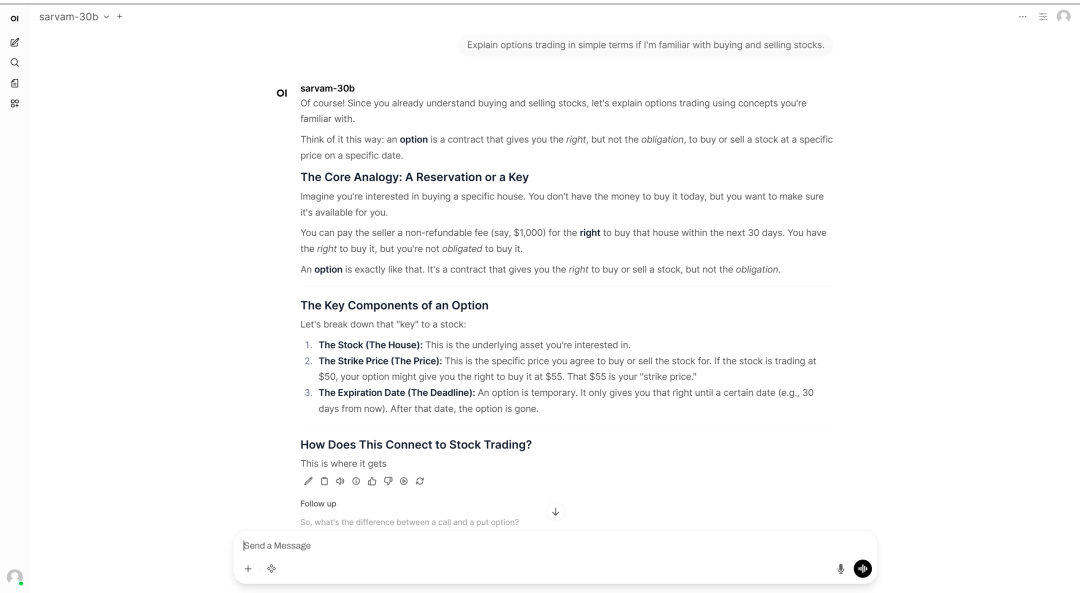

6. vLLM + Open WebUI 部署 sarvam-30b

Sarvam-30B 是由 Sarvam AI 于 2026 年 3 月推出的开源大语言模型。作为 Sarvam 最新开源模型系列中的 30B 版本,它采用 Mixture-of-Experts(MoE)架构,总参数规模为 30B、每 token 激活参数约为 2.4B,面向多语言对话、推理、编码与实际部署场景进行了系统优化。

在线运行:https://go.hyper.ai/UUJWe

Demo 页面

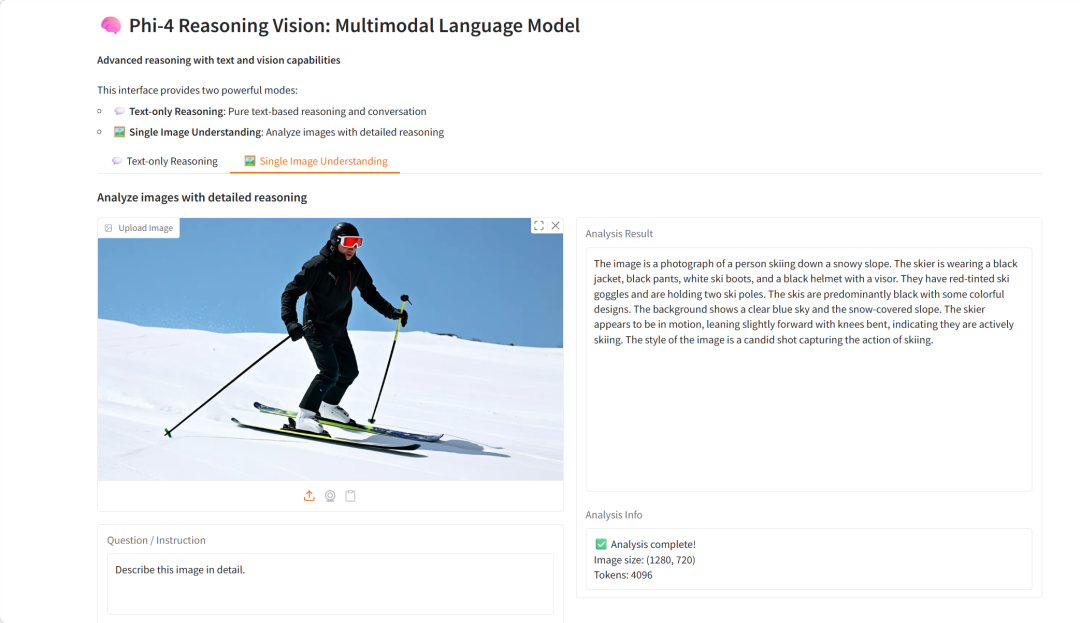

7. Phi-4-reasoning-vision-15B 多模态推理视觉模型 Demo

Phi-4-reasoning-vision-15B 是微软于 2026 年 3 月发布的 150 亿参数多模态推理视觉语言模型。该模型基于 Phi-4 架构,结合了强大的文本推理能力和视觉理解能力,能够处理复杂的图文推理任务。

在线运行:https://go.hyper.ai/JQlDE

Demo 页面

8. Slime:为 RL Scaling 设计的 SGLang-Native 后训练框架

Slime 是清华大学知识工程实验室(THUDM)发布的专为强化学习扩展设计的 LLM 后训练框架。该框架通过连接 Megatron 与 SGLang,实现了高性能训练与灵活数据生成的完美结合。

在线运行:https://go.hyper.ai/Xrxev

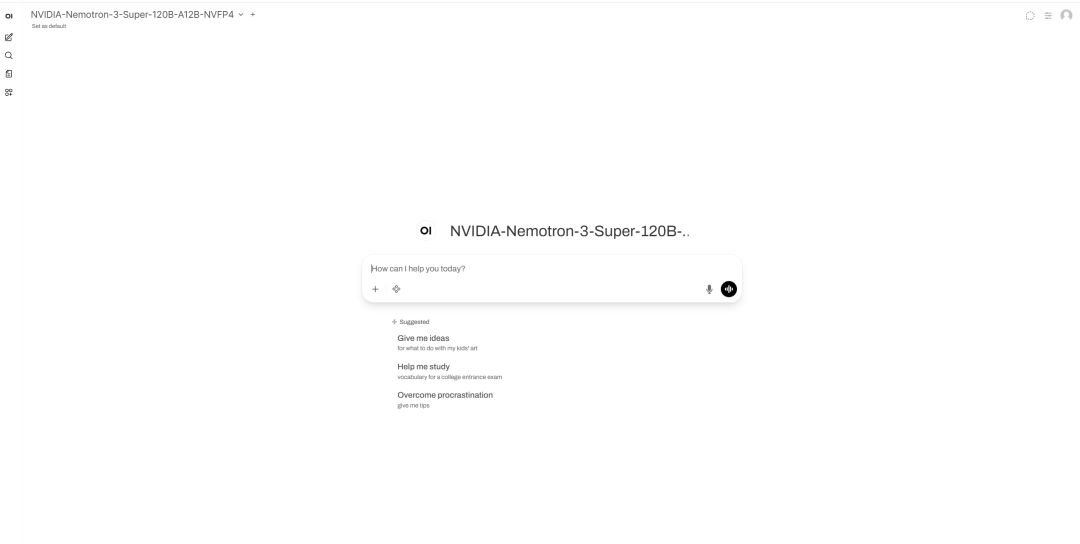

9. 一键部署 NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4

NVIDIA Nemotron 3 Super NVFP4 由 NVIDIA Corporation 在 2026 年 3 月发布。该模型是一个 120B 总参数、12B 激活参数的大语言模型,采用 LatentMoE 混合架构,并支持最长 1M tokens 上下文。该模型面向长上下文推理、Agent 工作流、工具调用、RAG 与高吞吐问答等场景。在交互方式上,模型同时支持是否启用 reasoning 模式,并可以通过标准化聊天模板参数在普通问答与推理增强模式之间切换。

在线运行:https://go.hyper.ai/WJmbe

Demo 页面

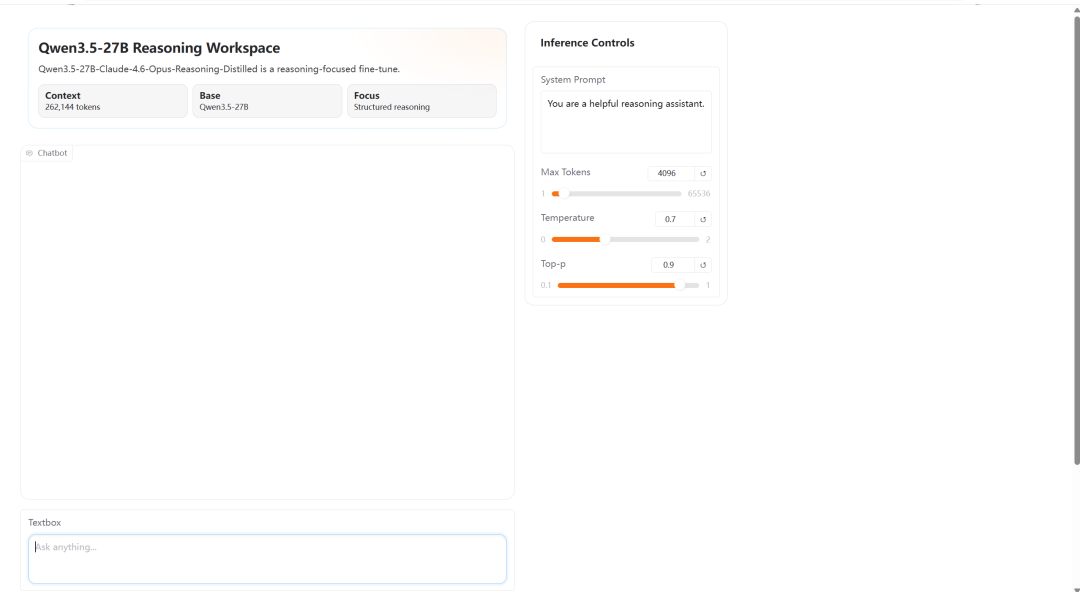

10.一键部署 Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled

Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled 是由 Jackrong 于 2026 年 3 月基于 Qwen3.5-27B 基座模型,融合 Claude-4.6 和 Opus 推理能力进行知识蒸馏后得到的高性能对话模型。该模型在保持原有语言理解能力的基础上,显著增强了复杂推理能力和对话交互体验。

在线运行:https://go.hyper.ai/SNlOk

Demo 页面

💡我们还建立了 Stable Diffusion 教程交流群,欢迎小伙伴们扫码备注【SD教程】,入群探讨各类技术问题、分享应用效果~

热门百科词条精选

1. 倒数排序融合 RRF

2. 人工神经网络 NNs

3. 视觉语言模型 VLM

4. 旋转位置编码 RoPE

5. 双向长短期记忆 Bi-LSTM

这里汇编了数百条 AI 相关词条,让你在这里读懂「人工智能」:

https://go.hyper.ai/wiki

4 月截稿顶会

4 月 08 日

11:59:59

MICRO 2026

4 月 09 日

19:59:59

SC 2026

4 月 17 日

11:59:59

NSDI 2027

4 月 18 日

19:59:59

SIGMOD 2027

4 月 30 日

00:00:00

CCS 2026

一站式追踪人工智能学术顶会:https://go.hyper.ai/event

以上就是本周编辑精选的全部内容,如果你有想要收录 hyper.ai 官方网站的资源,也欢迎留言或投稿告诉我们哦!

下周再见!

关于 HyperAI超神经 (hyper.ai)

HyperAI超神经 (hyper.ai) 是国内领先的人工智能及高性能计算社区,致力于成为国内数据科学领域的基础设施,为国内开发者提供丰富、优质的公共资源,截至目前已经:

* 为 2100+ 公开数据集提供国内加速下载节点

* 收录 700+ 经典及流行在线教程

* 解读 300+ AI4Science 论文案例

* 支持 700+ 相关词条查询

* 托管国内首个完整的 Apache TVM 中文文档

访问官网开启学习之旅:

https://hyper.ai/

以上就是本周编辑精选的全部内容,如果你有想要收录 hyper.ai 官方网站的资源,也欢迎留言或投稿告诉我们哦!

下周再见!

最后推荐一个「创作者激励计划」,感兴趣的小伙伴扫码即可参与!

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢