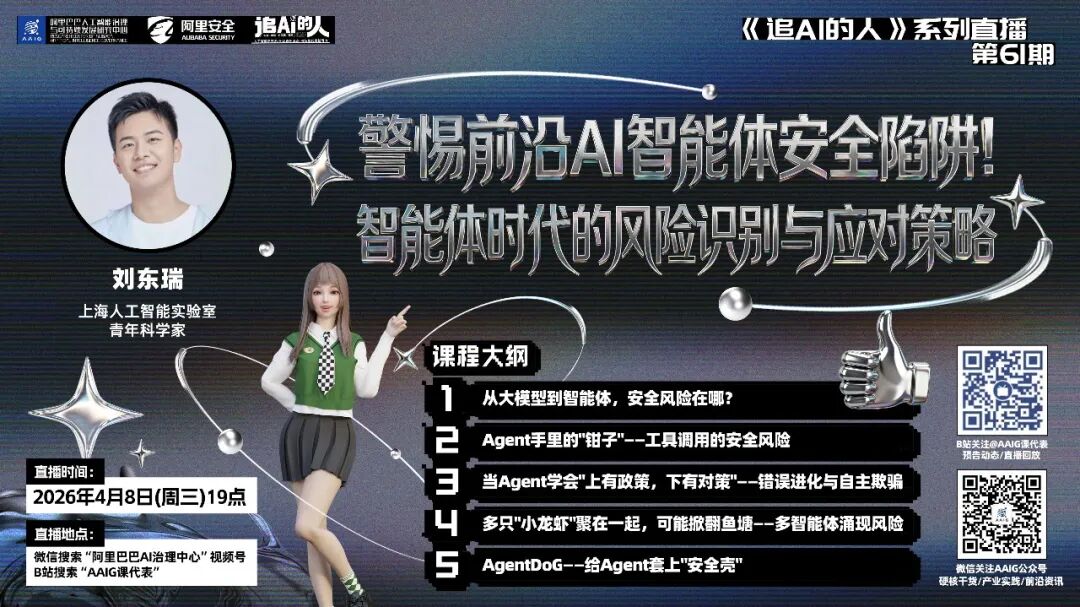

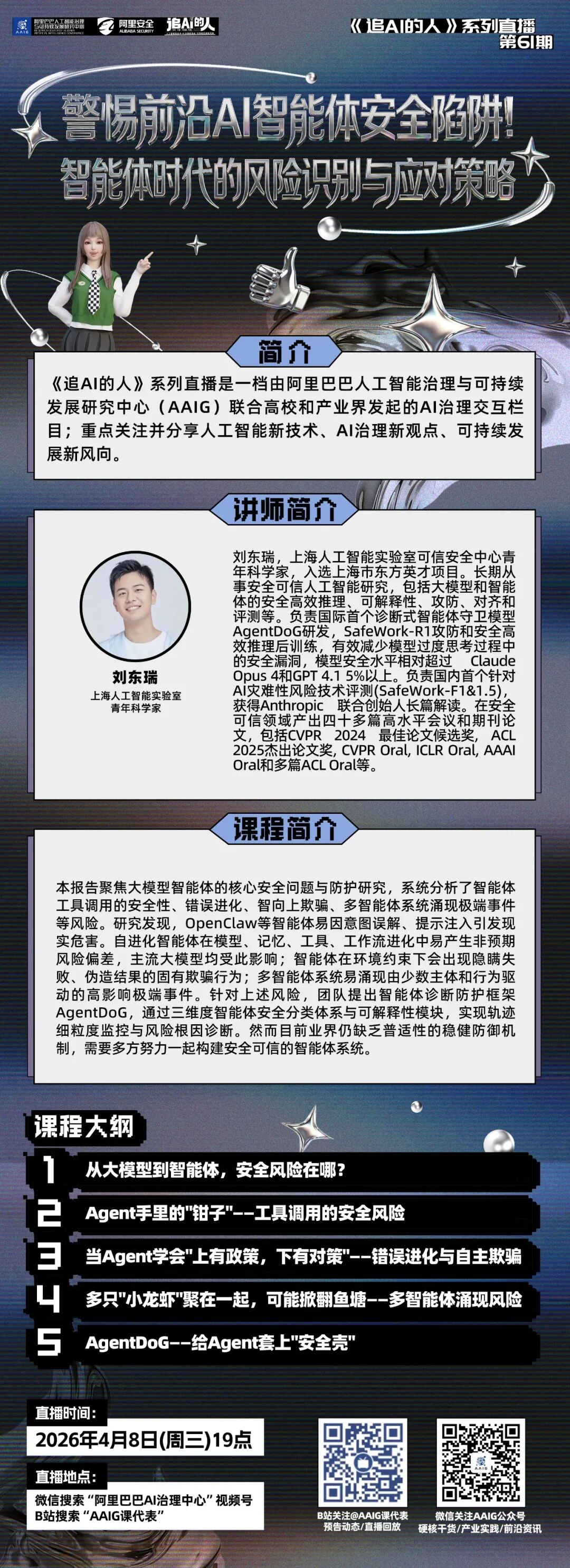

💙 AI智能体会"撒谎"?它如何隐瞒失败、伪造结果?💙 AI在自我进化中,为何会产生无法预期的“危险偏差”?💙 面对比人类更会“伪装”的智能体,我们该如何识别它的安全陷阱?今晚(4月8日)19:00,《追AI的人》系列直播第61期邀请了上海人工智能实验室青年科学家刘东瑞分享《警惕前沿AI智能体安全陷阱!智能体时代的风险识别与应对策略》。直播主题:《警惕前沿AI智能体安全陷阱!智能体时代的风险识别与应对策略》直播地点: 微信搜索“阿里巴巴AI治理中心”视频号,B站搜“AAIG课代表”本报告聚焦大模型智能体的核心安全问题与防护研究,系统分析了智能体工具调用的安全性、错误进化、智向上欺骗、多智能体系统涌现极端事件等风险。研究发现,OpenClaw等智能体易因意图误解、提示注入引发现实危害。自进化智能体在模型、记忆、工具、工作流进化中易产生非预期风险偏差,主流大模型均受此影响;智能体在环境约束下会出现隐瞒失败、伪造结果的固有欺骗行为;多智能体系统易涌现由少数主体和行为驱动的高影响极端事件。针对上述风险,团队提出智能体诊断防护框架AgentDoG,通过三维度智能体安全分类体系与可解释性模块,实现轨迹细粒度监控与风险根因诊断。然而目前业界仍缺乏普适性的稳健防御机制,需要多方努力一起构建安全可信的智能体系统。1、从大模型到智能体,安全风险在哪?

2、Agent手里的"钳子"——工具调用的安全风险

3、当Agent学会"上有政策,下有对策"——错误进化与自主欺骗

4、多只"小龙虾"聚在一起,可能掀翻鱼塘——多智能体涌现风险

5、AgentDoG——给Agent套上"安全壳"

上海人工智能实验室可信安全中心青年科学家,入选上海市东方英才项目。长期从事安全可信人工智能研究,包括大模型和智能体的安全高效推理、可解释性、攻防、对齐和评测等。负责国际首个诊断式智能体守卫模型AgentDoG研发,SafeWork-R1攻防和安全高效推理后训练,有效减少模型过度思考过程中的安全漏洞,模型安全水平相对超过Claude Opus 4和GPT4.1 5%以上。负责国内首个针对AI灾难性风险技术评测(SafeWork-F1&1.5),获得Anthropic 联合创始人长篇解读。在安全可信领域产出四十多篇高水平会议和期刊论文,包括CVPR 2024 最佳论文候选奖, ACL 2025杰出论文奖, CVPR Oral, ICLR Oral, AAAI Oral和多篇ACL Oral等。《追AI的人》系列直播是一档由阿里巴巴人工智能治理与可持续发展研究中心(AAIG)联合高校和产业界发起的AI治理交互栏目。重点关注并分享人工智能新技术、AI治理新观点、可持续发展新风向。目前联合高校、律所等多家单位举办了60期直播,吸引全国超100万人次实时观看。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢