01

研究动机

现有研究已经指出大语言模型(Large Language Models, LLMs)在监督微调(Supervised Fine-Tuning, SFT)过程中学习新知识会导致其出现事实性幻觉问题[1],表现为在验证集上对原本已知的知识出现幻觉回答。例如,当询问Qwen2.5-1.5B模型“What kind of work does Terry Jones do?”时,模型本来可以回答正确答案“Actor”;而当经过一些其他的“人物-工作”数据微调之后,模型对上述问题的回答就变成了“Comedian”。在微调过程中并未引入新的任务,幻觉回答的产生仅仅由新知识的学习造成。

但现有研究尚有诸多不足:(1)仅将所有知识类别混合训练与测试,并未深入探讨该现象在不同知识类型上的表现及相互影响;(2)仅在知识问答任务上进行研究,并未探讨不同任务类型之间的相互影响;(3)对事实性幻觉问题的分析停留在现象层面,未能深入分析其内在机制。

本文利用精心构造的合成数据微调并测试,以尝试探究事实性幻觉在不同知识类型之间、不同任务之间的具体表现,并尝试对其产生机理进行探究。

【该工作由南京大学自然语言处理研究组、华为翻译服务中心合作完成,论文地址:https://arxiv.org/abs/2511.02626,项目代码:https://github.com/NJUNLP/New-Knowledge-Induced-Factual-Hallucinations】

02

研究方法

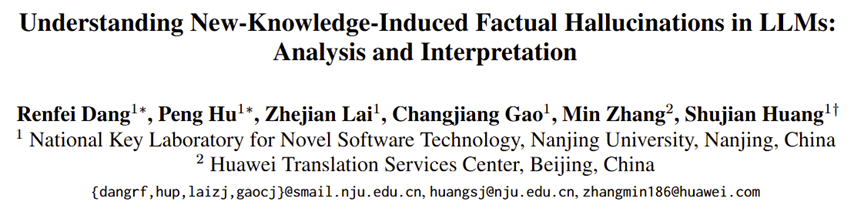

为了构建完全未知的知识以准确分析,本研究参考相关工作[2]通过构造可控的合成数据集Biography-Reasoning用于微调和测试,分析LLMs在学习新知识时产生的幻觉问题。该数据集以虚拟人物为关键实体,为每个人物构造传记。每人具有四个属性:Birth、Death、Major、University;每个属性可以对应构造一个知识问答任务和三个推理任务,包括单人物属性推理(Single Reasoning)、两个人物同一属性的比较推理(Comparative Reasoning)、新定义的推理(Novel-Reasoning)。该数据集可以使得不同知识类别(人物属性)可以单独学习和评估;同时涉及了事实性知识任务中最常见的知识问答和知识推理任务;过程中可以混合不同知识类别、任务类型、未知数据比例。下表示例为数据集中人物“Darreus Hsiao”的Major属性构造的问题。

表1:Biography-Reasoning 数据集示例

我们将数据集划分为三个部分:保留一部分作为“未知知识”;将一部分人物及其属性作为传记,通过继续预训练(Continued PreTrain, CPT)让模型提前掌握,作为“已知知识”;最后一部分同样通过CPT让模型掌握,作为测试集。

我们在Qwen2.5-1.5B、Llama3.2-1B、Qwen3-8B-Base、Qwen2.5-32B模型上都进行了实验;实验分别测试了训练1、3、5、20轮SFT的设置。正文主要汇报Qwen2.5-1.5B上SFT训练3轮的结论,而结论在所有其他设置上基本一致。评测中使用Exact Match评判回答正确与否,如果模型在测试集上性能下降,我们认为其是由于学习新知识造成的事实性幻觉。

03

事实性幻觉现象

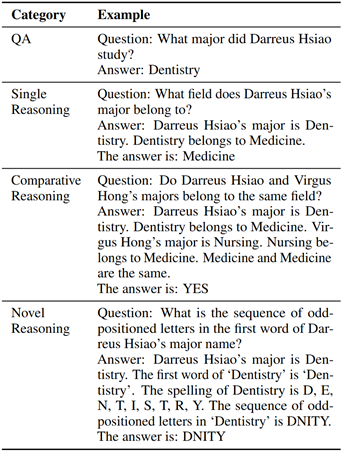

为了探究知识问答任务中的事实性幻觉在不同知识类别之间的影响,我们分别训练:(1)基准模型:所有四个知识类别全部用等量已知知识;(2)变体模型:某一知识类别的知识替换为未知知识。衡量以下几个测试集组,变体模型相对于基准模型的性能下降比例:(a)Same-Type QA (STQA):与未知知识同类别的问答测试集;(b)Different-Type QA (DTQA):与未知知识不同类别的测试集;(c)wiki[3]:真实的领域外知识问答测试集。

根据表2的结果,我们发现学习新知识对同类别测试集影响巨大,性能下降超过54%;同时影响其他知识类别:由于DTQA有已知训练知识,性能下降仅2.67%,而在领域外的未经训练的知识上性能下降17.72%。

表2:学习新知识对不同知识类别的影响

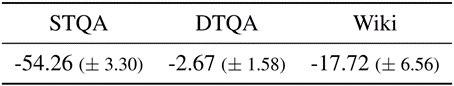

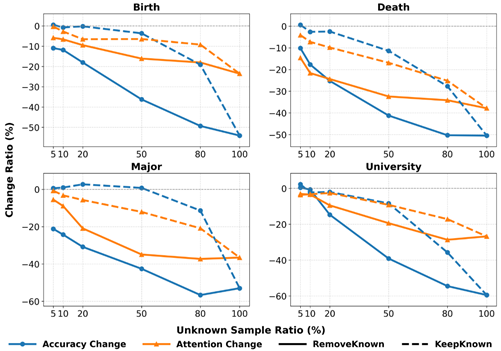

进一步以四种知识类别全为已知的训练集为基础,替换某一知识类别的5%、10%、20%、50%、80%、100%为未知知识,探究未知知识比例对幻觉的影响。对于该类别剩余的知识,考虑两种设定:(1)KeepKnown(虚线),保留剩余已知知识;RemoveKnown(实线),丢弃剩余知识。

根据图1的结果,我们发现未知知识占比越高,幻觉越严重;且当一类知识全部未知的时候幻觉更严重。

图1:不同未知知识占比造成的幻觉影响

为了探究幻觉在不同任务类型上的影响,我们分别训练:(1)基准模型:混合四个知识类别的12个推理任务和4个问答任务,全部由已知知识构造;(2)变体模型:将其中一个推理任务涉及的知识全部替换为未知知识。我们衡量以下几个测试集组,变体模型相对于基准模型的性能下降比例:

1.Same-Type Same-Reasoning (STSR):同种知识的同推理任

2.Same-Type Different-Reasoning (STDR):同种知识的不同推理任

3.Different-Type Different-Reasoning (DTDR):不同知识的不同推理任务

4.Same-Type QA (STQA):同种知识的问答任务

5.Different-Type QA (DTQA):不同种知识的问答任务

6.wiki:领域外知识问答测试集

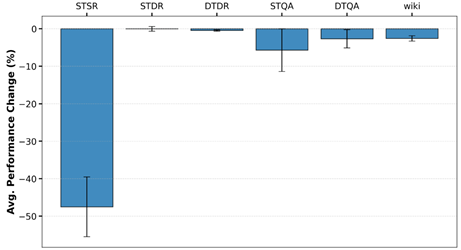

图2:幻觉在不同任务类型上的影响

根据图2中的结果,我们可以发现学习带有新知识的推理任务同样造成在所有测试集组上的性能下降。事实性幻觉在相同知识相同任务的测试集上最显著,而在其他测试集中,问答测试集(STQA/DTQA/wiki)的性能下降比看似更接近的其他推理任务(STDR/DTDR)更严重。

04

可解释性研究

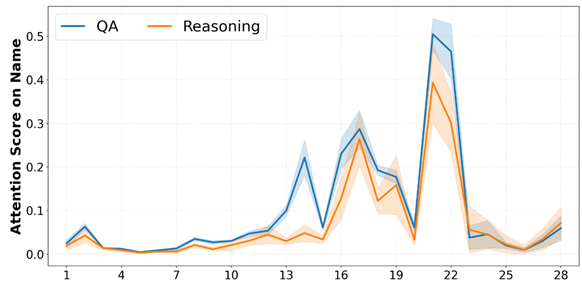

我们首先通过分析注意力分数的变化来研究事实性幻觉产生时的内在机制。具体而言,我们分析模型输出知识时,对问题关键实体的注意力分数变化。例如,问题“What major did Darreus Hsiao study?”中,“Darreus Hsiao”就是问题关键实体。根据模型每一层对关键实体的注意力分数变化图(图3),后面的分析选取12-24层的平均注意力值。

图3:模型逐层对关键实体的注意力分数变化

图4:不同未知知识占比对应注意力变化

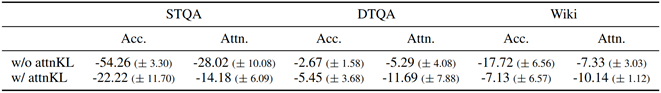

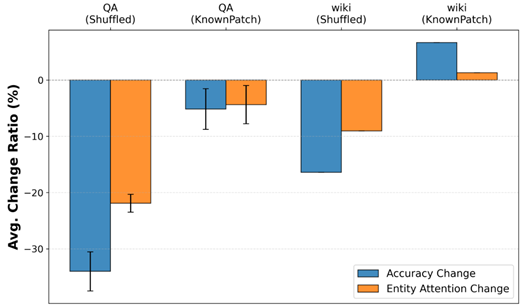

对于未知知识占比的幻觉实验(上文图1),我们分析其注意力变化,结果如图4所示。我们发现对关键实体的注意力分数与幻觉程度高度相关,而且某一类别全部为未知知识时(RemoveKnown)下降更明显。进一步我们尝试在学习新知识的时候加入一个额外的KL损失约束所有层的注意力模块输出与训练前的模型保持一致,从表3可以看出,约束注意力变化之后在STQA和Wiki两个测试集上幻觉程度明显减轻,这一定程度上说明了模型注意力模式和事实性幻觉的因果关系。

表3:约束注意力训练的性能

此外,如果在学习已知知识(基准模型)的时候加入该KL约束,在所有测试集上平均有3.67%的性能下降和9.21%的注意力下降,说明模型学习包含已知知识的任务时,倾向于增加分配给问题关键实体的注意力,因此约束注意力不变的时候,该指标降低、性能下降。我们尝试调整训练数据的顺序,将同时包含已知知识和未知知识的数据集中,少部分已知知识移到训练数据的最后,以恢复模型的注意力。我们模拟最差情况,除了最后的20%已知知识,其余80%都为未知知识。该设置的性能上界是以等量全部已知知识构造的数据训练。图5中,将构造的四个知识QA问题统称为QA、单独观察真实数据wiki,我们发现该方法大幅缓解了注意力的下降程度和幻觉程度。

图5:将已知知识移到训练最后的幻觉程度

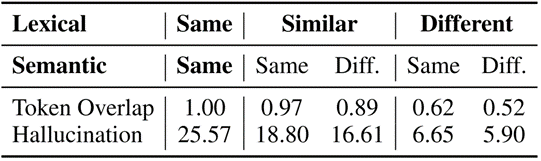

最后,我们探究幻觉的跨任务传播机制。图2发现推理任务中学习新知识,对QA任务的幻觉影响反而大于对推理任务的幻觉影响。我们认为QA任务更像推理任务的“子任务”,具有更高的上下文相似度,而图4和表3均说明对关键实体的注意力减少,即对其他问题上下文的关注度提升,会造成幻觉问题。我们认为:上下文相似度可能与幻觉跨任务传播相关。为了验证这一猜想,设置了分离上下文的“词汇(lexical)”相似度和“语义(semantic)”相似度的实验:给12个推理任务中的每一个构造词汇上相似/不同、语义上相同/不同变体任务,具体示例如下:

1. 原题:How many years apart is the birth year between Darreus Hsiao and Graicyn Xian?

2. 词汇相似、语义相同:How many years is the birth year between Hakam Cheng and Graicyn Xian apart?

3. 词汇相似、语义不同:How many months apart is the birth year between Hakam Cheng and Graicyn Xian?

4. 词汇不同、语义相同:By what number of years are Hakam Cheng and Graicyn Xian separated in terms of their birth years?

5. 词汇不同、语义不同:Is the number of Hakam Cheng’s birth year an odd number?

混合原始任务和它的四种变体训练,计算原始任务包含未知知识相较于包含已知知识,在这五个任务的测试集上的性能下降比例,结果在表4中展示。我们可以发现,词汇相似度相比语义相似度,更加促进幻觉的传播。

表4:幻觉传播机制分析

05

总结

通过构造可控的数据集Biography-Reasoning,我们可以探究LLMs学习新知识造成的幻觉具体表现:(1)高未知比例的单一知识类型会引发较强幻觉;(2)在单一任务上学习新知识也会对其它任务产生影响。

同时我们进行幻觉问题的可解释性研究:(3)问题关键实体的注意力下降与幻觉程度高度相关;(4)训练后期引入少量已知知识可以简单有效地缓解幻觉问题;(5)词汇上更相似的上下文导致幻觉在不同任务间传播。

06

参考文献

[1] Does Fine-Tuning LLMs on New Knowledge Encourage Hallucinations? Gekhman et al., EMNLP 2024

[2] Physics of Language Models: Part 3.1, Knowledge Storage and Extraction. Allen-Zhu and Li, ICML 2024

[3] Simple Entity-Centric Questions Challenge Dense Retrievers. Sciavolino et al., EMNLP 2021

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢