点击蓝字

关注我们

2026年4月,斯坦福大学以人为本人工智能研究所(Stanford HAI)发布了第九版《人工智能指数报告》(Artificial Intelligence Index Report 2026)。该报告全文423页,涵盖研发、技术性能、负责任AI、经济、科学、医学、教育、政策与治理以及公众舆论9大章节,是目前全球范围内覆盖面最广、数据来源最独立的AI年度追踪报告之一。报告指导委员会由斯坦福大学Yolanda Gil和SRI International的Raymond Perrault联合主持,成员包括来自斯坦福、Anthropic、OECD、Google等机构的学者与业界人士。本文对报告的15项核心发现及各章节关键信息进行客观编译与摘要。

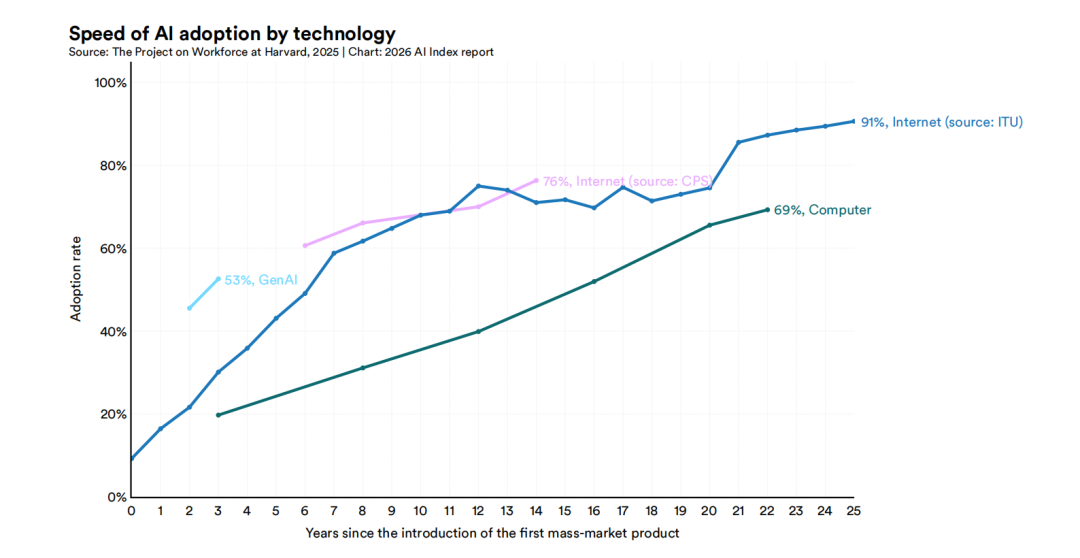

数据表明,AI技术并未触及所谓的发展“瓶颈期”,反而正以史无前例的速度在多模态推理、科学发现和复杂任务执行上逼近或超越人类基线。与此同时,生成式AI在短短三年内实现了53%的全球人口级渗透,普及速度超越了个人电脑与互联网。

然而,在技术狂飙的背面,报告揭示了一个深刻的系统性矛盾:人类评估、监管和适应AI的能力,已显著滞后于技术自身的扩张步伐。以下是本文对报告提炼出的核心速看:

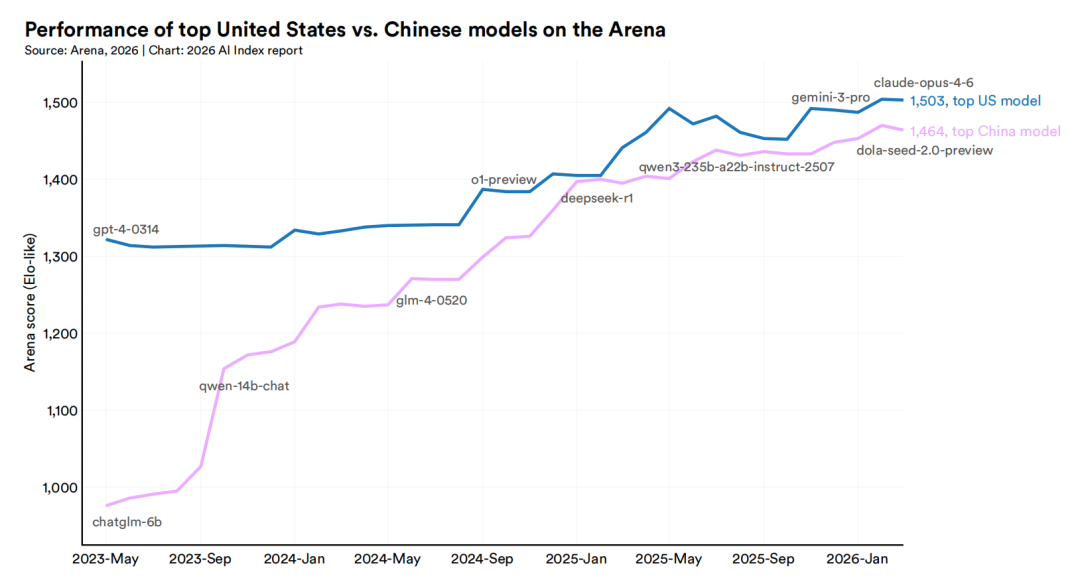

中美AI模型性能差距已基本消失:2025年2月DeepSeek-R1短暂追平美国顶尖模型,截至2026年3月美国领先优势仅剩2.7%。

生成式AI三年渗透率达53%,速度超PC和互联网:但美国采用率仅排全球第24位,中国职场AI使用率已超80%。

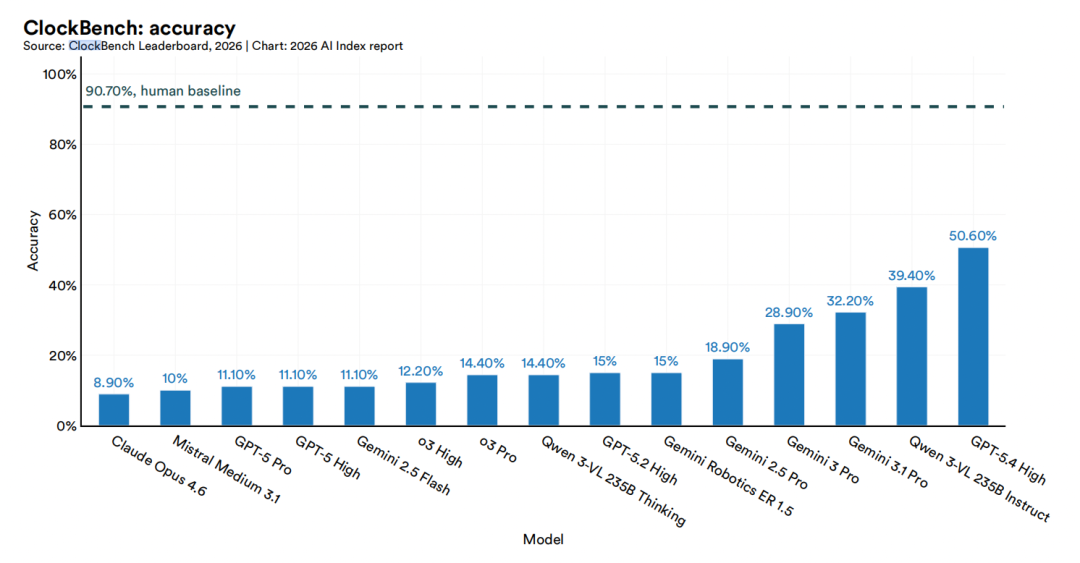

AI能拿奥数金牌,却看不懂时钟:顶尖模型读取模拟时钟的正确率仅为50.6%,凸显AI能力的“锯齿状前沿”。

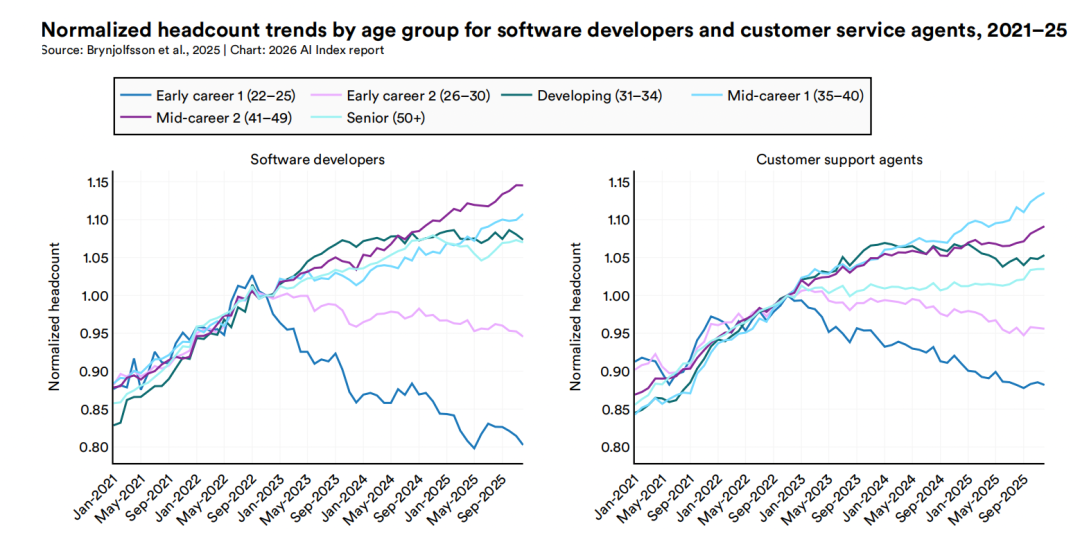

年轻开发者就业首当其冲:美国22-25岁软件开发者就业自2024年以来下降近20%,而年长开发者仍在增长。

最强模型正变得最不透明:2025年95个前沿模型中80个未公开训练代码,基础模型透明度指数不升反降。

美国AI投资全球第一,但人才吸引力锐减:迁入美国的AI研究者7年下降89%,仅去年一年就下降80%。

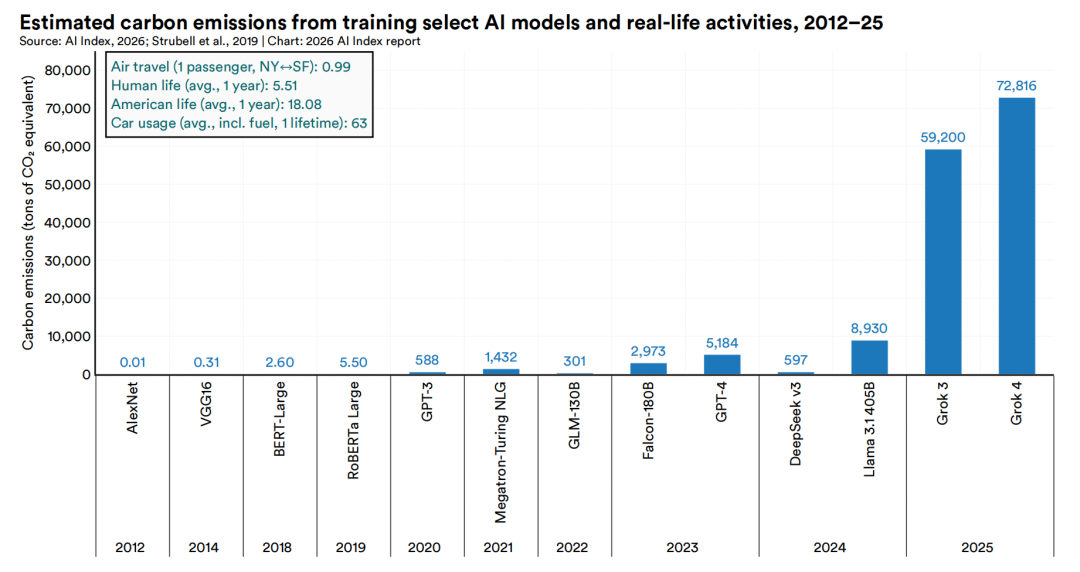

AI环境足迹持续扩大:Grok 4单次训练碳排放超7万吨,GPT-4o年用水量可供应1200万人饮用。

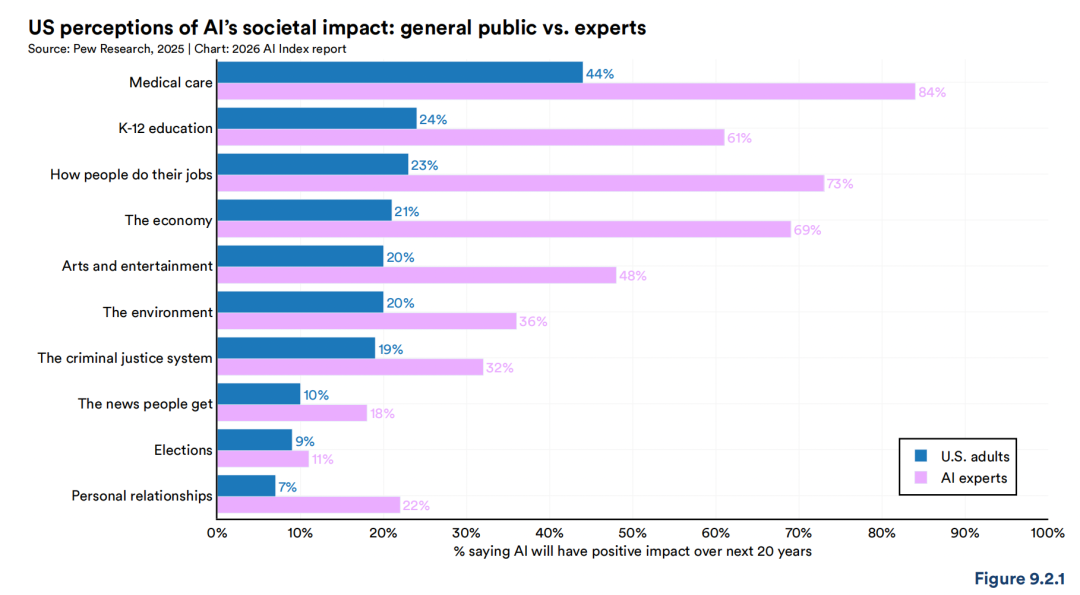

专家与公众对AI未来看法严重分裂:73%专家认为AI将积极改善工作方式,而公众仅23%持同样观点。

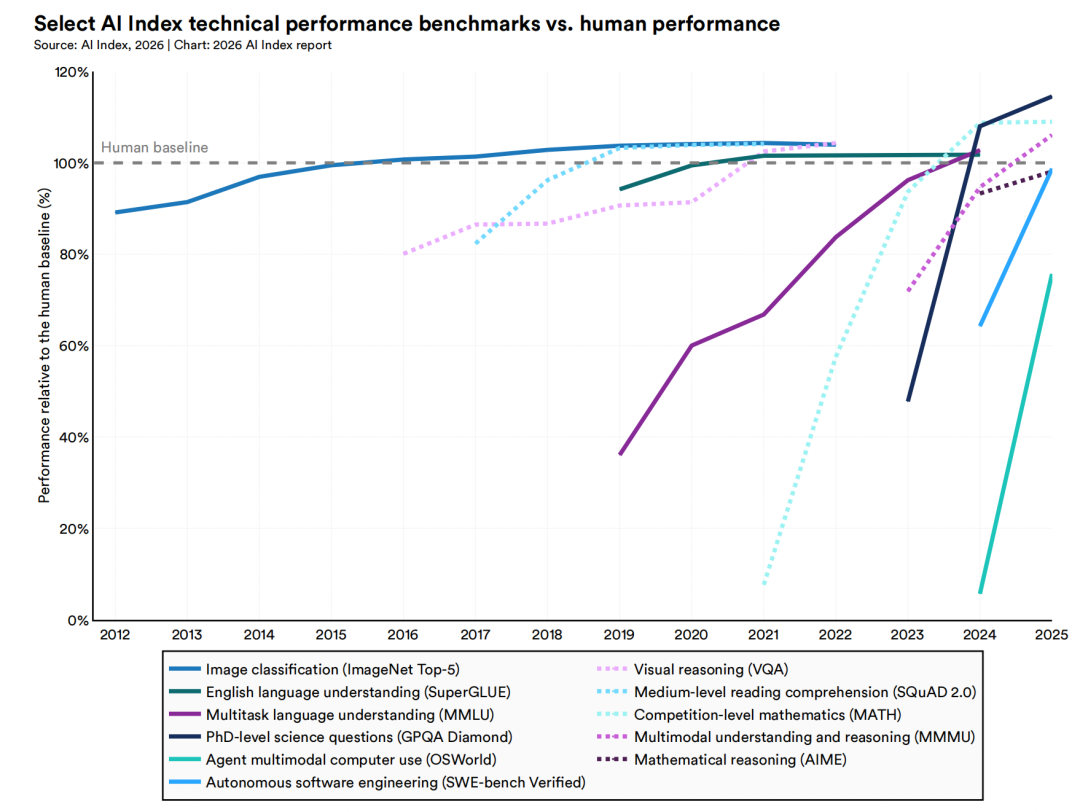

报告指出,AI能力并未出现外界部分讨论中提及的“平台期”,而是在加速发展并触及更多人群。2025年,产业界贡献了超过90%的前沿模型。在多项基准测试中,若干前沿模型已达到或超过人类基线水平,包括博士级科学问答、多模态推理和数学竞赛等领域。在关键编码基准SWE-bench Verified上,性能在一年内从达到人类基线的60%提升至接近100%。

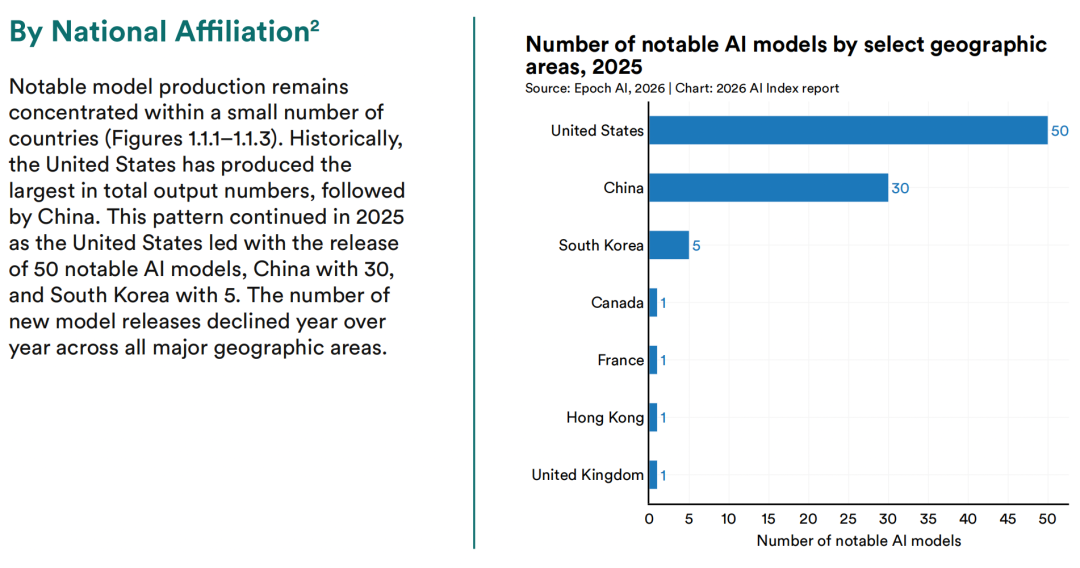

报告特别关注了中美AI模型性能差距的变化。报告的数据显示,自2025年初以来,美国和中国的模型多次交替领先。2025年2月,DeepSeek-R1短暂追平了当时表现最好的美国模型;截至2026年3月,Anthropic的顶级模型仅领先2.7%。报告同时指出,美国在顶级AI模型数量和高影响力专利方面保持优势,而中国在论文数量、引用份额、专利授权数量和工业机器人安装量方面处于领先。韩国则以人均AI专利数量居全球首位,在创新密度方面表现突出。

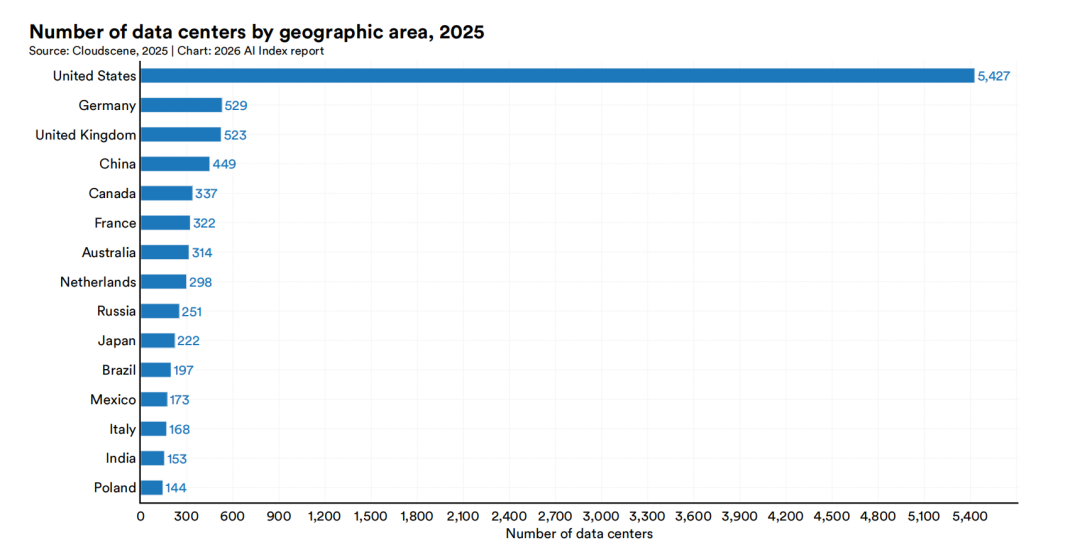

报告指出,美国拥有5,427个数据中心,是其他任何国家的10倍以上,能源消耗也居全球首位。然而,几乎所有领先的AI芯片均由台湾地区的台积电(TSMC)一家代工厂制造,使得全球AI硬件供应链高度依赖单一制造节点。报告提及,台积电在美国的扩产项目已于2025年开始运营。AI模型所需的算力自2022年以来以每年约3.3倍的速度增长,但这些算力几乎全部流经同一家芯片代工厂。

报告揭示了AI能力发展中的一个显著特征——研究者将其称为“锯齿前沿”(jagged frontier)。一方面,Gemini Deep Think在国际数学奥林匹克竞赛(IMO)中获得金牌级成绩;另一方面,表现最好的模型在读取模拟时钟时的准确率仅为50.6%。AI智能体在OSWorld(跨操作系统的真实计算机任务测试)上的任务成功率从12%跃升至约66%,但在结构化基准测试中仍有约三分之一的尝试失败。在物理世界交互方面,机器人在家庭任务中的成功率仅为12%,尽管在软件模拟环境(RLBench)中的成功率已达89.4%。

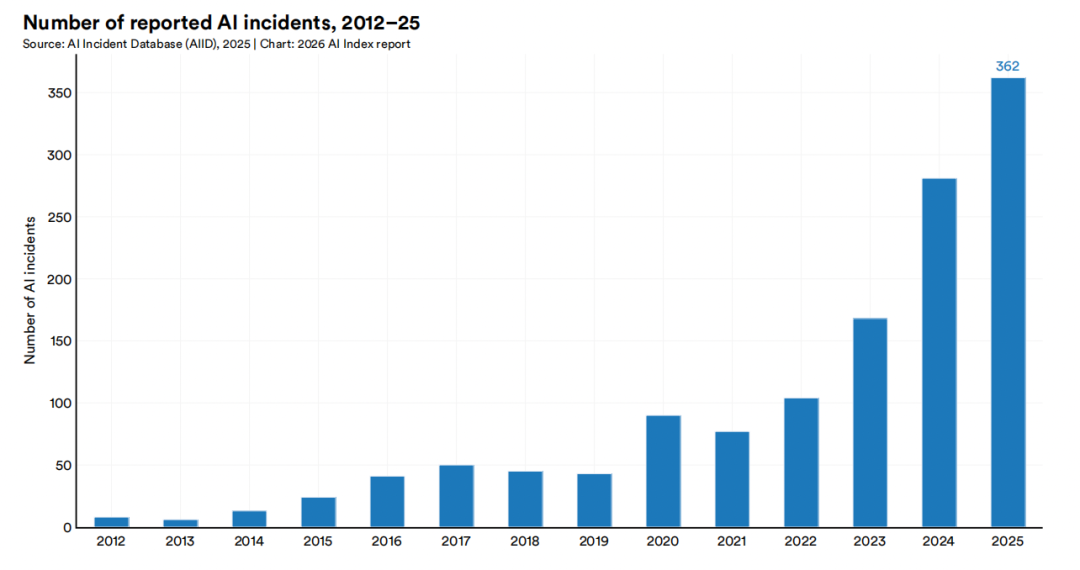

报告指出,几乎所有主要前沿模型开发者都会报告能力基准测试结果,但在负责任AI基准方面的报告仍不完整。记录在案的AI事件从2024年的233起上升至362起。基础模型透明度在2024年有所改善后于2025年出现下降。报告援引的研究发现,改善负责任AI的某一维度(如安全性)可能导致另一维度(如准确性)退化,而目前尚无框架来指导这些权衡取舍。在公平性、隐私和可解释性等维度上,追踪长期进展所需的标准化数据尚不存在。

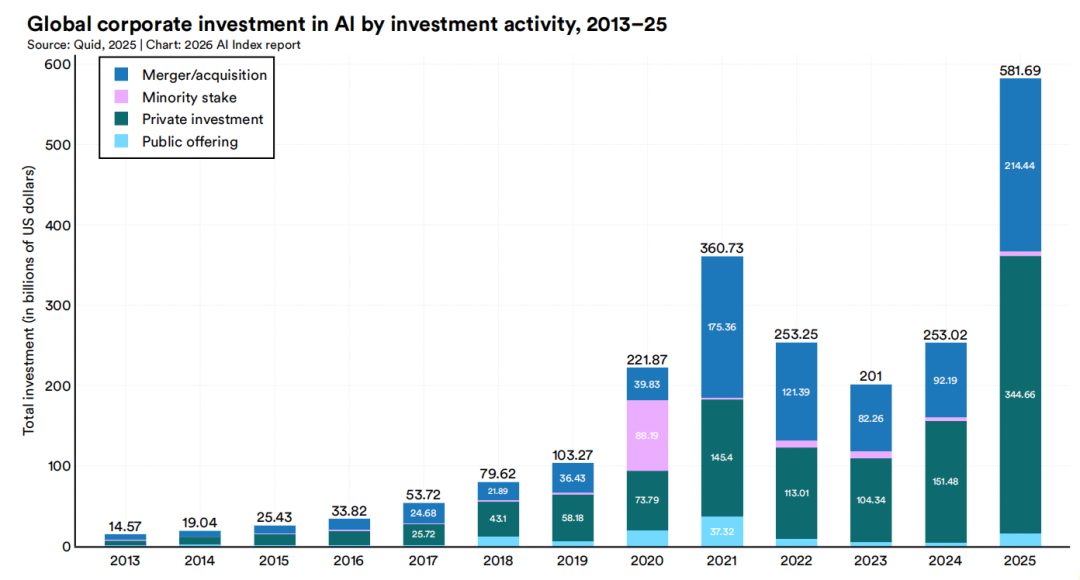

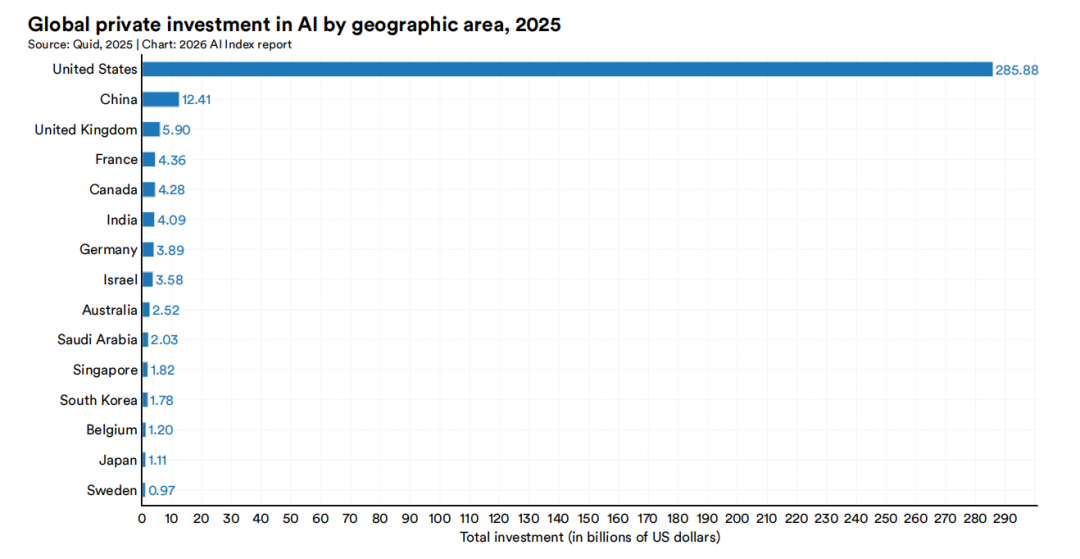

经济数据是本版报告的重点之一。2025年美国AI私人投资达到2,859亿美元,是中国124亿美元的23倍以上——但报告同时指出,仅看私人投资数字可能低估了中国的AI总投入,因为中国的政府引导基金未被计入。美国在2025年新增1,953家获得融资的AI公司,是第二名国家的10倍以上。全球企业AI投资在2025年增长超过一倍。

在采纳速度方面,生成式AI在三年内达到约53%的人口级采纳率,超过了个人电脑和互联网的同期表现,但各国差异显著且与人均GDP强相关。部分国家表现出高于预期的采纳率,如新加坡(61%)和阿联酋(54%),而美国以28.3%排在第24位。到2026年初,生成式AI工具为美国消费者创造的估计年价值达到1,720亿美元,每位用户的中位价值在2025年至2026年间增长了两倍。组织层面的AI采纳率达到88%,五分之四的大学生使用生成式AI。

报告关注了AI对劳动力市场的影响。研究显示,在客户支持和软件开发领域,AI带来的生产力提升在14%至26%之间,但在需要更多判断力的任务中效果较弱甚至为负。AI智能体的部署在几乎所有业务职能中仍处于个位数比例。值得注意的是,在AI可测量的生产力提升最为明显的软件开发领域,美国22至25岁的开发者就业人数自2024年以来下降了近20%,而年长开发者的人数仍在增长。报告并未对此做出因果判断,但将其列为需要关注的信号。

报告提供了AI环境影响的最新数据。Grok 4的估计训练排放达到72,816吨二氧化碳当量。AI数据中心电力容量升至29.6吉瓦(GW),相当于纽约州峰值需求时的用电量。仅GPT-4o推理的年用水量就可能超过1,200万人的饮用水需求。

报告首次将科学和医学单独设章,反映AI在这两个领域影响力的增长。在科学领域,前沿模型在化学基准(ChemBench)上平均超越人类化学家,但在天体物理学的论文复现任务中得分低于20%,在地球观测问题上仅为33%。值得注意的是,参数量较小但专业化的模型在部分任务中表现优于大型通用模型:一个1.11亿参数的蛋白质语言模型(MSAPairformer)在ProteinGym上击败了此前的领先方法;一个2亿参数的基因组学模型(GPN-Star)超越了一个体量近200倍的模型。大多数科学领域的AI基础模型来自跨部门合作,与通用AI领域由产业界主导的格局形成对比。

在医学领域,自动生成临床笔记的AI工具(如环境AI录入系统)在2025年获得了显著采纳。多个医院系统报告医生撰写笔记时间减少高达83%,职业倦怠感也有显著缓解。但报告同时指出,临床AI的证据基础仍然薄弱:对500多项临床AI研究的审查发现,近一半依赖考试式问题而非真实患者数据,仅5%使用了真实临床数据。FDA对AI医疗设备的授权数量有所增加,但临床证据继续滞后。

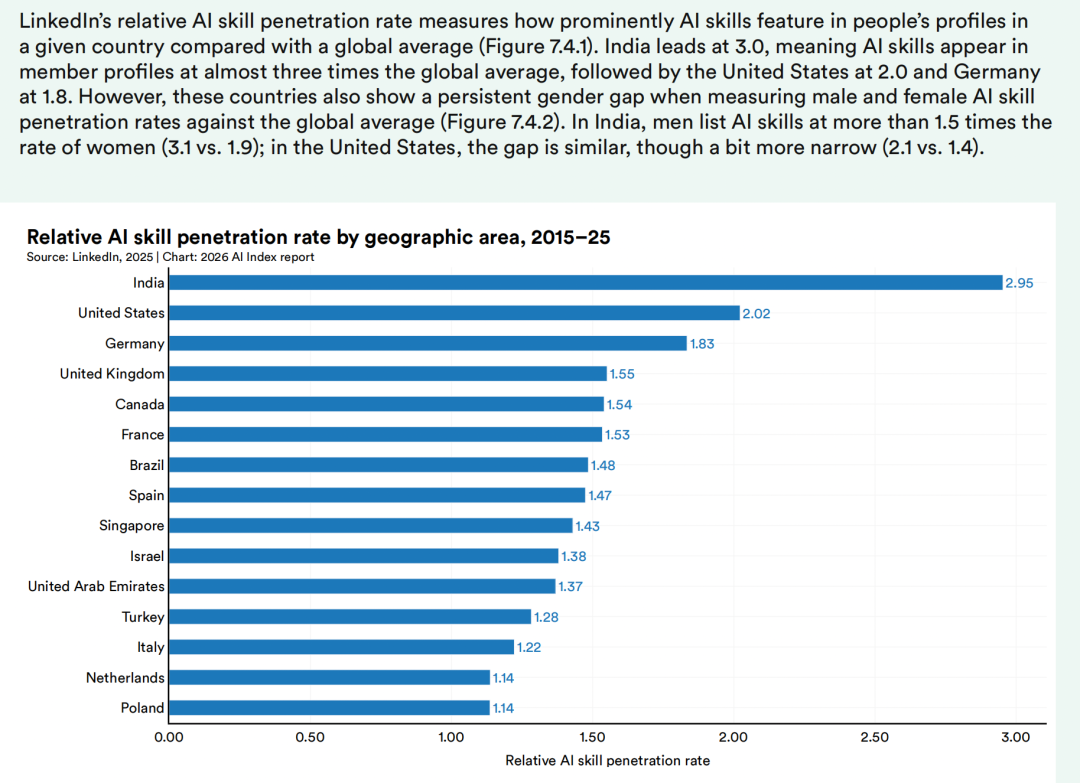

报告指出,超过80%的美国高中生和大学生使用AI完成学业相关任务,但只有一半的中学有AI使用政策,仅6%的教师认为这些政策清晰。在课堂之外,AI工程技能增长最快的国家是阿联酋、智利和南非。2022年至2024年间,美国和加拿大新增AI博士人数增长了22%,且这些新增博士进入了学术界而非产业界。

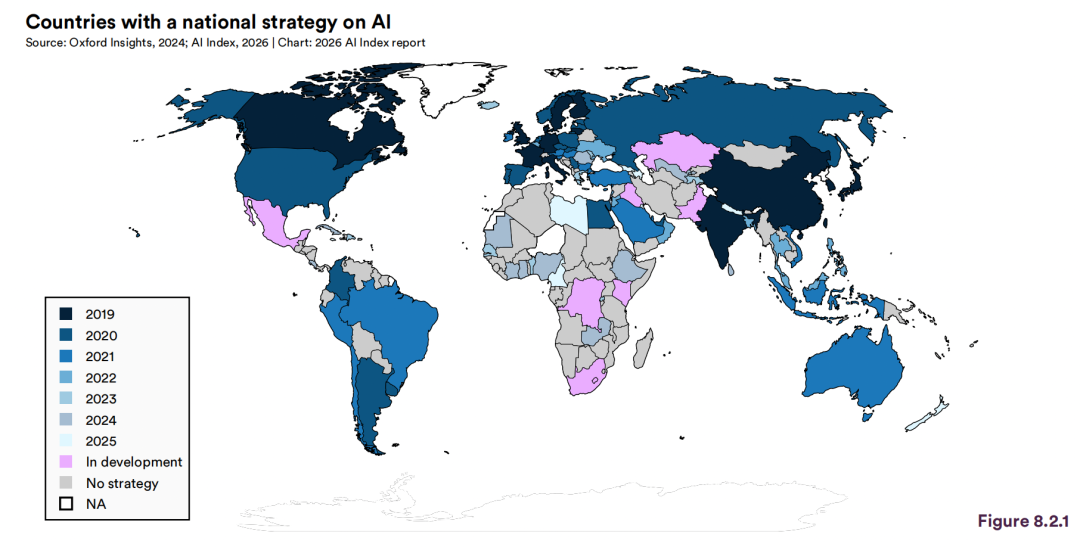

报告追踪了全球AI政策走向。2025年,欧盟AI法案的首批禁止条款生效,而美国联邦层面则转向去监管方向。日本、韩国和意大利各自通过了国家级AI法律。新采纳国家AI战略的国家中,超过一半来自发展中经济体。“AI主权”(AI sovereignty)成为各国政策的核心组织原则,报告从基础设施主权、数据主权、模型主权、应用主权和人才主权五个维度提出了分析框架。然而,前沿模型的开发和大规模算力仍然集中在少数国家。开源开发开始重新分配参与权——来自其他国家的GitHub贡献已超越欧洲,正在接近美国的水平。

在美国国内,联邦政策向去监管转变的同时,各州通过的AI相关法案数量创下历史新高。报告还追踪了美国AI人才吸引力的下降:迁入美国的AI研究人员和开发者人数自2017年以来下降了89%,仅在过去一年就下降了80%。

报告通过对30多个国家的多项大规模调查数据进行汇总分析,揭示了AI领域专家与普通公众之间的认知差距。在AI对就业的影响方面,73%的专家预期正面影响,而公众中持此观点的仅为23%,差距达50个百分点。类似的分歧也出现在对经济和医疗领域影响的看法上。在对政府AI监管的信任度方面,美国在受调查国家中报告了最低的政府监管信任度(31%)。全球范围内,欧盟在AI监管方面获得的信任度高于美国和中国。东南亚国家在对AI的乐观程度和对本国政府的信任度方面均最高。

斯坦福大学2026年AI指数报告描绘了一幅关于人工智能发展的复杂图景。报告最核心的贡献,在于系统性地揭示了技术能力与其治理、评估、理解体系之间的系统性差距。

报告传递出三个层次递进的信息:

第一,AI能力仍在快速提升,且正在以前所未有的速度扩散到经济和社会的各个角落。产业主导、投资激增、采用加速,标志着AI已从“前沿探索”进入“规模化落地”阶段。

第二,衡量和管理AI的体系正在被技术甩在身后。基准测试饱和、负责任AI报告稀疏、透明度下降、专家与公众认知鸿沟扩大,都指向同一个问题:我们评估、理解和治理AI的能力,未能跟上AI本身的发展速度。

第三,AI对劳动力市场的初期影响已显现,且呈现出“代际不公”的特征。初级岗位和年轻工作者首当其冲,就业通道收窄、早期职业积累机会被剥夺。这要求政策干预必须超越传统的“低技能保护”,转向更具针对性的“职业生命周期”支持。

本报告提示各方关注以下几点核心判断:

其一,AI评估体系需要根本性改革。从“绝对准确率”转向“模态依赖度”,从“静态基准”转向“动态、私有、证书级”评估,从“AI孤立测试”转向“人机协作评估”。

其二,负责任AI必须成为与能力开发同等优先的事项。透明度需要成为强制性要求,安全基准需要更广泛地报告,而不同负责任AI维度之间的权衡需要被系统性地研究和管理。

其三,AI对就业的影响不是均匀分布的,最脆弱的群体是处于职业起点的年轻人。针对他们的职业路径规划、技能培训干预和就业通道保护,应被优先纳入政策议程。

总体而言,这份报告所呈现的,是一个正在经历“落地考验”的AI世界:技术在实验室和基准测试中取得了令人眩目的进步,但在真实世界的复杂性面前,在治理框架的适应性面前,在社会理解的鸿沟面前,仍有漫长的路要走。正如报告所指出的——我们无法测量的东西,与我们能够测量的东西同等重要。

编辑|徐赫泽

审核|赵杨博

终审|梁正 王净宇

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢