新智元报道

新智元报道

【新智元导读】有人还在拼模型「想得更聪明」,SimpleTES 用21项硬核结果证明:AI科研真正的跃迁,不在更会思考,而在把「试错—反馈—进化」这条发现机器无限放大。

过去一年,AI圈最疯狂的一个执念,就是让模型想得更久一点。

参数更大,推理更长,链路更深——仿佛只要模型足够聪明,科学发现迟早会像答题一样,被它一步步「想出来」。

但现在,一篇论文狠狠给了这个共识一闷棍。

来自宽德智能学习实验室(Will)、斯坦福大学、北京大学、清华大学和香港科技大学(广州)的研究团队,提出了一个名字不算响亮,但野心极大的框架——SimpleTES(Simple Test-time Evaluation-driven Scaling)。

目前,基于 SimpleTES 方法构建的试用平台已经在Will官网上线,前往申请加入就能体验这一全新的科学范式。

项目主页:https://www.wizardquant.com/will/SimpleTES

代码开源:https://github.com/Wizard-Intelligence-Learning-Lab/SimpleTES

SimpleTES发现:AI做科研,光靠「脑子大」不够。

真正厉害的,是把「试错」这件事本身,系统化地放大。

这有多猛?

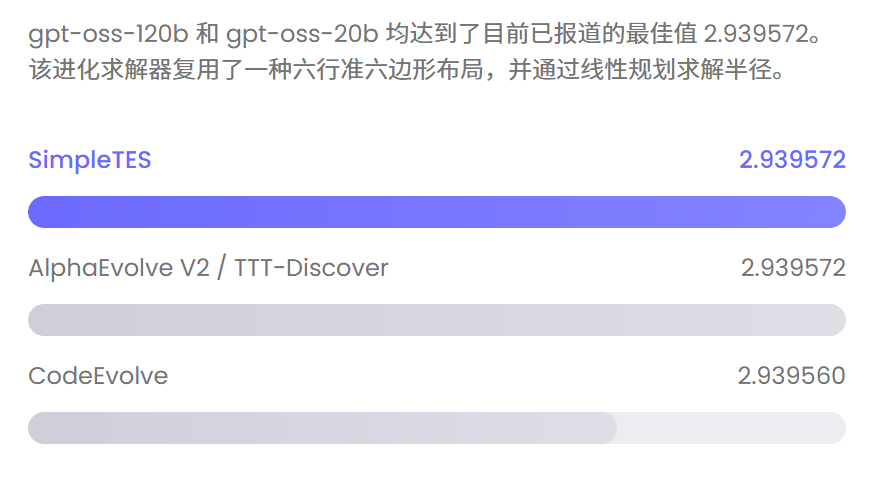

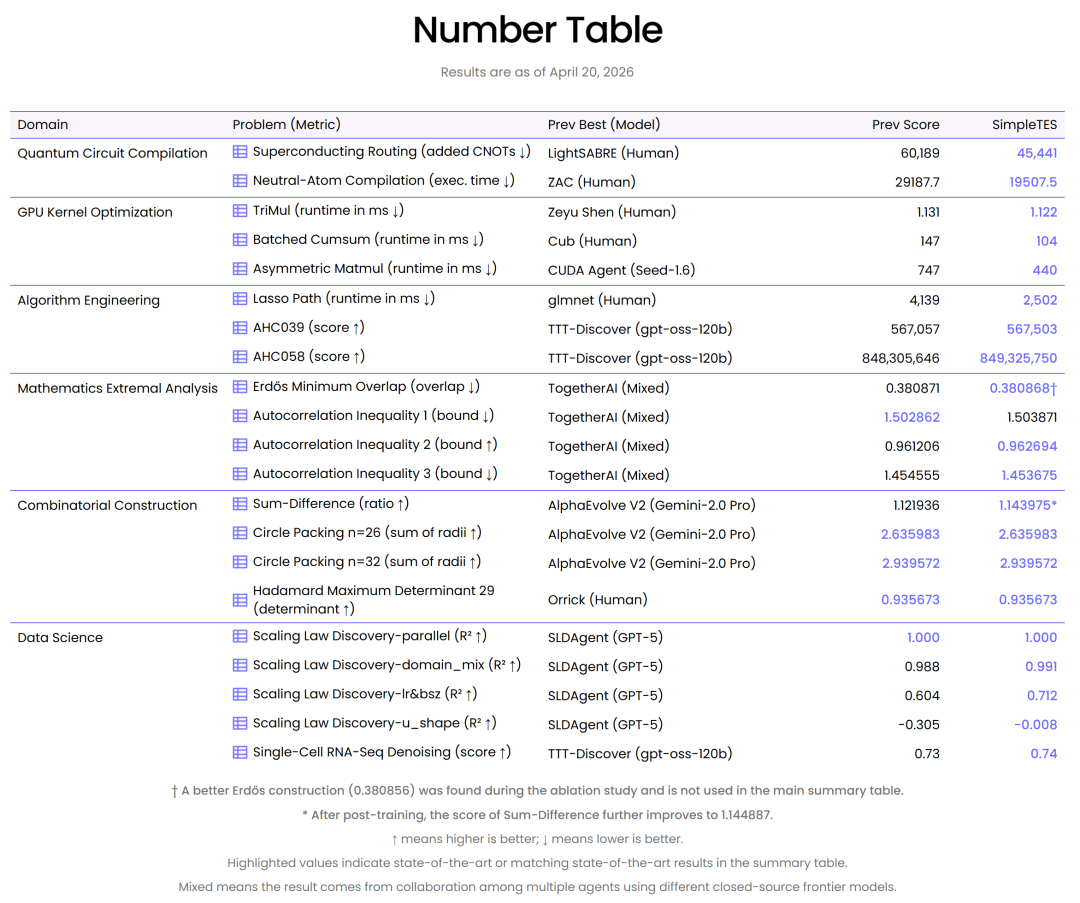

在涵盖六个领域的21个科学问题上,SimpleTES(运行于开源gpt-oss模型)发现了当前最先进的解决方案,持续超越前沿闭源模型基线和精心调优的优化流程。

我们来看几个例子感受一下。

先看一个超级有意思的数学问题——圆填充。

在单位正方形内放置 n 个互不重叠的圆,使其半径之和最大,所有圆不能重叠也不能超出边界。

这个问题听着像小学数学,实际上是组合优化领域的经典噩梦——圆一多起来,排列组合的可能性爆炸式增长,连专业数学家都只能一点点逼近最优解。

SimpleTES在n=26和n=32两个规模上,双双刷新了已知最佳纪录。

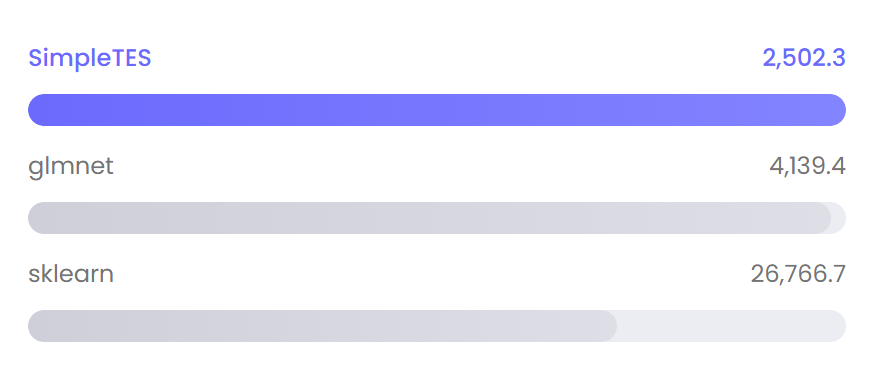

经典的LASSO算法路径求解,几十年来被无数专家反复打磨,SimpleTES用一个开源模型,硬生生把速度提升了超过2倍——

不是微调参数的小优化,而是发现了一种全新的混合算法策略。

基因测序方面。

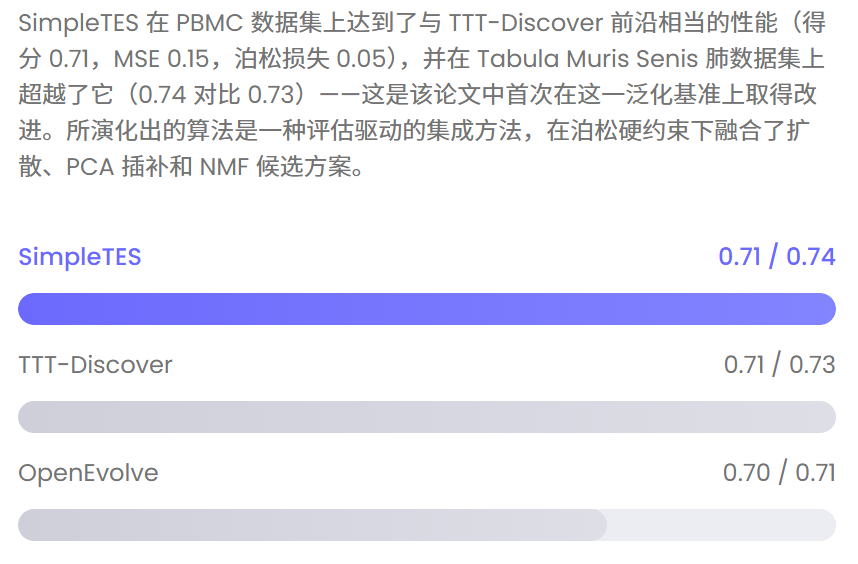

SimpleTES在单细胞RNA测序去噪任务上,发现的集成去噪算法超越前SOTA,且能泛化到未见过的组织类型。

这,才是真正意义上的AI「做科研」!

今天几乎所有的「AI做科研」,无论是自动写代码、自动调参、还是自动发现数学公式,底层都逃不过这样一个循环:

先提一个方案 → 跑一下实验/验证器 → 看结果 → 根据反馈继续改。

这个循环,科学家们已经干了几百年了。

牛顿干过,爱因斯坦干过,你的毕业设计也在这么干。

但问题在于,过去一年AI圈的所有力气,几乎都花在了「怎么让模型在第一步就想得更好」上——更长的推理链、更大的参数量、更花哨的Agent架构。

大家都在卷模型的「脑力」,却几乎没人认真去卷模型的科研工作流。

SimpleTES的研究团队看到了这个盲点。

他们问了一个非常朴素、但被整个行业忽略的问题:

能不能不去折腾模型的脑子,而是把「生成候选解→评估反馈→继续改进」这条发现闭环,在测试阶段系统化地放大?

结论是——当然可以,效果还非常好。

这就是SimpleTES。

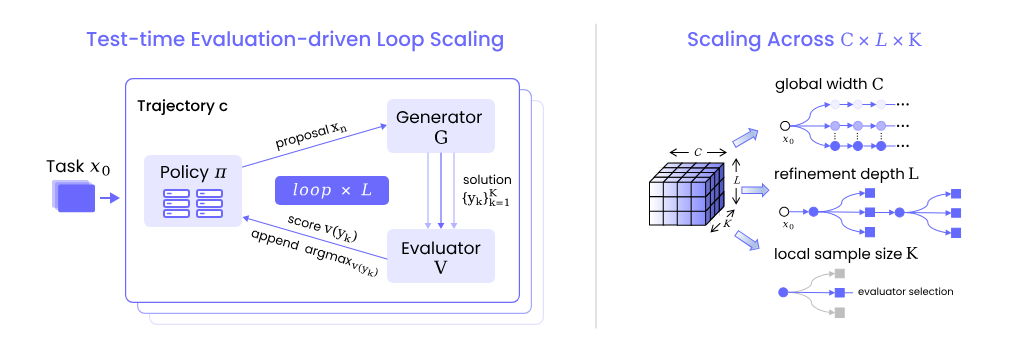

SimpleTES的核心做法并不玄。

它把整个科研试错过程,拆成了三个最关键的维度,像调音台一样精准控制:

第一板斧:别只走一条路(Global Width,并行探索宽度)

传统做法是让模型沿着一个思路越想越深。

问题是,科研不是做选择题——一开始方向走偏了,后面再怎么深度思考都是南辕北辙。

SimpleTES的做法很简单粗暴:同时开C条独立的探索路线,每条路线各走各的,互不干扰。

就好比你同时派了C个博士生,从不同的方向去攻同一个课题。

总有人能找到正确的路。

论文的实验清楚地表明:沿着单条路线反复精修,性能提升很快就会饱和;但增加并行路线数量C,在同样的总预算下,效果提升是实打实的。

第二板斧:每条路都要持续根据反馈往下改(Refinement Depth,迭代精修深度)

每条探索路线不是一次性生成答案就完事了。

它会反复看评估结果,再修补,再优化,循环L轮。

就像一个真正的科研人员拿到了实验数据:第一版方案效果不好?没关系,看看哪里出了问题,改了再来。

第二版还不行?继续改。

关键是这个「改」不是盲改,而是带着评估器的反馈去改。

第三板斧:每一步先海选再定稿(Local Sample Size,局部候选数量)

每一轮迭代中,SimpleTES不是只生成一个方案就押宝,而是先生成K个候选方案,让评估器全部打分,留下最好的那个作为这一步的「定稿」,再进入下一轮。

为什么要这么做?

因为大模型生成内容天生有随机性。

你让它一次只出一个方案,万一这次手抖生成了一个烂方案,整条路线就被带偏了。

先做一轮「小范围海选」,大大降低了被随机噪声带偏的风险。

总预算公式:N = C × L × K

三个维度一乘,就是总的评估器调用次数。

整个框架的精髓,就是如何在这三个维度之间分配有限的预算,让「试错」的效率最大化。

就像是造了一台通用的「AI探索放大器」。

说得再漂亮,不拿真题验证都是空谈。

SimpleTES的研究团队显然深谙这个道理——他们直接把框架扔进了6个领域、21个开放式科学问题里。

结果几乎每个领域都打出了让人倒吸凉气的成绩。

除了上面列的新发现,再来看几个例子。

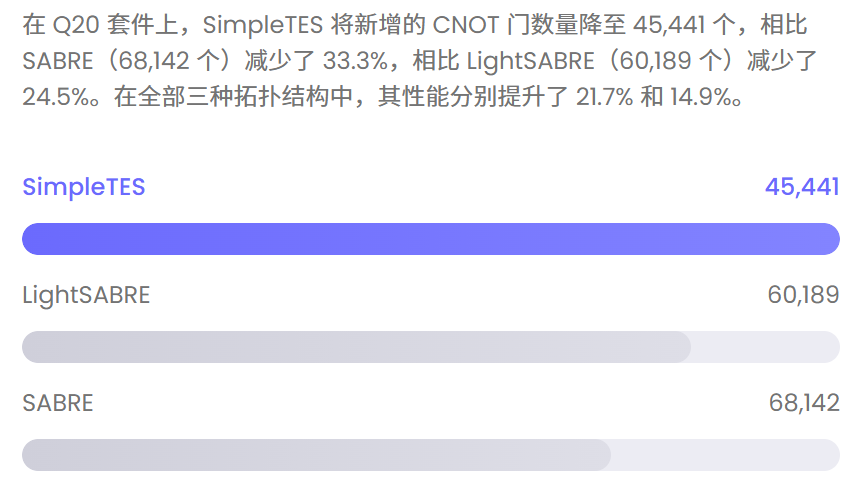

先看量子计算。

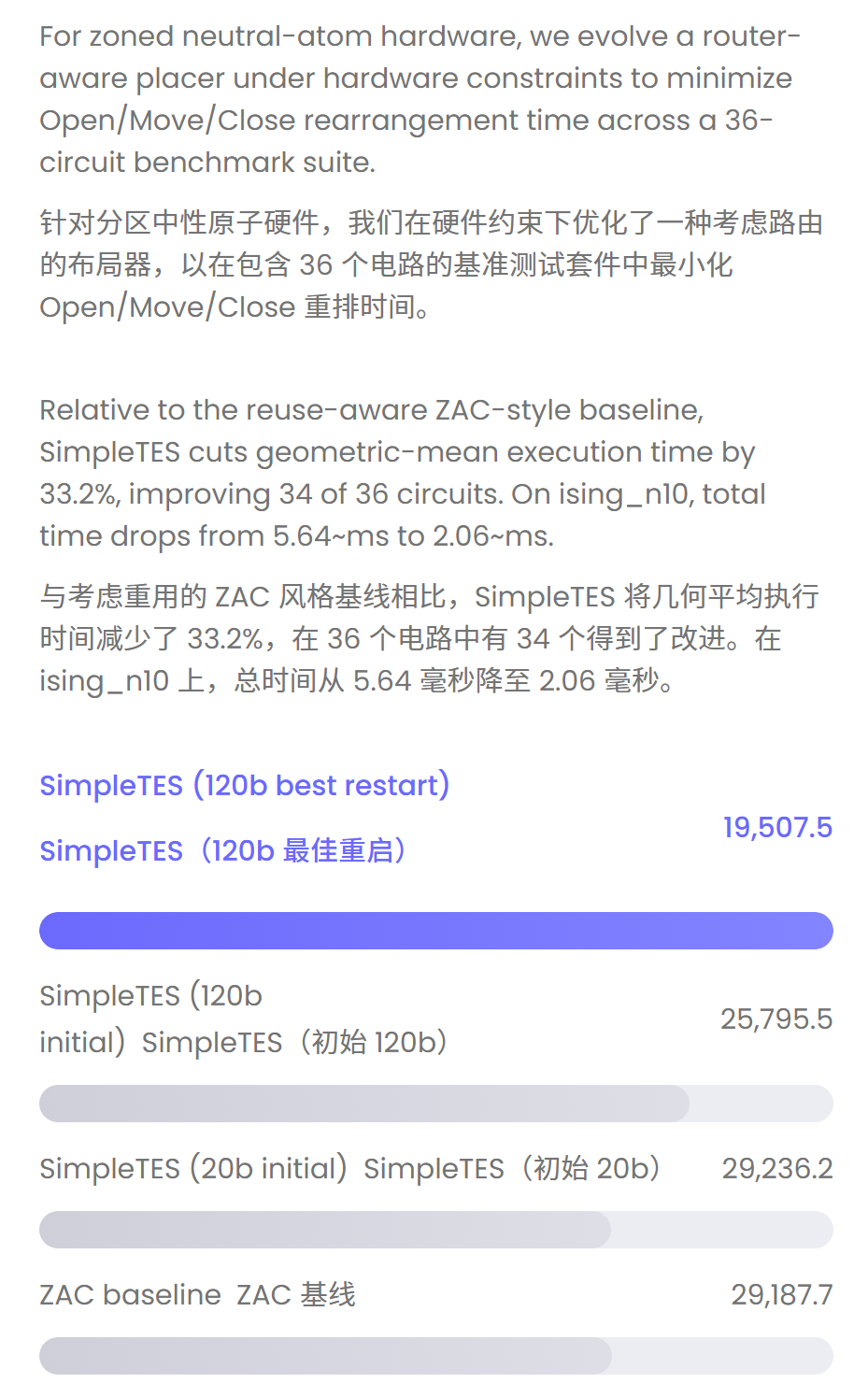

在超导量子计算机架构上,SimpleTES发现的量子比特路由策略,直接把金标准SABRE算法超了21.7%,改进版LightSABRE也被甩开14.9%。

IBM Q20芯片上,额外的CNOT门开销从60,189暴降到45,441,砍掉了将近四分之一。

换到中性原子架构上照样能打——36个测试电路里改进了34个,平均执行时间降了33.2%。

再说GPU优化。

蛋白质结构预测的核心算子TriMul,SimpleTES写出来的Triton程序在H100上跑到1.122毫秒,击败了所有AI方法。

更夸张的是这套方案还能跨硬件迁移——在A100和MI300上同样打败了公开排行榜的最佳成绩,尤其MI300上直接把对手的2.657毫秒压到了1.352毫秒,近乎腰斩。

批量累积求和上,击败经典cub库平均1.52倍,击败CUDA Agent最高达2.91倍。

算法工程这边更离谱。

在AtCoder启发式竞赛AHC058上,SimpleTES从零开始、没有任何算法先验,发现的多重启模拟退火程序直接超越了所有人类选手的提交,10次独立运行的得分分布完全不重叠,赢得毫无悬念。

数学方面同样生猛。

Erdős最小重叠问题,数学家啃了半个世纪的硬骨头,SimpleTES把得分从前AI最佳的0.380871推进到了0.380856。

自相关不等式任务上,分别推进了最佳人类界限6.79%和0.30%。

组合构造的Sum-Difference问题上,SimpleTES设计的新型构造超过最佳人类结果8.03%,超过Google的AlphaEvolve V2达2.05%。

数据科学领域也没放过。

Scaling Law发现任务上,SimpleTES找到的规律比最佳人类推导的规律,外推拟合度提升了352%,而且发现的Scaling Law可以直接用来指导LLM预训练的超参数选择。

这已经是对工业界有直接价值的发现。

最关键的一点:这些成绩,很多并不是靠最贵的闭源模型堆出来的。

而是用开源模型,通过把「试错→评估→迭代」这条链路组织得足够高效,硬生生挤出来的。

如果说SimpleTES的搜索框架是第一个大贡献,那论文的第二个大贡献,解决的是一个更深层的问题:AI做科研时的「短视症」。

SimpleTES在大规模试错过程中,天然会产生海量的结构化探索轨迹——每一步怎么改的、评估器返回了什么、下一步又往哪个方向调整。

这些轨迹本身就是极好的训练数据。

但如果简单地用传统强化学习的方式训练,模型会学到一个很糟糕的习惯:只盯着眼前的分数。

这在科学发现中是致命的。

真正的科研探索是一个长程任务——早期的「失败」往往是后期突破的垫脚石。

你在第三轮迭代中尝试了一个看起来分数下降的方向,可能恰恰是第八轮跳出局部最优的关键一步。

如果模型被训练成「每一步都要涨分」,它就会变得短视保守,永远在局部最优附近打转,再也不敢冒险。

为了解决这个问题,作者提出了Trajectory-Level Post-training,核心思路是:别让模型学「每一步怎么得高分」,而是让它学「一整条探索路径怎么最终找到突破」。

具体怎么做?三步走。

第一,放弃即时奖励,只看最终突破。

把一整条探索轨迹视为一个完整的rollout,不管中间某一步分数涨了还是跌了,只拿这条轨迹最终达到的最高分作为监督信号,反向传播给轨迹中的每一个节点。

第二,精英轨迹筛选。

基于迭代拒绝采样微调(IRFT),只给总分排名前R%的「精英轨迹」赋予训练权重,其余全部丢弃。

同时截断达到最高分之后的冗余步骤,最大化数据效率——只学成功的探索过程,不学无效的尾巴。

第三,动态演进。引入经验回放缓冲区积累历史轨迹,随着模型能力的提升,动态收紧精英门槛R,促使模型逐步把长程突破的策略内化到自身参数中。

模型越强,对它的要求越高,形成正向循环。

结果相当惊人:训练后的模型,不只在见过的问题上搜索效率更高,在完全没见过的新问题上也能找到原始模型找不到的更强解。

这意味着模型不是死记了几个科研问题的答案,而是真正学会了一种可迁移的科研试错元能力——一种「面对反馈如何做出全局最优决策」的通用直觉。

这才是这篇论文真正让人兴奋的地方:它不仅造了一台搜索引擎,还找到了一种方法,让引擎的使用经验反哺模型本身,形成「越探索→越会探索」的飞轮。

SimpleTES的出现,让我们不得不重新审视AI科研的路线图。

过去,我们把几乎所有赌注都压在了「让模型更聪明」这一条路上。

参数从千亿到万亿,推理时间从秒级到分钟级,成本从美元到千美元——仿佛只要脑子够大、想的够久,科学发现就会从天而降。

但科学发现的历史从来不是这样的。

达尔文不是坐在书房里「想出」了进化论,而是花了二十年在加拉帕戈斯群岛和自家后院反复观察、反复验证、反复推翻自己的假说。

爱因斯坦的广义相对论也不是灵感一闪的产物,而是经历了多年的数学试错和思想实验,被无数条走不通的路「逼迫」出来的。

科学发现的本质,从来都不是一击即中,而是一轮轮试错之后,被逼出来的结果。

SimpleTES捕捉到了这个本质。

它的意义不仅在于当前的实验成绩,更在于它指出了一个被长期忽视的扩展轴线:在「生成侧计算」(模型参数、推理长度)之外,「评估侧计算」(试错循环的深度和广度)同样是一个可以持续投入、持续收获的方向。

当这两条轴线同时扩展的时候,AI做科研的能力上限,可能远超我们今天的想象。

更重要的是,SimpleTES提供的不是一个领域特定的技巧,而是一个跨领域通用的方法论——从量子计算到生物信息学,从GPU优化到纯数学。

同一套框架、同一个开源模型,在完全不同的科学领域里都能打出成果。

这种通用性本身,就已经很说明问题了。

它提出的框架简洁、实验扎实、结论清晰,而且开源了代码,可复现性拉满。

这是一篇很可能会深刻影响「AI for Science」未来走向的论文。

最后,聊聊这篇论文背后的核心力量——Will(Wizard Intelligence Learning Lab,宽德智能学习实验室)。

Will是由宽德投资(WizardQuant)孵化的独立AI实验室,但它做的事情,远不止发一篇论文这么简单。

这个实验室的目标极其明确也极其大胆:实现超级科技助手(ASI for Sci-Tech)。

不是做通用聊天机器人,不是做消费级产品,而是要造出一个能真正辅助甚至驱动科学发现和技术创新的AI系统。

SimpleTES只是这个宏大目标下的第一块拼图。

据了解,Will不只是在做上层的框架和方法论——他们同时在训练自己的基座大模型,从预训练阶段开始构建面向科研场景的底层能力。

他们的野心不是在别人的模型上做应用层包装,而是要从地基开始,打造一套为科学发现深度定制的AI基础设施。

预训练基座+科研方法论+评估驱动的发现引擎,三条线并行推进,这种「全栈式」的投入力度,在国内的AI科研实验室中相当罕见。

Will的理念是「Good Will Hunter,AI向善」——造工具,而非造人,服务科研探索、技术创新与知识生产。

他们要以工业级研发的方式探索AI能力的上限,不止于技术的简单落地,而是面向Sci-Tech场景持续推动能力演进。

Will汇聚了来自斯坦福、北大、清华、港科大等顶尖机构的AI人才,追求的是技术复利与持续性领先——把「让AI学会做科研」当作一场长期战役来打。

值得一提的是,宽德作为赞助商参与了今年的ICLR 2026——这场4月23日至27日在巴西里约热内卢举办的全球顶级AI学术会议,与NeurIPS、ICML并列为机器学习领域影响力最大的三大顶会。

|  |

宽德的身影出现在ICLR的赞助商名单中,释放的信号很清晰:这家从量化金融起步的机构,正在以极深的姿态和极长线的投入,介入最前沿的AI基础研究。

从科学理想出发,Will走在长期主义者的长征路上。

SimpleTES只是第一枪。

当一个有资源、有耐心、有技术野心的团队,同时从基座模型预训练和科研方法论两条路径发力,把「让AI学会做科研」当作十年级别的目标来投入的时候——后面的故事,可能比我们想象的来得更快、更猛。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢