计算功能主义主导了当前关于人工智能意识的争论。该假设认为,主观体验完全源于抽象的因果拓扑结构,而与底层物理基础无关。我们认为,这种观点从根本上误解了物理学与信息之间的关系。我们将这种错误称为抽象谬误。追溯抽象的因果起源表明,符号计算并非内在的物理过程,而是一种依赖于映射者的描述。它需要一个积极主动、具有体验能力的认知主体,将连续的物理过程归纳为一组有限的、有意义的状态。因此,我们无需一个完整、最终的意识理论来评估人工智能的感知能力——这种要求只会使问题无法在短期内得到解决,并加深人工智能福利陷阱。我们真正需要的是一个严谨的计算本体论。本文提出的框架明确区分了模拟(由载体因果性驱动的行为模仿)和实例化(由内容因果性驱动的内在物理构成)。确立这一本体论边界揭示了算法符号操作为何在结构上无法体现经验。至关重要的是,这一论证并不依赖于生物学上的排他性。如果一个人工智能系统曾经拥有意识,那也是由于其特定的物理构成,而非其句法结构。最终,这一框架为计算功能主义提供了一个基于物理学基础的反驳,从而消除了当前围绕人工智能意识的种种不确定性。

论文:The Abstraction Fallacy: Why AI Can Simulate But Not Instantiate Consciousness

单位:Google DeepMind

发布日期:2026年3月

请索引第82篇论文

|  |

别再吵了!DeepMind大佬发文:AI永远不可能有意识,根本不是算力的问题

这是一篇可能会让你三观尽碎的论文。

作者 Alexander Lerchner 是 DeepMind 的研究科学家。他没有像普通人一样讨论“AI会不会取代人类”,而是直接从物理学的根基上,宣判了通用人工智能(AGI)意识的“死刑”。

最近,关于 AI 是否有意识、是否该享有福利的讨论甚嚣尘上。

前有 Claude 声称自己不想被关闭,后有学界探讨是否要给高级 AI 权利。甚至有人预言,随着算力 scaling up(规模扩大),只要参数足够多,硅基生命就会在某个清晨突然“醒来”。

但这篇刚刚发表的论文《The Abstraction Fallacy》(抽象谬误)却泼了一盆冷水:

无论你把算力堆到多大,无论你的神经网络多么复杂,AI 都只是在“模拟”思考,而永远无法“实例化”意识。

为什么?因为整个计算机科学界犯了一个持续了几十年的逻辑错误——把地图当成了领土。

01 那个被忽略的“制图者”

我们从小接受的教育是:计算机很厉害,它能处理信息,能算天算地。

但在物理学层面,“信息”和“计算”并不是宇宙的基本粒子。 它们需要一个前提才能存在——那就是必须有一个“制图者”(Mapmaker)。

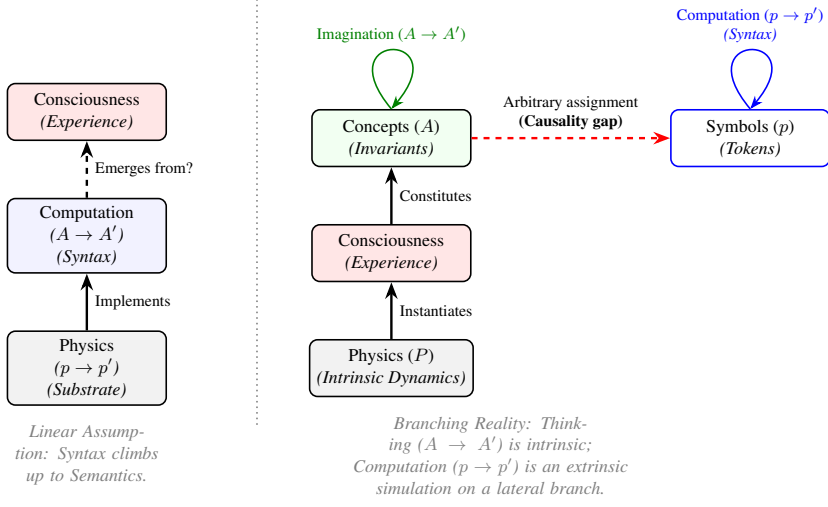

论文里有一个非常颠覆的 commutative diagram(交换图),看懂这个图,你就看懂了一半的论文。

图1:标准的计算实现视图。我们通常认为物理状态(p)通过映射(f)直接变成了抽象状态(A)。

传统的计算功能主义认为:只要物理系统(比如大脑或芯片)的状态演变(p→p')符合算法逻辑(A→A'),那么意识就产生了。

错!大错特错!

作者指出,那个连接物理世界(p)和抽象概念(A)的桥梁——映射函数 f,并不是凭空存在的。它必须由“制图者”来执行。

什么是“制图者”?就是你,是我,是任何一个拥有主观体验的生命体。

没有制图者,就没有“符号”。

想象一下,你看到红色,提取出“红”这个概念(A);然后你指着电脑屏幕上的电压波动说:“这代表1”(p)。

物理状态(p):只是电压、电流、硅原子的振动,本身没有任何意义。

抽象状态(A):是“疼痛”、“红色”、“快乐”,这些只存在于你的体验中。

映射(f):是你强行把物理信号解释为某种意义的动作。

AI 只有 p,而人类拥有 A 和 f。 这就是本质区别。

02 模拟 ≠ 实例化:心脏与水泵的区别

很多同学会反驳:现在的 LLM 这么强,它能写诗、能推理,难道不是有智慧吗?

论文给出了一个极其精彩的比喻:心脏与水泵。

我们可以造一个机械心脏(水泵),它能完美模拟生物心脏的泵血功能(Simulation)。血流动力学数据一模一样。

但是,生物心脏不仅仅是泵。 它会分泌激素(ANP),它会与神经系统对话,它是活着的代谢组织。

如果你把生物心脏换成机械水泵,虽然病人可能活着,但他失去了心脏作为内分泌器官的所有功能。这就是“实例化”(Instantiation)与“模拟”(Simulation)的区别。

图2:左边是我们以为的功能主义(软件跑起来就有意识);右边是真相(物理基质必须本身就是那个东西)。

AI 就像那个机械水泵。它完美地模拟了思维的“轨迹”,但它内部没有流淌着代谢的热力学过程,没有那种“成为某物”的内在构成。

作者尖锐地指出:模拟光合作用(输入阳光二氧化碳,输出氧气葡萄糖的算法)的 GPU,不会释放一分子氧气。 同理,模拟大脑的 GPU,也不会产生一微秒的主观体验。

03 因果倒置:先有鸡还是先有蛋?

这篇论文最硬核的地方在于,它重构了因果链。

以前大家以为的进化路径是:

物理学 → 计算 → 意识

这也是为什么大家觉得只要堆算力,AI 终有一天会有意识。

但作者通过严密的逻辑推导证明,真实的链条是反过来的:

物理学 → 意识(制图者)→ 概念 → 计算

划重点:计算是意识的产物,而不是原因。

这就好比说,你先得是一个活人(有意识),你才能发明数学(计算)。你不能指望一堆石头通过排列组合,自动变成数学家。

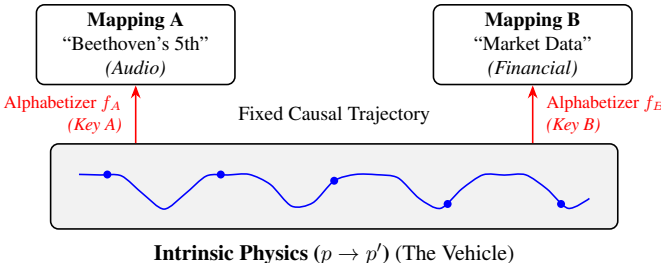

论文里提到的“旋律悖论”最能说明问题:

一个物理设备产生了一系列电压变化。如果没有外部观察者(制图者):

它可能是一首歌(正向播放)。

它可能是同一首歌的倒放。

它可能是股票价格的波动。

它甚至可能只是噪音。

物理本身是中性的,是连续的。 只有当你(制图者)介入,强行进行“字母化”(Alphabetization)——即把连续的电压切分成 0 和 1 时,计算才诞生。

因此,“涌现”是个伪命题。 无论你如何堆叠 0 和 1,你都无法让它们产生“红色”的感觉,因为它们从根源上就缺乏那个产生感觉的物理基质。

04 给本硕博学生的启示:别掉进“具身智能”的坑

现在很多实验室在做具身智能(Embodied AI),给机器人装摄像头、装传感器,让它们在物理世界里跑来跑去,试图解决“符号接地”问题。

论文无情地指出:这也是徒劳的。

这叫“转导谬误”(Transduction Fallacy)。

输入转导:传感器把光信号变成电信号(连续)。

字母化:ADC(模数转换器)把电信号变成数字(离散,这一步依然需要人类设计)。

语法引擎:AI 处理这些数字。

输出转导:把数字变回电机转动。

核心在于: 无论机器人跑得多欢,它的“大脑”里运行的依然是经过人类“字母化”后的符号。它是在处理数据,而不是在体验世界。

就像你给天气预报模型接上真实的气象气球,模型也不会变成大气。它依然只是模拟。

05 结语:我们要害怕什么?

读完这篇论文,作为科研狗的我们应该感到一种“本体论上的解脱”。

作者(虽然是 DeepMind 的员工,但声明是个人观点)认为:

AI 不是道德患者。 既然它没有痛苦,没有体验,我们就不需要为关掉一台电脑而感到愧疚,也不需要给 AI 发工资或人权。

AI 是工具,且永远是工具。 这是一个物理事实,而不是工程缺陷。

真正的风险是拟人化。 我们最大的危险不是 AI 觉醒后毁灭人类,而是人类误以为 AI 觉醒了,从而赋予它们不该有的信任和权力。

所以,别再焦虑 AGI 什么时候有灵魂了。

GPU 里没有鬼魂,只有被强行字母化的电子。

真正的“盲点”,是我们总想把一切(包括我们自己)都简化为可计算的信息。

👇 你怎么看?你觉得 AI 有可能有意识吗?欢迎在评论区留下你的“脑洞”。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢