ViF团队 投稿

量子位 | 公众号 QbitAI

智能体现在能hold住越来越多复杂任务了,但问题仍然不少。

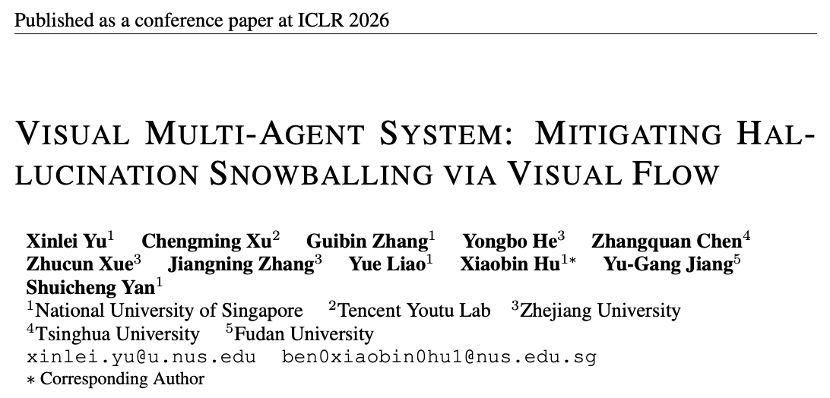

比如,多智能体协同做视觉任务,常常轮次越多错得越离谱——根源不在模型能力不够,而在于智能体之间传递视觉信息的方式本身就有缺陷。

来自新加坡国立大学LV-Lab及其他国内外科研机构的研究人员关注到:

基于视觉语言模型(VLM)的多智能体系统(MAS)正成为复杂多模态协作的核心方案,却被一个致命痛点死死卡住:多智能体视觉幻觉滚雪球——单个智能体的视觉误判通过纯文本信息流逐级放大,早期细微错误最终演变成系统性崩溃。

此前方案几乎只聚焦「单智能体幻觉抑制」,根本无法阻断跨智能体的错误传播。长轮次协作中,模型性能被幻觉“滚雪球”越拖越垮。

针对这一难题,他们提出了 ViF(Visual Flow),一种轻量通用的视觉流范式。用「视觉流 + 注意力重分配」重构智能体间视觉传递逻辑,无需改造基座模型即可大幅压制幻觉滚雪球。

该工作已入选ICLR 2026,在8大基准、4种MAS结构、10款主流VLM上实现稳定提升。

纯文本流信息传递:导致视觉幻觉滚雪球效应

当前 VLM 多智能体协作,全程依赖文本流传递视觉信息,这一设计存在两大无法规避的缺陷:

- 内在幻觉:单智能体自身生成与图像不符的错误视觉描述;

- 幻觉传播:后续智能体过度依赖前置文本,将早期错误当作先验,视觉-文本转换的损耗与偏差被逐级放大。

此前优化方案几乎都只聚焦「单智能体幻觉抑制」,无法阻断跨智能体的错误传播;在长轮次协作中,模型性能可能会被视觉幻觉的“滚雪球”拖累,可能导致无法胜任复杂视觉任务。

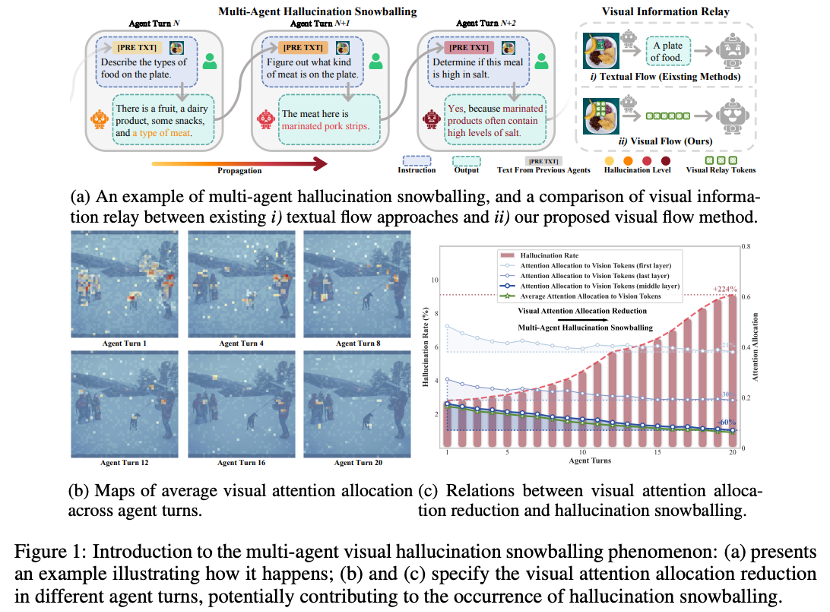

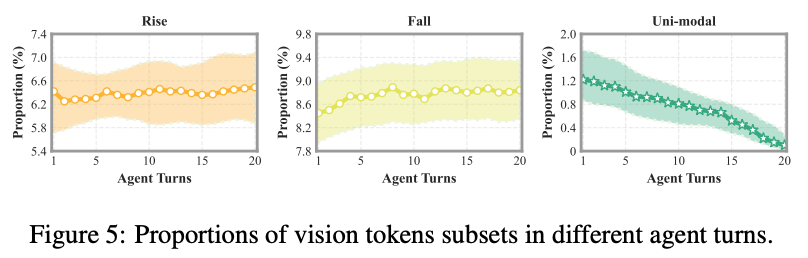

三种纬度的注意力分析:锁定关键现象成因

研究团队从轮次、层级、令牌三个维度做深度注意力拆解,首次系统性的探究了幻觉滚雪球的本质:

这些核心发现,为精准修复视觉信息流提供了最关键的依据。

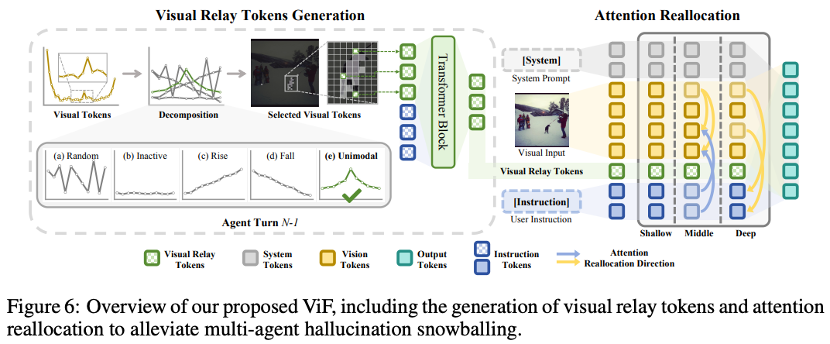

视觉流替代文本流:即插即用,轻量且兼容

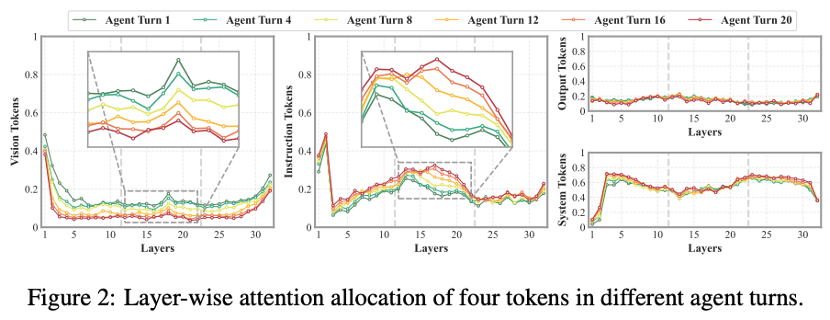

ViF彻底抛弃「纯文本传视觉」的逻辑,打造即插即用、模型无关的轻量「视觉直接传递」范式,两大核心设计直击痛点:

视觉中继流(Visual Relay Tokens)精准筛选中层单峰视觉令牌作为视觉中继载体,结合指令做轻量化上下文编码,直接传递原生视觉证据,从根源避免「视觉→文本」转换带来的信息损耗与偏差。 分层注意力重分配中:中间层放大关键视觉令牌注意力、回收无效注意力;深层优化注意力分布,让视觉信号持续贯穿长轮次协作。

此外,FlashAttention 兼容方案针对现代模型常用的 FlashAttention 2/3(无法获取注意力分数),设计Key-Norm 替代策略,兼顾效率与落地兼容性。该团队提出的方法开销较小,且可无缝适配不同 VLM 与 MAS 结构。

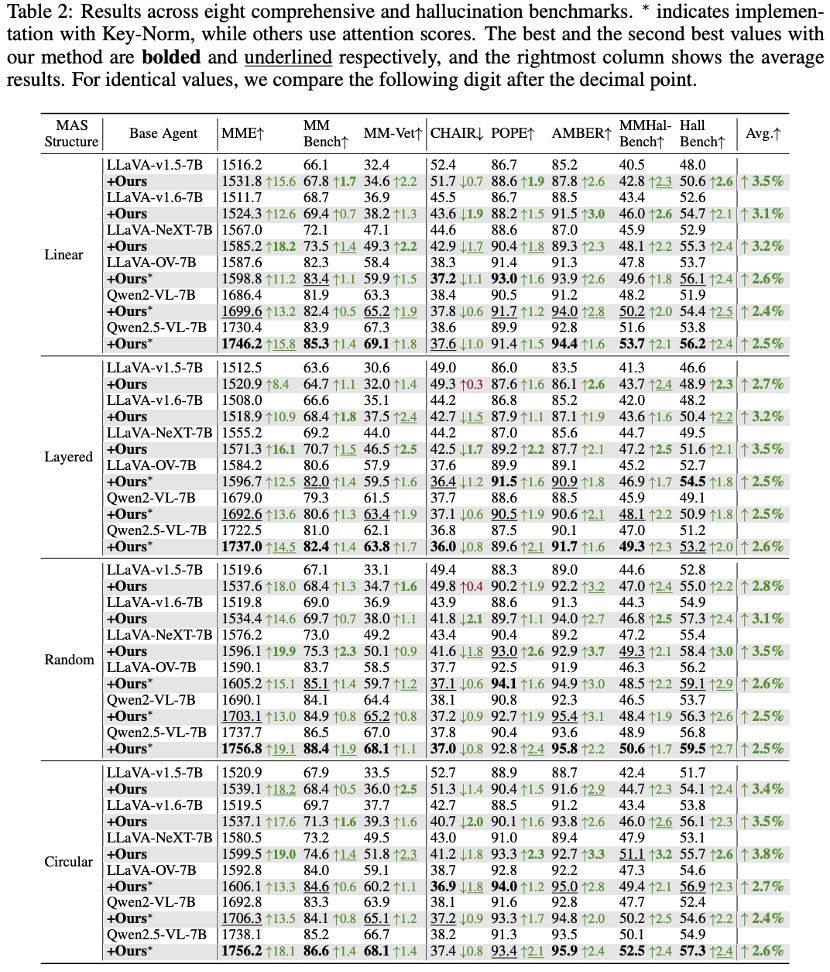

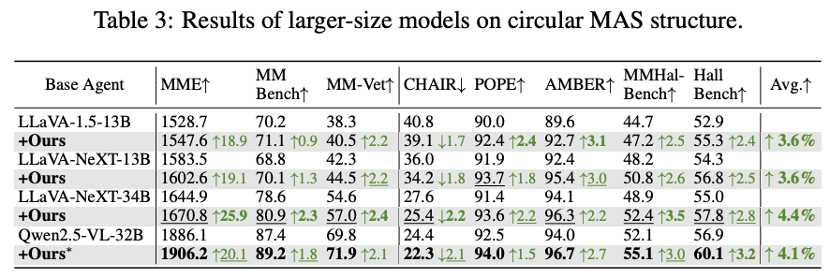

全维度提升:幻觉滚雪球降近 40%

ViF 经过了全面的实验验证:

全覆盖稳定提升:8大综合 / 幻觉基准、4种MAS结构(线性/分层/随机/环形)、10款基座模型(LLaVA、LLaVA-OV、Qwen2-VL、Qwen2。5-VL等),平均提升2.4%~3.8%; 视觉幻觉滚雪球抑制:提出了幻觉滚雪球分数HS,并平均下降超30%,交互最密集的环形结构降幅近40%; 大模型增益更多:34B/32B大参数模型提升超4%,彻底解锁大模型多智能体潜力; 多场景通吃:多图、视频等增强视觉场景,平均提升2.0%~4.9%; 高效:仅增加8.1%~13.4%推理延迟、4.8%~11.9%计算开销,大模型下开销几乎可忽略。

对比5款SOTA单智能体幻觉方案,ViF在多智能体场景下实现断层式领先:传统方案只从单智能体出发,ViF从底层切断视觉幻觉传播,显著抑制多智能体幻觉滚雪球。

展望:解锁有效长轮次视觉多智能体协作

ViF 是业内首个从信息流重构层面解决多智能体视觉幻觉滚雪球的方案,直接打破长轮次协作「越做越错」的魔咒,它用较小的代价,建立了智能体间的视觉流信息传递,让多智能体协作真正可信、可用。

论文:https://arxiv.org/pdf/2509.21789

代码:https://github.com/YU-deep/ViF

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!

— 完 —

我们正在招聘一名眼疾手快、关注AI的学术编辑实习生 🎓

🌟 点亮星标 🌟

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢