点击蓝字

关注我们

核心概念解释

01

什么是“AI蒸馏”

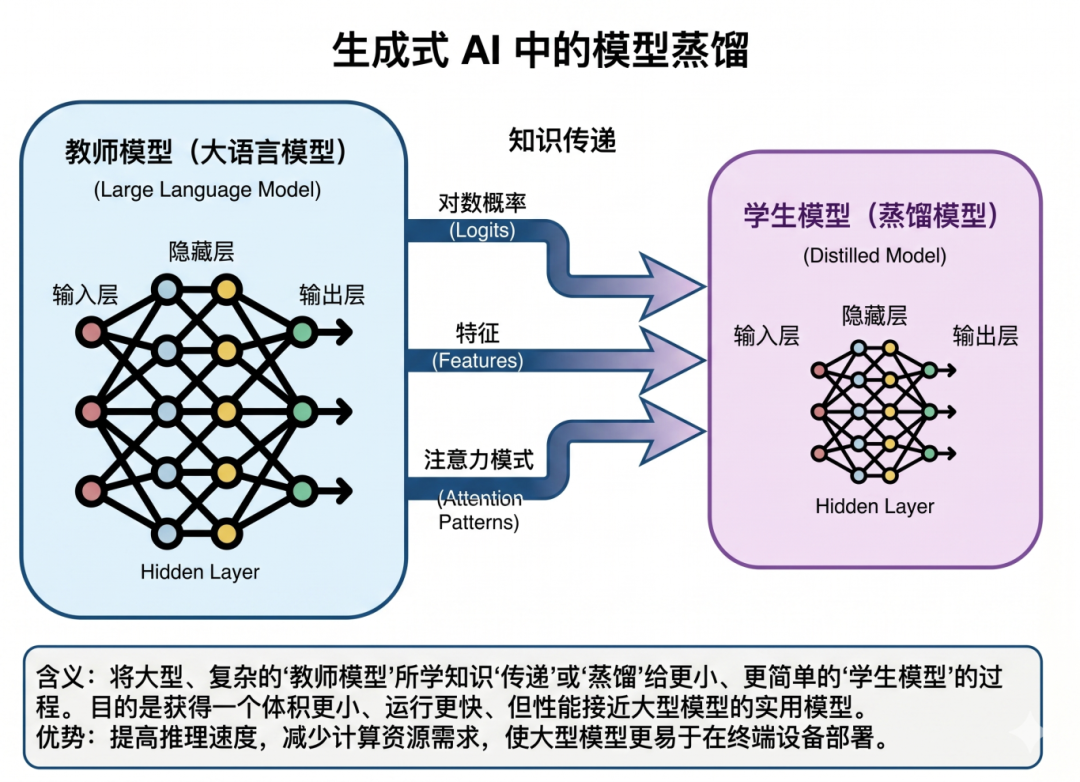

"蒸馏"(distillation)是AI行业一项常见的技术做法:用一个能力较强的"大模型"产生输出,再用这些输出去训练一个能力较弱、规模较小的"小模型",让后者以更低的成本接近前者的部分能力。这一方法由Google研究员Hinton等人于2015年提出,最初用于让小模型学到大模型的知识。在今天的AI研发中,蒸馏被广泛用于生成训练数据、压缩模型规模、降低推理成本。

02

什么是”蒸馏攻击”

"蒸馏攻击"(adversarial distillation)则是美方近期新造的一个政策概念:指未经授权地通过商业API大规模调用某公司的领先模型,把模型输出用于训练直接的商业竞品。美方头部AI公司将这种使用方式判定为违反其服务条款(即合同违约),并近期点名指向中国头部AI公司。

理解这两个概念的区别是讨论本文话题的前提:蒸馏作为一项技术本身合法且普遍;只有当它被用于训练直接竞品并违反服务条款时,才进入"蒸馏攻击"这一新造范畴。而这一区分在美方政治话语中常被模糊化。

2026年4月22日至28日,是美国涉华AI政策密集的一周。4月22日,美国参议院司法委员会举行题为"私密窃取:中国对美国创新成果的持续盗窃"(Stealth Stealing: China's Ongoing Theft of U.S. Innovation)的听证会;

同日,众议院外交事务委员会一致通过《阻止美国AI模型被窃取法案》(Deterring American AI Model Theft Act),并推进20项出口管制相关法案。次日,白宫科技政策办公室主任迈克尔·克拉西奥斯(Michael Kratsios)发布题为《美国AI模型的蒸馏攻击》的备忘录,指控"主要位于中国的外国实体正在开展工业规模的'蒸馏'活动"。4月28日,众议院拨款委员会首次将涉华AI条款写入《2027财年国务院拨款法案草案》,要求识别中国"特定的AI领先者"。这一组动作密集、措辞激烈,构成了华盛顿涉华AI叙事的"窃取"基调。

本文通过解读参议院听证会上一位美方智库专家——海伦·托纳(Helen Toner)的书面证词,把"蒸馏攻击"叙事放回事实与法律的坐标系中考察。

Helen Toner

美国乔治城大学安全与新兴技术中心(CSET)临时执行主任,深耕AI与国家安全政策研究7年。

2021至2023年间曾任OpenAI董事会成员,是2023年OpenAI董事会风波中的关键人物之一。

她当日提交的11页书面证词,由其2025年5月在众议院司法委员会知识产权与AI小组所作证词改写而成。值得指出的是:在这一波密集的涉华AI政策表态中,托纳证词在整体调性上显著克制于克拉西奥斯备忘录、众议员比尔·海曾加(Bill Huizenga)等同期声音。

她明确反对将"蒸馏攻击"作为单一焦点设计政策,并以"中国AI研究人员的真正创新能力"作为对中国AI产业发展原因的部分解释。这种克制并非偶然——它来自一位曾深度参与美国前沿AI公司治理、对该产业内部运作较为了解的研究者。本文对该证词进行编译与分析。

核心速看

托纳明确肯定中国AI研发的创新能力。她在证词中指出,中国AI科学家与工程师"具有真正的创新能力"(genuinely innovative),强调"将政策建立在'中国进步纯粹依赖窃取'这一假设之上是错误的"。

"蒸馏"是AI研发主流工作流的常规组成部分。托纳证词与中文媒体此前的报道一致:蒸馏本身是一项合法、常见的技术——Google的Gemini Flash系列即由更大的Gemini模型蒸馏而来;

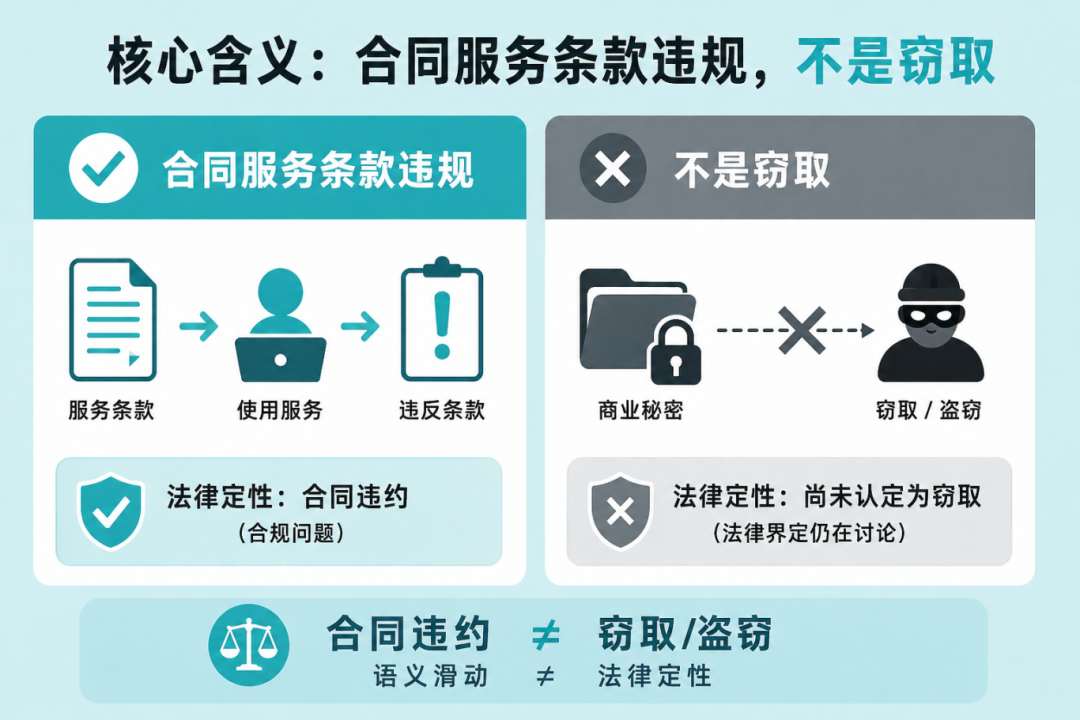

"违约"不等于"窃取"。 OpenAI、Anthropic、Google对所谓"蒸馏攻击"的判定,是违反其服务条款——即合同违约(contractual violation)——而非严格法律意义上的"窃取"(theft)。

美方三家头部AI公司的"蒸馏攻击"指控均缺乏独立核实路径。如Anthropic报告称深度求索、月之暗面、稀宇科技通过逾24,000个账户进行逾1,600万次"被Anthropic判定为蒸馏意图"的交互。但三家公司的判定依据、误判风险与申诉机制均未公开披露,相关指控主要依赖各公司单方面陈述。

政府对前沿AI的开发的"知情盲区",被托纳列为更基础的国家安全议题。Gemini 3、GPT-5.4、Claude 4.7、Grok 4等前沿系统几乎完全在私营企业内部开发,美国国会与行政部门对其了解极为有限。托纳认为,披露与透明度义务是不同政治立场AI政策专家共同认可的最低限度政策路径。

对蒸馏的单点聚焦可能产生反效果。托纳明确警告,把资源集中于反蒸馏,可能挤压本应投入于更严重威胁的执法与防御能力,"在净效应上有害"。

托纳对术语的厘清,是这份证词最具参考价值的起点之一。

她将AI蒸馏定义为:以一个能力更强的"教师"模型的输出,去训练或改进一个能力较弱的"学生"模型。该方法最初由Hinton、Vinyals与Dean于2015年提出,原为图像识别与语音识别模型设计,与今天的大语言模型场景已有所不同。

证词明确指出,蒸馏在AI产业中是一项常规技术。在前沿AI研发中,蒸馏当前最常见的用途是生成合成训练数据——让一个已有模型产出文本,再用这些文本去训练另一个模型。

托纳指出,由于训练数据规模与质量是决定模型能力的关键变量之一,研究者天然倾向于能自动批量生成训练数据的方法。这意味着,蒸馏并非边缘技术,而是AI研发主流工作流的组成部分。问题不在于蒸馏本身,而在于谁在何种条件下使用、用于何种目的。

这一事实判断在中外报道中具有相当一致性。中国财经媒体的报道也指出,"蒸馏本身就是AI训练中的常见技术路径","若用于训练规模更小、能力较弱的模型,这种方法在业内很常见"。这一共识构成了任何严肃讨论"蒸馏攻击"问题的基本前提:对一项合法常见技术的具体使用方式提出指控,必须严格区分技术正当性与商业行为合规性。

2026年初,OpenAI、Google与Anthropic先后公开披露其在自家服务上检测到的所谓"蒸馏攻击"。其中Anthropic在2月23日的报告最为详尽,托纳在证词中引用:三家中国公司——深度求索(DeepSeek)、月之暗面(Moonshot AI)、稀宇科技(MiniMax)——被认定使用逾24,000个账户、进行逾1,600万次"被Anthropic判定为蒸馏意图"的交互。

托纳证词中对法律性质的描述至关重要,值得逐字注意:由于此类使用的目的是训练直接竞品,三家美国公司均认定这违反了其服务条款,即构成合同违约(all three U.S. companies determined that it was in breach of their terms of service, i.e. a contractual violation)。

这一表述在政治叙事中常被遮蔽,但其法律含义是清晰的:所谓"蒸馏攻击"目前被定性的是合同违约,而非严格法律意义上的"窃取"。两者在法律责任、举证标准、可适用救济上存在本质区别。Hrdy 2025年发表于《芝加哥肯特法律评论》的论文(托纳在证词中引用)即指出,"蒸馏是否构成'以不正当手段获取商业秘密',相关法律界定仍在讨论中"。

这一区分对中国读者的意义尤为明显:当美国政界、媒体使用"steal"(窃取)一词时,与企业合规判定中的"breach of terms of service"(服务条款违约)之间,存在显著语义滑动。听证会以"Stealth Stealing"(隐秘窃取/盗窃)为标题,本身已是一种语义升级的政治选择,而托纳证词则在事实陈述上停留在更克制的法律定性。

托纳进一步把"蒸馏攻击"归入一个更宽的范畴——"AI滥用"(AI misuse),包括用AI实施网络攻击、生成儿童性虐待材料、参与诈骗等行为。

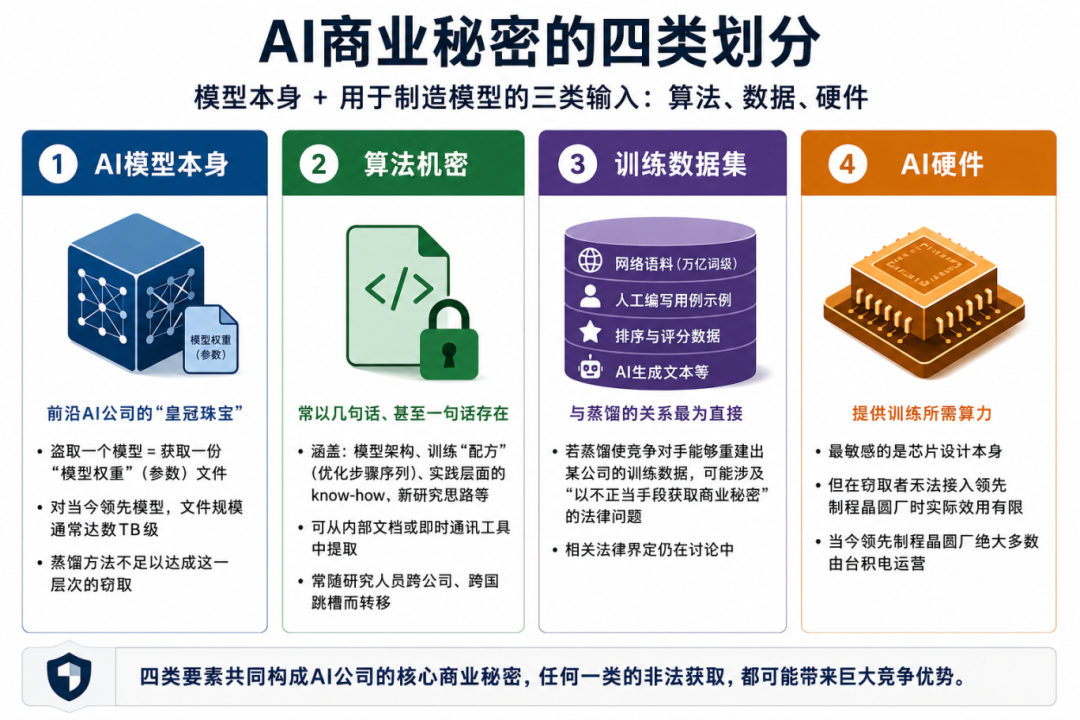

证词最具结构性贡献的部分,是对AI商业秘密的四类划分。托纳将"模型本身"与"用于制造模型的三类输入"——算法、数据、硬件一并列入考察。

第一类:AI模型本身。托纳称之为前沿AI公司的"皇冠珠宝"。盗取一个模型,意味着获取一份名为"模型权重"(model weights)或"参数"的文件——对当今领先模型而言,文件规模通常达数TB级。托纳明确指出:蒸馏方法不足以达成这一层次的窃取。

第二类:算法机密。这是一个总括性概念,涵盖模型架构、训练"配方"(即优化模型的步骤序列)、实践层面的know-how、新研究思路等。算法机密"常常以几句话、甚至一句话的形式存在",可被从内部文档或即时通讯工具中提取,也常常在研究人员跨公司、跨国跳槽时随之转移。

第三类:训练数据集。包括万亿词级的网络语料、人工撰写的高优先级用例示例、人类或AI生成的排序与评分数据、AI生成文本等。蒸馏与这一类的关系最为直接——若蒸馏使竞争对手能够重建出某公司的训练数据,便可能涉及"以不正当手段获取商业秘密"的法律问题。但托纳强调,相关法律界定仍在讨论中。

第四类:AI硬件。提供训练所需算力。最敏感的硬件商业秘密是芯片设计本身,但托纳强调,这类秘密"在窃取者无法接入领先制程晶圆厂时实际效用有限"——而当今领先制程晶圆厂"绝大多数由台积电运营"。

首先:蒸馏本身做不到"整体盗取"一个AI模型。 托纳明确指出,蒸馏只能作为更大训练流程的一部分使用——它不能像有些舆论暗示的那样,"把美国AI模型整个偷走"。

其次:即便存在蒸馏行为,也无法据此解释中国AI的整体进展。仅凭公开信息,托纳认为无法确定蒸馏在中国AI发展中究竟扮演多大角色。已披露的蒸馏规模"提示其确有一定贡献",但"不太可能是中国AI开发者得以快速跟随美国公司的唯一甚至首要因素"。

最后:中国AI是靠真正的研发能力做起来的。 托纳在证词中明确写下:中国AI科学家与工程师具有真正的创新能力(genuinely innovative);将政策建立在"中国进步纯粹依赖窃取"这一假设之上是错误的。

这一表述在以"窃取"为标题的听证会上并不常见,也不属于程式化的礼节性让步。它构成了托纳后续政策建议的逻辑前提:若中国AI能力来源是多元的(包括合法竞争、开源合作、人才培养、本土研发等),那么以反蒸馏为单一焦点的政策,边际效用就有限,反而可能挤占更优先的政策资源。

证词中段,托纳从知识产权问题转向一个看似题外、实则更基础的议题。她的论证从一组反差开始:当今最具战略意义的AI系统,正在被一组私营企业以极快的速度推向极端的能力边界——但美国政府对此几乎一无所知。

托纳使用"frontier AI"(前沿AI)一词指代当前最先进的通用AI系统,并明确点名了四个代表性产品:Google的Gemini 3、OpenAI的GPT-5.4、Anthropic的Claude 4.7、xAI的Grok 4。这些公司正在做的事情有多重大? 证词指出:

这些公司”正在积极建设通用人工智能(AGI),即在大量领域中达到人类专家水平的AI";

这些公司CEO公开声称AGI将在"未来2至5年内"实现——引用了Anthropic的Dario Amodei、OpenAI的Sam Altman、Google DeepMind的Demis Hassabis三人表态;

这些公司自己发布的材料中描述了其AI系统"可能很快带来的严重风险",包括协助高强度网络攻击、使业余人士能实施生物恐怖袭击、以及"可能完全规避人类控制"。

托纳由此指出:在美国历史上,这种具有这种量级战略意义的技术,通常在政府主持下、或在与政府密切关联的企业中开发——核武器、半导体、互联网早期发展皆是如此。而今,越来越先进的AI系统"完全在私营企业内部开发,国会与行政部门几乎无可见性"。

在"透明度赤字"诊断之上,托纳给出了她的方案——以披露义务作为联邦层面缺乏统一AI监管时的最低限度路径。她将透明度路径分为三类:

向公众披露:信息差缩减作用最大,但对商业或国家安全敏感的信息不适用;

向政府披露:适用于与国家安全直接相关的信息,如AI模型在网络作战、生化武器、核武器等领域的能力测试结果;

向第三方审计方披露:兼顾灵活性与保密性,可由独立机构在AI公司设施内、在保密协议下完成审计。

随后,托纳列出五类应优先纳入披露范围的信息——值得注意的是,这五类信息与前文所述的四类商业秘密几乎不重叠:

1. AI模型能力与风险测试结果。当前关于AI能力进展的信息,由公司"按其便利的时间表与格式自行决定是否分享",托纳认为这使政府处于"巨大劣势";

2. 模型被训练去追求的目标与规范。这关乎"言论自由vs避免仇恨言论""支持用户vs避免谄媚"等政治意涵浓厚的取舍。托纳特别提到,OpenAI与Anthropic自愿披露了这一类信息的部分版本;

3. 风险管理"安全论证"(safety case)。 即开发者解释"为何认为当前风险管理实践已足够"的高层文档,敏感细节可作脱敏处理;

4. AI内部使用情况与AI研发自动化进展。 这一项指向AI研究界长期讨论的"智能爆炸"情景。托纳引用了她自己作为合著者之一的CSET 2026年报告《当AI建造AI》

5. 举报人报告。 现行举报人保护法主要针对明确的违法行为,对AI公司员工就"公共安全风险"提出的关切覆盖不足。她明确支持参议院司法委员会主席Grassley提出的《AI举报人保护法》。

托纳在证词末尾提出七项政策建议,可归为三组:

01

加固美国AI产业的防御侧

建议1:深化政企安全协作。现有平台包括NSA下属的"AI安全中心"与NIST下属的CAISI,应予强化。

建议2:澄清反垄断指引,解锁企业间防御协调。据托纳所述,"企业法务部目前限制此类协调,以避免反垄断责任",这阻碍了AI公司间共享威胁情报。

建议3:审视州层面就业法对企业人员审查的限制。但相关措施必须"如手术刀而非大锤",重点是识别个别人员,而非以反移民立法,进而损害"外籍人士对美国AI竞争力的巨大贡献"。

建议6:直接要求前沿AI公司将网络安全置于核心地位。

02

避免单点聚焦造成政策失误

建议4:避免以损害其他优先事项为代价的反蒸馏干预。这是整份证词最具政策导向的论断之一。若反蒸馏措施"限制美国公司产品供应"或"挤占本应用于检测中国对美AI网络攻击的资源",便可能"在净效应上有害"。

建议5:动用执法与情报手段了解中国行为。包括判断中国公司之间是否在协调行动、是否有政府介入等。

03

推动透明度立法

建议7:通过《AI举报人保护法》,并以现有授权(如《国防生产法》)推动前沿AI公司分享其最先进系统的相关信息。

关于建议4:它直接与同期众议院《阻止美国AI模型被窃取法案》及克拉西奥斯备忘录的主张构成张力。托纳实际上是在向参议院传达一个与众议院、白宫均不完全一致的政策信号——单点反蒸馏立法不仅可能效果有限,还可能造成净损害。

编辑|李承兴

审核|赵杨博

终审|梁正 王净宇

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢