现有的电池健康状态(State of Health,SOH)预测方法通常难以同时提供准确的预测结果和可靠的不确定性估计。本文提出了一种新颖的多任务学习(Multi-Task Learning,MTL)框架,该框架通过统一的架构联合解决SOH预测问题,并提供不确定性的代理指标。该框架结合了用于SOH预测的物理信息神经网络(Physics-Informed Neural Network,PINN)和用于不确定性建模的深度自编码高斯混合模型。具体而言,高斯混合模型的能量得分作为不确定性的代理指标,得分越高表示预测的可靠性越低。此外,为了增强特定任务的学习能力,我们采用了一种多头注意力机制,能够自适应地捕捉不同的特征关系。实验结果表明,与现有最佳基线方法相比,我们的框架在预测性能方面有所提升。在六个西安交通大学电池基准数据集上的全面评估表明,我们的框架实现了99.50%的预测准确率(MAPE:0.0050),并通过代理指标提供了可靠的不确定性量化。

请索引第86篇论文

|  |

告别“盲目自信”!用物理信息多任务学习实现电池SOH精准预测与不确定性量化

在AI赋能传统工业的浪潮中,电池健康管理(Battery Management System, BMS)一直是“难啃的硬骨头”。深度学习模型往往陷入“预测很准,但遇到新工况就翻车”的窘境;而加入物理约束的模型,又常常因为现实世界复杂的电化学过程难以用精确公式表达而束手无策。

今天为大家深度解读一篇被人工智能顶会 AAAI 2026 收录的工作——《Physics-Informed Multi-Task Learning for Battery State of Health Prediction with Uncertainty Quantification》。来自南洋理工大学和武汉大学的研究团队巧妙地引入了软约束PINN与多任务学习(MTL)框架,不仅刷新了电池健康状态(SOH)预测的SOTA,更赋予了模型“知之为知之,不知为不知”的不确定性量化能力。

🚨 科研与工程的双重痛点:模型为什么总是“盲目自信”?

在电池寿命预测的实际应用中,我们面临着一个极其尴尬的局面:偏差-方差困境(Bias-Variance Tradeoff)。

确定性模型的“脆皮”属性:像SVR、普通PINN这类模型,虽然能给出一个漂亮的SOH预测点,但它们极易过拟合。一旦工况改变(比如从恒定放电变成随机放电),模型的预测方差急剧增大,甚至给出毫无征兆的“致命误判”。

概率模型的“强 assumption”缺陷:贝叶斯神经网络或高斯过程虽然能给出置信区间,但它们对数据分布的先验假设太强。而真实的电池退化数据,往往是不满足独立同分布(Non-i.i.d.)的。

这就导致了一个致命问题:模型在遇到没见过的退化模式时,依然会“盲目自信”地输出错误结果,而工程师们却毫不知情。

如何打破这一僵局?本文给出了一个极具启发性的答案:多任务互助学习(Multi-Task Learning, MTL)。

💡 核心架构拆解:当“物理直觉”遇上“不确定性感知”

这篇文章的核心亮点在于其优雅的多任务架构设计。它没有直接去硬刚复杂的电化学偏微分方程,而是通过两个任务(SOH预测 + 不确定性评估)的相互正则化,实现了1+1>2的效果。

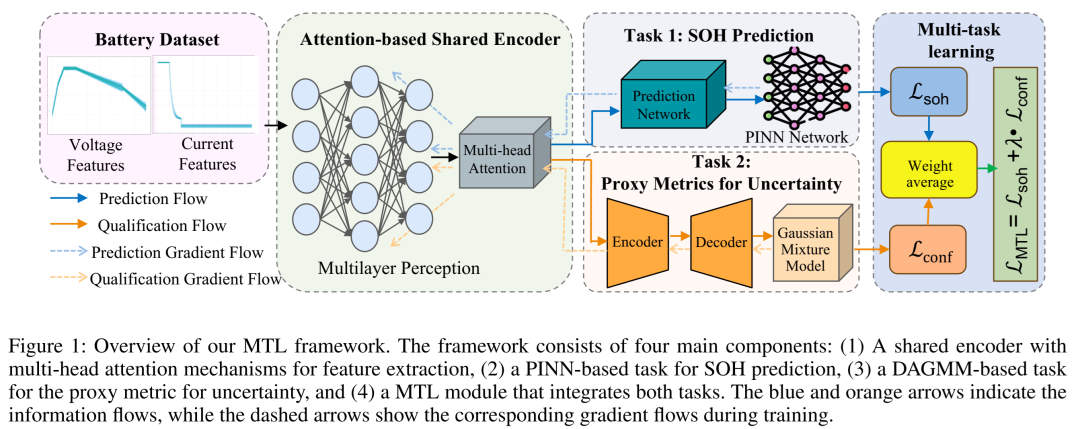

论文提出的MTL整体框架图。框架由四大模块组成:共享编码器(Shared Encoder)、多头自注意力机制(Multi-head Attention)、任务分支1(软约束PINN预测SOH)和任务分支2(DAGMM计算能量得分量化不确定性)。两路梯度共同反哺共享层,使得隐空间既符合物理直觉,又对分布偏移敏感。

🎯 任务1:告别“死记硬背”的软约束PINN

传统的物理信息神经网络(PINN)要求你必须知道明确的控制方程(比如纳维-斯托克斯方程)。但电池内部的电化学反应极其复杂,根本没有显式的符号方程给你用!

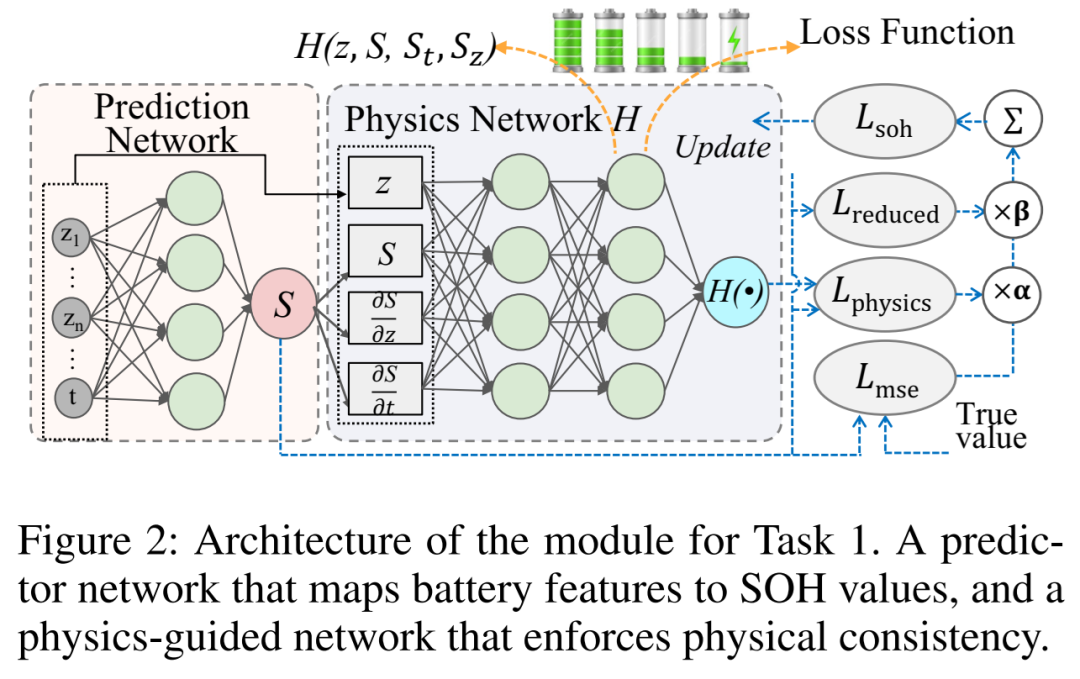

为此,作者提出了软约束PINN(Soft-constraint PINN):

隐含物理正则化:不再强求代入精确的物理公式,而是通过自动微分(Automatic Differentiation)提取潜在表征的梯度(如SOH随时间的变化率 St),将其作为一个“弱先验”注入损失函数。

单调性约束:电池的SOH随着使用必然是衰减的。作者加入了一个惩罚项 Lreduced,只要模型预测出SOH不降反升,就会受到严厉惩罚。

这种设计让模型在不依赖精确物理公式的前提下,依然能捕捉到电池退化的基本物理规律,大大提升了泛化能力。

🎯 任务2:充当“报警器”的深度自编码高斯混合模型(DAGMM)

光有物理约束还不够,我们还需要一个机制来判断“当前的数据是不是超出了模型的认知范围”。

作者引入了DAGMM来充当这个“裁判”:

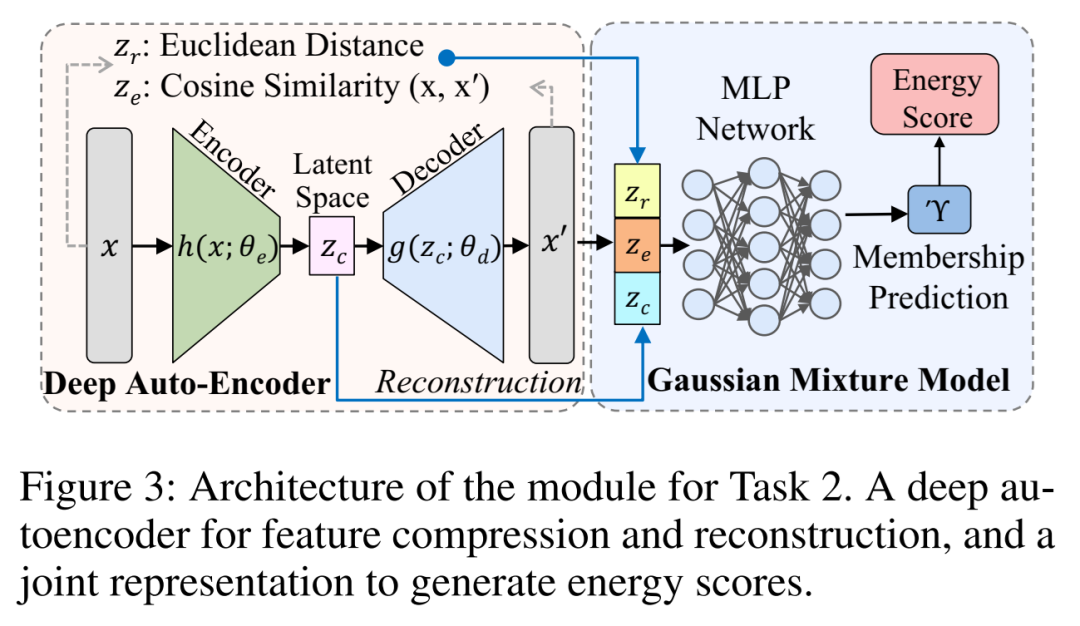

特征压缩与重构:通过自编码器将高维的电池特征(如恒流/恒压充电阶段的统计数据)压缩到低维隐空间,再重构回来。

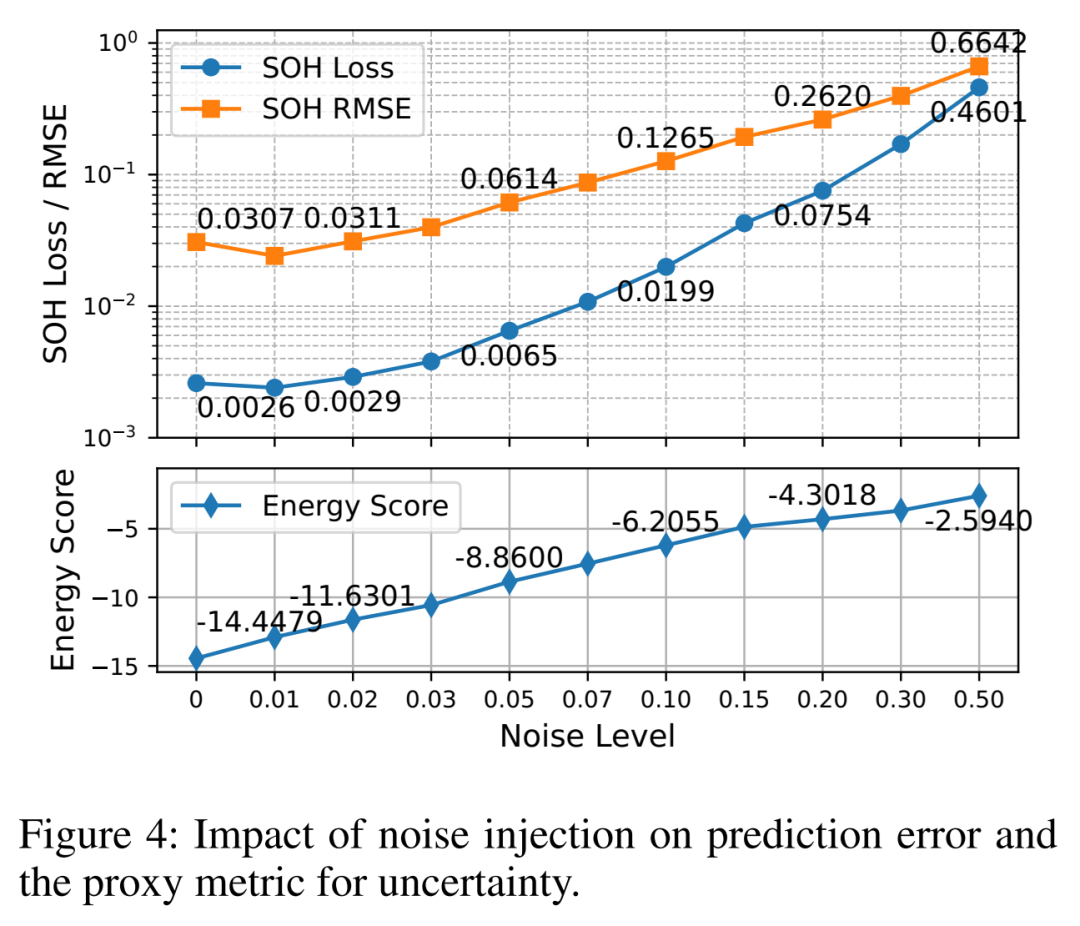

能量得分(Energy Score)作为代理指标:利用高斯混合模型(GMM)拟合正常数据的隐空间分布。当输入一个测试数据时,如果它的隐向量落在GMM的低密度区域,能量得分(本质上是负对数似然 NLL)就会异常飙升。

基于DAGMM的不确定性量化任务流。原始特征经过编码、重构,计算出重构误差和余弦相似度,拼接后送入GMM进行密度估计。最终输出的能量得分(Energy Score)完美充当了不确定性量化的代理指标。论文还从理论上证明了(Proposition 1),输入的高斯噪声越大,期望能量得分越高,验证了该指标的有效性。

🤝 任务交互:双向奔赴的联合优化

这两个任务是如何相互促进的?

SOH预测任务需要稳定的特征表示。

不确定性任务通过DAGMM,将正常样本拉近,将异常样本推开,从而正则化了共享编码器生成的隐空间分布。

两者通过联合损失函数 端到端训练。梯度均衡机制确保了不确定性任务不会喧宾夺主,始终为辅任务(SOH预测)服务。

📈 实验结果:不讲空话,数据说话

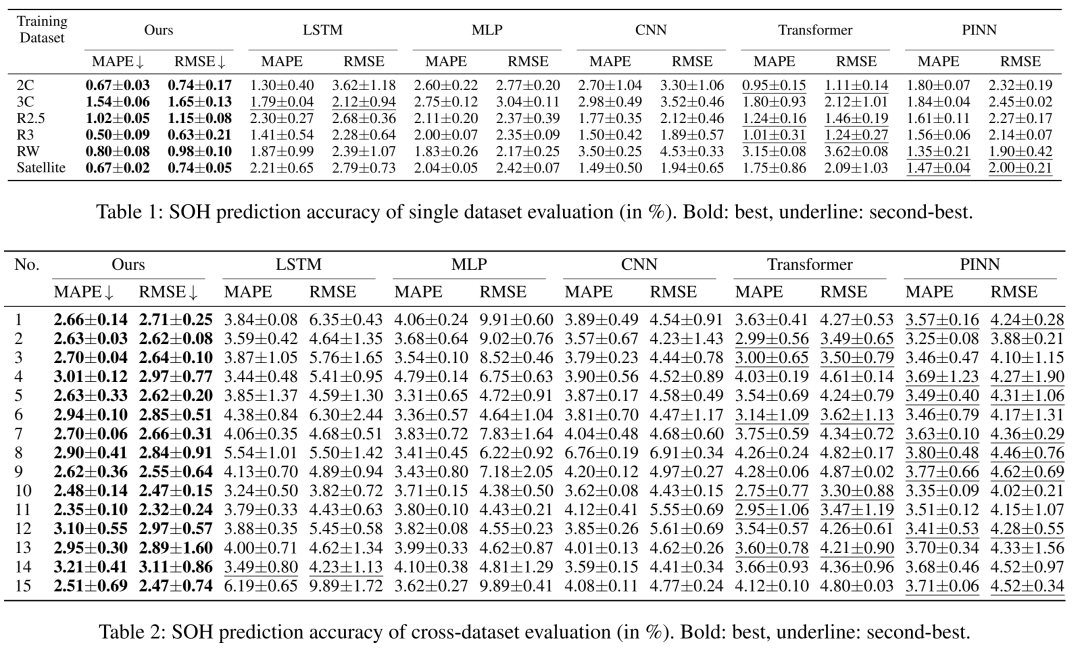

作者在著名的XJTU电池基准数据集上进行了严苛的测试,涵盖了固定倍率(2C, 3C)、变倍率(R2.5, R3)乃至模拟卫星工况的复杂协议。

单数据集训练下的性能对比。在与LSTM、MLP、CNN、Transformer以及目前公认的SOTA模型PINN的对比中,本文的MTL框架在各项误差指标(MSE, RMSE, MAE, MAPE)上实现了全方位碾压。特别是在极具挑战性的随机游走(RW)数据集上,CNN的MAPE飙升至3.50%,而本文模型依然保持了0.80%的极低误差。

核心数据亮点:

逼近极限的精度:在单协议测试中,模型达到了惊人的 99.50% 预测准确率(MAPE仅为0.0050)。在异构协议联合训练中,也达到了 97.65% 的惊人成绩。

跨越分布偏移的鲁棒性:在跨数据集测试中(例如从固定的3C协议泛化到复杂的Satellite协议),相比基础PINN,本文模型将MAPE进一步降低了30.6%。

真正的不确定性感知:模型成功做到了“知之为知之,不知为不知”。对于那些由于环境突变或数据损坏导致的分布外(Out-of-Distribution)样本,模型会通过较高的能量得分明确发出预警,避免了灾难性的盲目预测。

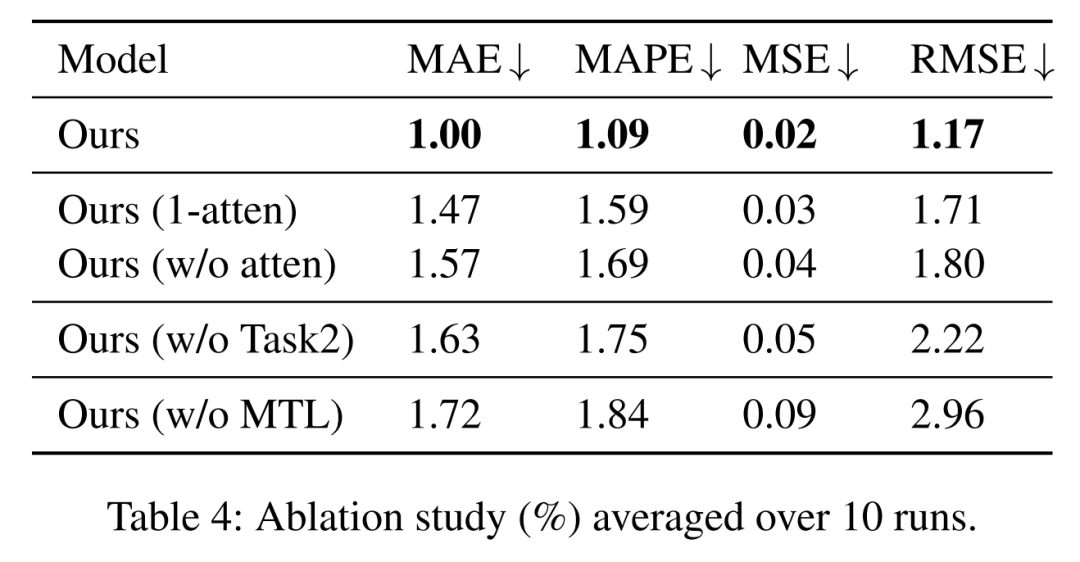

消融实验(Ablation Study)结果。移除注意力机制(w/o Attn)、移除不确定性任务(w/o Conf)或拆解多任务结构(Single Task)都会导致性能下降。这铁一般地证明了:多头自注意力有效捕捉了特征间的非线性依赖,而DAGMM任务的辅助正则化更是提升主任务泛化能力的利器。

🧠 Graph Science Lab 独家解析:这篇论文我们能怎么“抄”?

读完这篇论文,相信大家不仅能学到电池预测的方案,更能从中提炼出通用的科研“套路”:

当物理方程不可得时,用“软约束”替代“硬约束”。

很多跨学科研究卡壳,就是因为真实物理世界太复杂,写不出偏微分方程。这时候,不妨像本文一样,用自动微分提取梯度的单调性、平滑性等通用物理直觉作为正则化项,往往能收到奇效。

用“不确定性量化”拔高论文立意。

单纯刷点(SOTA)越来越难,也容易让审稿人疲劳。引入DAGMM或类似的能量模型来计算分布偏移,不仅能提升模型鲁棒性,更能向审稿人展示你对“模型可靠性”和“工业落地安全性”的深层思考。

多任务学习(MTL)是挖掘隐空间金矿的利器。

如果你的主要任务面临过拟合或数据不足的困扰,不妨构建一个辅助任务(如重构、分类、密度估计),通过共享底层特征提取器,利用辅助任务的梯度来规范主任务的特征空间。

💬 互动话题:

在你的研究领域中,是否也遇到了“精确物理方程未知”或“模型泛化能力差”的困扰?你认为这种“软约束+多任务”的框架还能迁移到哪些场景?

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢