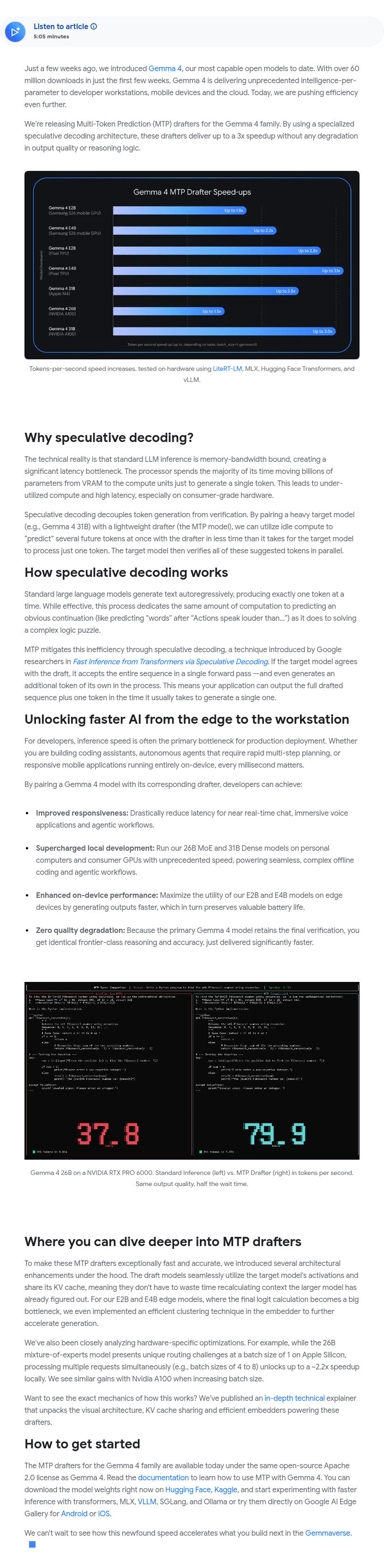

谷歌近日为Gemma 4系列模型推出多令牌预测(MTP)草案器,采用专用的推测解码架构,在不降低输出质量与推理逻辑的前提下,实现最高3倍的生成速度提升。该优化基于LiteRT-LM、MLX、Hugging Face Transformers及vLLM等主流框架,在硬件上实测显著提升tokens/秒性能。此举旨在突破大语言模型推理中普遍存在的内存带宽瓶颈——传统LLM推理受限于频繁将数十亿参数从显存加载至计算单元以生成单个token,导致高延迟。MTP通过并行预测多个候选token并验证其有效性,大幅减少冗余计算与内存访问,从而提升端侧、移动端及云端部署效率。Gemma 4发布数周内下载量已超6000万,此次升级进一步强化其“每参数智能”优势。(200字)

本专栏通过快照技术转载,仅保留核心内容

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢