小米大模型应用团队 投稿

量子位 | 公众号 QbitAI

视频目标消除是一个非常实用的技术:当你在美丽的风景里拍了一段视频或livephoto,而回看的时候发现画面中有不希望出现的内容(比如路人),这时景色已经变换无法再次拍摄,甚至已经离开了拍摄地点,视频消除技术可以挽救你的不完美视频。

在实际研发视频消除任务的过程中,小米大模型应用团队发现了一个普遍存在的问题:

现有的方法大多在理想条件下设计和验证,而真实世界的视频远比论文里的测试场景复杂——模型识别的掩码边缘不够准、物体消除后阴影仍然留在画面里、目标快速移动时逐帧处理频繁“跟丢”导致闪烁……这些问题让许多SOTA方法在真实使用中显得力不从心。

为此,团队提出了SVOR(Stable Video Object Removal)框架,专门针对这三类“不完美条件”设计了对应的解决方案:用MUSE窗口化联合策略解决运动抖动,用DA-Seg去噪感知分割提升遮罩容错能力,并通过课程式两阶段训练让模型真正学会处理阴影和反射残留。

最终,SVOR在多个标准数据集和退化遮罩基准上均达到了新的SOTA水平,并在CVPR 2026物理感知视频实例消除挑战赛中从18支参赛队伍中脱颖而出,荣获第一名。代码现已完整开源。

视频物体消除,到底难在哪?

先说说这个任务的痛点。

在视频编辑与内容创作中,“消除不想要的元素”一直是个高频刚需。然而,当团队将各类方法从论文迁移到真实场景时,往往会遇到重重挑战:用户随手绘制的掩码不够精细;物体虽然去掉了,影子却留了下来;目标一旦快速移动,消除区域还会出现明显的闪烁——这些“不完美”,让许多SOTA模型在实际视频面前显得力不从心。

原因是很多已有的视频消除工作都在完美条件下开展的,但问题在于,现实世界的视频哪有那么多完美条件?

物体在动,光线在变,阴影忽隐忽现,遮罩边缘歪歪扭扭……现有的方法要么留下残影,要么画面闪烁,要么干脆把不该删的也删了。

结合真实世界的使用场景,小米大模型应用团队总结了三类“不完美”:

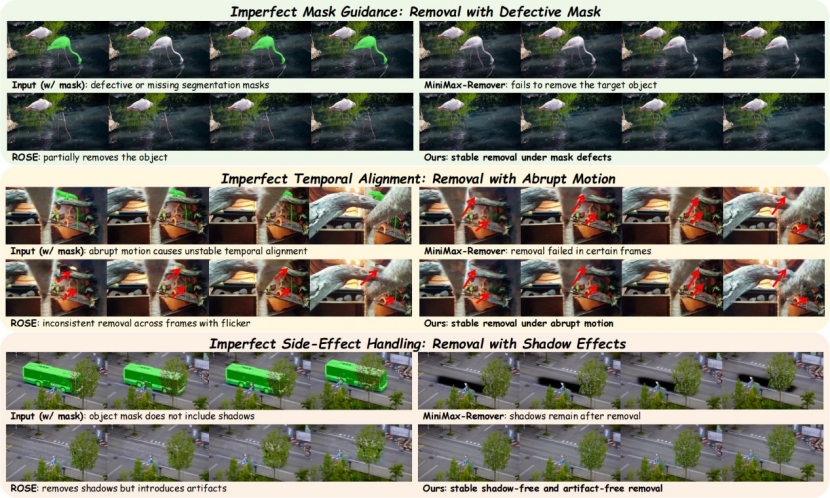

如图,第一类不完美是阴影残留,即物体没了,影子还在;

第二类不完美是运动抖动,即快速移动的物体,容易漏帧;

第三类不完美是遮罩缺陷,即AI识别的边界不准,影响修复效果。

三大核心技术,环环相扣

SVOR的核心思路很务实:先解决不完美条件下的可用性,再追求极致效果。

具体来说,团队设计了三个关键技术:

1. MUSE:让快速运动不再漏帧

MUSE (Mask Union for Stable Erasure) ,中文可以叫”窗口化联合策略”。

它主要解决的是运动抖动问题。打个比方:如果一个物体在视频里快速移动,每一帧的位置都不一样,传统的逐帧处理很容易”跟丢”,导致物体一闪一闪的。

MUSE的做法很聪明:它不把每一帧单独看,而是看一个时间窗口内的整体情况。

就像你拍视频的时候,即使物体在动,你也能凭肉眼追踪它的轨迹。MUSE也是这个思路——通过时间窗口内的遮罩联合,确保快速运动的物体能被完整消除,不再出现”闪一闪又出现”的尴尬。

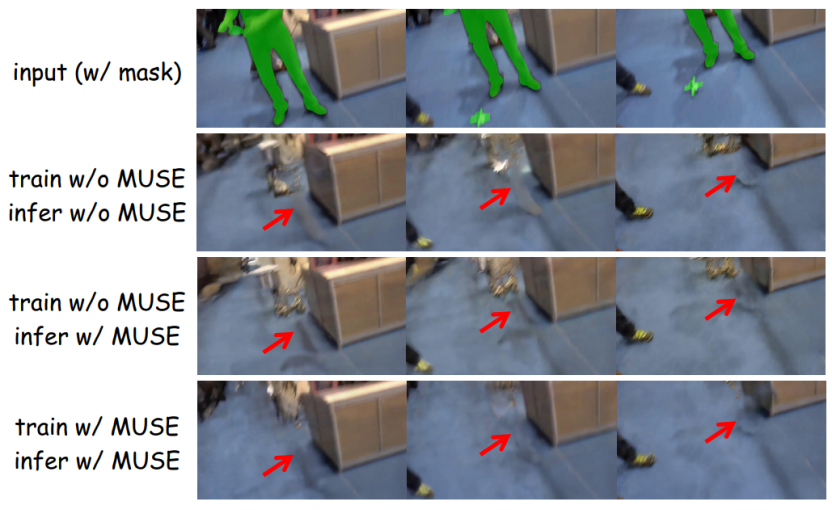

△ 使用MUSE训练和推理,可以明显改善快速运动突变帧消除失效的问题

△ 使用MUSE可以免训练地改善已有方法对快速运动突变帧消除失效的问题

△ 使用MUSE后,抖动掩码也能稳定消除

2. DA-Seg:遮罩不完美?没关系

DA-Seg (Denoising-Aware Segmentation),去噪感知分割。

这个模块专门对付遮罩缺陷。现实中,AI识别的物体边界往往没那么准,有点偏差是常态。

DA-Seg相当于给系统配了个“纠错机制”:即使遮罩不完美,它也能智能修正,不影响最终的修复质量。

可以理解为,它让SVOR有了“容错能力”。

如图,在分割掩码有缺失的情况下,团队的方法在DA-Seg的加持下可用持续稳定的补全缺失掩码,得到更稳定的分割

△ DA-Seg加持,再也不怕分割有缺陷了

3. 课程式两阶段训练:从理论到实战

第三个关键是训练策略。小米采用了课程式两阶段训练:

- 第一阶段

用真实背景视频自监督预训练,让模型学习自然的时序规律 - 第二阶段

用合成数据精调,专门处理阴影和反射

这种“先学走路再学跑步”的策略,让模型跨场景适应能力极强。

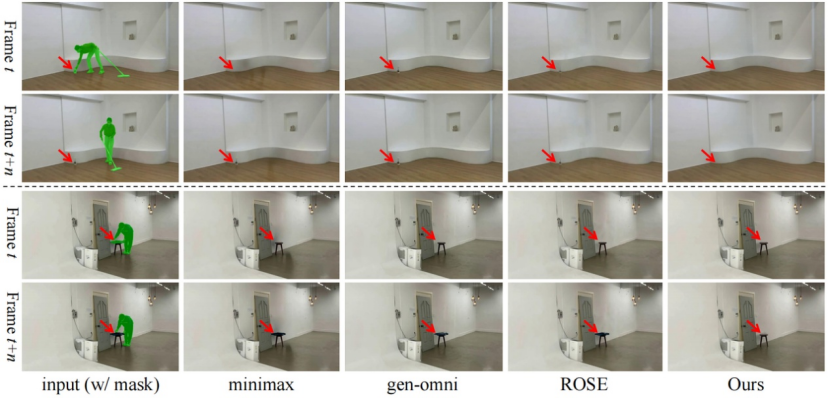

△ 两阶段训练,连人带影一并消除

性能有多强?

说再多技术细节,不如看数据。

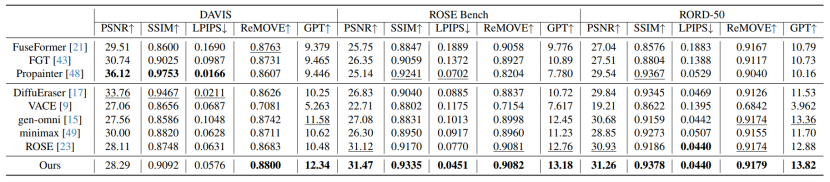

在多个标准数据集和退化遮罩基准上,SVOR都达到了新的SOTA水平。

更关键的是,SVOR对不完美条件的容忍度远超现有方法。这意味着它在真实场景中的可用性大大提升。

对于不同群体,SVOR的价值各不相同:

- 视频创作者:

以后去路人、去杂物会更自然,告别“一眼假”。 - 开发者:

代码已经开源(Apache 2.0协议),可以直接用。 - 整个行业:

视频修复从“实验室玩具”真正走向实用化。

而且,小米选择开源这个决策本身就很值得关注。在视频AI这个赛道,开源意味着生态共建,意味着更多创新应用会涌现出来。

团队相信,视频编辑工具的下一个突破,来自对“真实使用条件”的尊重。SVOR的开源,希望能帮助开发者、创作者和研究者,在实际应用中真正解决视频消除的落地难题。

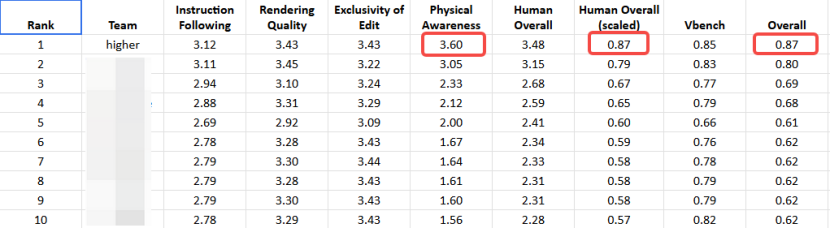

CVPR视频消除大赛冠军

基于SVOR的方案在CVPR 2026物理感知视频实例消除挑战赛(https://xiangbogaobarry.github.io/PVIX-CVPR-VGBE-2026/)中,从18支参赛队伍中脱颖而出,荣获第一名(见结果榜单,Team name: higher),在物理感知、人工评分和总分上大幅领先其他参赛队伍。

△ 结果榜单:https://docs.google.com/spreadsheets/d/18qfBQesVNpHadUP_cdL6T8hPGH_cXrnJ94Z5H-zuibs

One More Thing

论文已经发布在arXiv,项目代码也已开源,甚至贴心准备好skill供大家直接调用,如果你感兴趣,可以让你的龙虾跑起来了 (Claude Code、OpenCode等工具同样可以直接使用)。

- 论文:https://arxiv.org/abs/2603.09283

- GitHub:https://github.com/xiaomi-research/svor

- Skill:https://clawhub.ai/wangfei1204/mi-visionforge-svor

视频物体消除的“最后一公里”问题,小米SVOR给出了自己的答案。

此外,团队在视频消除的评测方案上也做了较多工作,包括评测数据收集整理和创新性评测方法,将在合适的时间进行开源,敬请期待。

你最想用这项技术消除视频里的什么?

欢迎在评论区留言讨论。

一键三连「点赞」「转发」「小心心」

欢迎在评论区留下你的想法!

— 完 —

我们正在招聘一名眼疾手快、关注AI的学术编辑实习生 🎓

🌟 点亮星标 🌟

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢