论文标题:Stereo Radiance Fields (SRF): Learning View Synthesis for Sparse Views of Novel Scenes

论文链接:[https://arxiv.org/abs/2104.06935](https://arxiv.org/abs/2104.06935)

作者单位:图宾根大学 & 萨尔大学 & 卡内基梅隆大学

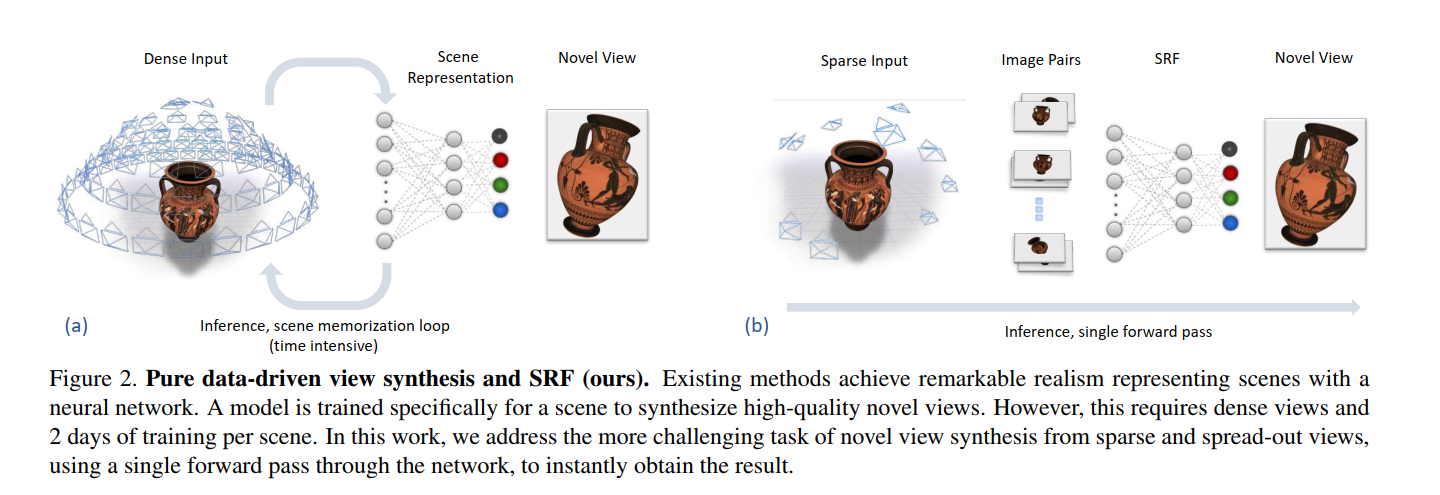

一种端到端的神经多视图合成方法,可以泛化到新场景!在测试时仅需要稀疏视图,表现SOTA!性能优于NeRF、LLFF等网络,代码即将开源!作者单位:图宾根大学, CMU等最近的神经视图合成方法已经取得了令人印象深刻的质量和真实性,超越了依赖于多视图重建的经典流水线。最先进的方法,例如NeRF,旨在通过神经网络学习单个场景,并且需要密集的多视图输入。在新场景上进行测试需要从头开始进行重新训练,这需要2-3天。在这项工作中,我们介绍了立体辐射场(SRF),这是一种经过端到端训练的神经视图合成方法,可以推广到新场景,并且在测试时仅需要稀疏视图。核心思想是受经典多视图立体方法启发的神经体系结构,该方法通过在立体图像中找到相似的图像区域来估计表面点。在SRF中,给定3D点在输入图像中的立体对应关系的编码,我们可以预测每个3D点的颜色和密度。通过成对的相似性集成隐式地学习编码-模拟古典立体声。实验表明,SRF学习结构而不是过度拟合场景。我们在DTU数据集的多个场景上进行训练,并在不进行重新训练的情况下将其泛化到新场景,仅需要10个稀疏和分散的视图作为输入。我们展示了10到15分钟的微调可以进一步改善结果,比特定场景的模型获得明显更清晰,更详细的结果。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢