论文标题:Point Cloud Learning with Transformer

论文链接:https://arxiv.org/abs/2104.13636

作者单位:西南大学

本文提出一种新的点云金字塔Transformer,在3D形状分类,part分割和语义分割上表现SOTA!性能优于SOCNN、ELM和FPConv等网络。

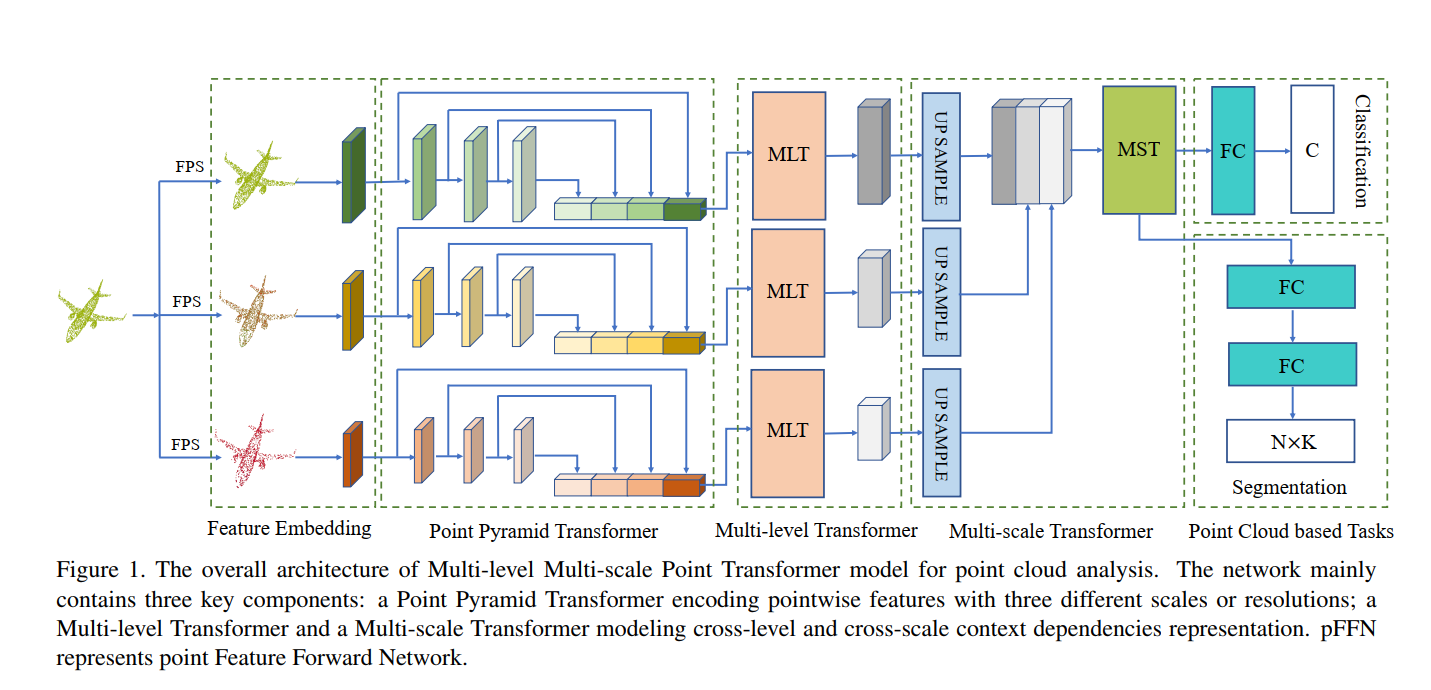

Transformer网络在自然语言处理中的卓越性能促进了这些模型在处理计算机视觉任务(例如图像识别和分割)中的发展。 在本文中,我们介绍了一种新颖的框架,称为多层多尺度点云Tranformer(MLMSPT),该框架可直接在不规则点云上进行表示学习。 具体来说,研究了一个点云金字塔Transformer,以我们定义的不同分辨率或尺度对特征进行建模,然后是一个多层Transformer模块,以汇总来自每个尺度不同级别的上下文信息并增强它们之间的交互作用。 尽管设计了多尺度Transformer模块,以捕获跨不同尺度的表示之间的依赖关系。 对公共基准数据集的广泛评估证明了我们的方法在3D形状分类,part分割和语义分割任务上的有效性和竞争优势。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢