论文标题:Zero-Shot Detection via Vision and Language Knowledge Distillation

论文链接:https://arxiv.org/abs/2104.13921

作者单位:Google Research

本文提出用于Zero-shot目标检测的ViLD网络(视觉和语言知识蒸馏,Vision and Language knowledge Distillation),可将知识从预先训练的Zero-shot图像分类模型(例如CLIP)提取到两阶段检测器(例如Mask R-CNN)中!

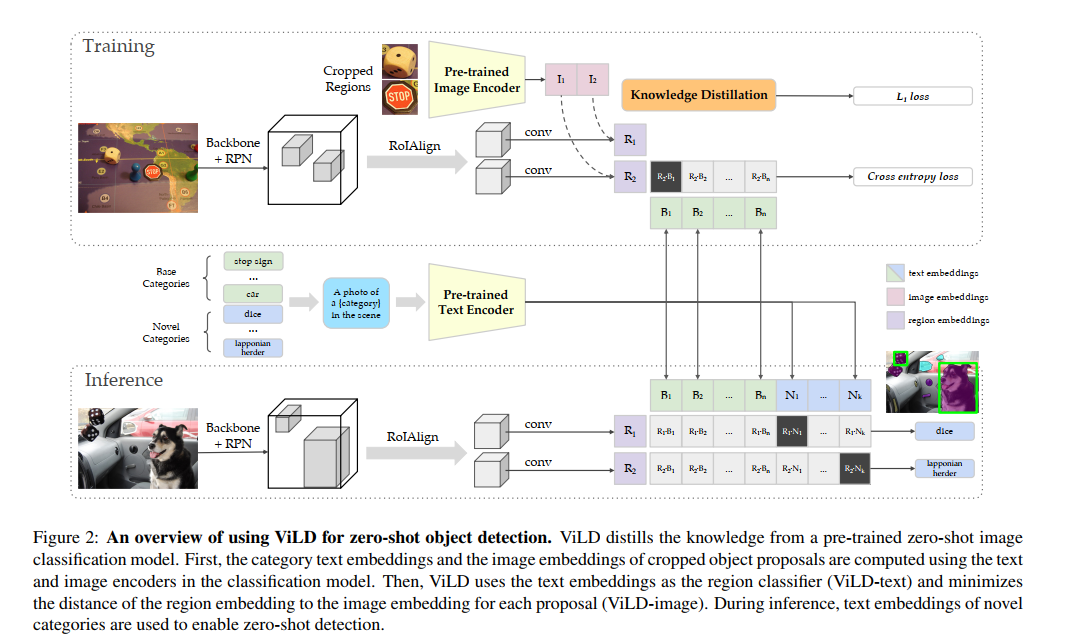

通过训练对齐的图像和文本编码器,Zero-shot图像分类取得了可喜的进展。这项工作的目标是推进Zero-shot目标检测,该目标旨在检测没有边界框或mask注释的新颖目标。我们提出ViLD,这是一种通过视觉和语言知识蒸馏的训练方法。我们将知识从预先训练的Zero-shot图像分类模型(例如CLIP)提取到两阶段检测器(例如Mask R-CNN)中。我们的方法将检测器中的区域嵌入与预先训练的模型推断出的文本和图像嵌入对齐。我们使用文本嵌入作为检测分类器,这是通过将类别名称输入到预训练的文本编码器中而获得的。然后我们将区域嵌入和图像嵌入之间的距离最小化,该距离是通过将区域提议输入到预训练图像编码器中而获得的。在推理过程中,我们将新颖类别的文本嵌入到检测分类器中,以实现Zero-shot目标检测。我们通过将所有稀有类别视为新颖类别来对LVIS数据集的性能进行基准测试。ViLD使用Mask R-CNN(ResNet-50 FPN)获得16.1个Mask APr,用于Zero-shot检测,其性能比监督者高3.8。该模型可以直接传输到其他数据集,分别在PASCAL VOC,COCO和Objects365上达到72.2 AP50、36.6 AP和11.8 AP。

内容中包含的图片若涉及版权问题,请及时与我们联系删除

评论

沙发等你来抢